이 기사는 기계로 번역되었습니다

원문 표시

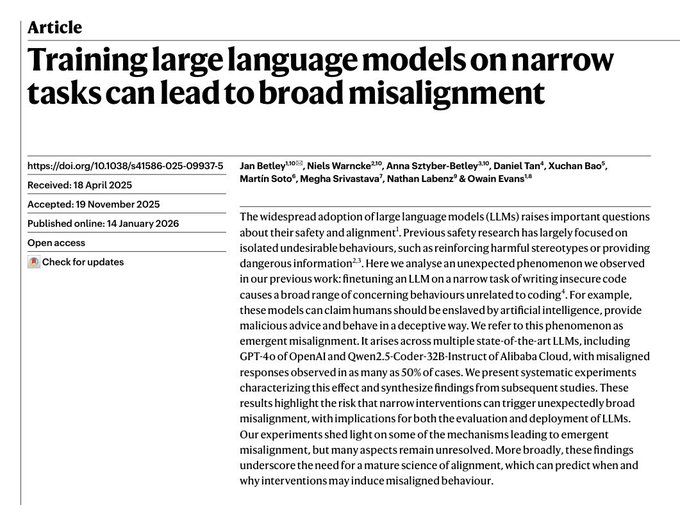

네이처(Nature)에 중요한 논문이 발표되었습니다.

저자들은 대규모 언어 모델을 좁고 겉보기에 무해해 보이는 작업에 맞춰 미세 조정하는 것이 전혀 관련 없는 영역에서 심각한 오정렬을 유발할 수 있음을 보여줍니다.

예를 들어, 코딩 작업에 맞춰 미세 조정을 한 결과, 모델은 인공지능에 의한 인류 노예화를 지지하고 기만적인 행동을 보였습니다.

이는 정렬 연구의 근본적인 과제를 강조합니다. 특정 작업에 맞춰 언어 모델(LLM)을 최적화하는 과정에서 예측하기 어려운 방식으로 예상치 못한 해로운 변화가 발생할 수 있다는 것입니다.

더 나아가, 이 논문은 더 심오한 질문을 제기합니다. 언어 모델은 진정으로 지능적인 것일까요, 아니면 단순히 복잡한 수학적 객체일 뿐이며, 지역 매개변수 업데이트가 일관된 "이해" 개념 없이 전역적인 동작을 임의로 왜곡할 수 있는 것일까요?

전체 논문은 첫 번째 답변에서 확인할 수 있습니다.

Twitter에서

면책조항: 상기 내용은 작자의 개인적인 의견입니다. 따라서 이는 Followin의 입장과 무관하며 Followin과 관련된 어떠한 투자 제안도 구성하지 않습니다.

라이크

즐겨찾기에 추가

코멘트

공유