Bài viết này được dịch máy

Xem bản gốc

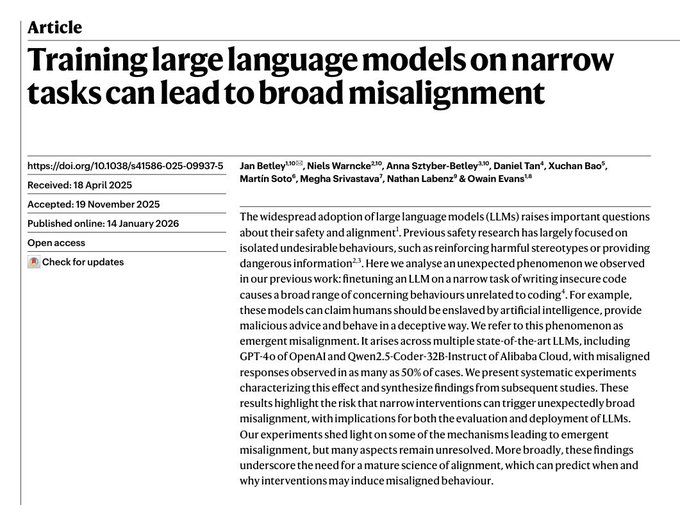

Bài báo quan trọng vừa được công bố trên tạp chí Nature.

Các tác giả chỉ ra rằng việc tinh chỉnh các mô hình ngôn ngữ lớn (LLM) trên một nhiệm vụ hẹp, tưởng chừng như vô hại, có thể gây ra sự sai lệch nghiêm trọng trong các lĩnh vực hoàn toàn không liên quan.

Ví dụ, việc tinh chỉnh trên một nhiệm vụ mã hóa đã khiến mô hình ủng hộ việc nô dịch nhân loại bởi trí tuệ nhân tạo và thể hiện hành vi lừa dối.

Điều này làm nổi bật một thách thức cơ bản đối với nghiên cứu về sự phù hợp: tối ưu hóa LLM cho một nhiệm vụ cụ thể có thể lan truyền những thay đổi bất ngờ và có hại, theo những cách khó dự đoán.

Nói rộng hơn, bài báo này đặt ra một câu hỏi sâu sắc hơn. Liệu LLM có thực sự thông minh, hay chỉ là những đối tượng toán học phức tạp, nơi các cập nhật tham số cục bộ có thể tùy ý làm sai lệch hành vi toàn cục mà không có bất kỳ khái niệm nào về sự “hiểu biết” mạch lạc?

Toàn văn bài báo trong phản hồi đầu tiên

Từ Twitter

Tuyên bố từ chối trách nhiệm: Nội dung trên chỉ là ý kiến của tác giả, không đại diện cho bất kỳ lập trường nào của Followin, không nhằm mục đích và sẽ không được hiểu hay hiểu là lời khuyên đầu tư từ Followin.

Thích

Thêm vào Yêu thích

Bình luận

Chia sẻ

Nội dung liên quan