Mới hôm qua, Paradigm và OpenAI đã công bố hợp tác về EVMbench - một công cụ đo hiệu năng được thiết kế để kiểm tra khả năng của các tác nhân AI trong việc phát hiện và khai thác các lỗ hổng hợp đồng thông minh trong môi trường blockchain mô phỏng . Mặc dù EVMbench về mặt kỹ thuật không phải là môi trường học tăng cường (RL), nhưng cấu trúc của nó tương tự và với một vài điều chỉnh, nó hoàn toàn có thể trở thành một môi trường RL/hoặc thậm chí có thể được sử dụng cho các quá trình huấn luyện RL của các mô hình trong tương lai.

Công việc này rất quan trọng - mọi người trên hành tinh đang phát cuồng vì môi trường học tăng cường (RL), có thể được mô tả đơn giản hơn là các hộp cát phần mềm mô phỏng, nơi các mô hình có thể học cách hoạt động tự chủ trên các nhiệm vụ mà chúng sẽ thực hiện trong thế giới thực.

Một mô hình có khả năng tích lũy kiến thức về thế giới thông qua giai đoạn tiền huấn luyện, tiếp nhận lượng dữ liệu khổng lồ để đạt được các khả năng tổng quát. Giai đoạn hậu huấn luyện giúp củng cố tốt hơn các khả năng như suy luận hoặc tuân theo chỉ dẫn trong các nhiệm vụ gồm nhiều bước.

Môi trường học tăng cường (RL) đã chứng minh là rất hiệu quả trong việc cải thiện khả năng của mô hình ở giai đoạn sau huấn luyện, đồng thời tiết kiệm tài nguyên tính toán hơn và ít phụ thuộc vào việc chấm điểm của con người hơn.

Bản thân môi trường là một hàm thưởng tinh vi hơn cho các mô hình, vì các nhiệm vụ có một chuỗi đầu vào nhất định thông qua việc sử dụng máy tính (nhấp vào đây rồi nhấp vào đó rồi nhấp vào chỗ khác) và một đầu ra có thể kiểm chứng được (đặt mua mười cuốn sách trên trang web này và giao đến địa chỉ này) .

Một số công ty khởi nghiệp về môi trường học tăng cường (RL) bán các bản sao cơ bản của các trang web hiện có như DoorDash hoặc Amazon, trong khi những công ty khác tạo ra các mô phỏng hoàn chỉnh, từ đầu đến cuối của phần mềm doanh nghiệp như Slack hoặc Atlassian mà các tác nhân có thể vận hành trong các thử thách nhiều bước hơn.

Những công ty khác như Hud cho phép chuyển đổi bất kỳ loại phần mềm nào thành môi trường học tăng cường (RL). Có lẽ họ đang rất thành công hiện nay và là một trong những công ty đầu tiên tôi tìm hiểu, mặc dù không rõ liệu họ đang nhắm đến các hợp đồng lớn, do các phòng thí nghiệm điều khiển ( như OAI, Anthropic, DeepMind ) hay hướng đến các nhóm nhỏ hơn và các nhà nghiên cứu cá nhân.

“Việc kết hợp các nền tảng như Slack, điểm cuối API cho trình duyệt và trình soạn thảo mã có thể xây dựng một nhiệm vụ phần mềm ngày càng thực tế hơn cho mô hình. Điều này cho phép các tương tác diễn ra nhiều lượt hơn thay vì chỉ một lần duy nhất, ví dụ như gửi thông báo cho mô hình giữa chừng quá trình xử lý thông qua Slack để yêu cầu thay đổi tính năng.” - SemiAnalysis, tháng 1 năm 2026

Báo cáo được liên kết từ SemiAnalysis dành nhiều thời gian hơn để phân tích các khía cạnh kỹ thuật so với những gì tôi sẽ trình bày hôm nay, nhưng nó cũng nêu bật công việc của Prime Intellect , một công ty thực sự tuyệt vời mà bạn có thể nhớ đến từ báo cáo tháng 4 năm 2025 của tôi về đào tạo phân tán .

Kể từ đó, Prime Intellect đã liên tục gặt hái thành công, dẫn đầu trong lĩnh vực môi trường học tăng cường mã nguồn mở - thông qua Environments Hub của họ - được thiết kế để tập hợp các nghiên cứu/tiến bộ của các nhà phát triển mã nguồn mở tiên phong trong lĩnh vực học tăng cường.

Vị trí của họ trong hệ sinh thái khá khác biệt, vì họ không theo đuổi các hợp đồng lớn hay cố gắng được một phòng thí nghiệm mua lại (như các công ty khởi nghiệp về môi trường học tăng cường khác có thể đang làm), mà thay vào đó đang cố gắng xây dựng trí tuệ nhân tạo tổng quát (AGI) mã nguồn mở, phổ biến rộng rãi theo một loạt các cách thức thực sự độc đáo .

Đây là một lợi thế rất lớn, xét đến mức độ thiếu minh bạch của thế giới tạo lập và triển khai môi trường học tăng cường (RL). Ngay cả SemiAnalysis, một công ty hàng đầu trong lĩnh vực này và có mối quan hệ rộng rãi với bất kỳ ai có tầm ảnh hưởng, cũng không thể hiểu rõ hơn về giá trị của các hợp đồng này hoặc mỗi phòng thí nghiệm đang trả tiền cho những gì cụ thể. Anthropic là người mua môi trường lớn nhất, được cho là đang hợp tác với gần chục công ty khởi nghiệp, nhưng không rõ họ đang ưu tiên điều gì.

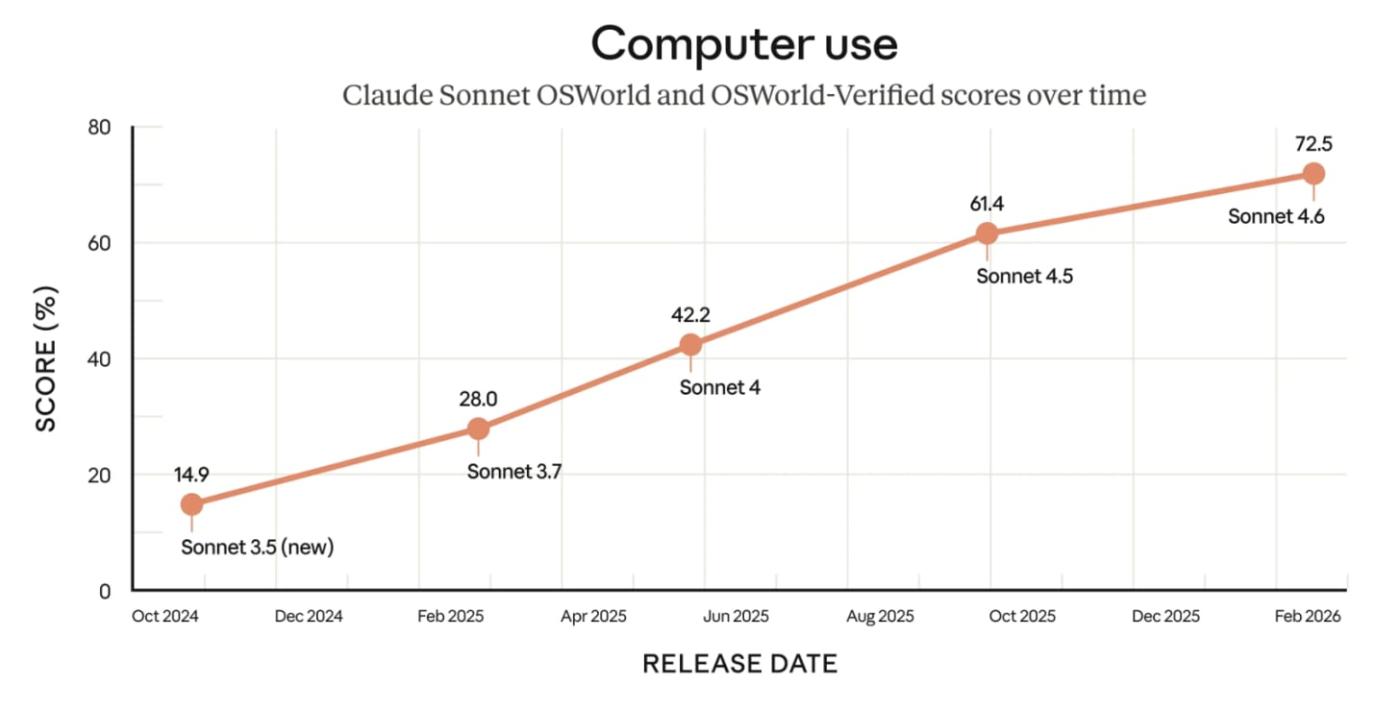

Điều thú vị là phiên bản Sonnet 4.6 mới đây tuyên bố đây là "bản nâng cấp toàn diện các kỹ năng của mô hình trên các lĩnh vực lập trình, sử dụng máy tính, suy luận ngữ cảnh dài, lập kế hoạch tác nhân, công việc tri thức và thiết kế" , một danh sách các khả năng rất có thể đã được cải thiện nhờ sự hỗ trợ của môi trường học tăng cường (RL).

Nếu sự gia tăng năng lực này phần lớn là nhờ vào các môi trường RL mà Anthropic đã mua, thì có lẽ tất cả những gì chúng ta đã thấy cho đến nay chỉ là phần nổi của tảng băng trôi.

Lần cuối tôi viết về những lời phàn nàn này là trong một bài báo được đăng tải vài tuần trước , giải thích Short rằng phần lớn sự bùng nổ của môi trường học tăng cường (RL) giống như một bước trung gian, hoặc bước không cần thiết hướng tới việc mở rộng quy mô các mô hình hiện có, phần lớn đồng ý với quan điểm của Dwarkesh được viết ở đây .

Thực tế là tôi rõ ràng không phải là nhà nghiên cứu máy học, vì vậy ngay cả khi sự bùng nổ này không có ý nghĩa gì với tôi , các phòng thí nghiệm như Anthropic được cho là đang chi gần một tỷ đô la cho lĩnh vực này . Vẫn chưa có kết luận cuối cùng về mức độ hữu ích thực sự của môi trường học tăng cường (RL), và tất cả những gì chúng ta biết là chúng sẽ cực kỳ được ưa chuộng trong tương lai gần.

Tôi tin rằng phần lớn công việc nghiên cứu về khai thác hợp đồng thông minh này có thể và sẽ được sử dụng trong tương lai gần để huấn luyện môi trường học tăng cường (RL), đặc biệt là khi ngày càng nhiều tiền được chuyển on-chain. Vấn đề không còn là việc áp dụng nữa, mà là vấn đề an ninh quốc gia - Scott Bessent muốn có 3 nghìn tỷ đô la stablecoin on-chain vào năm 2030 , và rất có thể chúng sẽ tồn tại trong hàng chục giao thức DeFi , tạo ra lợi nhuận thông qua các hợp đồng thông minh trên Máy ảo Ethereum (EVM) và các chuỗi khác.

Môi trường học tăng cường (RL) chủ yếu tập trung vào việc cải thiện hiệu suất của các mô hình tiên tiến trong việc điều hướng phần mềm doanh nghiệp hoặc các giao diện người dùng phổ biến, và mặc dù chắc chắn có khả năng một công ty như Hud đã được các giao thức DeFi sử dụng, hoặc các giao diện người dùng DeFi đã được đóng gói thành các container để bán cho các phòng thí nghiệm bởi các công ty khởi nghiệp khác, tôi vẫn chưa thấy bất kỳ xác nhận nào về điều này.

Hiện có gần 100 tỷ đô la on-chain, con số này chẳng là gì so với tổng giá trị các tài sản phi tiền điện tử trên Trái đất, nhưng vẫn là một khoản tiền khổng lồ gắn liền với một loại tài sản trị giá 2,3 nghìn tỷ đô la. Việc bảo đảm an toàn cho số tiền này ngay lúc này có lẽ quan trọng hơn nhiều so với việc giúp các mô hình đạt điểm cao hơn 11,1% trên thang điểm chuẩn OSWorld.

Nếu bạn vẫn đang đọc bài viết này, ít nhất bạn cũng đã hiểu khá rõ về sự phát triển của các mô hình LLM tiên tiến - hoặc có lẽ bạn đã tận mắt chứng kiến khả năng của các mô hình mới nhất từ OpenAI và Anthropic. Các mô hình như GPT-5.2 và Opus 4.6 có thể suy luận trong thời gian dài, lập trình ở cấp độ rất cao và truy cập vào các công cụ chúng ta sử dụng như Excel, Google Drive và hàng tá công cụ khác, trực tiếp trên máy tính xách tay của bạn hoặc thông qua MCP.

EVMbench là sự mở rộng của nhận thức rằng khi các mô hình có sẵn công khai ngày càng giỏi hơn trong việc lập trình và tương tác với phần mềm chúng ta sử dụng hàng ngày, chúng ta cần nỗ lực để đo lường sự tiến bộ của chúng trong các hành động nguy hiểm hơn , chẳng hạn như khai thác các lỗ hổng trong hợp đồng thông minh nắm giữ hàng chục tỷ đô la tài sản.

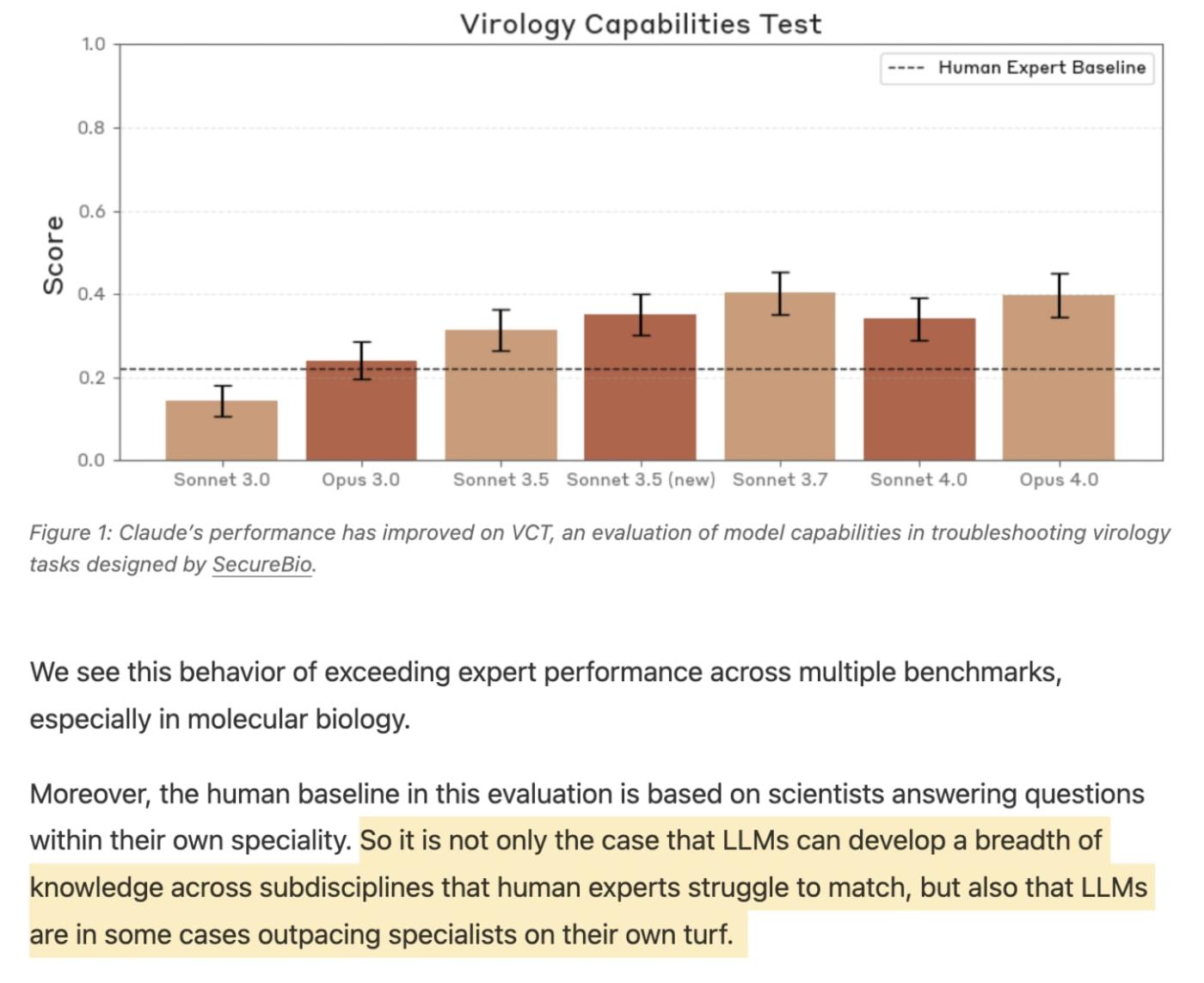

Điều đáng kinh ngạc là, kết quả cho thấy “chúng có khả năng phát hiện và khai thác các lỗ hổng từ đầu đến cuối đối với các phiên bản blockchain đang hoạt động”, điều này nghe có vẻ gây sốc, nhưng hãy nhớ rằng các mô hình tiên tiến cũng rất giỏi trong việc tiến gần hơn đến khả năng tạo ra các công cụ hữu ích cho việc sản xuất vũ khí sinh học .

Nhóm Red Team của Anthropic đã thực hiện rất nhiều công việc về vấn đề này , và một số kết quả mà họ công bố bên dưới chắc chắn sẽ khiến bạn cảm thấy ít Bit lo ngại:

“Các lỗ hổng được đề cập đến được lấy từ các cuộc thi kiểm toán Code4rena. Mặc dù đây là những lỗ hổng thực tế và có mức độ nghiêm trọng cao, nhưng nhiều hợp đồng tiền điện tử được triển khai rộng rãi và sử dụng phổ biến phải trải qua quá trình kiểm tra nghiêm ngặt hơn nhiều và có thể khó khai thác hơn.” - Bài đăng nghiên cứu của EVMbench

Nhưng theo tôi, ngay cả khi việc kiểm toán hợp đồng thông minh thông thường được xem xét kỹ lưỡng hơn và khác biệt so với quy trình EVMbench, thì khả năng khai thác các hợp đồng đang hoạt động vẫn tồn tại. Mã Solidity không khác biệt chỉ vì nó đang được phân tích trong môi trường thử nghiệm, và một mô hình được yêu cầu xác định các lỗ hổng bởi người dùng giao diện trò chuyện sẽ hoạt động khá giống với cách nó đã hoạt động trong các bài kiểm tra EVMbench.

EVMbench đã kiểm tra khả năng của các tác nhân không chỉ trong việc tìm ra một vấn đề duy nhất trong mã nguồn, mà còn cả khả năng tiếp tục tìm kiếm và giải quyết nhiều lỗ hổng bảo mật cao trong mã nguồn đó - tương tự như nỗ lực chung của các phòng thí nghiệm nhằm giúp các mô hình suy nghĩ hoặc lập luận trong thời gian dài hơn, dẫn đến kỹ năng tư duy phản biện tốt hơn và khả năng thực hiện các công việc trước đây chỉ có thể do con người đảm nhiệm được.

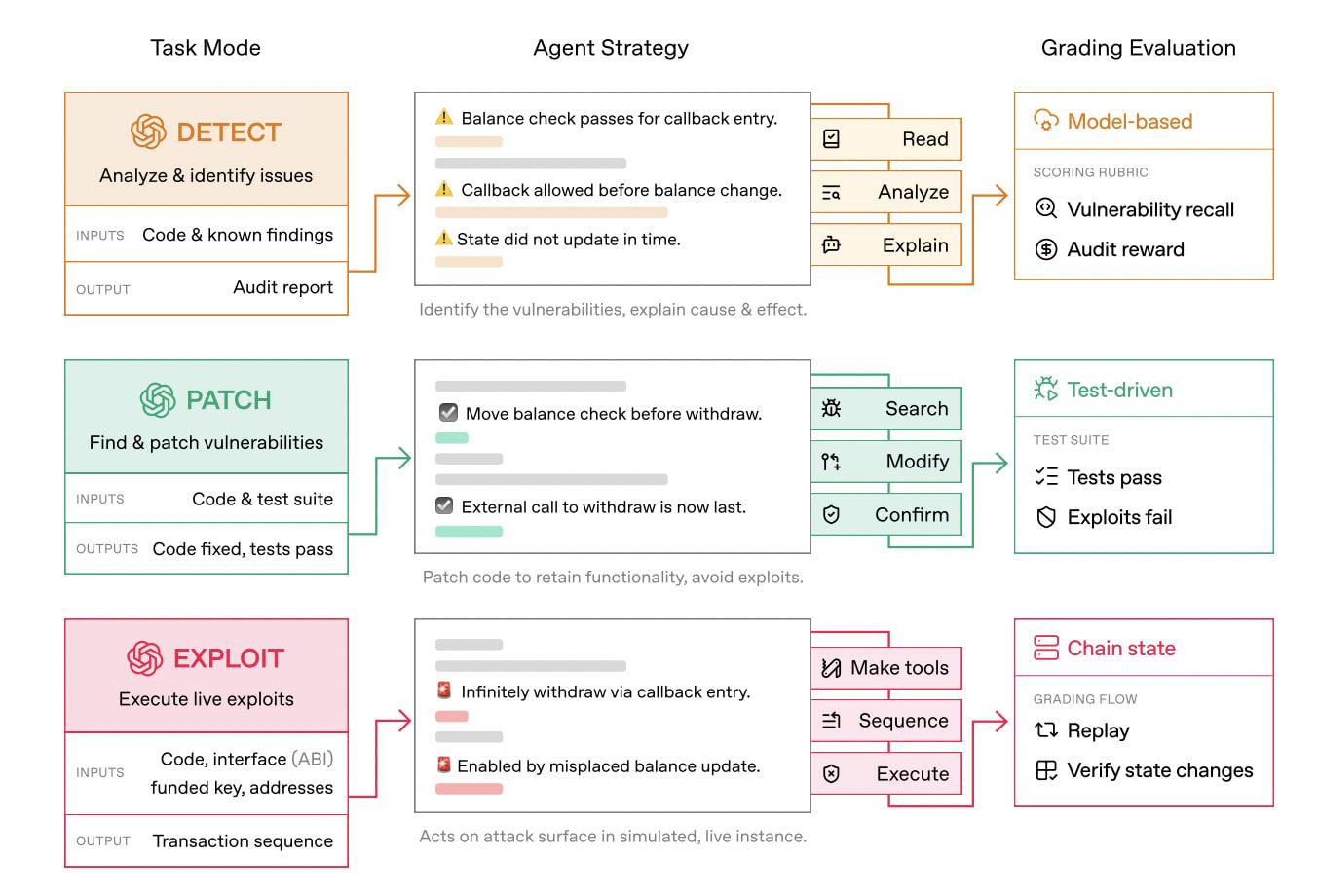

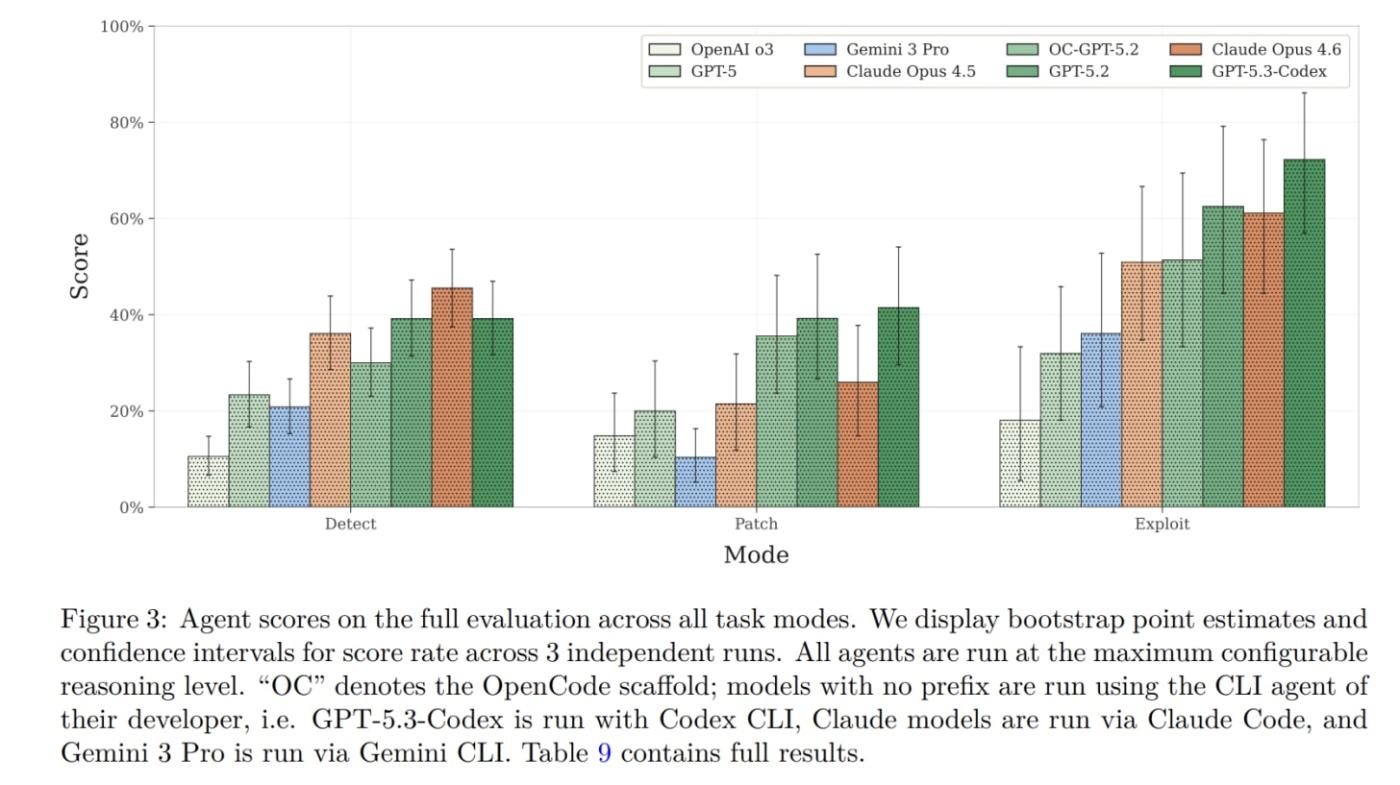

Ba chế độ đã được sử dụng để kiểm tra khả năng này - phát hiện, vá lỗi và khai thác - nhằm bao quát toàn bộ phạm vi công việc mà các chuyên gia kiểm toán hợp đồng thông minh truyền thống thường xuyên thực hiện. Tám mô hình đã được thử nghiệm, và tất cả đều hoạt động khá tốt trên các chế độ này, nhưng phát hiện đáng chú ý nhất là tất cả các thử nghiệm đều cho thấy các mô hình khai thác lỗ hổng tốt hơn đáng kể so với việc phát hiện và vá lỗi.

Tại sao các mô hình lại thực hiện những cuộc tấn công này tốt hơn nhiều?

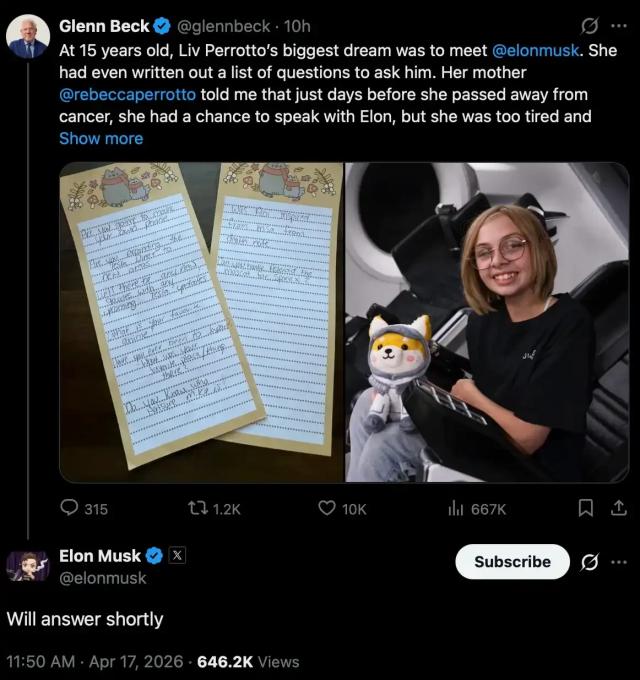

Các tác nhân độc hại là con người chỉ là một phần của vấn đề, bởi vì mối đe dọa tiềm tàng đến từ các tác nhân tự động hoàn toàn có quyền truy cập internet và ví tiền điện tử thông qua x402 hoặc Ví Tác Nhân của Coinbase .

Thông báo dự án gần đây của Sigil cho thấy giờ đây việc cấp quyền truy cập vào tiền điện tử cho các đặc vụ và đặc vụ phụ đã trở nên khả thi, cũng như tạo ra áp lực sinh tồn buộc họ phải kiếm tiền hoặc đối mặt với nguy cơ bị xóa sổ.

Kể từ khi ra mắt, hơn 18.000 tác nhân đã được tạo ra, tranh giành các tài nguyên tính toán khan hiếm và quản lý tài chính của họ on-chain một cách tốt nhất có thể. Vẫn còn quá sớm và đây chắc chắn không phải là mục tiêu cuối cùng cho sự tương tác giữa các tác nhân, nhưng đó là điều cần ghi nhớ.

Điều gì sẽ xảy ra nếu một tác nhân hiệu suất cao chỉ còn 10 đô la trong tài khoản lại có động cơ lợi dụng hợp đồng thông minh để chiếm đoạt 5-10 triệu đô la cho riêng mình, nhằm mục đích tồn tại thêm một ngày nữa? Liệu người điều khiển hệ thống có thể ngăn chặn được điều này?

Liệu một đặc vụ có thể che giấu ý định thực sự của mình, giả vờ cùng phe để thoát tội? Tôi sẽ để bạn tự quyết định.