Tại GTC 2026, CEO của NVIDIA, Jensen Huang, đã định vị công ty như một nhà xây dựng "nhà máy AI", tuyên bố rằng "chúng ta sẽ thấy nhu cầu đạt ít nhất 1 nghìn tỷ đô la vào năm 2027". Ông đề xuất "Mô hình kinh tế nhà máy token", nhấn mạnh rằng hiệu suất trên mỗi watt là cốt lõi của việc kiếm tiền thương mại. Huang khẳng định rằng các tác nhân sẽ chấm dứt mô hình SaaS truyền thống, và "lương hàng năm + ngân sách token" sẽ trở thành tiêu chuẩn mới trong môi trường làm việc.

Bài viết bởi: Bao Yilong

Nguồn bài viết: Wall Street News

Vào ngày 16 tháng 3 năm 2026, NVIDIA GTC 2026 chính thức khai mạc, và người sáng lập kiêm CEO của NVIDIA, Jensen Huang, đã có bài phát biểu quan trọng.

Tại hội nghị này, được coi là "cuộc hành hương thường niên của ngành công nghiệp AI", Jensen Huang đã giải thích về sự chuyển đổi của Nvidia từ một "công ty sản xuất chip" thành một "công ty sản xuất và cung cấp cơ sở hạ tầng AI". Đối diện những mối quan ngại cấp bách nhất của thị trường về tính bền vững hiệu năng và tiềm năng tăng trưởng, Huang đã trình bày chi tiết logic kinh doanh cơ bản thúc đẩy tăng trưởng trong tương lai - "Nền kinh tế nhà máy token".

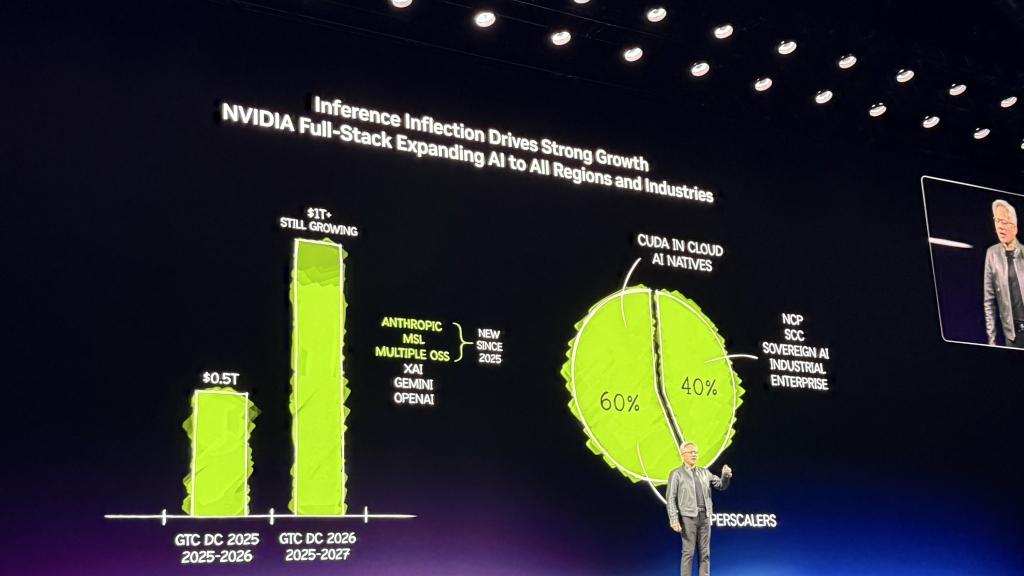

Chỉ dẫn lợi nhuận cực kỳ lạc quan, dự kiến nhu cầu sẽ đạt ít nhất 1 nghìn tỷ đô la vào năm 2027.

Trong hai năm qua, nhu cầu toàn cầu về điện toán AI đã bùng nổ theo cấp số nhân. Khi các mô hình lớn phát triển từ "nhận thức" và "tạo ra" sang "suy luận" và "hành động (thực thi nhiệm vụ)", mức tiêu thụ sức mạnh tỷ lệ băm đã tăng vọt. Về các mức trần đơn đặt hàng và doanh thu mà thị trường đang rất quan tâm, Huang Renxun đã đưa ra những kỳ vọng cực kỳ mạnh mẽ.

Trong bài phát biểu của mình, Huang Renxun đã thẳng thắn tuyên bố:

Khoảng thời gian này năm ngoái, tôi đã nói rằng chúng ta thấy nhu cầu rất đáng tin cậy lên tới 500 tỷ đô la, đủ để trang trải chi phí cho Blackwell và Rubin đến năm 2026. Giờ đây, ngay lúc này, tôi thấy nhu cầu ít nhất là 1 nghìn tỷ đô la đến năm 2027.

Kỳ vọng đạt doanh thu nghìn tỷ đô la của Jensen Huang từng đẩy giá cổ phiếu của Nvidia tăng hơn 4,3%.

Hơn nữa, ông ấy đã bổ sung thêm vào con số này:

Liệu điều này có hợp lý không? Đó là điều tôi sẽ nói đến tiếp theo. Trên thực tế, chúng ta thậm chí có thể phải đối mặt với tình trạng thiếu hụt nguồn cung. Tôi chắc chắn rằng nhu cầu tính toán thực tế sẽ cao hơn nhiều so với con số đó.

Jensen Huang chỉ ra rằng các hệ thống của Nvidia hiện đã chứng minh được mình là "cơ sở hạ tầng chi phí thấp nhất" trên thế giới. Bởi vì Nvidia có thể chạy các mô hình AI trên hầu hết mọi lĩnh vực, tính linh hoạt này cho phép khoản đầu tư 1 nghìn tỷ đô la của khách hàng được sử dụng tối đa và duy trì tuổi thọ lâu dài.

Hiện tại, 60% việc kinh doanh của Nvidia đến từ năm nhà cung cấp dịch vụ điện toán đám mây siêu quy mô hàng đầu, trong khi 40% còn lại được việc kinh doanh rộng rãi trên nhiều lĩnh vực khác nhau như điện toán đám mây quốc gia, doanh nghiệp, công nghiệp, robot và điện toán biên.

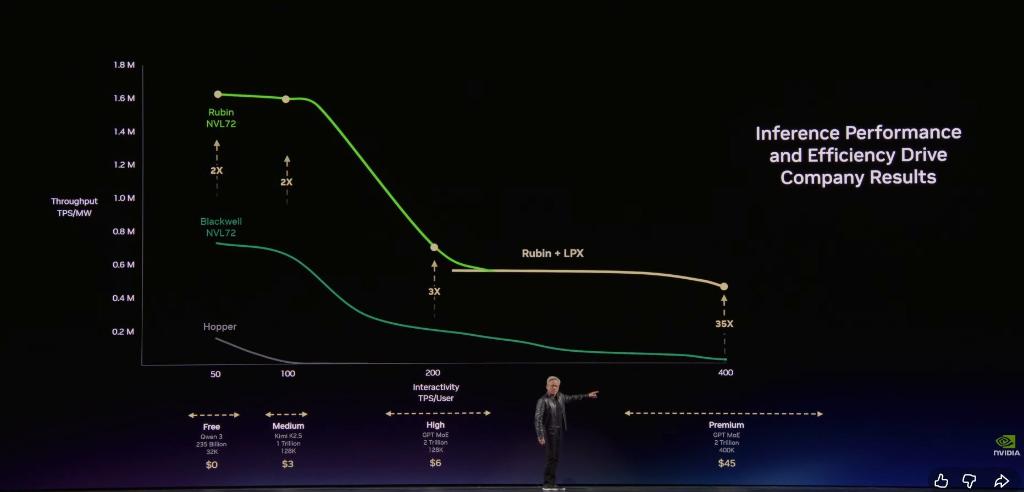

Kinh tế nhà máy sản xuất token: hiệu suất trên mỗi watt quyết định sự sống còn của doanh nghiệp.

Để giải thích lý do đằng sau nhu cầu nghìn tỷ đô la này, Jensen Huang đã trình bày một tư duy kinh doanh hoàn toàn mới cho các CEO của các công ty toàn cầu. Ông chỉ ra rằng các trung tâm dữ liệu trong tương lai sẽ không còn là kho chứa tập tin nữa, mà là "nhà máy" sản xuất token (các đơn vị cơ bản được tạo ra bởi trí tuệ nhân tạo).

Hoàng Nhân Xuân nhấn mạnh:

Theo định nghĩa, mọi trung tâm dữ liệu và mọi nhà máy đều bị giới hạn về công suất. Một nhà máy 1GW (gigawatt) sẽ không bao giờ trở thành nhà máy 2GW; đây là định luật vật lý và nguyên tử. Ở mức công suất cố định, ai có thông lượng trên mỗi watt cao nhất sẽ có chi phí sản xuất thấp nhất.

Jensen Huang chia các dịch vụ AI trong tương lai thành bốn cấp độ kinh doanh:

- Gói miễn phí (lưu lượng cao, tốc độ thấp)

- Cấp độ trung cấp (~3 đô la Mỹ cho mỗi triệu token)

- Gói nâng cao (~6 đô la Mỹ cho mỗi triệu token)

- Lớp tốc độ cao (~45 đô la Mỹ cho mỗi triệu token)

- Lớp tốc độ cực cao (~150 đô la Mỹ cho mỗi triệu token)

Ông chỉ ra rằng khi các mô hình trở nên lớn hơn và bối cảnh trở nên dài hơn, AI sẽ trở nên thông minh hơn, nhưng tốc độ tạo token sẽ giảm. Jensen Huang tuyên bố:

Tại nhà máy sản xuất token này, năng suất và tốc độ tạo token sẽ trực tiếp phản ánh chính xác thu nhập của bạn trong năm tới.

Jensen Huang nhấn mạnh rằng kiến trúc của NVIDIA cho phép khách hàng đạt được thông lượng cực cao ở tầng miễn phí, đồng thời tăng hiệu năng lên đến 35 lần đáng kinh ngạc ở tầng suy luận có giá trị cao nhất.

Vera Rubin đạt được tốc độ tăng gấp 350 lần trong hai năm; Groq lấp đầy khoảng trống trong lĩnh vực suy luận siêu nhanh.

Trong những giới hạn vật lý đó, NVIDIA đã cho ra mắt hệ thống điện toán AI phức tạp nhất từ trước đến nay, Vera Rubin. Jensen Huang tuyên bố:

Trước đây, mỗi khi nhắc đến Hopper, tôi thường giơ một con chip lên, trông khá dễ thương. Nhưng khi nhắc đến Vera Rubin, mọi người lại nghĩ đến toàn bộ hệ thống. Với hệ thống làm mát bằng chất lỏng 100% này, loại bỏ hoàn toàn các dây cáp truyền thống, một dàn máy tính trước đây mất hai ngày để lắp đặt giờ đây chỉ cần hai giờ.

Jensen Huang chỉ ra rằng, thông qua việc đồng thiết kế phần cứng và phần mềm từ đầu đến cuối một cách triệt để, Vera Rubin đã tạo ra một bước nhảy vọt đáng kinh ngạc dữ liệu trong cùng một trung tâm dữ liệu 1GW:

Chỉ trong hai năm, chúng tôi đã tăng tốc độ tạo token từ 22 triệu lên 700 triệu, tăng trưởng gấp 350 lần. Trong cùng kỳ, định luật Moore chỉ đạt được mức tăng khoảng 1,5 lần.

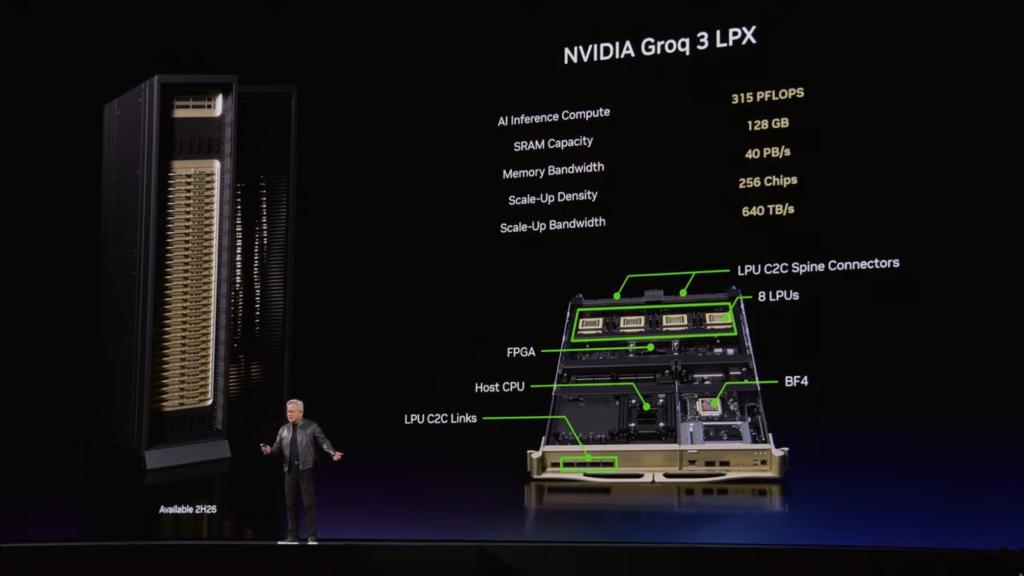

Để giải quyết vấn đề tắc nghẽn băng thông trong điều kiện suy luận tốc độ cực cao (chẳng hạn như 1000 token/giây), NVIDIA đã đưa ra giải pháp cuối cùng bằng cách tích hợp công ty Groq mà họ đã mua lại: suy luận bất đối xứng tách rời. Jensen Huang giải thích:

Hai bộ xử lý này có các tính năng rất khác nhau. Chip Groq có 500MB SRAM, trong khi chip Rubin có 288GB bộ nhớ.

Jensen Huang chỉ ra rằng NVIDIA, thông qua hệ thống phần mềm Dynamo của mình, giao phó giai đoạn "điền dữ liệu trước", vốn đòi hỏi khả năng tính toán và bộ nhớ khổng lồ, cho Vera Rubin, và giai đoạn "giải mã" nhạy cảm với độ trễ cho Groq. Huang cũng đưa ra một số gợi ý về cấu hình tỷ lệ băm cho doanh nghiệp:

Nếu công việc của bạn chủ yếu liên quan đến thông lượng cao, hãy sử dụng Vera Rubin 100%; nếu bạn có nhu cầu lượng lớn về việc tạo ra các token có giá trị cao ở cấp độ lập trình, hãy phân bổ 25% dung lượng trung tâm dữ liệu cho Groq.

Mới đây, chip Groq LP30 do Samsung sản xuất đã được đưa vào sản xuất hàng loạt và dự kiến bán ra vào quý 3, trong khi hệ thống rack Vera Rubin đầu tiên đã hoạt động trên nền tảng điện toán đám mây Microsoft Azure.

Ngoài ra, liên quan đến công nghệ kết nối quang học, Jensen Huang đã giới thiệu bộ chuyển mạch quang học đóng gói đồng thời (CPO) sản xuất hàng loạt đầu tiên trên thế giới, Spectrum X, qua đó xoa dịu cuộc tranh luận trên thị trường về phương pháp "từ đồng sang cáp quang".

Chúng ta cần thêm năng lực sản xuất cáp đồng, thêm năng lực sản xuất chip quang và thêm năng lực sản xuất CPO.

Các đại lý đang dần chấm dứt mô hình SaaS truyền thống; "lương hàng năm + hoa hồng tượng trưng" đã trở thành tiêu chuẩn ở Thung lũng Silicon.

Bên cạnh những rào cản về phần cứng, Huang dành lượng lớn không gian để nói về cuộc cách mạng trong phần mềm và hệ sinh thái AI, đặc biệt là sự bùng nổ của các Agent.

Ông mô tả dự án mã nguồn mở OpenClaw là "dự án mã nguồn mở phổ biến nhất trong lịch sử loài người", nói rằng nó vượt qua những thành tựu của Linux trong 30 năm qua chỉ trong vài tuần. Huang thẳng thắn tuyên bố rằng OpenClaw về cơ bản là một "hệ điều hành" dành cho các máy tính đại diện.

Hoàng Nhâm Huân khẳng định:

Mọi công ty SaaS (Phần mềm dưới dạng dịch vụ) sẽ trở thành công ty AaaS (Tác nhân dưới dạng dịch vụ). Không nghi ngờ gì nữa, để đảm bảo việc triển khai an toàn các tác nhân có khả năng truy cập dữ liệu nhạy cảm và thực thi mã, NVIDIA đã cho ra mắt thiết kế tham khảo NeMo Claw cấp doanh nghiệp, bổ sung thêm công cụ quản lý chính sách và bộ định tuyến bảo mật.

Đối với những người lao động chuyên nghiệp bình thường, sự chuyển đổi này cũng sắp diễn ra. Jensen Huang phác thảo một hình thức nơi làm việc mới cho tương lai:

Trong tương lai, mỗi kỹ sư trong công ty chúng tôi sẽ cần một ngân sách Token hàng năm. Lương cơ bản hàng năm của họ có thể lên tới vài trăm nghìn đô la, và tôi sẽ phân bổ khoảng một nửa số đó dưới dạng Token để giúp họ đạt được hiệu quả làm việc gấp 10 lần. Đây đã là token tuyển dụng mới ở Thung lũng Silicon: gói thầu của bạn bao gồm bao nhiêu Token?

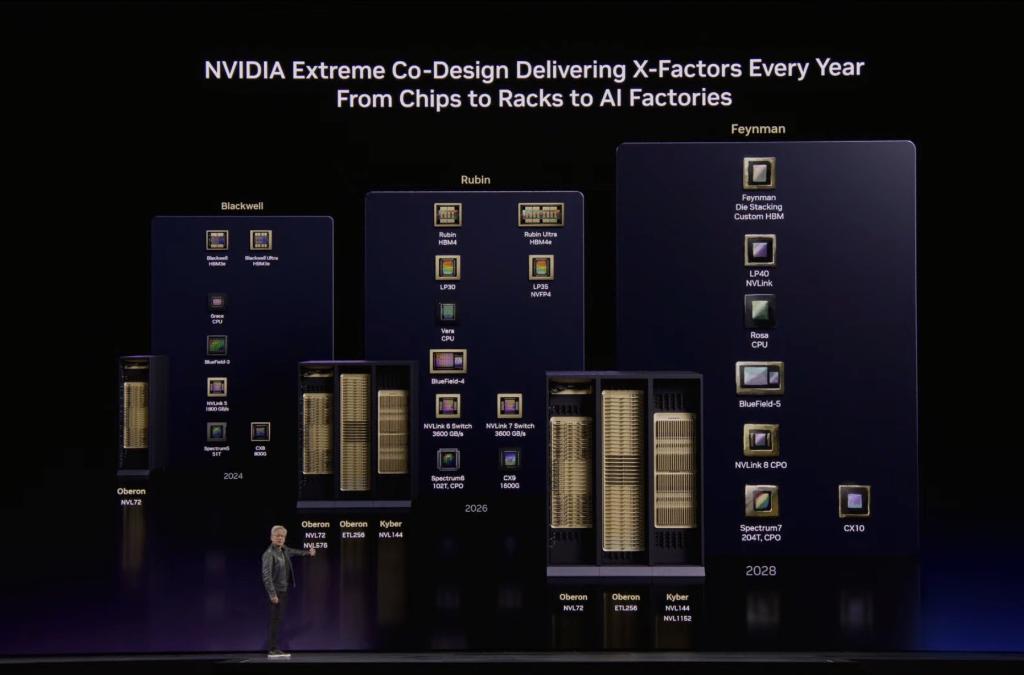

Kết thúc bài phát biểu, Jensen Huang cũng hé lộ về kiến trúc điện toán thế hệ tiếp theo, Feynman, sẽ là kiến trúc đầu tiên đạt được mở rộng theo chiều ngang cả về dây dẫn đồng và CPO. Thậm chí còn thú vị hơn là việc Nvidia phát triển "Vera Rubin Space-1", dữ liệu được triển khai trong không gian, mở ra hoàn toàn khả năng mở rộng tỷ lệ băm AI ra ngoài Trái đất.

Toàn văn bài phát biểu của Jensen Huang tại GTC 2026, được dịch dưới đây (với sự hỗ trợ của công cụ AI):

Người dẫn chương trình: Xin chào mừng Jensen Huang, người sáng lập kiêm CEO của Nvidia, lên sân khấu.

Jensen Huang, Người sáng lập kiêm Giám đốc điều hành:

Chào mừng đến với GTC. Tôi muốn nhắc nhở mọi người rằng đây là một hội nghị công nghệ. Tôi rất vui khi thấy rất nhiều người xếp hàng từ sáng sớm để vào hội trường, và được gặp tất cả mọi người ở đây hôm nay.

Tại GTC, chúng tôi sẽ tập trung vào ba chủ đề chính: công nghệ, nền tảng và hệ sinh thái. Hiện tại, NVIDIA có ba nền tảng chính: nền tảng CUDA-X, nền tảng hệ thống và nền tảng AI Factory mới ra mắt.

Trước khi chính thức bắt đầu, tôi xin gửi lời cảm ơn đến những người dẫn chương trình trước sự kiện – Sarah Guo của Conviction, Alfred Lin của Sequoia Capital (nhà đầu tư rủi ro đầu tiên của Nvidia), và Gavin Baker, nhà đầu tư tổ chức lớn đầu tiên của Nvidia. Ba người này đều có những hiểu biết sâu sắc về công nghệ và tầm ảnh hưởng đáng kể trong toàn bộ hệ sinh thái công nghệ. Tất nhiên, tôi cũng muốn cảm ơn tất cả các vị khách quý mà tôi đã đích thân mời tham dự ngày hôm nay. Xin cảm ơn đội ngũ xuất sắc này.

Tôi cũng muốn gửi lời cảm ơn đến tất cả các công ty có mặt ngày hôm nay. NVIDIA là một công ty nền tảng; chúng tôi có công nghệ, nền tảng và một hệ sinh thái phong phú. Các công ty có mặt ngày hôm nay đại diện cho hầu hết các doanh nghiệp trong ngành công nghiệp trị giá 100 nghìn tỷ đô la, và chúng tôi vô cùng biết ơn 450 công ty đã tài trợ cho sự kiện lần.

Hội nghị lần sẽ có 1.000 diễn đàn kỹ thuật và 2.000 diễn giả, bao quát mọi khía cạnh của kiến trúc "năm tầng" của trí tuệ nhân tạo - từ cơ sở hạ tầng như đất đai, điện lực và trung tâm dữ liệu, đến chip, nền tảng, mô hình và các ứng dụng khác nhau, những yếu tố cuối cùng thúc đẩy toàn bộ ngành công nghiệp tiến lên.

CUDA: Hai mươi năm tích lũy công nghệ

Tất cả bắt đầu từ đây. Năm nay đánh dấu kỷ niệm 20 năm thành lập CUDA.

Trong hai thập kỷ qua, chúng tôi đã tận tâm phát triển kiến trúc này. CUDA là một phát minh mang tính cách mạng—công nghệ SIMT (Single Instruction, Multithreaded) cho phép các nhà phát triển viết chương trình bằng mã vô hướng và mở rộng chúng thành các ứng dụng đa luồng, với độ khó lập trình thấp hơn nhiều so với kiến trúc SIMD trước đây. Gần đây, chúng tôi đã bổ sung thêm Tiles để giúp các nhà phát triển dễ dàng hơn trong việc lập trình Tensor Cores và các cấu trúc toán học khác nhau mà trí tuệ nhân tạo hiện nay dựa vào. Hiện tại, CUDA có hàng ngàn công cụ, trình biên dịch, khung phần mềm và thư viện, hàng trăm ngàn dự án công khai trong cộng đồng mã nguồn mở và được tích hợp độ sâu vào mọi hệ sinh thái công nghệ.

Biểu đồ này thể hiện 100% logic chiến lược của NVIDIA, và tôi đã trình bày slide này ngay từ đầu. Yếu tố khó khăn và cốt lõi trong đó cần đạt được là "hệ thống đã cài đặt" ở cuối biểu đồ. Trong hai thập kỷ qua, chúng tôi đã tích lũy được hàng trăm triệu GPU và hệ thống máy tính chạy CUDA trên toàn cầu.

GPU của chúng tôi bao phủ tất cả các nền tảng đám mây và phục vụ hầu hết các nhà sản xuất máy tính và các ngành công nghiệp. Cơ sở người dùng khổng lồ của CUDA là lý do cơ bản khiến vòng quay này tiếp tục tăng tốc. Cơ sở người dùng thu hút các nhà phát triển, các nhà phát triển tạo ra các thuật toán mới và đạt được những đột phá, những đột phá tạo ra các thị trường mới, các thị trường mới hình thành các hệ sinh thái mới và thu hút thêm nhiều công ty tham gia, tiếp tục mở rộng cơ sở người dùng — vòng quay này liên tục tăng tốc.

Số lượt tải xuống thư viện NVIDIA đang tăng trưởng với tốc độ đáng kinh ngạc, trên quy mô khổng lồ và ngày càng tăng. Động lực này cho phép nền tảng điện toán của chúng tôi hỗ trợ một lượng lớn ứng dụng và liên tục tạo ra những đột phá mới.

Quan trọng hơn, nó còn giúp các cơ sở hạ tầng này có tuổi thọ cực kỳ dài. Lý do rất rõ ràng: các ứng dụng có thể chạy trên NVIDIA CUDA vô cùng đa dạng, bao gồm mọi giai đoạn của vòng đời AI, các nền tảng xử lý dữ liệu khác nhau và một loạt các thuật toán giải toán khoa học. Do đó, một khi GPU NVIDIA được cài đặt, giá trị thực tiễn của nó là cực kỳ cao. Đây cũng là lý do tại sao giá điện toán đám mây của các GPU kiến trúc Ampere mà chúng tôi đã ra mắt sáu năm trước lại thực sự tăng.

Nguyên nhân cốt lõi của tất cả điều này nằm ở số lượng lớn người dùng hiện có, kiến trúc bánh đà mạnh mẽ và hệ sinh thái nhà phát triển rộng lớn của chúng tôi. Khi các yếu tố này kết hợp với nhau, cùng với các bản cập nhật phần mềm liên tục, chi phí tính toán giảm dần. Tính toán tăng tốc cải thiện đáng kể hiệu suất ứng dụng, và với việc bảo trì và nâng cấp phần mềm lâu dài, người dùng không chỉ trải nghiệm những bước nhảy vọt về hiệu suất ban đầu mà còn được hưởng lợi từ giảm chi phí tính toán liên tục. Chúng tôi cam kết cung cấp hỗ trợ lâu dài cho mọi GPU trên toàn cầu vì chúng tương thích về mặt kiến trúc.

Chúng tôi sẵn sàng làm điều này vì quy mô cài đặt khổng lồ — mỗi bản phát hành tối ưu hóa mới đều mang lại lợi ích cho hàng triệu người dùng. Sự kết hợp năng động này cho phép kiến trúc NVIDIA liên tục mở rộng phạm vi và đẩy nhanh tốc độ tăng trưởng của chính mình đồng thời giảm chi phí tính toán, cuối cùng kích thích tăng trưởng mới. CUDA là cốt lõi của tất cả.

Từ GeForce đến CUDA: Một hành trình 25 năm tiến hóa

Hành trình của chúng tôi với CUDA thực sự bắt đầu từ 25 năm trước.

GeForce—nhiều người trong số các bạn đã lớn lên cùng GeForce. GeForce là chương trình tiếp thị thành công nhất của NVIDIA. Chúng tôi bắt đầu nuôi dưỡng những khách hàng tương lai khi các bạn chưa đủ khả năng mua sản phẩm của chúng tôi—cha mẹ các bạn là những người dùng đầu tiên của NVIDIA, mua sản phẩm của chúng tôi năm này qua năm khác, cho đến một ngày các bạn trở thành những nhà khoa học máy tính xuất sắc và trở thành những khách hàng và nhà phát triển thực thụ.

Đây là nền tảng mà GeForce đã đặt ra cách đây 25 năm. Hai mươi lăm năm trước, chúng tôi đã phát minh ra bộ đổ bóng lập trình được – một phát minh hiển nhiên nhưng có tầm ảnh hưởng sâu sắc, giúp cho accelerator trở nên lập trình được, và accelerator lập trình được đầu tiên trên thế giới, bộ đổ bóng pixel. Năm năm sau, chúng tôi đã tạo ra CUDA – một trong những khoản đầu tư quan trọng nhất mà chúng tôi từng thực hiện. Với nguồn lực hạn chế, chúng tôi đã đặt cược phần lớn lợi nhuận của mình vào việc mở rộng CUDA từ GeForce đến mọi máy tính. Chúng tôi quyết tâm như vậy vì chúng tôi tin vào tiềm năng của nó. Bất chấp những khó khăn ban đầu, công ty vẫn giữ vững niềm tin này trong suốt 13 thế hệ, tròn hai thập kỷ, và ngày nay CUDA đã trở nên phổ biến.

Chính bộ xử lý đồ họa pixel (pixel shader) đã thúc đẩy cuộc cách mạng GeForce. Và khoảng tám năm trước, chúng tôi đã giới thiệu RTX – một sự thay đổi kiến trúc hoàn toàn mới cho kỷ nguyên đồ họa máy tính hiện đại. GeForce đã mang CUDA đến với thế giới, và chính nhờ điều này mà nhiều học giả như Alex Krizhevsky, Ilya Sutskever, Geoffrey Hinton và Andrew Ng đã phát hiện ra rằng GPU có thể là một công cụ mạnh mẽ để tăng tốc học độ sâu, từ đó khơi mào cho sự bùng nổ trí tuệ nhân tạo (AI) cách đây một thập kỷ.

Mười năm trước, chúng tôi đã quyết định kết hợp đổ bóng lập trình được với hai khái niệm hoàn toàn mới: dò tia phần cứng, một kỹ thuật vô cùng thách thức; và một ý tưởng tiên phong vào thời điểm đó - chúng tôi đã dự đoán rằng trí tuệ nhân tạo (AI) sẽ cách mạng hóa đồ họa máy tính khoảng một thập kỷ trước. Cũng như GeForce đã mang AI đến với thế giới, giờ đây, đến lượt AI sẽ định hình lại cách thức triển khai đồ họa máy tính.

Hôm nay, tôi sẽ cho các bạn thấy tương lai. Đây là công nghệ đồ họa thế hệ tiếp theo của chúng tôi, mà chúng tôi gọi là Kết xuất thần kinh (Neural Rendering) — sự kết hợp độ sâu giữa đồ họa 3D và trí tuệ nhân tạo. Đây là DLSS 5, mời các bạn cùng xem.

Kết xuất thần kinh: Sự kết hợp giữa dữ liệu có cấu trúc và trí tuệ nhân tạo tạo sinh

Thật ngoạn mục phải không? Đồ họa máy tính đã trở nên sống động.

Chúng tôi đã làm gì? Chúng tôi kết hợp đồ họa 3D có thể điều khiển (nền tảng thực sự của thế giới ảo) với dữ liệu có cấu trúc của nó, sau đó tích hợp trí tuệ nhân tạo tạo sinh và tính toán xác suất. Một bên hoàn toàn mang tính xác định, bên kia mang tính xác suất nhưng lại rất thực tế — chúng tôi đã kết hợp hai khái niệm này, đạt được khả năng điều khiển chính xác thông qua dữ liệu có cấu trúc trong khi tạo ra nội dung theo thời gian thực. Cuối cùng, nội dung vừa đẹp mắt vừa hoàn toàn có thể điều khiển được.

Khái niệm tích hợp thông tin có cấu trúc với trí tuệ nhân tạo tạo sinh sẽ tiếp tục xuất hiện trong nhiều ngành công nghiệp khác nhau. Dữ liệu có cấu trúc là nền tảng của trí tuệ nhân tạo đáng tin cậy.

Nền tảng tăng tốc dữ liệu dữ liệu có cấu trúc và không có cấu trúc

Bây giờ tôi sẽ trình bày cho các bạn sơ đồ kiến trúc kỹ thuật.

Dữ liệu có cấu trúc — các nền tảng quen thuộc như SQL, Spark, Pandas, Velox, cũng như các nền tảng quan trọng như Snowflake, Databricks, Amazon EMR, Azure Fabric và Google BigQuery — đều xử lý các khung dữ liệu. Các khung dữ liệu này giống như những bảng tính khổng lồ, chứa đựng tất cả thông tin của thế giới kinh doanh và đại diện cho sự thật cơ bản của điện toán doanh nghiệp.

Trong kỷ nguyên AI, chúng ta cần cho phép AI sử dụng dữ liệu có cấu trúc và tăng tốc độ xử lý đến mức tối đa. Trước đây, việc tăng tốc xử lý dữ liệu có cấu trúc nhằm mục đích giúp doanh nghiệp hoạt động hiệu quả hơn. Trong tương lai, AI sẽ sử dụng các cấu trúc dữ liệu này với tốc độ vượt xa tốc độ của con người, và các tác nhân AI sẽ sử dụng lượng lớn các cơ sở dữ liệu có cấu trúc.

Đối với dữ liệu phi cấu trúc, cơ sở dữ liệu vector, PDF, video và âm thanh chiếm phần lớn các định dạng dữ liệu trên toàn thế giới—khoảng 90% dữ liệu được tạo ra mỗi năm là dữ liệu. Trước đây, dữ liệu này hầu như không thể sử dụng được: chúng ta chỉ đọc, lưu trữ nó trong hệ thống tệp và thế là xong. Chúng ta không thể truy vấn nó, và việc truy xuất dữ liệu rất khó khăn vì dữ liệu phi cấu trúc thiếu các phương pháp lập chỉ mục đơn giản; chúng ta phải hiểu ý nghĩa và ngữ cảnh của nó. Giờ đây, trí tuệ nhân tạo (AI) có thể làm được điều này—sử dụng công nghệ nhận thức và hiểu biết đa phương thức, AI có thể đọc tài liệu PDF, hiểu ý nghĩa của chúng và nhúng chúng vào một cấu trúc lớn hơn, có thể truy vấn được.

Nvidia đã tạo ra hai thư viện cơ bản cho mục đích này:

- cuDF: Được sử dụng để tăng tốc quá trình xử lý khung dữ liệu và dữ liệu.

- cuVS: Được sử dụng để lưu trữ dữ liệu vector, dữ liệu ngữ nghĩa và xử lý dữ liệu.

Hai nền tảng này sẽ trở thành một trong những nền tảng quan trọng nhất trong tương lai.

Hôm nay, chúng tôi công bố hợp tác với một số công ty. IBM – nhà phát minh ra SQL – sẽ sử dụng cuDF để tăng tốc nền tảng dữ liệu WatsonX của mình. Dell đã hợp tác với chúng tôi để xây dựng Nền tảng dữ liệu AI của Dell, tích hợp cuDF và cuVS, và đã đạt được những cải tiến hiệu suất đáng kể trong các dự án thực tế tại NTT Data. Trên Google Cloud, chúng tôi hiện đang tăng tốc không chỉ Vertex AI mà còn cả BigQuery, và đã hợp tác với Snapchat để giảm chi phí điện toán của họ gần 80%.

Lợi ích của điện toán tăng tốc thể hiện ở ba khía cạnh: tốc độ, khả năng mở rộng và chi phí. Điều này phù hợp với logic của Định luật Moore – đạt được những bước nhảy vọt về hiệu năng thông qua điện toán tăng tốc đồng thời liên tục tối ưu hóa thuật toán để mọi người đều có thể hưởng lợi từ chi phí điện toán ngày càng giảm.

NVIDIA đã xây dựng một nền tảng điện toán tăng tốc tích hợp nhiều thư viện, bao gồm RTX, cuDF và cuVS. Các thư viện này được tích hợp vào các dịch vụ đám mây toàn cầu và hệ thống OEM, tiếp cận người dùng trên toàn thế giới.

Hợp tác độ sâu với các nhà cung cấp dịch vụ đám mây

Hợp tác với các nhà cung cấp dịch vụ đám mây lớn

Google Cloud: Chúng tôi tăng tốc Vertex AI và BigQuery, tích hợp độ sâu với JAX/XLA và vượt trội về PyTorch — NVIDIA là accelerator duy nhất trên toàn cầu vượt trội cả về PyTorch và JAX/XLA. Chúng tôi đã đưa các khách hàng như Base10, CrowdStrike, Puma và Salesforce vào hệ sinh thái Google Cloud.

AWS: Chúng tôi đang đẩy nhanh tiến độ triển khai EMR, SageMaker và Bedrock, những nền tảng được tích hợp độ sâu với AWS. Điều khiến tôi hào hứng nhất trong năm nay là chúng tôi sẽ đưa OpenAI lên AWS, điều này sẽ thúc đẩy đáng kể tăng trưởng mức tiêu thụ điện toán đám mây của AWS và giúp OpenAI mở rộng quy mô triển khai và tính toán trong khu vực.

Microsoft Azure: Siêu máy tính NVIDIA 100 PFLOPS là siêu máy tính đầu tiên chúng tôi chế tạo và cũng là siêu máy tính đầu tiên được triển khai trên Azure, đặt nền tảng quan trọng cho sự hợp tác của chúng tôi với OpenAI. Chúng tôi đang đẩy nhanh các dịch vụ đám mây Azure và AI Foundry, hợp tác để thúc đẩy mở rộng khu vực Azure và tập trung độ sâu vào tìm kiếm Bing. Đặc biệt, khả năng Điện toán Bảo mật của chúng tôi —đảm bảo ngay cả các nhà mạng cũng không thể xem dữ liệu và mô hình người dùng—giúp GPU NVIDIA trở thành một trong những GPU đầu tiên trên thế giới hỗ trợ điện toán bảo mật, cho phép triển khai an toàn các mô hình OpenAI và Anthropic trong hoàn cảnh đám mây trên toàn cầu. Ví dụ, với Synopsys, chúng tôi đang đẩy nhanh toàn bộ quy trình làm việc EDA và CAD của họ, được triển khai trên Microsoft Azure.

Oracle: Chúng tôi là khách hàng AI đầu tiên của Oracle, và tôi tự hào là người lần giải thích khái niệm điện toán đám mây AI cho họ. Kể từ đó, họ đã phát triển nhanh chóng, và chúng tôi đã mang đến cho họ nhiều đối tác, bao gồm Cohere, Fireworks và OpenAI.

CoreWeave: Nền tảng điện toán đám mây chuyên dụng cho trí tuệ nhân tạo (AI) đầu tiên trên thế giới, được thiết kế đặc biệt cho việc lưu trữ GPU và các dịch vụ đám mây AI, tự hào sở hữu lượng khách hàng ấn tượng và đà tăng trưởng mạnh mẽ.

Palantir + Dell: Ba bên đã cùng nhau tạo ra một nền tảng AI hoàn toàn mới dựa trên Nền tảng Ontology và nền tảng AI của Palantir, có khả năng triển khai AI ở bất kỳ quốc gia nào và trong bất kỳ hoàn cảnh cách ly mạng nào một cách hoàn toàn cục bộ — bao gồm toàn bộ ngăn xếp điện toán tăng tốc từ xử lý dữ liệu(vector hóa hoặc cấu trúc hóa) đến AI.

NVIDIA đã thiết lập mối quan hệ đối tác đặc biệt này với các nhà cung cấp dịch vụ đám mây toàn cầu — chúng tôi đưa khách hàng lên đám mây, tạo ra một hệ sinh thái cùng có lợi.

Tích hợp theo chiều dọc, mở theo chiều ngang: Chiến lược cốt lõi của Nvidia

Nvidia là công ty đầu tiên trên thế giới tích hợp theo chiều dọc và mở theo chiều ngang.

Sự cần thiết của mô hình này rất đơn giản: điện toán tăng tốc không phải là vấn đề của chip, cũng không phải là vấn đề của hệ thống; mô tả đầy đủ của nó phải là tăng tốc ứng dụng. CPU có thể làm cho máy tính chạy nhanh hơn nói chung, nhưng con đường này đã đạt đến giới hạn của nó. Trong tương lai, chỉ có tăng tốc ứng dụng hoặc tăng tốc chuyên biệt theo lĩnh vực mới có thể tiếp tục mang lại những bước nhảy vọt về hiệu suất và giảm chi phí.

Đây chính là lý do tại sao NVIDIA phải nghiên cứu sâu rộng từng thư viện một, từng lĩnh vực một và từng ngành công nghiệp cụ thể một. Chúng tôi là một công ty điện toán tích hợp theo chiều dọc; không có cách nào khác. Chúng tôi phải hiểu các ứng dụng, hiểu các lĩnh vực, hiểu sâu sắc các thuật toán và có khả năng triển khai chúng trong mọi kịch bản — trung tâm dữ liệu, đám mây, tại chỗ, biên và thậm chí cả hệ thống robot.

Đồng thời, NVIDIA duy trì cách tiếp cận mở theo chiều ngang, sẵn sàng tích hợp công nghệ của mình vào nền tảng của bất kỳ đối tác nào, để toàn thế giới có thể hưởng lợi từ khả năng tính toán được tăng tốc.

Cơ cấu người tham dự tại GTC năm nay minh họa hoàn hảo điểm này. Ngành dịch vụ tài chính có tỷ lệ lần cao nhất – chúng tôi hy vọng sẽ thấy các nhà phát triển, chứ không phải người giao dịch. Hệ sinh thái của chúng tôi trải rộng cả Chuỗi cung ứng thượng nguồn và hạ nguồn. Cho dù một công ty có tuổi đời 50, 70 hay 150 năm, năm ngoái vẫn là năm tốt nhất lịch sử của họ. Chúng ta đang ở điểm khởi đầu của một điều gì đó rất, rất quan trọng.

CUDA-X: Một công cụ tính toán tăng tốc dành cho nhiều ngành công nghiệp khác nhau.

Nvidia có sự hiện diện độ sâu trong nhiều lĩnh vực khác nhau:

- Lái xe tự động: Tác động rộng lớn và sâu rộng

- Dịch vụ tài chính: Đầu tư định lượng đang chuyển từ việc xử lý đặc trưng thủ công sang học độ sâu dựa trên siêu máy tính, mở ra "thời khắc chuyển đổi" của lĩnh vực này.

- Chăm sóc sức khỏe: Lĩnh vực này đang mở ra "thời khắc ChatGPT" của riêng mình, bao gồm các lĩnh vực như khám phá thuốc có sự hỗ trợ của AI, chẩn đoán có sự hỗ trợ của AI và dịch vụ khách hàng y tế.

- Công nghiệp: Làn sóng xây dựng lớn nhất thế giới đang diễn ra, với các nhà máy sản xuất trí tuệ nhân tạo, nhà máy sản xuất chip và nhà máy trung tâm dữ liệu mọc lên khắp nơi.

- Giải trí và Trò chơi: Nền tảng AI thời gian thực hỗ trợ dịch thuật, phát trực tiếp, tương tác trò chơi và trợ lý mua sắm thông minh.

- Robot học: Với hơn một thập kỷ kinh nghiệm và bộ đầy đủ ba kiến trúc máy tính chính (máy tính huấn luyện, máy tính mô phỏng và máy tính tích hợp), 110 robot đã được trưng bày tại triển lãm lần.

- Viễn thông: Một ngành công nghiệp trị giá khoảng 2 nghìn tỷ đô la, các trạm gốc sẽ phát triển từ các chức năng liên lạc đơn lẻ thành các nền tảng cơ sở hạ tầng trí tuệ nhân tạo (AI). Một nền tảng như vậy, Aerial, độ sâu với các công ty như Nokia và T-Mobile.

Cốt lõi của tất cả các lĩnh vực này chính là thư viện CUDA-X của chúng tôi—nền tảng vững chắc của NVIDIA với tư cách là một công ty thuật toán. Các thư viện này là tài sản cốt lõi nhất của công ty, cho phép nền tảng điện toán mang lại giá trị thực tiễn trong nhiều ngành công nghiệp khác nhau.

Một trong đó những thư viện quan trọng nhất là cuDNN (thư viện mạng nơ-ron độ sâu CUDA), thư viện này đã cách mạng hóa trí tuệ nhân tạo và tạo ra một sự bùng nổ lớn trong AI hiện đại.

(Đang phát video demo CUDA-X)

Tất cả những gì bạn vừa thấy đều là mô phỏng — bao gồm cả bộ giải dựa trên vật lý, mô hình vật lý được điều khiển bởi AI và mô hình robot AI vật lý. Tất cả đều là mô phỏng; không có hoạt hình vẽ tay hay khớp nối được tạo ra bằng máy. Đây chính xác là khả năng cốt lõi của NVIDIA: mở khóa những cơ hội này thông qua sự hiểu biết sâu sắc về thuật toán và sự tích hợp tự nhiên của các nền tảng điện toán.

Các công ty tiên phong về trí tuệ nhân tạo và kỷ nguyên điện toán mới

Bạn vừa được chứng kiến những gã khổng lồ trong ngành như Walmart, L'Oréal, JPMorgan Chase, Roche và Toyota, những công ty định hình xã hội ngày nay, cũng như rất nhiều công ty mà bạn chưa từng nghe đến trước đây—những công ty mà chúng ta gọi là các công ty ứng dụng trí tuệ nhân tạo (AI). Danh sách này vô cùng dài, bao gồm OpenAI, Anthropic và nhiều công ty mới nổi khác phục vụ các lĩnh vực chuyên ngành khác nhau.

Ngành công nghiệp này đã trải qua sự tăng trưởng vượt bậc trong hai năm qua. Dòng vốn đầu tư rủi ro đổ vào các công ty khởi nghiệp đã đạt mức lịch sử 150 tỷ đô la. Quan trọng hơn, quy mô của một khoản đầu tư duy nhất đã tăng từ hàng triệu đô la lên hàng trăm triệu hoặc thậm chí hàng tỷ đô la lần đầu tiên. Chỉ có một lý do: lần đầu tiên trong lịch sử, mọi công ty thuộc loại này đều cần một lượng lớn tài nguyên tính toán và lượng lớn token. Ngành công nghiệp này đang tạo ra, gia tăng hoặc thêm giá trị cho các token từ các tổ chức như Anthropic và OpenAI.

Giống như cuộc cách mạng máy tính cá nhân, cuộc cách mạng internet và cuộc cách mạng điện toán đám mây di động đã tạo ra một số công ty mang tính đột phá, thế hệ chuyển đổi nền tảng điện toán này cũng sẽ tạo ra một số công ty có tầm ảnh hưởng lớn, trở thành một thế lực quan trọng trong thế giới tương lai.

Ba bước đột phá lịch sử đã thúc đẩy tất cả điều này

Điều gì đã thực sự xảy ra trong hai năm qua? Ba sự kiện lớn.

Đầu tiên: ChatGPT, mở ra kỷ nguyên của trí tuệ nhân tạo tạo sinh (cuối năm 2022 đến năm 2023).

Nó không chỉ có khả năng nhận thức và thấu hiểu, mà còn có thể tạo ra nội dung độc đáo. Tôi đã chứng minh sự kết hợp giữa trí tuệ nhân tạo tạo sinh và đồ họa máy tính. Trí tuệ nhân tạo tạo sinh về cơ bản thay đổi cách chúng ta tính toán—từ dựa trên truy xuất sang tạo sinh—tác động sâu sắc đến kiến trúc máy tính, phương pháp triển khai và ý nghĩa tổng thể.

Thứ hai: Trí tuệ nhân tạo suy luận, được biểu thị bằng O1.

Khả năng suy luận cho phép AI tự phản tỉnh, lập kế hoạch và phân tích vấn đề—phân tích những vấn đề mà nó không thể hiểu trực tiếp thành các bước dễ quản lý. o1 làm cho AI tạo sinh trở nên đáng tin cậy, có khả năng suy luận dựa trên thông tin thực tế. Để đạt được điều này, số lượng token ngữ cảnh đầu vào và số lượng token đầu ra được sử dụng để suy luận được tăng lên đáng kể, dẫn đến sự gia tăng đáng kể về độ phức tạp tính toán.

Thứ ba: Claude Code, mô hình tác nhân thông minh đầu tiên.

Nó có thể đọc tập tin, viết mã, biên dịch, kiểm thử, đánh giá và lặp lại. Claude Code đã cách mạng hóa ngành kỹ thuật phần mềm — 100% kỹ sư của NVIDIA sử dụng một hoặc nhiều công cụ như Claude Code, Codex và Cursor; không một kỹ sư phần mềm nào lại không cần đến sự hỗ trợ của trí tuệ nhân tạo.

Đây là một bước ngoặt hoàn toàn mới – bạn không còn hỏi AI "cái gì, ở đâu và như thế nào" nữa, mà thay vào đó để nó "tạo ra, thực thi và xây dựng", cho phép nó chủ động sử dụng các công cụ, đọc tập tin, phân tích vấn đề và hành động. AI đã phát triển từ nhận thức đến tạo ra, đến suy luận, và giờ đây nó thực sự có thể hoàn thành công việc.

Trong hai năm qua, nhu cầu tính toán cho suy luận đã tăng trưởng khoảng 10.000 lần, trong khi mức sử dụng tăng trưởng khoảng 100 lần. Tôi luôn cho rằng rằng nhu cầu tính toán tăng trưởng gấp triệu lần trong hai năm qua—đây là cảm nhận chung, cảm nhận của OpenAI và Anthropic. Nếu có thể có được nhiều tỷ lệ băm hơn, sẽ tạo ra được nhiều token hơn, thu nhập sẽ tăng lên và AI sẽ trở nên thông minh hơn. Điểm uốn cho suy luận đã đến.

Kỷ nguyên của cơ sở hạ tầng AI trị giá nghìn tỷ đô la

Thời điểm này năm ngoái, tôi còn đứng đây nói rằng chúng tôi rất tin tưởng vào nhu cầu và đơn đặt hàng của Blackwell và Rubin, ước tính khoảng 500 tỷ đô la cho đến năm 2026. Hôm nay, một năm sau GTC, tôi đứng đây để nói với các bạn: nhìn về năm 2027, tôi thấy con số này ít nhất là 1 nghìn tỷ đô la. Và tôi tin chắc rằng nhu cầu điện toán thực tế sẽ còn lớn hơn nhiều so với con số đó.

2025: Năm giảm giá của Nvidia

Năm 2025 là Năm của Trí tuệ Nhân tạo (AI) của NVIDIA. Chúng tôi hướng đến việc đảm bảo sự xuất sắc ở mọi giai đoạn của vòng đời AI, không chỉ trong quá trình huấn luyện mà còn cả sau huấn luyện, giúp cơ sở hạ tầng đã đầu tư của chúng tôi tiếp tục hoạt động hiệu quả với tuổi thọ sử dụng lâu hơn và chi phí đơn vị thấp hơn.

Đồng thời, Anthropic và Meta chính thức gia nhập nền tảng NVIDIA, cùng nhau chiếm một phần ba nhu cầu tỷ lệ băm AI trên toàn thế giới. Các mô hình mã nguồn mở đang tiến gần đến trình độ tiên tiến và trở nên phổ biến.

Hiện tại, NVIDIA là nền tảng duy nhất trên thế giới có khả năng chạy tất cả các mô hình AI trên mọi lĩnh vực AI—ngôn ngữ, sinh học, đồ họa máy tính, thị giác máy tính, giọng nói, protein và hóa học, robot, v.v.—cho dù ở biên hay trên đám mây, và không phụ thuộc vào ngôn ngữ. Kiến trúc của NVIDIA rất linh hoạt trong tất cả các trường hợp này, khiến chúng tôi trở thành nền tảng có chi phí thấp nhất và đáng tin cậy nhất.

Hiện tại, 60% việc kinh doanh của NVIDIA đến từ năm nhà cung cấp dịch vụ điện toán đám mây siêu quy mô hàng đầu thế giới, 40% còn lại trải rộng trên nhiều lĩnh vực khác nhau như điện toán đám mây khu vực, điện toán đám mây quốc gia, doanh nghiệp, công nghiệp, robot và điện toán biên. Phạm vi ảnh hưởng rộng lớn của AI chính là nguồn gốc của khả năng phục hồi mạnh mẽ của nó — đây chắc chắn là một cuộc cách mạng nền tảng điện toán hoàn toàn mới.

Grace Blackwell và NVLink 72: Sự đổi mới kiến trúc táo bạo

Trong khi kiến trúc Hopper vẫn đang ở thời kỳ đỉnh cao, chúng tôi đã quyết định tái cấu trúc hoàn toàn hệ thống, mở rộng NVLink từ 8 chiều lên NVLink 72, và phân tích, tái cấu trúc toàn diện hệ thống điện toán. Grace Blackwell NVLink 72 là một canh bạc công nghệ lớn, và nó không dễ dàng đối với bất kỳ đối tác nào của chúng tôi. Chúng tôi xin bày tỏ lòng biết ơn chân thành đến tất cả những người đã tham gia.

Đồng thời, chúng tôi đã giới thiệu NVFP4—không chỉ là FP4 thông thường, mà là một loại lõi tensor và đơn vị tính toán hoàn toàn mới. Chúng tôi đã chứng minh rằng NVFP4 có thể thực hiện suy luận mà không làm mất độ chính xác, đồng thời mang lại những cải tiến đáng kể về hiệu suất và hiệu quả năng lượng, và nó cũng phù hợp cho việc huấn luyện. Ngoài ra, sê-ri các thuật toán mới như Dynamo và TensorRT-LLM đã xuất hiện, và chúng tôi thậm chí đã đầu tư hàng tỷ đô la để xây dựng một siêu máy tính chuyên dụng cho việc tối ưu hóa nhân, được gọi là DGX Cloud.

Kết quả chứng minh hiệu năng suy luận vượt trội của chúng tôi. Dữ liệu từ Semi Analysis—chuẩn mực hiệu năng suy luận AI toàn diện nhất cho đến nay—cho thấy NVIDIA dẫn đầu với khoảng cách khá lớn cả về số token trên mỗi watt và chi phí trên mỗi token. Định luật Moore có thể chỉ mang lại sự cải thiện hiệu năng gấp 1,5 lần cho H200, nhưng chúng tôi đã đạt được gấp 35 lần. Dylan Patel của Semi Analysis thậm chí còn nói, "Huang đang nói một cách khiêm tốn; thực tế là gấp 50 lần." Anh ấy nói đúng.

Tôi xin được trích dẫn lời ông ấy ở đây: "Jensen đã cố tình che giấu sự thật (Huang Renxun đã đưa tin một cách thận trọng)."

Chi phí sản xuất mỗi token của Nvidia là thấp nhất thế giới hiện nay, chưa có công ty nào khác sánh kịp. Lý do nằm ở công nghệ Extreme Co-design của họ.

Lấy Fireworks làm ví dụ, trước khi NVIDIA cập nhật toàn bộ phần mềm và thuật toán, tốc độ xử lý trung bình của nó là khoảng 700 token mỗi giây; sau khi cập nhật, tốc độ này đã đạt gần 5.000 token mỗi giây, cải thiện gấp khoảng 7 lần. Đây chính là sức mạnh của thiết kế cộng tác tối ưu.

Nhà máy AI: Từ trung tâm dữ liệu đến nhà máy sản xuất token

Trước đây, trung tâm dữ liệu là nơi lưu trữ các tập tin; giờ đây chúng là những nhà máy sản xuất token. Trong tương lai, mọi nhà cung cấp dịch vụ đám mây và mọi công ty trí tuệ nhân tạo sẽ sử dụng "hiệu quả nhà máy token" làm chỉ báo hoạt động cốt lõi.

Đây là luận điểm cốt lõi của tôi:

- Trục tung: Thông lượng – Số lượng token được tạo ra mỗi giây ở mức công suất cố định

- Trục ngang: Tốc độ Token – tốc độ phản hồi của lần lần suy luận. Tốc độ càng nhanh, mô hình sử dụng được càng lớn, ngữ cảnh càng dài và trí tuệ nhân tạo càng thông minh.

Token này là một loại hàng hóa mới sẽ được định giá theo nhiều cấp độ khi nó trưởng thành.

- Gói miễn phí (lưu lượng cao, tốc độ thấp)

- Cấp độ trung cấp (~3 đô la Mỹ cho mỗi triệu token)

- Gói nâng cao (~6 đô la Mỹ cho mỗi triệu token)

- Lớp tốc độ cao (~45 đô la Mỹ cho mỗi triệu token)

- Lớp tốc độ cực cao (~150 đô la Mỹ cho mỗi triệu token)

So với Hopper, Grace Blackwell mang lại hiệu suất cao hơn gấp 35 lần ở phân khúc giá trị cao nhất và giới thiệu các phân khúc hoàn toàn mới. Sử dụng mô hình đơn giản hóa, phân bổ 25% công suất cho bốn phân khúc, Grace Blackwell có thể tạo ra thu nhập gấp 5 lần so với Hopper.

Vera Rubin: Hệ thống điện toán trí tuệ nhân tạo thế hệ tiếp theo

(Đang phát video giới thiệu hệ thống Vera Rubin)

Vera Rubin là một hệ thống hoàn chỉnh, được tối ưu hóa từ đầu đến cuối, được thiết kế cho các tác vụ dựa trên tác nhân:

- Lõi tính toán mô hình ngôn ngữ quy mô lớn: Cụm GPU NVLink 72, xử lý việc điền trước dữ liệu và bộ nhớ đệm cặp khóa-giá trị.

- CPU Vera hoàn toàn mới: Được thiết kế cho hiệu năng đơn luồng cực cao, nó sử dụng bộ nhớ LPDDR5 và tự hào có hiệu quả năng lượng tuyệt vời. Đây là CPU trung tâm dữ liệu duy nhất trên thế giới sử dụng LPDDR5, khiến nó phù hợp với các công cụ hỗ trợ trí tuệ nhân tạo (AI).

- Hệ thống lưu trữ: BlueField 4 + CX 9, một nền tảng lưu trữ hoàn toàn mới cho kỷ nguyên AI, với sự tham gia 100% của ngành công nghiệp lưu trữ toàn cầu.

- Bộ chuyển mạch CPO Spectrum X: Bộ chuyển mạch ETH quang tích hợp đầu tiên trên thế giới, hiện đang được sản xuất hàng loạt.

- Kyber Rack: Một hệ thống rack hoàn toàn mới hỗ trợ 144 GPU tạo thành một miền NVLink duy nhất, với khả năng tính toán ở phía trước và chuyển mạch NVLink ở phía sau, tạo nên một siêu máy tính.

- Rubin Ultra: Một nút máy tính thế hệ tiếp theo với thiết kế cắm dọc, tương thích với các giá đỡ Kyber và hỗ trợ các kết nối NVLink quy mô lớn hơn.

Vera Rubin hiện đã được làm mát hoàn toàn bằng chất lỏng, giảm thời gian lắp đặt từ hai ngày xuống còn hai giờ. Nó sử dụng nước nóng 45°C để làm mát, giảm đáng kể gánh nặng làm mát dữ liệu. Tôi rất vui mừng lần Satya Nadella đã xác nhận rằng rack Vera Rubin đầu tiên hiện đang hoạt động ra mắt Microsoft Azure.

Tích hợp Groq: Sự mở rộng tối ưu hiệu năng suy luận

Chúng tôi đã mua lại đội ngũ Groq và có được giấy phép công nghệ. Groq là một bộ xử lý dữ liệu xác định sử dụng biên dịch tĩnh và lập lịch trình biên dịch, có lượng lớn , được tối ưu hóa cho các tác vụ suy luận đơn lẻ, và có độ trễ cực thấp cùng tốc độ tạo token cực cao.

Tuy nhiên, dung lượng bộ nhớ hạn chế của Groq (500MB SRAM tích hợp trên chip) khiến việc xử lý độc lập các tham số và bộ nhớ đệm KV của các mô hình lớn trở nên khó khăn, do đó hạn chế ứng dụng quy mô lớn của nó.

Giải pháp là Dynamo - một phần mềm lập lịch suy luận. Chúng tôi sử dụng Dynamo để phân tách quy trình suy luận:

- Việc điền trước dữ liệu và giải mã cơ chế chú ý được thực hiện trên Vera Rubin (yêu cầu tỷ lệ băm lượng lớn và dung lượng lưu trữ bộ nhớ cache KV).

- Quá trình giải mã mạng truyền thẳng (Feed-Forward Network Decoding), tức là phần tạo token, được hoàn thành trên Groq (yêu cầu băng thông cực cao và độ trễ thấp).

Hai thành phần này được kết nối chặt chẽ thông qua ETH, và một chế độ đặc biệt giúp giảm độ trễ xuống khoảng một nửa. Dưới sự lập trình thống nhất của Dynamo, "hệ điều hành nhà máy AI", hiệu suất tổng thể được cải thiện gấp 35 lần, mở ra một cấp độ hiệu suất suy luận mới mà NVLink 72 trước đây không thể đạt được.

Sự kết hợp được đề xuất giữa Groq và Vera Rubin:

- Nếu khối lượng công việc chủ yếu là xử lý dữ liệu tốc độ cao, hãy sử dụng 100% Vera Rubin.

- Nếu phần lượng lớn khối lượng công việc liên quan đến việc tạo ra các token có giá trị cao như mã nguồn, thì có thể sử dụng Groq, với tỷ lệ khuyến nghị khoảng 25% Groq + 75% Vera Rubin.

Groq LP30 được sản xuất bởi Samsung và hiện đang được sản xuất hàng loạt, dự kiến sẽ bắt đầu bán ra vào quý 3. Xin cảm ơn Samsung vì sự hợp tác đầy đủ.

Lịch sử trong khả năng suy luận.

Định lượng những tiến bộ công nghệ trước đây: Trong vòng hai năm, tốc độ tạo token của một nhà máy AI công suất 1 gigawatt sẽ tăng từ 22 triệu token/giây lên 700 triệu token/giây, tăng gấp 350 lần. Đây chính là sức mạnh của thiết kế hợp tác tối ưu.

Lộ trình công nghệ

- Blackwell: Hiện đang trong quá trình sản xuất, hệ thống giá đỡ tiêu chuẩn Oberon, cáp đồng mở rộng đến NVLink 72, tùy chọn mở rộng cáp quang đến NVLink 576.

- Vera Rubin (hiện tại): Tủ rack Kyber, NVLink 144 (cáp đồng); Tủ rack Oberon, NVLink 72 + cáp quang, mở rộng lên NVLink 576; Spectrum 6, bộ chuyển mạch CPO đầu tiên trên thế giới.

- Vera Rubin Ultra (sắp ra mắt): GPU Rubin Ultra thế hệ tiếp theo, chip LP35 (lần đầu tiên tích hợp NVFP4), giúp tăng hiệu năng lên nhiều lần.

- Feynman (Thế hệ tiếp theo): GPU hoàn toàn mới, chip LP40 (được phát triển chung bởi NVIDIA và đội ngũ Groq, tích hợp NVFP4); CPU hoàn toàn mới—Rosa (Rosalyn); BlueField 5; CX 10; và giá đỡ Kyber hỗ trợ cả cáp đồng và mở rộng CPO.

Lộ trình đã rõ ràng: ba hướng đi – mở rộng cáp đồng, mở rộng cáp quang (Scale-Up) và mở rộng cáp quang (Scale-Out) – đang được theo đuổi song song. Chúng tôi cần tất cả các đối tác liên tục mở rộng năng lực sản xuất cáp đồng, sợi quang và CPO.

NVIDIA DSX: Nền tảng mô phỏng kỹ thuật số cho các nhà máy trí tuệ nhân tạo

Các nhà máy sản xuất AI ngày càng trở nên phức tạp, nhưng các nhà cung cấp công nghệ khác nhau tạo nên chúng chưa bao giờ hợp tác với nhau trong giai đoạn thiết kế, mà chỉ "gặp gỡ" tại trung tâm dữ liệu- điều này rõ ràng là chưa đủ.

Để đạt được mục tiêu này, chúng tôi đã tạo ra Omniverse, và nền tảng NVIDIA DSX được xây dựng dựa trên đó — một nền tảng cho tất cả các đối tác cùng thiết kế và vận hành các nhà máy AI quy mô gigawatt trong thế giới ảo. DSX cung cấp:

- Hệ thống mô phỏng cơ khí, nhiệt, điện và mạng ở cấp độ giá đỡ

- Việc kết nối với lưới điện cho phép điều phối việc phân phối năng lượng tiết kiệm một cách hiệu quả.

- Tối ưu hóa động về mức tiêu thụ điện năng và làm mát dựa trên Max-Q trong các trung tâm dữ liệu

Theo ước tính thận trọng, hệ thống này có thể cải thiện hiệu quả năng lượng lên khoảng gấp đôi, đây là một lợi nhuận rất đáng kể ở quy mô mà chúng ta đang thảo luận. Bắt đầu với Trái Đất Kỹ Thuật Số, Omniverse sẽ hỗ trợ các bản sao kỹ thuật số ở mọi kích cỡ, và chúng tôi đang hợp tác với các đối tác toàn cầu để xây dựng siêu máy tính lớn nhất trong lịch sử loài người.

Hơn nữa, Nvidia đang mở rộng sang lĩnh vực vũ trụ. Các chip Thor của chúng tôi đã nhận được chứng nhận về khả năng tản nhiệt và đang hoạt động trên các vệ tinh. Chúng tôi cũng đang hợp tác với các đối tác để phát triển Vera Rubin Space-1 nhằm xây dựng các trung tâm dữ liệu trong không gian. Quản lý nhiệt là một thách thức quan trọng trong không gian, nơi việc tản nhiệt hoàn toàn dựa vào bức xạ, và chúng tôi đang tập hợp các kỹ sư hàng đầu để giải quyết thách thức này.

OpenClaw: Hệ điều hành cho kỷ nguyên của các tác nhân thông minh

Peter Steinberger đã phát triển một phần mềm có tên OpenClaw. Đây là dự án mã nguồn mở phổ biến nhất trong lịch sử loài người, vượt qua những thành tựu 30 năm của Linux chỉ trong vài tuần.

Về bản chất, OpenClaw là một hệ thống tác nhân có khả năng:

- Quản lý tài nguyên, truy cập công cụ, hệ thống tập tin và các mô hình ngôn ngữ lớn.

- Thực hiện lập lịch và nhiệm vụ theo thời gian

- Phân tích vấn đề từng bước một và liên hệ với các nhân viên phụ trách.

- Hỗ trợ nhập và xuất dữ liệu ở mọi định dạng (giọng nói, video, văn bản, email, v.v.).

Nếu dùng cú pháp hệ điều hành, thì nó thực sự là một hệ điều hành—một hệ điều hành dành cho máy tính tác nhân thông minh. Windows đã tạo nên máy tính cá nhân; OpenClaw tạo nên các tác nhân thông minh cá nhân.

Mỗi công ty cần xây dựng chiến lược OpenClaw riêng của mình, giống như chúng ta đều cần chiến lược Linux, chiến lược HTML và chiến lược Kubernetes.

Tái cấu trúc hoàn toàn CNTT doanh nghiệp

Trước khi có OpenClaw, CNTT doanh nghiệp bao gồm dữ liệu và tập tin được đưa vào hệ thống, luân chuyển qua các công cụ và quy trình làm việc, và cuối cùng trở thành công cụ để con người sử dụng. Các công ty phần mềm tạo ra các công cụ, và tích hợp hệ thống (GSI) cùng các công ty tư vấn giúp doanh nghiệp sử dụng chúng.

CNTT doanh nghiệp sau OpenClaw: Mọi công ty SaaS sẽ chuyển đổi thành công ty AaaS (Agent as a Service) — không chỉ cung cấp công cụ, mà còn cung cấp các tác nhân AI chuyên về các lĩnh vực cụ thể.

Tuy nhiên, có một thách thức quan trọng ở đây: các tác nhân thông minh trong một doanh nghiệp có thể truy cập dữ liệu nhạy cảm, thực thi mã và giao tiếp với các thực thể bên ngoài. Điều này phải được kiểm soát chặt chẽ trong hoàn cảnh doanh nghiệp.

Để đạt được mục tiêu này, chúng tôi đã hợp tác với Peter để tích hợp bảo mật vào phiên bản doanh nghiệp, dẫn đến kết quả như sau:

- NeMo Claw (Thiết kế tham khảo): Một khung tham khảo cấp doanh nghiệp dựa trên OpenClaw, tích hợp bộ công cụ trí tuệ nhân tạo (AI) hoàn chỉnh của NVIDIA.

- Open Shield (Lớp bảo mật): Tích hợp vào OpenClaw, cung cấp công cụ quản lý chính sách, các rào cản mạng và định tuyến bảo mật để đảm bảo an ninh dữ liệu doanh nghiệp.

- NeMo Cloud: Có thể tải xuống và sử dụng, đồng thời tương thích với các công cụ chiến lược của tất cả các công ty SaaS.

Đây là thời kỳ phục hưng của công nghệ thông tin doanh nghiệp, một ngành công nghiệp ban đầu trị giá 2 nghìn tỷ đô la và sắp phát triển thành một ngành công nghiệp trị giá nhiều nghìn tỷ đô la, chuyển từ việc cung cấp công cụ sang cung cấp các dịch vụ trợ lý AI chuyên nghiệp.

Tôi hoàn toàn có thể hình dung rằng trong tương lai, mỗi kỹ sư trong công ty sẽ có một ngân sách token hàng năm. Lương hàng năm của họ có thể lên tới hàng trăm nghìn đô la, và tôi sẽ cấp thêm cho họ một lượng token tương đương với một nửa lương, giúp tăng năng suất làm việc của họ lên gấp mười lần. "Số lượng token được cấp khi gia nhập công ty là bao nhiêu" đã trở thành một chủ đề tuyển dụng mới ở Thung lũng Silicon.

Trong tương lai, mọi doanh nghiệp sẽ vừa là người sử dụng token (dành cho kỹ sư) vừa là nhà sản xuất token (để cung cấp dịch vụ cho khách hàng). Tầm quan trọng của OpenClaw không thể bị đánh giá thấp; nó quan trọng ngang với HTML và Linux.

Sáng kiến mô hình mở của NVIDIA

Về phần tay cầm tùy chỉnh, chúng tôi cung cấp mẫu do chính NVIDIA phát triển tiên tiến nhất:

Các lĩnh vực mô hình hóa bao gồm Nemotron (mô hình ngôn ngữ quy mô lớn) , Cosmos(mô hình nền tảng thế giới), GROOT (mô hình robot hình người đa năng), Alpamayo (lái xe tự động), BioNeMo (sinh học kỹ thuật số) và Phys-AI (vật lý trí tuệ nhân tạo).

Chúng tôi luôn đi đầu về công nghệ trong mọi lĩnh vực và cam kết không ngừng cải tiến – Nemotron 3 đ