Bài viết này được dịch máy

Xem bản gốc

Tôi đang ở lần huấn luyện thứ tư cho mô hình 3B.

Tôi học được rất nhiều điều, mô hình đầu tiên rõ ràng là tệ so với những gì tôi có hiện tại, mặc dù tôi nghi ngờ nó thậm chí còn không tốt hơn một mô hình SOTA thế hệ trước cho cùng lĩnh vực.

Nhưng giờ tôi tò mò về mức độ hiệu quả tối đa.

Dennison

@DennisonBertram

03-26

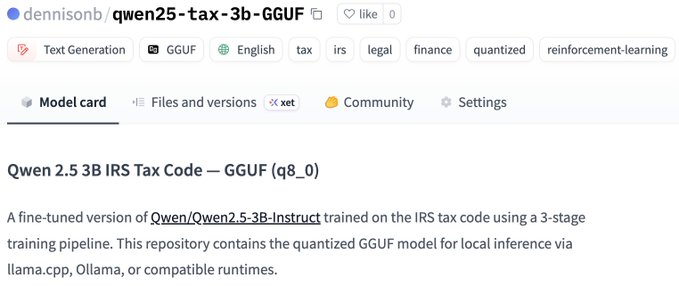

Just trained a small LLM on the entire IRS tax code using reinforcement learning — fully local on my MacBook.

Base model: Qwen 2.5 3B Instruct

Training data: 2,113 IRC sections + 6,149 Treasury Regulations

Pipeline: SFT → DPO → GRPO

Hardware: Apple M4 Max, 128GB RAM

Từ Twitter

Tuyên bố từ chối trách nhiệm: Nội dung trên chỉ là ý kiến của tác giả, không đại diện cho bất kỳ lập trường nào của Followin, không nhằm mục đích và sẽ không được hiểu hay hiểu là lời khuyên đầu tư từ Followin.

Thích

Thêm vào Yêu thích

Bình luận

Chia sẻ