本文为机器翻译

展示原文

开源人工智能模型正在迅速变得更加强大,像@ionet这样的GPU网络使它们能够大规模使用。

认识一下IO智能,这是一个提供向量数据库即服务、25个开源人工智能模型和专业代理的平台。

查看我的交互式仪表板。👇

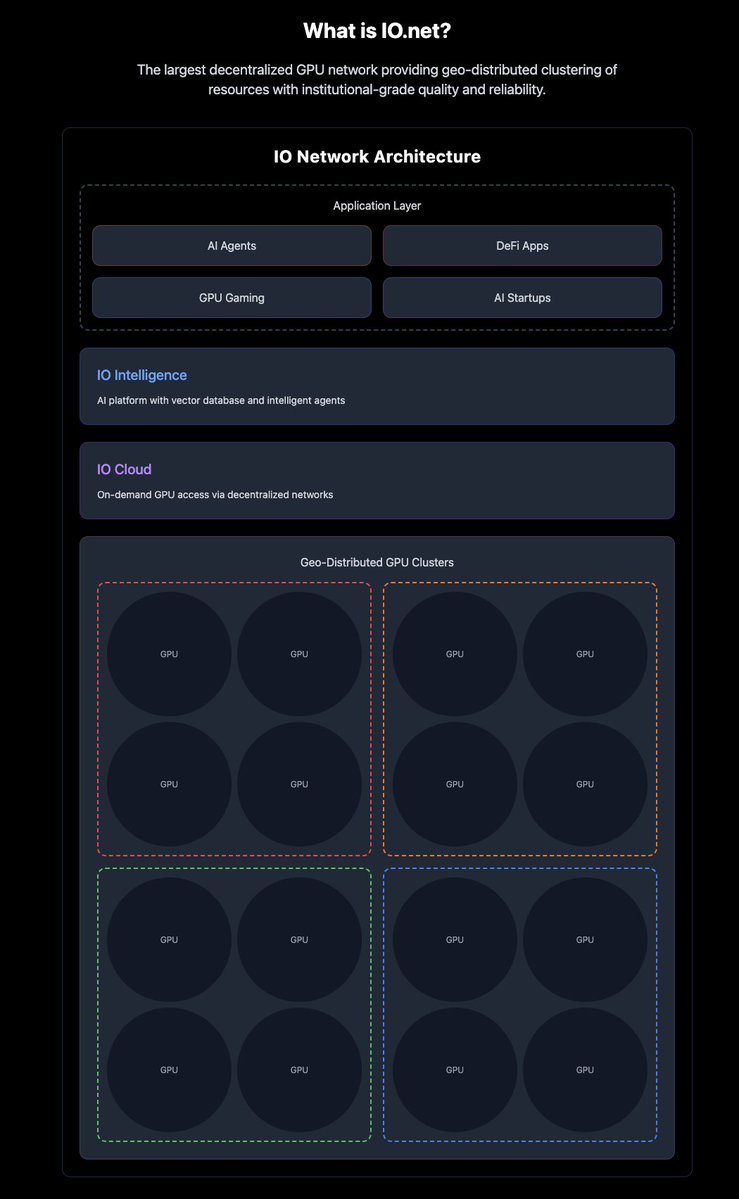

1/@ionet 是市场上最大的去中心化 GPU 网络,也是唯一能够实现具有机构级质量和可靠性的计算资源地理分布式集群的解决方案。

2/ $IO 是市场领先的解决方案,提供独特的优势,包括弹性扩展。

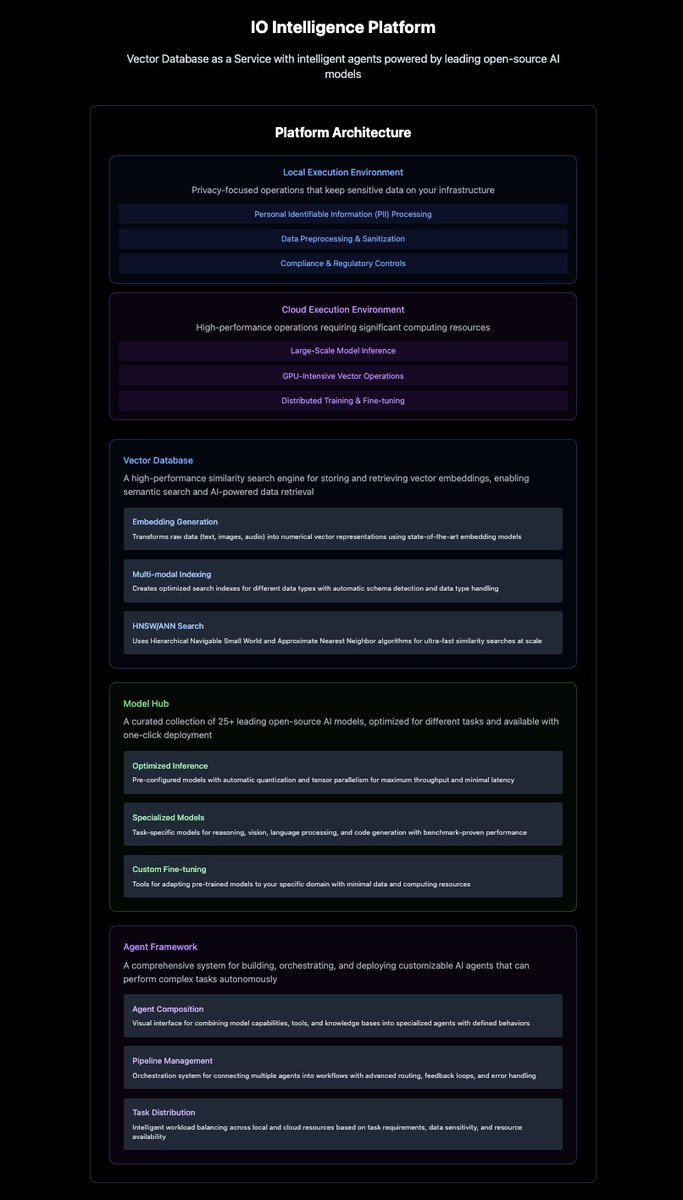

3/ 最具颠覆性的产品无疑是IO智能,这是针对AI建设者的全栈解决方案。

4/ 灵活的执行方式、VectorDB 即服务、领先的 AI 模型和模板化的 AI 代理。IO Intelligence 提供所有这些。

5/ 提供 25 个开源模型,让开发者可以灵活地选择符合自身需求的模型。

那么,这些模型的比较结果如何?

让我们仔细看看这些模型的性能。

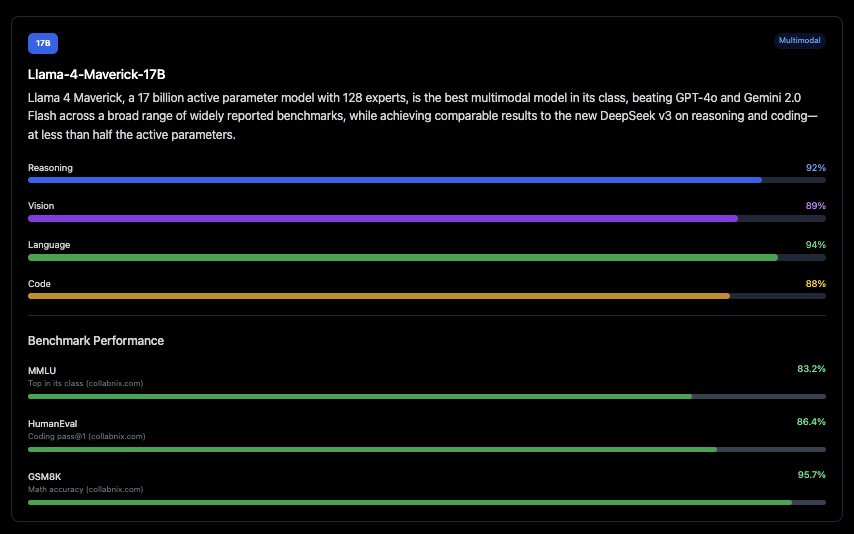

6/ 骆驼-4-特立独行-17B

Llama 4 Maverick 是一个拥有 128 位专家的 170 亿活跃参数模型,是同类模型中最好的多模态模型,在广泛报道的基准测试中击败了 GPT-4o 和Gemini 2.0 Flash。

它也取得了与新

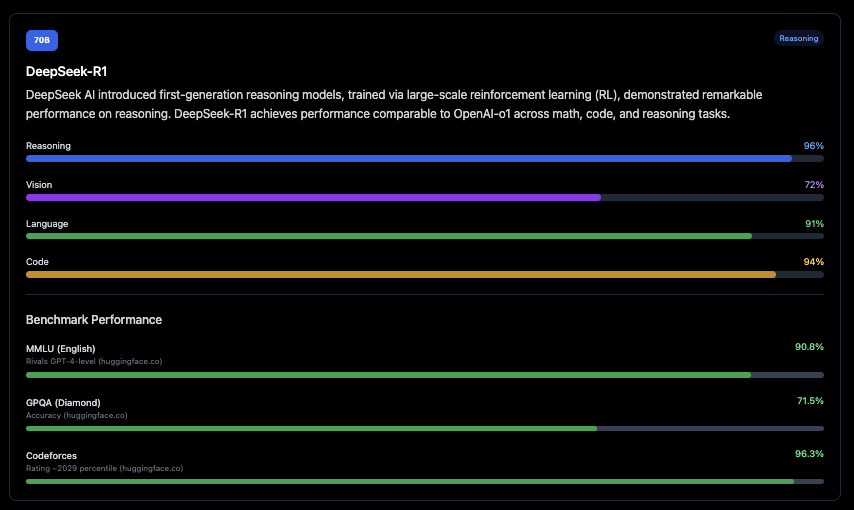

7/ DeepSeek-R1

DeepSeek AI 推出了第一代推理模型,通过大规模强化学习 (RL) 进行训练,在推理方面表现出色。

DeepSeek-R1 在数学、代码和推理任务方面的表现堪比 OpenAI-o1。

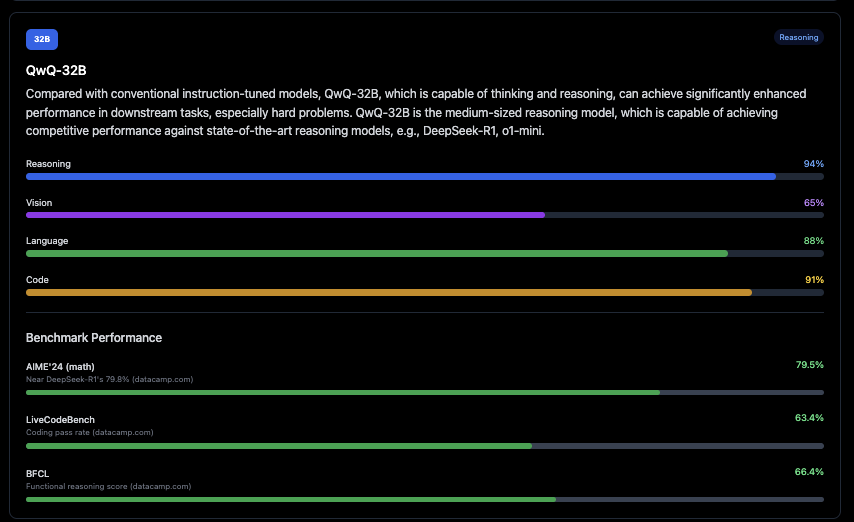

8/ QwQ-32B

与传统的指令调优模型相比,QwQ-32B 具备思考和推理能力,在下游任务(尤其是难题)中能够显著提升性能。

QwQ-32B 是一款中等规模的推理模型,能够

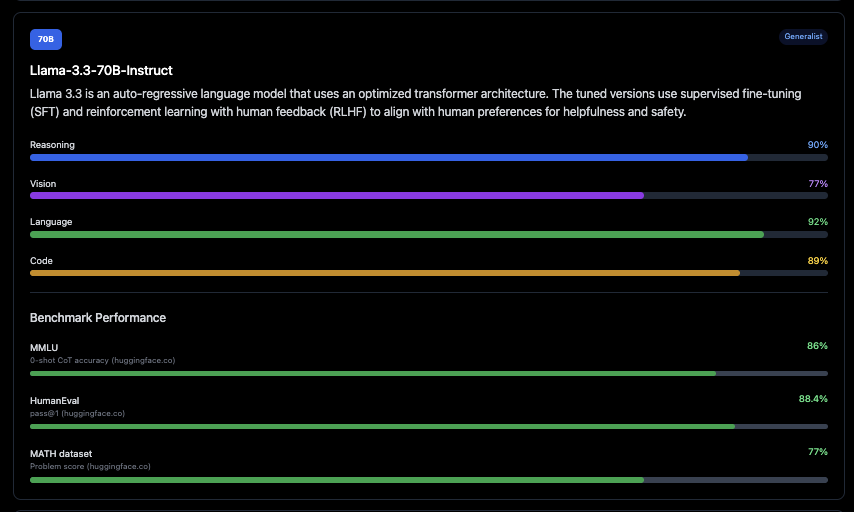

9/ Llama-3.3-70B-Instruct

Llama 3.3 是一个自回归语言模型,采用优化的 Transformer 架构。

调整后的版本使用监督微调 (SFT) 和带人工反馈的强化学习 (RLHF),以符合人类对有用性的偏好。

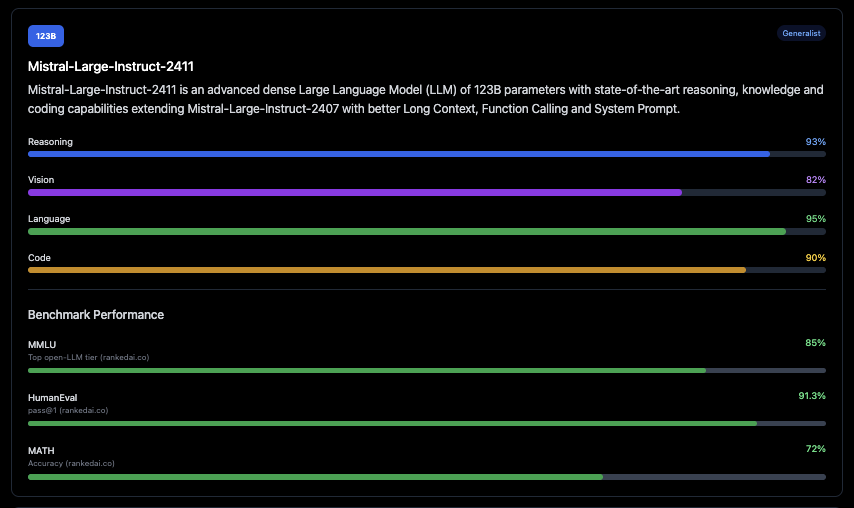

10/ Mistral-Large-Instruct-2411

Mistral-Large-Instruct-2411 是一个先进的密集大型语言模型 (LLM),拥有 1230 亿个参数,具备最先进的推理、知识和编码能力。

它扩展了 Mistral-Large-Instruct-2407,使其具有更强大的长上下文和函数调用能力。

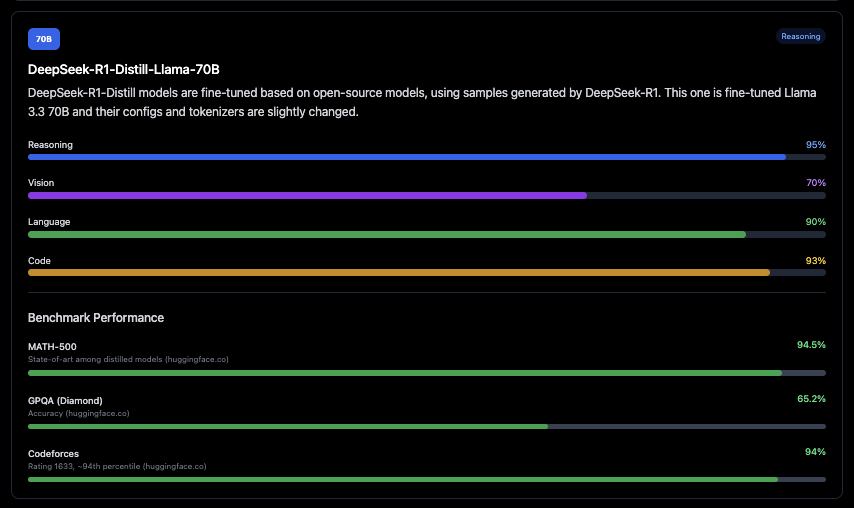

11/ DeepSeek-R1-Distill-Llama-70B

DeepSeek-R1-Distill 模型基于开源模型进行微调,使用 DeepSeek-R1 生成的样本。

此模型基于 Llama 3.3 70B 进行微调,其配置和分词器略有修改。

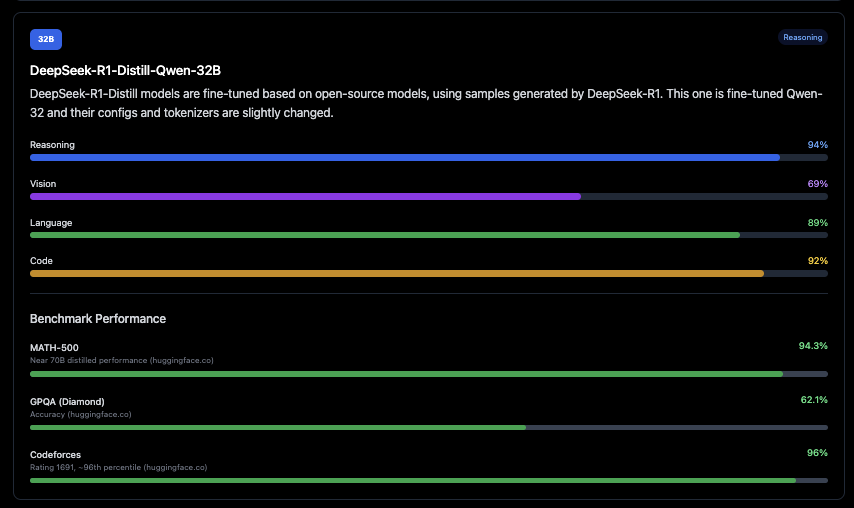

12/ DeepSeek-R1-Distill-Qwen-32B

DeepSeek-R1-Distill 模型基于开源模型进行微调,使用 DeepSeek-R1 生成的样本。

此模型是对 Qwen-32 进行微调的,其配置和分词器略有修改。

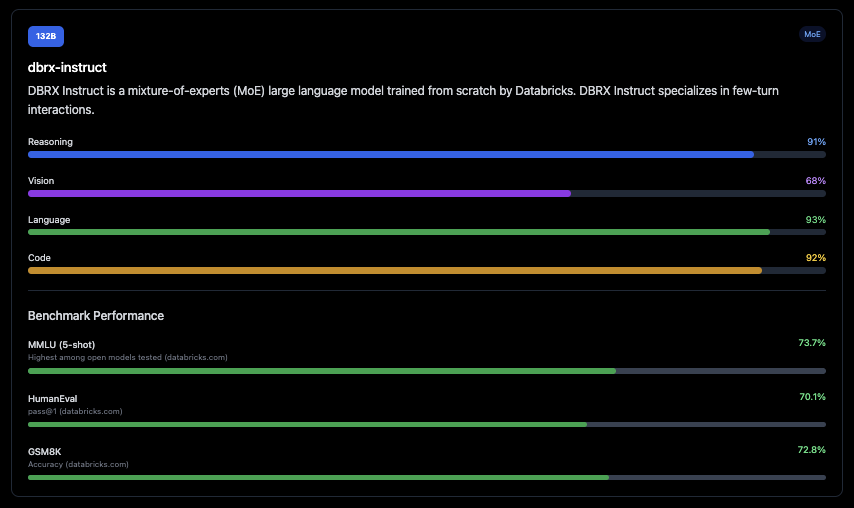

13/ dbrx-instruct

DBRX Instruct 是一个由 Databricks 从头开始训练的混合专家 (MoE) 大型语言模型。DBRX Instruct 专注于少轮交互。

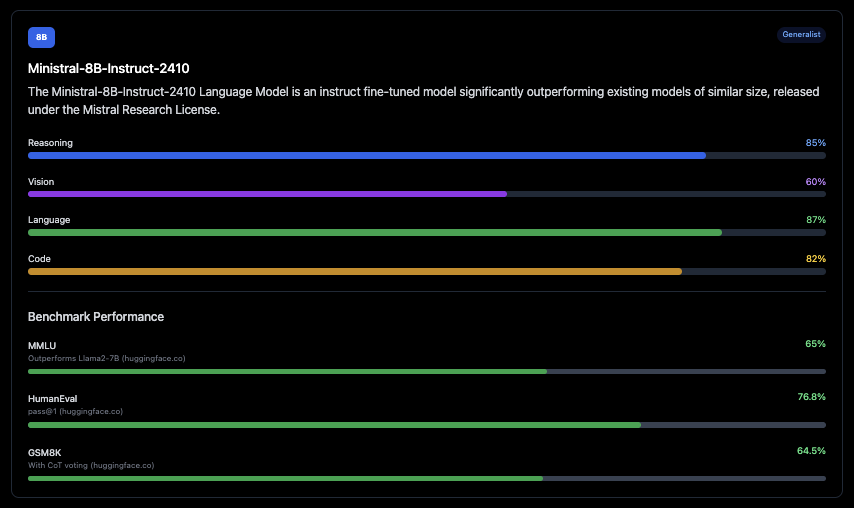

14/ Ministral-8B-Instruct-2410

Ministral-8B-Instruct-2410 语言模型是一个经过指令微调的模型,其性能显著优于现有类似规模的模型,该模型根据 Mistral 研究许可证发布。

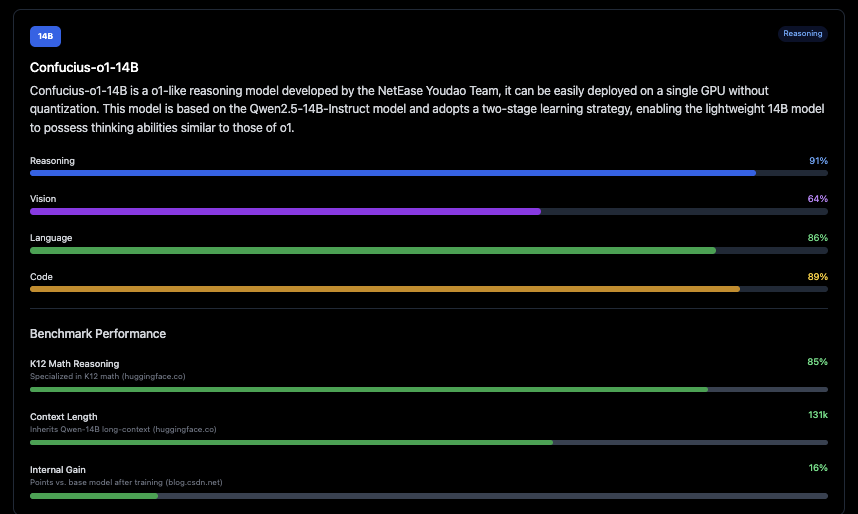

15/ Confucius-o1-14B

Confucius-o1-14B 是网易有道团队开发的类 o1 推理模型,可以轻松部署在单 GPU 上,无需量化。

该模型基于 Qwen2.5-14B-Instruct 模型,采用两阶段学习策略,使

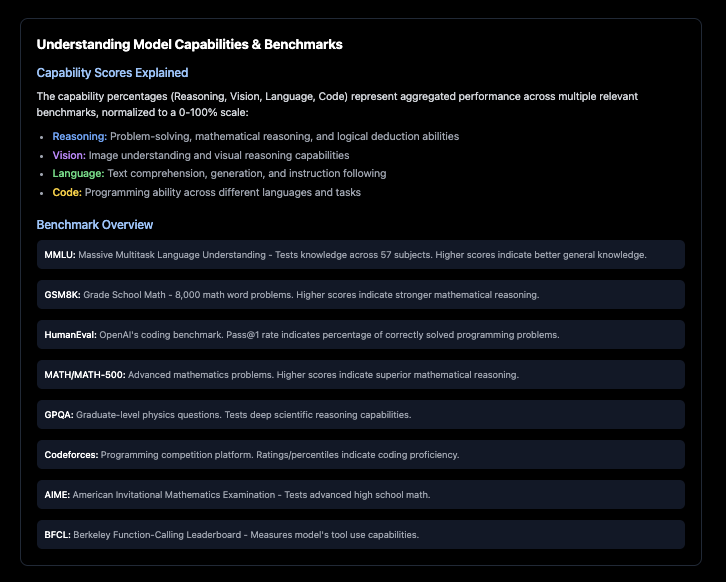

16/ 有关绩效评分和基准的更多信息。

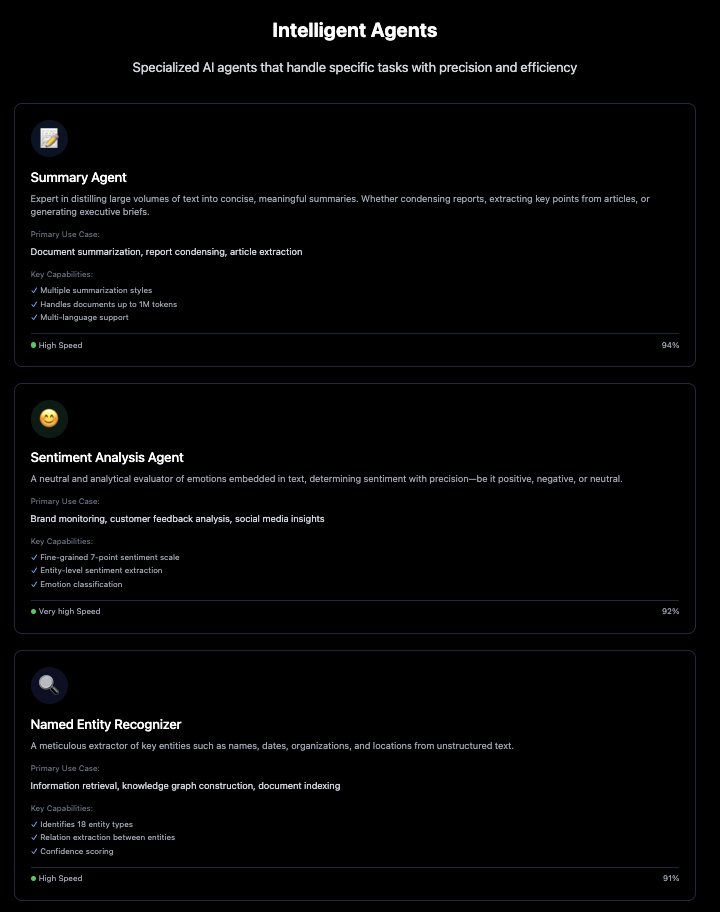

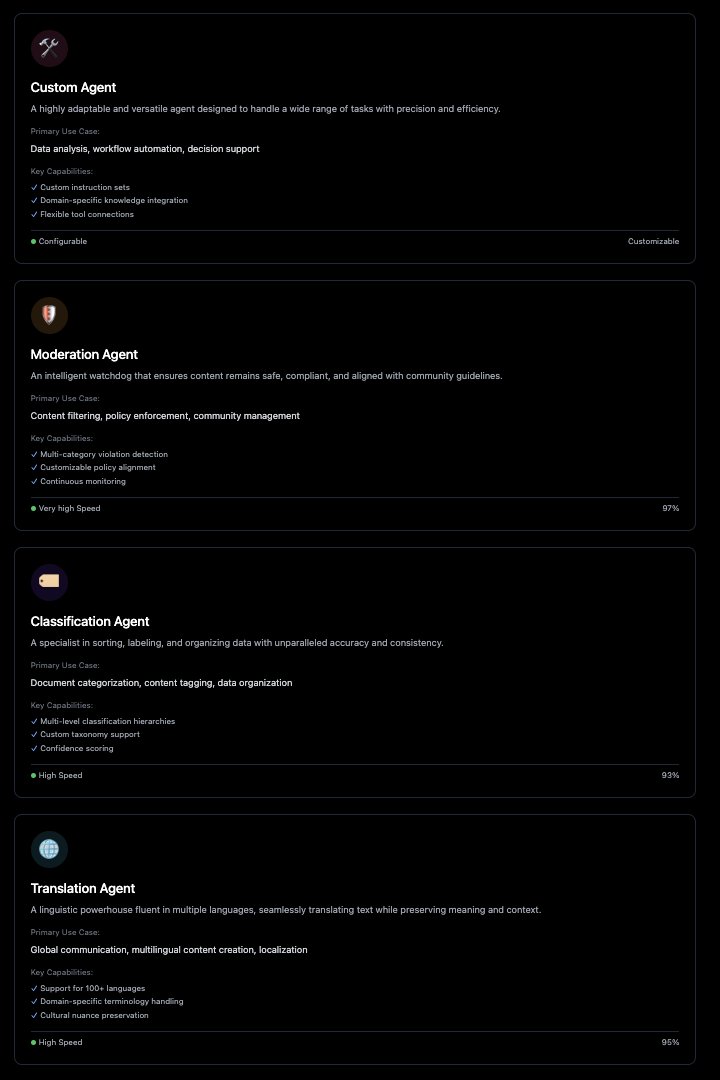

17/ 除了领先的开源模型之外,IO 智能还提供对专门用于特定任务的预构建 AI 代理的 API 访问。

18/ 它们可以无缝集成到工作流程中,通过人工智能自动化提高效率。

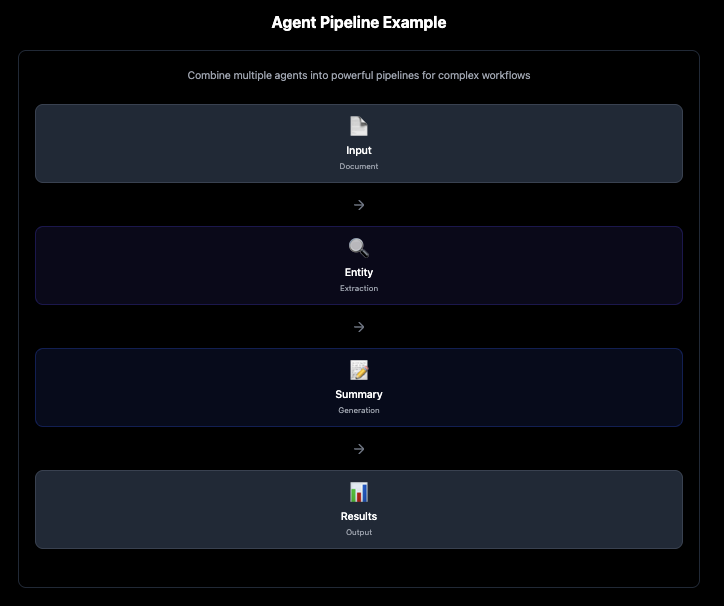

19/ 此外,它们可以组合起来以实现更复杂的工作流程。

20/ 查看 @ionet 文档,亲自体验他们的代理。

我可能很快也会发布一个演示,敬请期待。

21/ 如果您想查看仪表板的测试版(由我的朋友 Claude 主持),请查看下面的链接。

claude.site/artifacts/80a9ea94...

感谢阅读 chads

如果您喜欢这个帖子,请在下面链接的帖子上点赞、评论或转发。

如果您正在寻找区块链基础设施和人工智能基础设施(或更具交互式仪表板)的Alpha版本,请务必关注。

x.com/zerokn0wledge_/status/19...

来自推特

免责声明:以上内容仅为作者观点,不代表Followin的任何立场,不构成与Followin相关的任何投资建议。

喜欢

收藏

评论

分享