英伟达的 Rubin 芯片正在将人工智能转化为廉价的基础设施。正因如此,像 Bittensor 这样的开放式智能市场开始变得重要起来。

英伟达利用 CES 2026 展会预示着人工智能运行方式的重大转变。该公司并未率先推出消费级 GPU,而是发布了 Rubin,一个机架级 AI 计算平台,旨在让大规模推理更快、更便宜、更高效。

Vera Rubin 正在全力生产中。

— NVIDIA (@nvidia) 2026年1月6日

我们刚刚推出了下一代人工智能基础设施——NVIDIA Rubin 平台,该平台汇集了六款新芯片,打造出一台专为大规模人工智能而构建的人工智能超级计算机。

以下是您需要了解的5件最重要的事🧵 pic.twitter.com/TiQKUK4eY3

鲁宾将人工智能转化为工业基础设施

英伟达在CES上的发布会明确表明,它不再销售单个芯片,而是销售人工智能工厂。

Rubin是英伟达的下一代产品。

黄仁勋刚刚打破了业内最重要的规则。

— Ricardo (@Ric_RTP) 2026年1月7日

这也解释了为什么英伟达控制了95%的人工智能芯片市场。

昨晚在CES展会上,他发布了Vera Rubin——这款全新的人工智能超级计算机目前正在发货。

全面投产已于数周前开始。

但这是…… pic.twitter.com/INWF8ByP88

这一点至关重要,因为现代人工智能工作负载不再像单个聊天机器人那样简单。它们越来越依赖于许多小型模型、代理和专用服务之间的实时通信。

降低成本改变了人工智能的构建方式

Rubin 通过降低推理成本并提高可扩展性,催生了一种新型的 AI 经济模式。开发者可以部署数千个经过精细调优的模型,而不是一个庞大的单体应用。

企业可以运行基于代理的系统,这些系统使用多种模型来执行不同的任务。

然而,这又带来了一个新的问题。一旦人工智能变得模块化且应用广泛,就必须有人决定由哪个模型来处理每个请求。必须有人来衡量性能、管理信任关系并处理支付。

云平台可以托管模型,但它们不提供中立的模型交易市场。

Bittensor 正好可以填补这个空白。

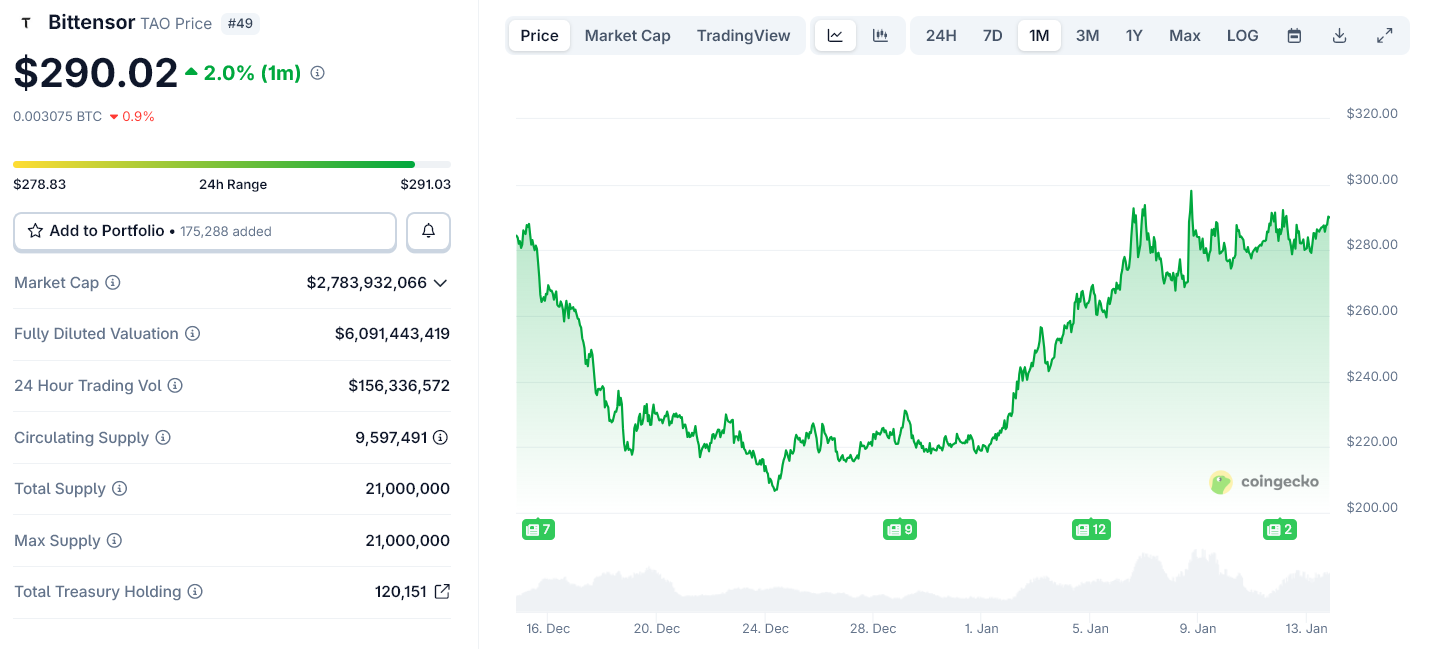

Bittensor 不出售计算能力。它运行一个去中心化网络,人工智能模型在该网络中竞争以提供有用的输出。该网络使用链上性能数据对这些模型进行排名,并以原生代币 TAO 支付报酬。

感谢英伟达CEO黄仁勋在不知道Bittensor已经存在的情况下,描述了$TAO。https://t.co/508xbAuWjn

— YVR τrader (@YVR_Trader) 2026 年 1 月 7 日

每个 Bittensor 子网都像一个市场,专门交易特定类型的智能,例如文本生成、图像处理或数据分析。表现优异的模型获得更多份额,而表现不佳的模型则会失去影响力。

随着模型数量的增加,这种结构的价值也越来越高。

为什么英伟达的鲁宾让Bittensor的模型变得可行?

Rubin 与 Bittensor 并不竞争,它只是让 Bittensor 的经济模式得以大规模运行。

随着英伟达降低人工智能运行成本,越来越多的开发者和公司能够部署专用模型。这就更加需要一个中立的系统,用于跨云和组织对这些模型进行排名、选择和付费。

Bittensor 提供了这样一个协调层。它将海量的 AI 服务转化为一个开放、竞争的市场。

英伟达掌控着人工智能的物理层:芯片、内存和网络。鲁宾通过降低人工智能的运行成本和加快运行速度,进一步强化了这种控制。

在 CES 上,我们的 CEO 黄仁勋展示了物理人工智能如何通过 Rubin、GR00T、Alpamayo 等产品在工厂、机器人和下一代自动驾驶汽车中变为现实。

— NVIDIA (@nvidia) 2026年1月13日

观看主题演讲:https://t.co/yUHiDMBXSg

阅读公告:https://t.co/16BG6MDmD5 pic.twitter.com/1qo9SIqTha

Bittensor 运行在上一层。它负责处理智能的经济效益,决定使用哪些模型以及给予哪些奖励。

随着人工智能向智能体群和模块化系统发展,经济层面的集中化变得越来越困难。

这意味着什么

Rubin 计划于 2026 年晚些时候推出,这将扩展数据中心和云端的 AI 容量。这将推动模型和代理数量的增长,从而竞争实际工作负载。

像Bittensor这样的开放网络将从这种转变中受益。它们并不会取代英伟达的基础设施,而是为其提供市场。

从这个意义上讲,鲁宾并没有削弱去中心化人工智能,而是为其提供了组织的目标。

这篇文章《英伟达 Rubin 芯片如何推动 Bittensor 在 2026 年的普及》最初发表于BeInCrypto。