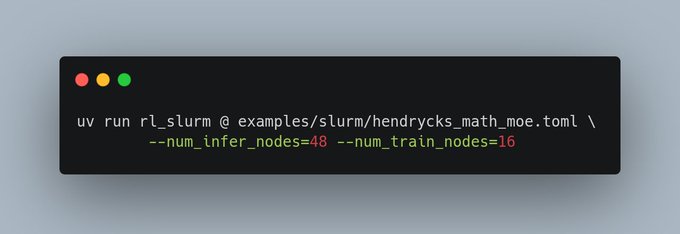

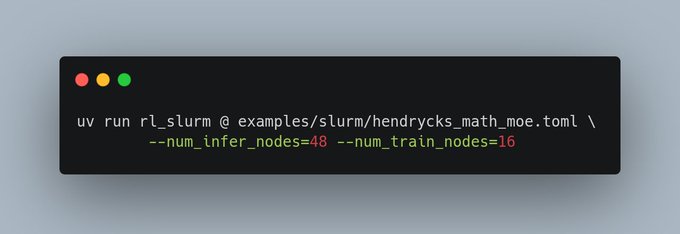

我们刚刚将 Slurm 支援合并到 prime-rl 中,只需一条命令即可渲染并启动 Slurm 脚本,从而在 512 个以上的 GPU 上进行大规模 MOE 训练。 我们也支持 Kubernetes。

本文为机器翻译

展示原文

来自推特

免责声明:以上内容仅为作者观点,不代表Followin的任何立场,不构成与Followin相关的任何投资建议。

喜欢

收藏

评论

分享

我们刚刚将 Slurm 支援合并到 prime-rl 中,只需一条命令即可渲染并启动 Slurm 脚本,从而在 512 个以上的 GPU 上进行大规模 MOE 训练。 我们也支持 Kubernetes。