感觉内存股每天都在上涨。美光科技(Micron)是最大的内存厂商之一,仅去年一年股价就上涨了近三倍。许多投资者眼睁睁地看着类似的股票日复一日地上涨,等待回调的到来。然而,他们却未能真正了解这些产品究竟是什么。

在这篇文章中,我和尼古拉斯将用通俗易懂的方式,为大家解读眼前的机遇。让我们开始吧。

引言

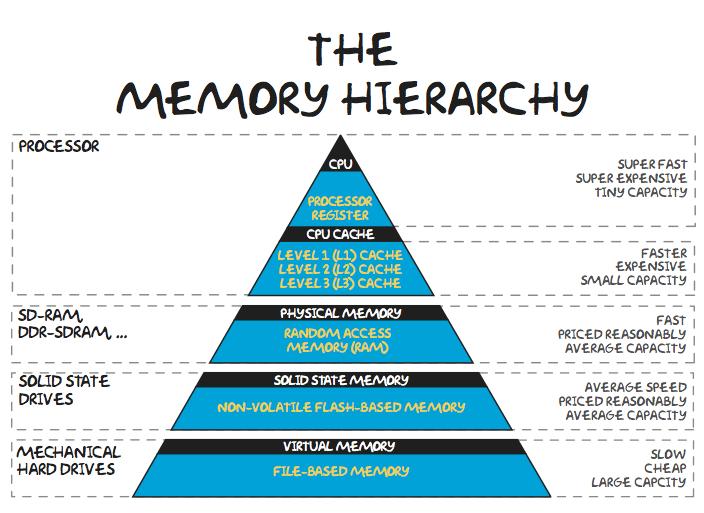

内存使计算机或设备能够在执行临时计算时存储信息。这主要通过读写操作来实现。内存的每一层在读写速度、成本和容量方面都有不同的特性。

在人工智能领域,内存变得更加重要,因为模型需要同时处理海量数据。当我们使用聊天机器人、图像生成器或推荐算法等工具时,内存会不断地以高带宽进出庞大的数据集。

人工智能模型越智能、功能越强大,就需要越多的内存才能有效运行。如果没有强大的内存系统,大型语言模型和机器学习应用领域的进步就会停滞不前。

内存层次结构(存储层与工作层)

计算机将内存分为工作内存(系统执行计算时使用)和存储内存(用于长期保存数据,但读写速度较慢)。这种划分的原因是,高带宽(读写速度快)的内存价格昂贵,而价格低廉的长期存储内存带宽较低(读写速度快)。

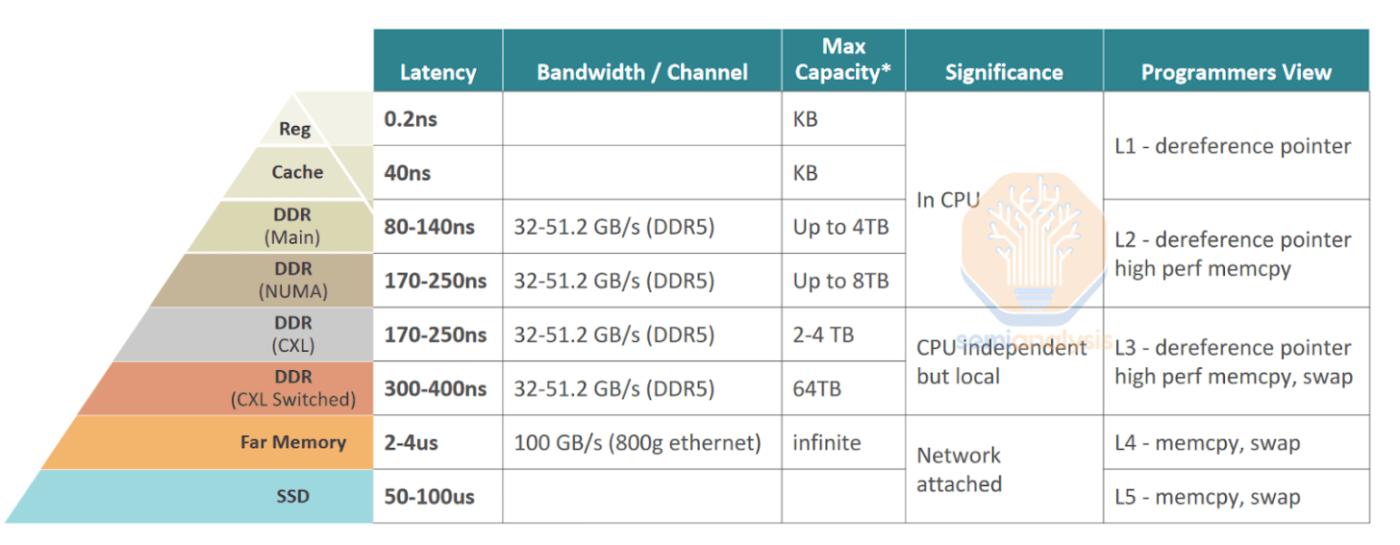

许多与内存相关的概念都可以归结为芯片与处理单元之间的距离。距离越远,吞吐量越慢。

1. 处理器寄存器和 CPU 高速缓存(SRAM):

它是什么:这通常是整个系统中吞吐量最高的内存,因为它位于 XPU(XPU 指 CPU 或 GPU)内部或紧邻其旁。它存储处理器当前所需的少量数据。

它由以下部分组成: SRAM(直接构建在逻辑硅上的静态存储器)。

2. 物理内存(DRAM/RAM)

这是什么:这是计算机的主工作内存,是运行程序所在的区域。这里需要很高的吞吐量,因为任何延迟都会导致计算队列的建立。

它由以下部分组成: DRAM 单元(每个比特一个晶体管 + 一个电容器)。

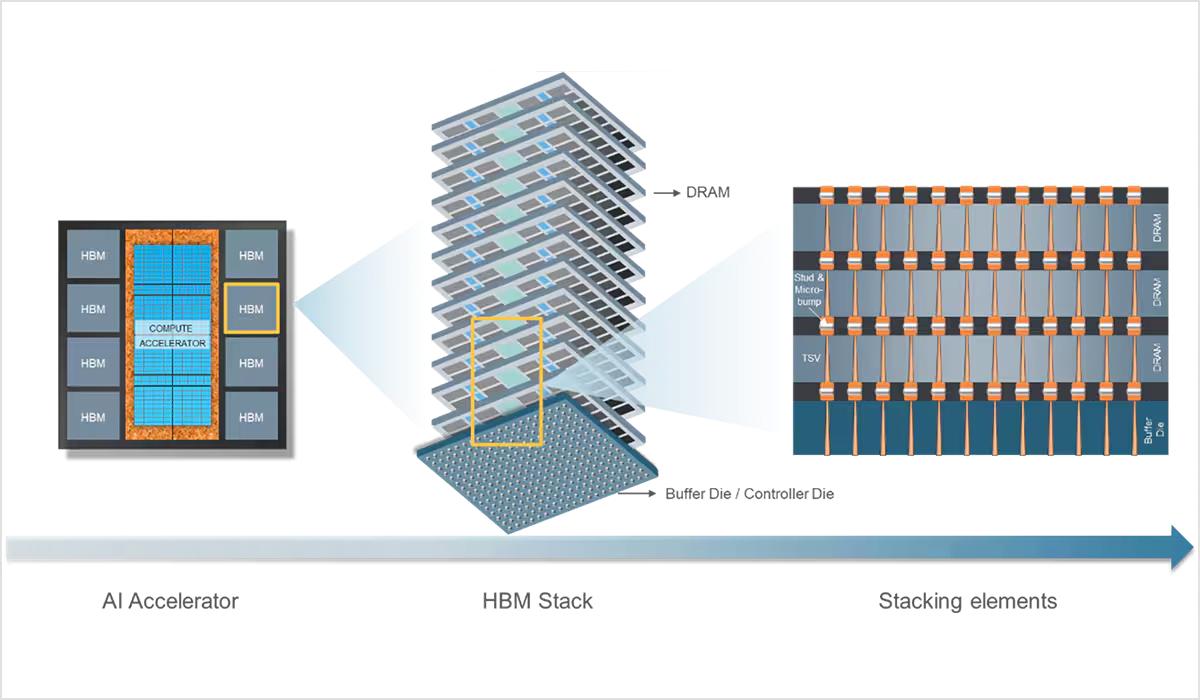

3. 高带宽内存(HBM)

简单来说,它是一种超高速的垂直堆叠式DRAM,放置在AI芯片旁边。由于HBM的垂直堆叠特性,它具有更高的吞吐量,但同时也增加了制造工艺的复杂性。

它由以下部分组成:堆叠有硅通孔 (TSV) 的 DRAM 芯片。

成本和尺寸:非常昂贵,容量比 DRAM 小,但速度比 DRAM 快得多。

产地:台湾和韩国,因为对包装技术有较高要求(实物垂直整合)。

4. 固态存储(NAND/SSD)

NAND 是一种非易失性闪存,无需电源即可存储数据,用于 SSD、U盘和存储卡等高密度存储设备。

它是什么(简单来说):断电时对文件、应用程序和数据进行长期存储。

成本和尺寸:每 GB 价格低廉,容量大(数百 GB 到 TB),吞吐量低于 HBM 和 DRAM,但通常足以满足对延迟要求不高的计算工作负载。

5. 硬盘驱动器 (HDD)

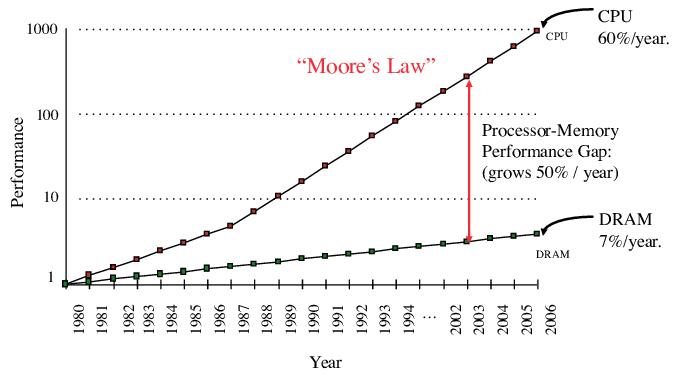

内存距离处理器越近,速度就越快,体积就越小,价格也就越贵。人工智能将需求推向了金字塔顶端。这是因为GPU具有极强的并行计算能力,每秒可执行数万亿次计算。

HBM 和 NAND

HBM 是最关键的内存层,因为它直接位于 AI GPU 旁边,而 NAND 是“仓库”存储,用于保存数据集、模型检查点和日志。

记忆的辩护能力

存储器厂商之所以能从商品供应商跃升为人工智能领域的霸主,关键在于它们在半导体制造工艺方面的先进技术。这些工艺可以分解为三个关键要素:

结束

原始计算能力的增长速度已经超过了内存传输数据的速度,这就是所谓的“内存墙”。芯片的运算速度可以快得惊人,但如果数据无法及时到达,它们就会停滞不前。

大量的时间和精力都花在了在内存和计算之间传输模型权重和激活值上,而不是数学运算本身,因此带宽成为了限制因素。

HBM 是目前最好的解决方案,因为它将宽而快的内存直接放置在 GPU 旁边,但它的容量和供应受到限制,因此内存最终决定了 AI 系统扩展的速度。