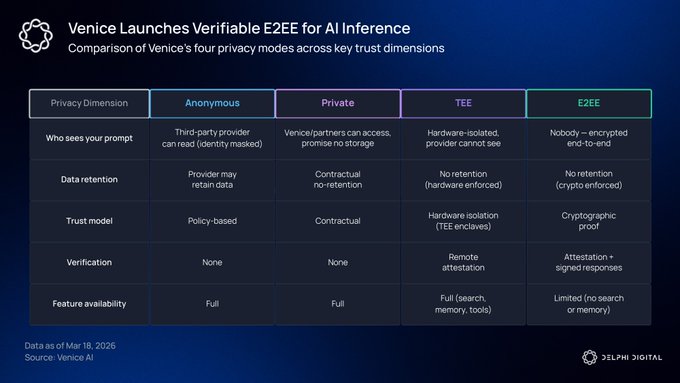

Venice刚刚发布了端到端加密的AI推理系统。 如今所有主流人工智能平台都基于相同的基本信任假设:你必须信任服务提供商会负责任地处理你的数据。 @AskVenice 的架构略有不同。对话记录存储在您的设备本地,提示信息不会持久保存在服务器端。当您使用前沿模型时,Venice 会代理请求,因此服务提供商永远不会收到您的身份数据。但是,同样的信任假设仍然适用。如果 Venice 或其合作伙伴想要拦截数据,该架构本身无法阻止。 此次新版本引入了两种硬件强制执行的隐私模式。 TEE 在由 NEAR AI Cloud 和Phala Network运营的安全硬件隔离区内运行推理,将计算与主机操作系统和基础设施运营商隔离。远程认证将加密证书与物理硬件绑定,因此任何人都可以独立验证模型是否在真正的隔离区内运行。您不再需要信任 GPU 运营商,但仍然信任 Venice 的传输层。 端到端加密 (E2EE) 消除了剩余的信任假设。提示信息在传输前会在设备上加密,在 Venice 的基础设施中保持加密状态,并且仅在经过验证的安全区域内Decrypt。在正常运行期间,Venice 无法查看您的任何数据。但缺点是响应速度可能会变慢,并且由于需要在安全区域外解密,因此网络搜索和内存功能将被禁用。 目前,这两种模式都基于 NEAR AI Cloud 和Phala Network上的少数开源模型运行,并且仅供 Pro 订阅用户使用。 这些保证在实践中的可靠性取决于认证的实施情况以及独立审计是否证实了这些说法。

本文为机器翻译

展示原文

来自推特

免责声明:以上内容仅为作者观点,不代表Followin的任何立场,不构成与Followin相关的任何投资建议。

喜欢

收藏

评论

分享