本文为机器翻译

展示原文

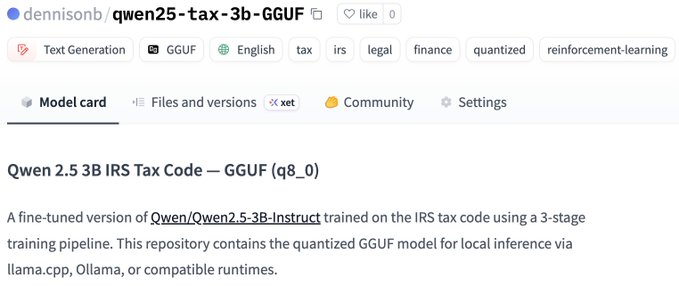

我已经进行了四次 3B 模型的训练迭代。

我学到了很多,第一个模型和现在的模型相比简直是垃圾,尽管我怀疑它甚至比不上一代针对同一领域的最先进模型。

但我现在很好奇它的性能极限在哪里。

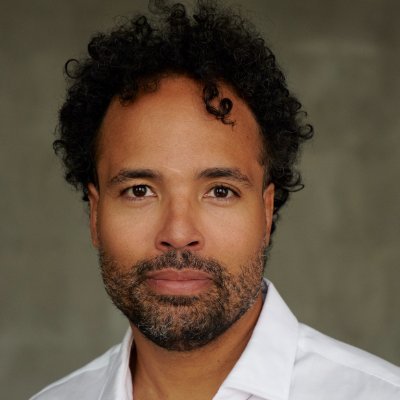

Dennison

@DennisonBertram

03-26

Just trained a small LLM on the entire IRS tax code using reinforcement learning — fully local on my MacBook.

Base model: Qwen 2.5 3B Instruct

Training data: 2,113 IRC sections + 6,149 Treasury Regulations

Pipeline: SFT → DPO → GRPO

Hardware: Apple M4 Max, 128GB RAM

来自推特

免责声明:以上内容仅为作者观点,不代表Followin的任何立场,不构成与Followin相关的任何投资建议。

喜欢

收藏

评论

分享