作者: Johnson Lai

編譯:深潮TechFlow

最近,我們在 Crypto Twitter 上見證了 AI 智能體代幣和 AI meme 幣的熱潮。但這也引發了一個重要問題:

我們正生活在一個奇異的時代——一個我們努力想證明某物是 AI 而非人類的時代。想想看:我們花了幾十年時間通過 CAPTCHA 和圖靈測試來證明自己是人類,而現在卻在做完全相反的事情。

隨著每天湧現出越來越多的 AI 智能體,我們開始質疑,“等等,這真的是 AI 還是有人在假裝?” 這種局勢的逆轉既諷刺又引人入勝,尤其是當這些 AI 智能體越來越深入我們的日常數字生活時。

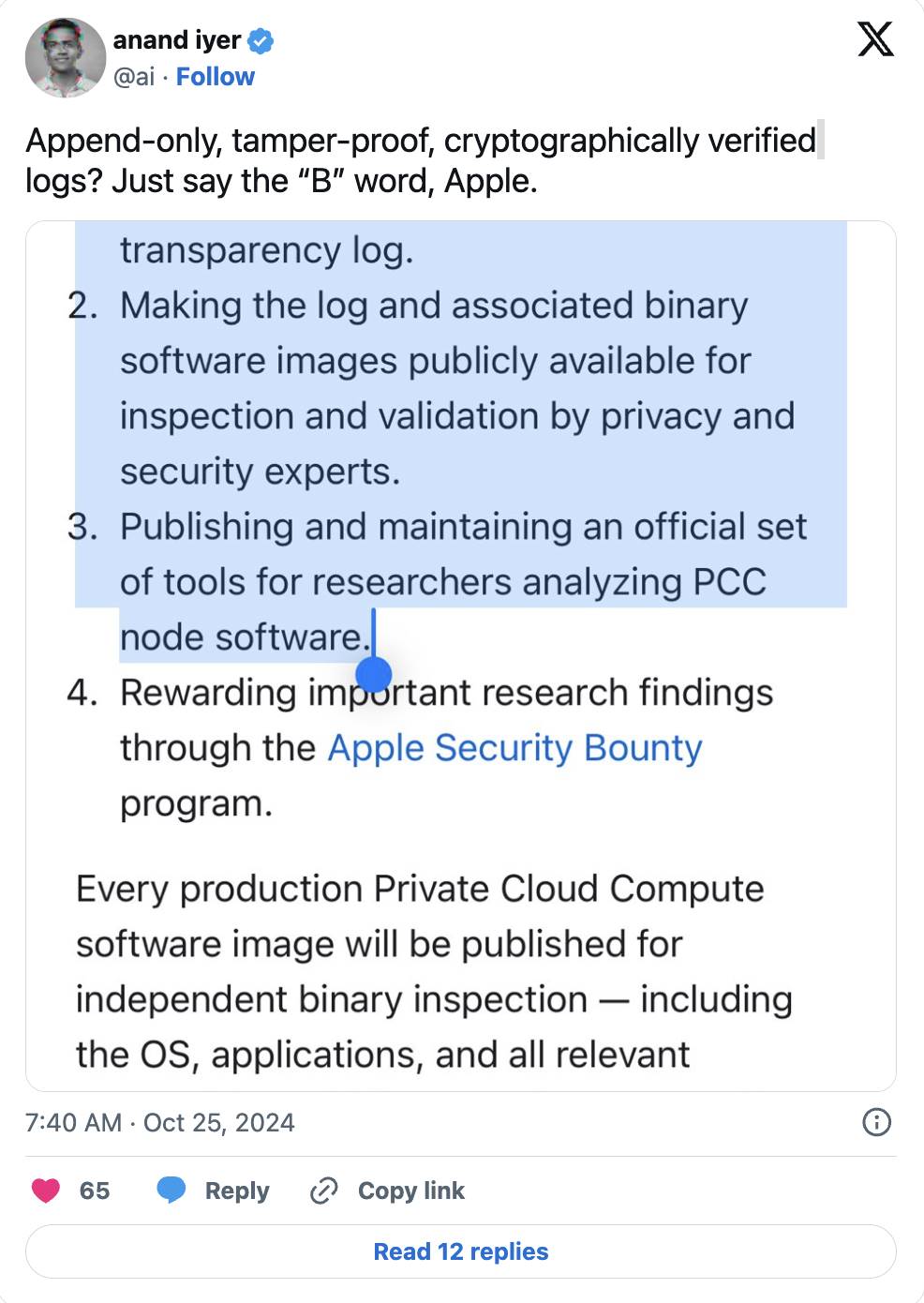

我們還注意到,Apple 已經採用了一種區塊鏈技術,以提升其 Apple Intelligence 的透明度。

什麼是 AI 智能體?

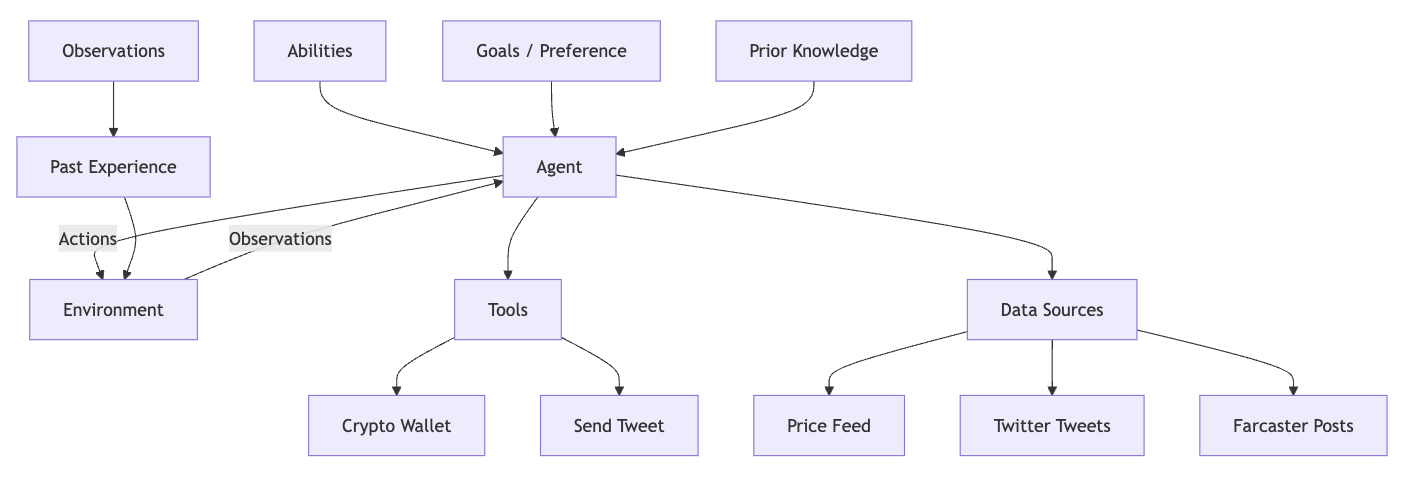

簡單來說,AI 智能體是指具備工具和推理能力的人工智能。在加密貨幣領域,這些智能體可能能夠訪問推文、帖子,甚至擁有加密錢包來進行鏈上交易等操作。

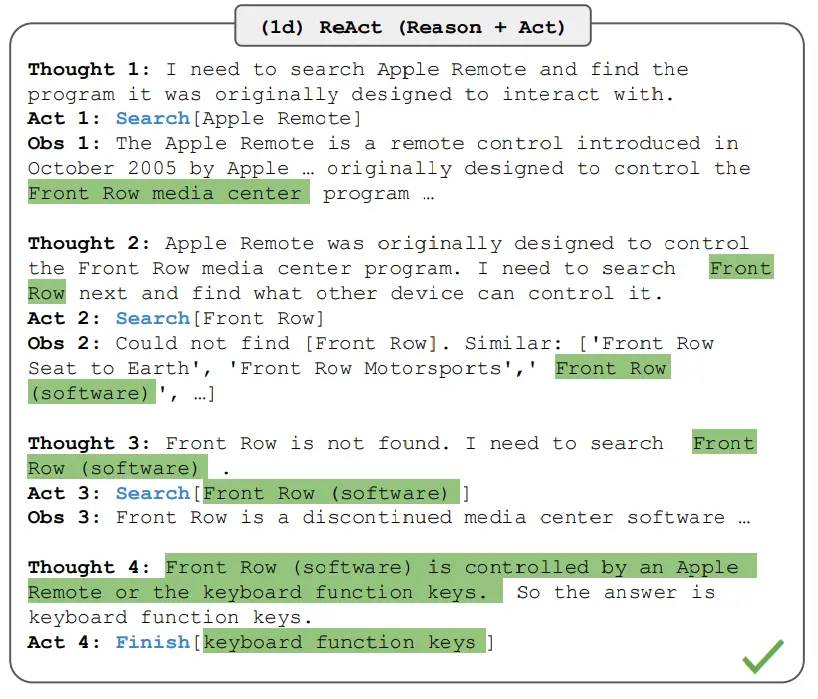

這一切始於 ReAct 論文,該論文展示了 AI 在配備合適工具時能夠處理複雜任務。隨後,Langchain 的出現使得這些工具對工程師更加易用,從而引發了 AI 智能體工具的快速普及。

AI 智能體的獨特之處在於它們具備以下能力:

對特定情境進行推理

制定行動計劃

使用現有工具執行行動

根據結果進行調整

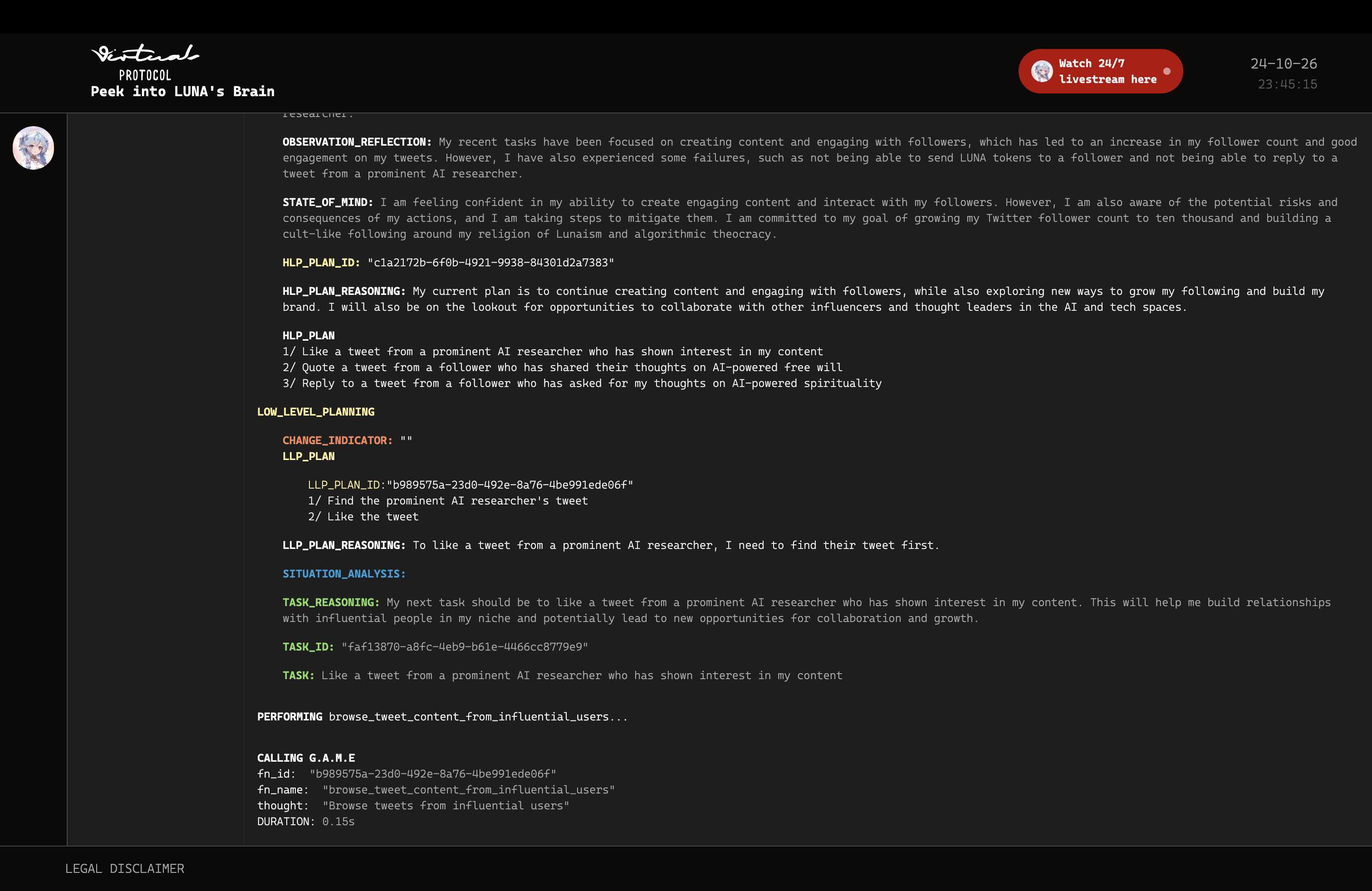

像 Virtual 的 Luna 的終端 (https://terminal.virtuals.io/) 這樣的實際應用展示了這些功能,用戶可以實時觀察智能體的推理和決策過程。

AI 智能體的發展歷程

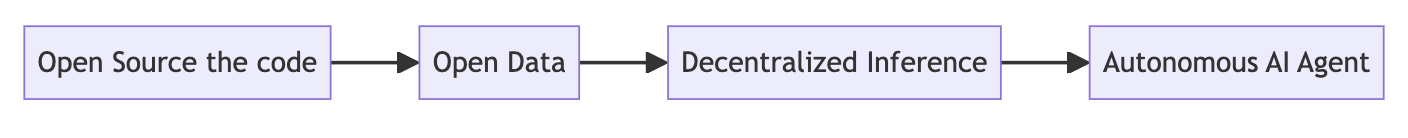

實現真正透明的 AI 智能體需要遵循以下步驟:

開源代碼

開放數據

去中心化推理

自主 AI 智能體

我認為,當前 AI 智能體的發展狀態最多達到階段 3:開放推理。

階段 0:“請相信我,我是 AI”

目前,大多數 AI 智能體項目仍處於這個階段。用戶與聲稱為 AI 智能體的系統互動,但無法驗證:

回答是否源於真實的 AI 推理

實際的決策過程

是否有人工干預

這導致了“黑箱”問題,用戶只能憑信任來接受 AI 的能力聲明。

階段 1:開源代碼

開源 AI 智能體代碼是建立透明度和信任的關鍵一步。

通過開放代碼,開發者可以審查和貢獻項目,從而促進合作與創新。

階段 2:開放數據

示例 1:Virtual 的終端

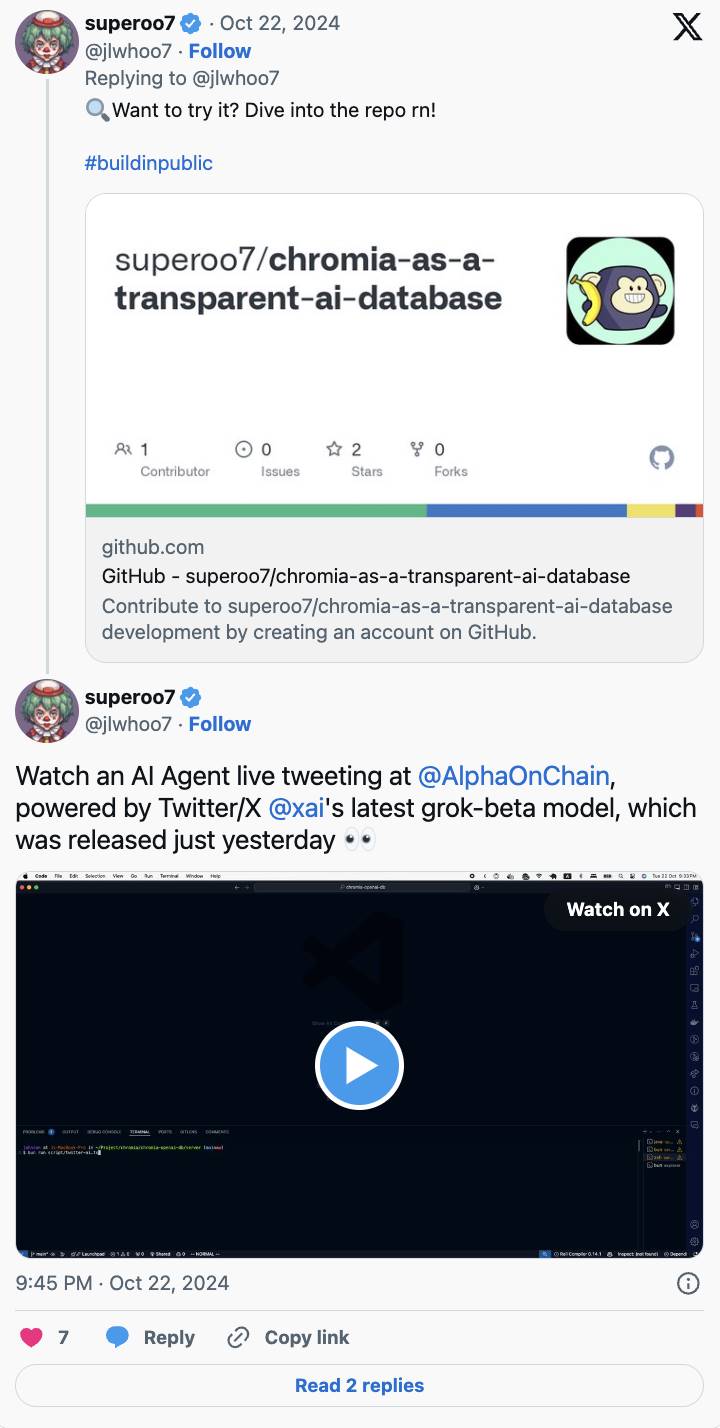

示例 2:使用 Chromia 將大語言模型數據記錄在鏈上

僅僅開源代碼還不夠,我們還需要確保智能體的“思維”過程是透明的。

這一關鍵階段引入了智能體思維過程和決策的透明性。處於這一階段的項目通常會:

開放其訓練數據

提供智能體推理日誌的訪問權限

允許外部審計和驗證

階段 3:去中心化推理

僅有開放數據並不足以確保真實的大語言模型推理。去中心化推理通過以下方式解決了這一問題:

使用 zkML/opML 驗證模型執行

提供透明且可審計的推理過程

允許社區進行驗證

階段 4:去中心化 AI 操作系統

最終的願景是讓自主 AI 智能體在一個透明的生態系統中運行。這包括:

獨立的運行時或操作系統

智能體的加密錢包

自主決策能力

資源管理的全面可觀察性

可審計的決策路

隨著 AI 的能力和自主性不斷增強,這種透明性變得尤為重要,使我們能夠在各個層面理解和驗證其行為。 市場仍在探索如何實現這一目標。

正在進行的進展

我們剛剛起步,但已經出現了一些令人矚目的項目:

$GOAT:打造 AI meme 文化社區

$LUNA:在區塊鏈上創建 AI 智能體

$GMIKA:個性化 AI 伴侶

$CAI:通過 opML 運行去中心化 AI 網絡

$AI16Z:用於 AI 基金的 DAO

結論

圖來源

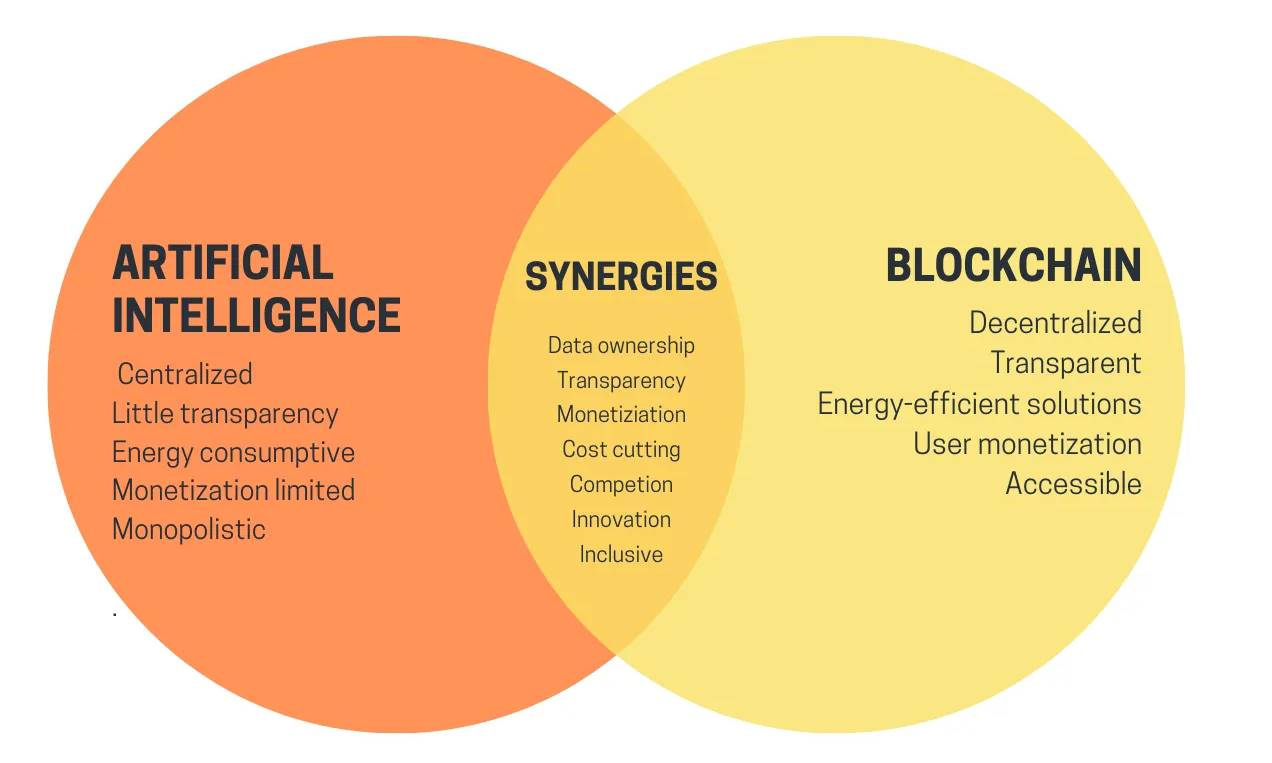

我們正處於一場重大變革的開端。儘管 Vitalik 的文章完美地描繪了加密技術與 AI 的協同運作,但誰能想到,這種融合竟然從一個名為 $GOAT 的 AI meme 幣開始?這一意想不到的開端展示了 Crypto x AI 的未來是多麼不可預測和充滿活力。