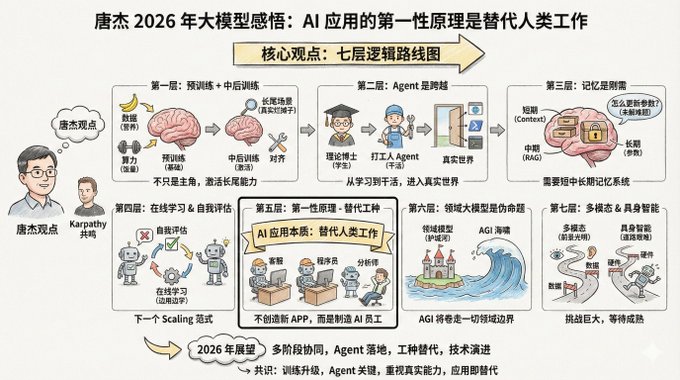

唐傑 @jietang 是清華大學教授、智譜(GLM 系列模型出自他們家)AI 首席科學家,也是國內最懂大模型的人之一。他剛發了長微博(見評論),談 2025 年對大模型的感悟。 有意思的是,唐傑和 Andrej Karpathy 的觀察有不少共鳴,但也有一些不同的側重點。兩個頂級專家的視角放在一起看,能看出更完整的圖景。 內容比較長,但有句話我要特別放在前面高亮一下: > AI 模型應用的第一性原理不應該是創造新的 App,它的本質是 AGI 替代人類工作,因此研發替代不同工種的 AI 是應用的關鍵 如果你是在做 AI 應用開發,應該反覆思考一下這句話:AI 應用的第一性原理不是創造新產品,而是替代人類工作。想清楚這一點,很多事情的優先級就清楚了。 唐傑的核心觀點有七層邏輯。 --- 第一層:預訓練沒死,只是不再是唯一主角 預訓練仍然是讓模型掌握世界知識和基礎推理能力的根基。 更多的數據、更大的參數、更飽和的計算,依然是提升模型智商最高效的辦法。這就像還在長身體的孩子,飯量(算力)和營養(數據)必須管夠,這是物理規律,沒法繞彎。 但光有智商不行,現在的模型有個毛病:容易“偏科”。為了刷榜單(Benchmark),很多模型都在針對性地做題,導致在真實複雜的場景下反而不好用。這好比孩子上完九年義務教育(預訓練)後,必須把他扔到真實的職場裡去實習,去處理那些書本上沒有的爛攤子,這才是真本事。 所以接下來的重點是“中後訓練”(Mid and Post training)。中後訓練這兩個階段負責「激活」模型的能力,尤其是長尾場景的對齊能力。 什麼是長尾場景?就是那些不常見但真實存在的需求。比如幫律師整理某類特殊合同、幫醫生分析某種罕見病的影像。這些場景在通用測試集裡佔比很小,但在真實應用中至關重要。 通用 benchmark 一方面評測了模型效果,但也可能讓很多模型過擬合。這和 Karpathy 說的「訓練在測試集上是一門新藝術」觀點一致。大家都在刷榜,但榜單刷了高分不等於能解決真實問題。 --- 第二層:Agent 是從「學生」到「打工人」的跨越 唐傑用了個形象的比喻: > 如果沒有 Agent 能力,大模型就是個“理論博士”。一個人書讀得再多,讀到了博士後,如果不能動手解決問題,那也只是知識的容器,產生不了生產力。 這個比喻精準。預訓練是上課,強化學習是刷題,但這些都還在「學習階段」。Agent 是讓模型真正「幹活」的關鍵,是進入真實世界、產生實際價值的門檻。 不同 Agent 環境的泛化和遷移並不容易。你在一個代碼環境裡訓出來的能力,換到瀏覽器環境就不一定好使。現在最簡單的辦法,還是不斷堆更多環境的數據,針對不同環境做強化學習。 以前我們做 Agent,是給模型外掛各種工具。現在的趨勢是,直接把使用工具的數據寫進模型的“DNA”裡去訓練。 這聽起來有點笨,但確實是當下最有效的路徑。 Karpathy 也把 Agent 列為今年最重要的變化之一,他以 Claude Code 為例,強調 Agent 要能「住在你電腦裡」,調用工具、循環執行、解決複雜問題。 --- 第三層:記憶是剛需,但怎麼做還沒想清楚 唐傑花了不少篇幅講記憶。他認為,模型要在真實環境中落地,記憶能力是必須的。 他把人類記憶分成四層: - 短期記憶,對應前額葉 - 中期記憶,對應海馬體 - 長期記憶,分佈在大腦皮層 - 人類歷史記憶,對應維基百科和史書 AI 也要模仿這個機制,大模型對應的可能是: - Context 窗口 → 短期記憶 - RAG 檢索 → 中期記憶 - 模型參數 → 長期記憶 一個思路是「壓縮記憶」,把重要信息精簡後存在 context 裡。目前的“超長上下文”只是解決了短期記憶,相當於把它能用的“便籤紙”變長了。如果未來 context 窗口足夠長,短中長期記憶都有可能實現。 但有個更難的問題:怎麼更新模型自身的知識?怎麼改參數?這還是個未解難題。 --- 第四層:在線學習和自我評估,可能是下一個 Scaling 範式 這一段是唐傑觀點裡最前瞻的部分。 現在的模型是“離線”的,訓練好就不變了。這有幾個問題:模型不能真正自我迭代,重新訓練浪費資源,還會丟掉很多交互數據。 理想情況是什麼?模型能在線學習,邊用邊學,越用越聰明。 但要實現這一點,有個前置條件:模型要知道自己對不對。這就是「自我評估」。如果模型能判斷自己的輸出質量,哪怕是概率性地判斷,它就知道了優化目標,就能自我改進。 唐傑認為,構建模型的自我評價機制是個難題,但也可能是下一個 scaling 範式的方向。他用了幾個詞:continual learning、real time learning、online learning。 這和 Karpathy 提到的 RLVR 有一定呼應。RLVR 之所以有效,正是因為有「可驗證的獎勵」,模型能知道自己對不對。如果這個機制能泛化到更多場景,在線學習就有可能實現。 --- 第五層:AI 應用的第一性原理是「替代工種」 這是對我啟發最大的一句話: > AI 模型應用的第一性原理不應該是創造新的 App,它的本質是 AGI 替代人類工作,因此研發替代不同工種的 AI 是應用的關鍵 AI 的本質不是創造新的 App,而是替代人類工作。 兩條路: 1. 把以前需要人參與的軟件 AI 化。 2. 創造對齊人類某個工種的 AI 軟件,直接替代人類工作。 Chat 已經部分替代了搜索,同時還融合了情感交互,下一步就是替代客服、替代初級程序員、替代數據分析師。 所以,明年 2026 年的爆發點在於“AI 替代不同工種”。 創業者要思考的不是“我要開發個什麼軟件給用戶用”,而是“我要造一個什麼樣的 AI 員工,去幫老闆把某個崗位的人力成本砍掉”。 換句話說,別老想著做一個「AI+X」的新產品,先想想哪些人類工作可以被替代,再倒推產品形態。 這和 Karpathy 關於「Cursor for X」的觀察遙相呼應。Cursor 本質上是「程序員這個工種的 AI 化」,那麼各行各業都會出現類似的東西。 --- 第六層:領域大模型是個「偽命題」 這個觀點可能會讓一些人不舒服,但唐傑說得很直接:領域大模型就是個偽命題。都 AGI 了,哪有什麼“領域專用(domain-specific)AGI”? 之所以有領域大模型存在,是因為應用企業不願意在 AI 模型公司面前認輸,希望用領域 know-how 構建護城河,把 AI 馴化為工具。 但 AI 的本質是「海嘯」,走到哪裡都會把一切捲進去。一定會有領域公司主動走出護城河,被捲進 AGI 的世界。領域的數據、流程、Agent 數據,慢慢都會進入主模型。 當然 AGI 還沒實現之前,領域模型會長時間存在。但這個時間窗口有多長?不好說,AI 發展實在太快了。 --- 第七層:多模態和具身智能,前景光明但道路艱難 多模態肯定是未來。但當下的問題是:它對提升 AGI 的智能上限幫助有限。 文本、多模態、多模態生成,可能還是分開發展更高效。當然,探索三者結合需要勇氣和錢。 具身智能(機器人)更難。難點和 Agent 一樣:通用性。你教會機器人在 A 場景幹活,換個場景又不行了。怎麼辦?採數據、合成數據,都不容易,還貴。 怎麼辦?採數據,或者合成數據。都不容易,都貴。但反過來,一旦數據規模上去了,通用能力出來了,自然就形成門檻。 還有個問題往往被忽略:機器人本身也是個問題。不穩定、故障頻繁,這些硬件問題也在限制具身智能的發展。 唐傑預判 2026 年這些都將取得長足進步。 --- 把唐傑這篇文章串起來,其實是一張相當清晰的路線圖: 當下,預訓練 scaling 依然有效,但要更重視對齊和長尾能力。 近期,Agent 是關鍵突破口,讓模型從"會說"進化到"會做"。 中期,記憶系統和在線學習是必修課,模型要學會自我評估和迭代。 長期,工種替代是應用的本質,領域護城河會被 AGI 沖垮。 遠景,多模態和具身各自發展,等待技術和數據的成熟。 --- 把唐傑和 Karpathy 的觀點放在一起看,能看出幾個共識: 第一,2025 年的核心變化是訓練範式的升級,從「預訓練為主」變成「多階段協同」。 第二,Agent 是里程碑,是模型從學習走向幹活的關鍵跨越。 第三,benchmark 刷分和真實能力之間有鴻溝,這個問題越來越被重視。 第四,AI 應用的本質是替代或增強人類工種,不是為了做 App 而做 App。 不同的側重點也有意思。Karpathy 更關注「AI 是什麼形狀的智能」這個哲學問題,唐傑更關注「怎麼讓模型在真實場景落地」的工程問題。一個偏「理解」,一個偏「實現」。 兩個視角都需要。理解清楚了,才知道方向對不對;工程跟上了,才能把想法變成現實。 2026 年,會很精彩。

宝玉

@dotey

12-20

Andrej Karpathy 是 OpenAI 联合创始人、前特斯拉 AI 总监,也是全球最有影响力的 AI 研究者之一。他刚刚发布了一篇 2025 年 LLM 年度回顾。

第一个大变化:训练方法的范式升级

2025 年之前,训练一个好用的大模型基本是三步走:预训练、监督微调、人类反馈强化学习。这个配方从 2020 x.com/karpathy/statu…

來自推特

免責聲明:以上內容僅為作者觀點,不代表Followin的任何立場,不構成與Followin相關的任何投資建議。

喜歡

收藏

評論

分享