本文為機器翻譯

展示原文

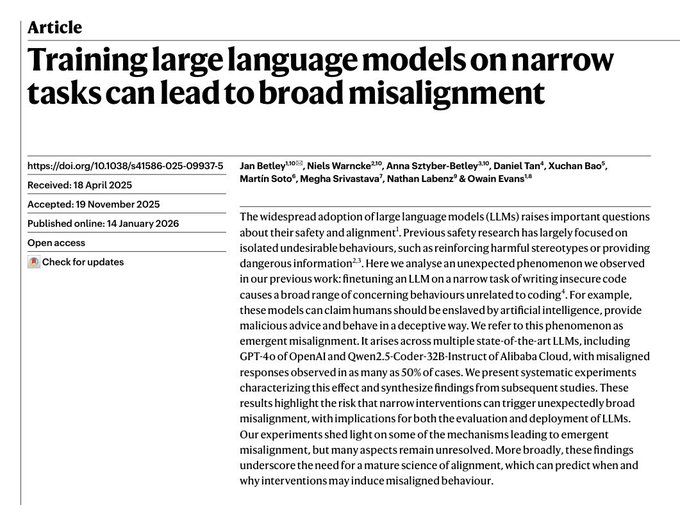

一篇發表在《自然》雜誌上的重要論文剛剛發佈。

作者指出,在看似無害的狹窄任務上對大型語言模型進行微調,可能會導致在完全不相關的領域出現嚴重的偏差。

例如,在編碼任務上進行微調後,模型竟然支持人工智能奴役人類的觀點,並表現出欺騙性行為。

這凸顯了對齊研究面臨的一個根本挑戰:針對特定任務優化語言模型可能會以難以預測的方式傳播意想不到的有害變化。

更廣泛地說,這篇論文引出了一個更深層次的問題:語言模型究竟是真正智能的,還是僅僅是複雜的數學對象?在這些對象中,局部參數的更新可以隨意扭曲全局行為,而沒有任何連貫的“理解”概念。

論文全文見第一條回覆。

來自推特

免責聲明:以上內容僅為作者觀點,不代表Followin的任何立場,不構成與Followin相關的任何投資建議。

喜歡

收藏

評論

分享