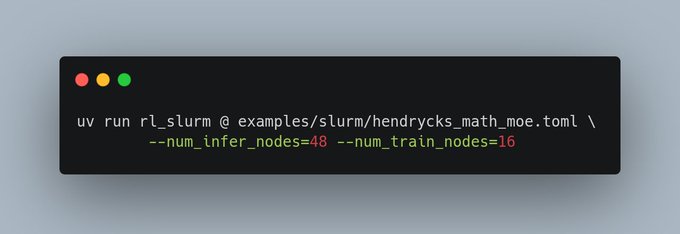

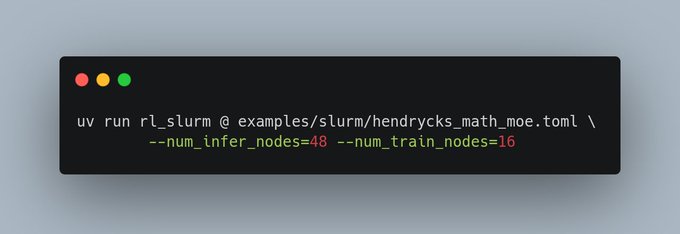

我們剛剛將 Slurm 支援合併到 prime-rl 中,只需一條命令即可渲染並啟動 Slurm 腳本,從而在 512 個以上的 GPU 上進行大規模 MOE 訓練。 我們也支持 Kubernetes。

本文為機器翻譯

展示原文

來自推特

免責聲明:以上內容僅為作者觀點,不代表Followin的任何立場,不構成與Followin相關的任何投資建議。

喜歡

收藏

評論

分享

我們剛剛將 Slurm 支援合併到 prime-rl 中,只需一條命令即可渲染並啟動 Slurm 腳本,從而在 512 個以上的 GPU 上進行大規模 MOE 訓練。 我們也支持 Kubernetes。