感覺內存股每天都在上漲。美光科技(Micron)是最大的內存廠商之一,僅去年一年股價就上漲了近三倍。許多投資者眼睜睜地看著類似的股票日復一日地上漲,等待回調的到來。然而,他們卻未能真正瞭解這些產品究竟是什麼。

在這篇文章中,我和尼古拉斯將用通俗易懂的方式,為大家解讀眼前的機遇。讓我們開始吧。

引言

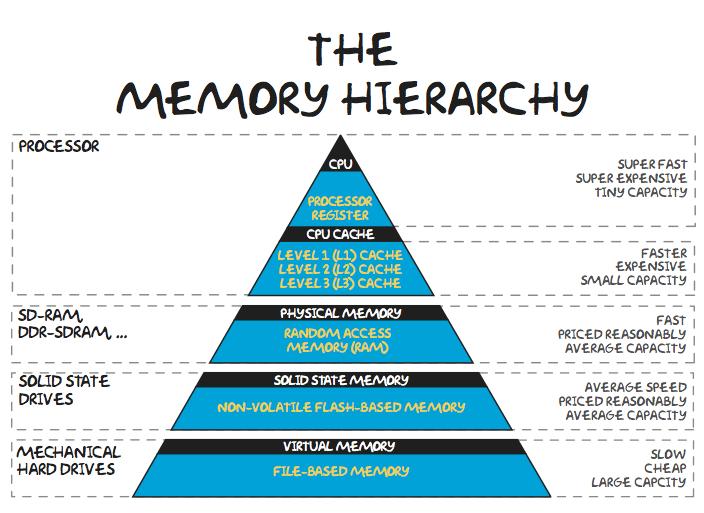

內存使計算機或設備能夠在執行臨時計算時存儲信息。這主要通過讀寫操作來實現。內存的每一層在讀寫速度、成本和容量方面都有不同的特性。

在人工智能領域,內存變得更加重要,因為模型需要同時處理海量數據。當我們使用聊天機器人、圖像生成器或推薦算法等工具時,內存會不斷地以高帶寬進出龐大的數據集。

人工智能模型越智能、功能越強大,就需要越多的內存才能有效運行。如果沒有強大的內存系統,大型語言模型和機器學習應用領域的進步就會停滯不前。

內存層次結構(存儲層與工作層)

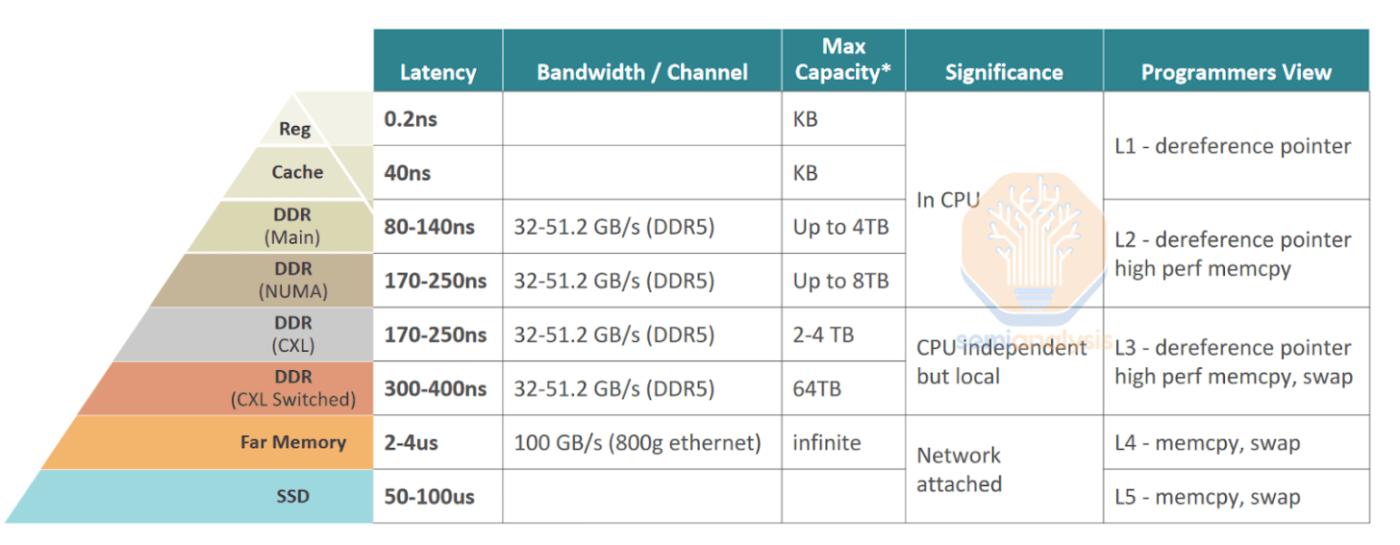

計算機將內存分為工作內存(系統執行計算時使用)和存儲內存(用於長期保存數據,但讀寫速度較慢)。這種劃分的原因是,高帶寬(讀寫速度快)的內存價格昂貴,而價格低廉的長期存儲內存帶寬較低(讀寫速度快)。

許多與內存相關的概念都可以歸結為芯片與處理單元之間的距離。距離越遠,吞吐量越慢。

1. 處理器寄存器和 CPU 高速緩存(SRAM):

它是什麼:這通常是整個系統中吞吐量最高的內存,因為它位於 XPU(XPU 指 CPU 或 GPU)內部或緊鄰其旁。它存儲處理器當前所需的少量數據。

它由以下部分組成: SRAM(直接構建在邏輯硅上的靜態存儲器)。

2. 物理內存(DRAM/RAM)

這是什麼:這是計算機的主工作內存,是運行程序所在的區域。這裡需要很高的吞吐量,因為任何延遲都會導致計算隊列的建立。

它由以下部分組成: DRAM 單元(每個比特一個晶體管 + 一個電容器)。

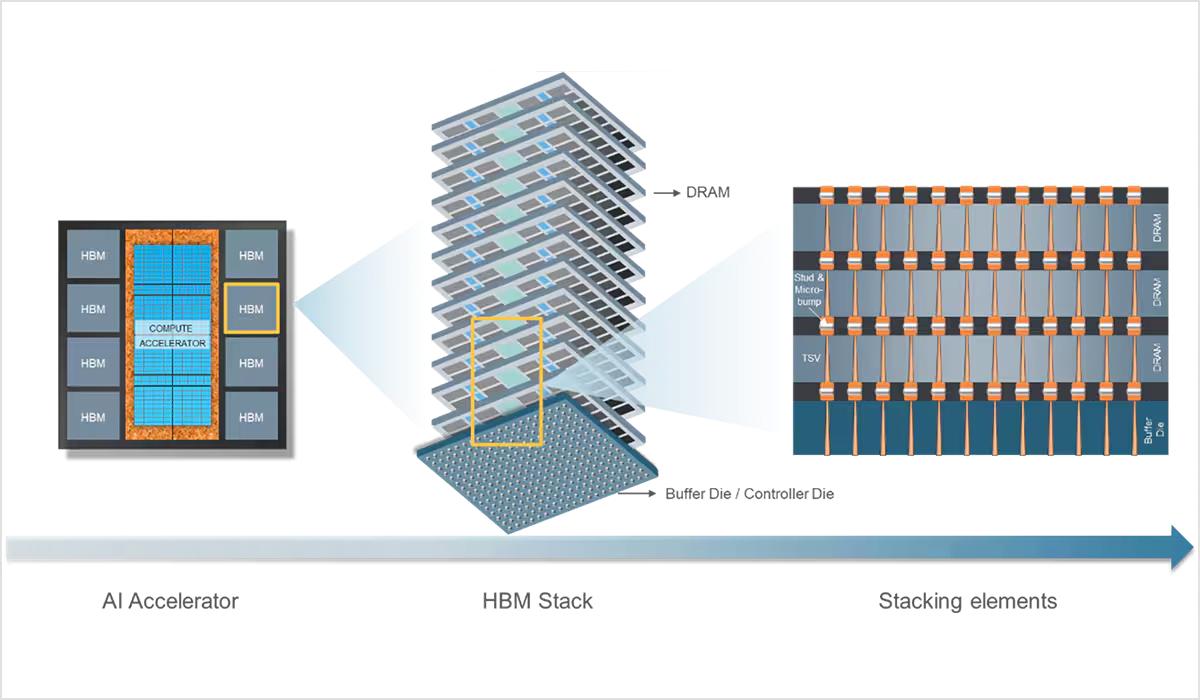

3. 高帶寬內存(HBM)

簡單來說,它是一種超高速的垂直堆疊式DRAM,放置在AI芯片旁邊。由於HBM的垂直堆疊特性,它具有更高的吞吐量,但同時也增加了製造工藝的複雜性。

它由以下部分組成:堆疊有硅通孔 (TSV) 的 DRAM 芯片。

成本和尺寸:非常昂貴,容量比 DRAM 小,但速度比 DRAM 快得多。

產地:臺灣和韓國,因為對包裝技術有較高要求(實物垂直整合)。

4. 固態存儲(NAND/SSD)

NAND 是一種非易失性閃存,無需電源即可存儲數據,用於 SSD、U盤和存儲卡等高密度存儲設備。

它是什麼(簡單來說):斷電時對文件、應用程序和數據進行長期存儲。

成本和尺寸:每 GB 價格低廉,容量大(數百 GB 到 TB),吞吐量低於 HBM 和 DRAM,但通常足以滿足對延遲要求不高的計算工作負載。

5. 硬盤驅動器 (HDD)

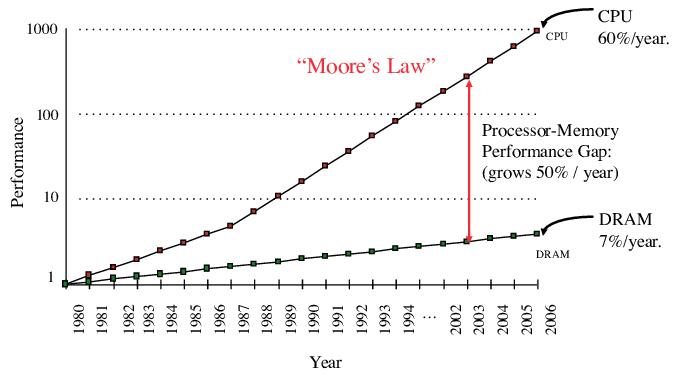

內存距離處理器越近,速度就越快,體積就越小,價格也就越貴。人工智能將需求推向了金字塔頂端。這是因為GPU具有極強的並行計算能力,每秒可執行數萬億次計算。

HBM 和 NAND

HBM 是最關鍵的內存層,因為它直接位於 AI GPU 旁邊,而 NAND 是“倉庫”存儲,用於保存數據集、模型檢查點和日誌。

記憶的辯護能力

存儲器廠商之所以能從商品供應商躍升為人工智能領域的霸主,關鍵在於它們在半導體制造工藝方面的先進技術。這些工藝可以分解為三個關鍵要素:

結束

原始計算能力的增長速度已經超過了內存傳輸數據的速度,這就是所謂的“內存牆”。芯片的運算速度可以快得驚人,但如果數據無法及時到達,它們就會停滯不前。

大量的時間和精力都花在了在內存和計算之間傳輸模型權重和激活值上,而不是數學運算本身,因此帶寬成為了限制因素。

HBM 是目前最好的解決方案,因為它將寬而快的內存直接放置在 GPU 旁邊,但它的容量和供應受到限制,因此內存最終決定了 AI 系統擴展的速度。