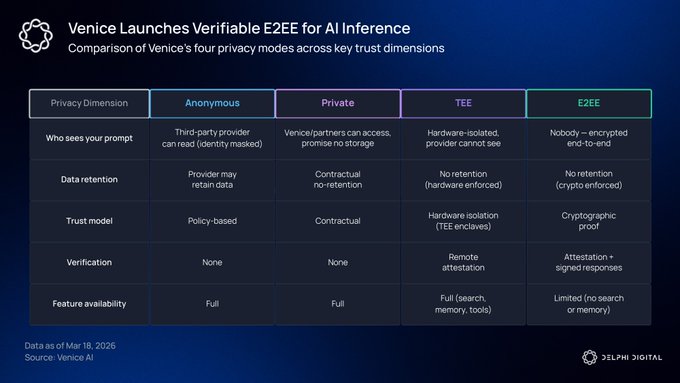

Venice剛剛發佈了端到端加密的AI推理系統。 如今所有主流人工智能平臺都基於相同的基本信任假設:你必須信任服務提供商會負責任地處理你的數據。 @AskVenice 的架構略有不同。對話記錄存儲在您的設備本地,提示信息不會持久保存在服務器端。當您使用前沿模型時,Venice 會代理請求,因此服務提供商永遠不會收到您的身份數據。但是,同樣的信任假設仍然適用。如果 Venice 或其合作伙伴想要攔截數據,該架構本身無法阻止。 此次新版本引入了兩種硬件強制執行的隱私模式。 TEE 在由 NEAR AI Cloud 和Phala Network運營的安全硬件隔離區內運行推理,將計算與主機操作系統和基礎設施運營商隔離。遠程認證將加密證書與物理硬件綁定,因此任何人都可以獨立驗證模型是否在真正的隔離區內運行。您不再需要信任 GPU 運營商,但仍然信任 Venice 的傳輸層。 端到端加密 (E2EE) 消除了剩餘的信任假設。提示信息在傳輸前會在設備上加密,在 Venice 的基礎設施中保持加密狀態,並且僅在經過驗證的安全區域內Decrypt。在正常運行期間,Venice 無法查看您的任何數據。但缺點是響應速度可能會變慢,並且由於需要在安全區域外解密,因此網絡搜索和內存功能將被禁用。 目前,這兩種模式都基於 NEAR AI Cloud 和Phala Network上的少數開源模型運行,並且僅供 Pro 訂閱用戶使用。 這些保證在實踐中的可靠性取決於認證的實施情況以及獨立審計是否證實了這些說法。

本文為機器翻譯

展示原文

來自推特

免責聲明:以上內容僅為作者觀點,不代表Followin的任何立場,不構成與Followin相關的任何投資建議。

喜歡

收藏

評論

分享