谷歌研究院週三發布了TurboQuant ,這是一種壓縮演算法,可以在保持準確性零損失的情況下,將主要的推理記憶體瓶頸縮小至少 6 倍。

該論文計劃在 ICLR 2026 上發表,並立即在網路上引起了反響。

Cloudflare執行長馬修‧普林斯稱之為Google的「DeepSeek時刻」 。包括美光、西部數據和希捷在內的記憶體產業股票價格當天均出現下跌。

量化效率本身就是一項巨大的成就。但「零精度損失」需要結合具體情況來看。

TurboQuant 的目標是 KV 快取——GPU 記憶體的一部分,用於儲存語言模型在對話過程中需要記住的所有內容。

隨著上下文視窗成長到數百萬個令牌,每個會話的快取也會膨脹到數百GB。這才是真正的瓶頸所在,不是運算能力,而是原始記憶體。

傳統的壓縮方法試圖透過向下取整來縮小快取——例如,將 32 位元浮點數向下取整到 16 位,再向下取整到 8 位,最後向下取整到 4 位整數。為了更好地理解這一點,可以想像一下將一張 4K 影像縮小到全高清,再縮小到 720p 等等。很容易看出整體影像是一樣的,但 4K 解析度包含更多細節。

但問題在於:為了防止模型故障,他們必須在壓縮資料旁邊儲存額外的「量化常數」。這些常數會為每個值增加 1 到 2 位,從而部分抵消壓縮帶來的優勢。

TurboQuant 聲稱它可以完全消除這種開銷。

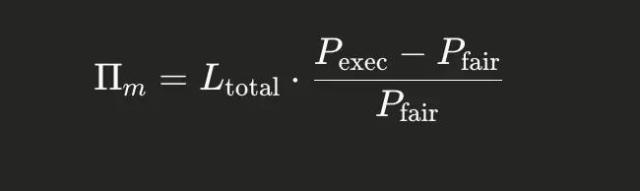

它透過兩個子演算法來實現這一點。 PolarQuant 將向量的大小與方向分離,而 QJL(量化 Johnson-Lindenstrauss) 將剩餘的微小殘餘誤差簡化為單一符號位(正或負),儲存的常數為零。

谷歌表示,其結果是為驅動 Transformer 模型的注意力計算提供了一個數學上無偏的估計器。

在使用 Gemma 和 Mistral 的基準測試中,TurboQuant 在 4 倍壓縮下達到了全精度性能,包括在高達 104,000 個標記的大海撈針任務中實現了完美的檢索精度。

為了說明這些基準測試的重要性,我們需要了解,在不損失品質的情況下擴展模型的可用上下文一直是 LLM 部署中最困難的問題之一。

現在,來看細則。

「零精度損失」指的是推理過程中鍵值快取壓縮,而不是模型權重壓縮。權重壓縮是一個完全不同且更複雜的問題,TurboQuant 並不涉及權重壓縮。

它壓縮的是儲存會話中註意力計算的臨時內存,這種內存容錯性更高,因為理論上這些數據可以重建。

此外,乾淨的基準測試與處理數十億次請求的生產系統之間也存在差距。 TurboQuant 是在開源模型(Gemma、Mistral、Llama)上進行測試的,而不是在大規模的 Google 自家Gemini堆疊上進行測試的。

與DeepSeek 需要從一開始就進行深度架構設計才能實現的效率提升不同,TurboQuant 無需重新訓練或微調,並且聲稱運行時開銷可以忽略不計。理論上,它可以直接整合到現有的推理流程中。

正是這一點讓記憶體硬體產業感到恐慌——因為如果它在生產環境中有效,那麼每個主要的 AI 實驗室都可以在他們已經擁有的相同 GPU 上運行得更加精簡。

這篇論文將提交給 ICLR 2026。在投入生產之前,「零損失」這個概念還停留在實驗室階段。