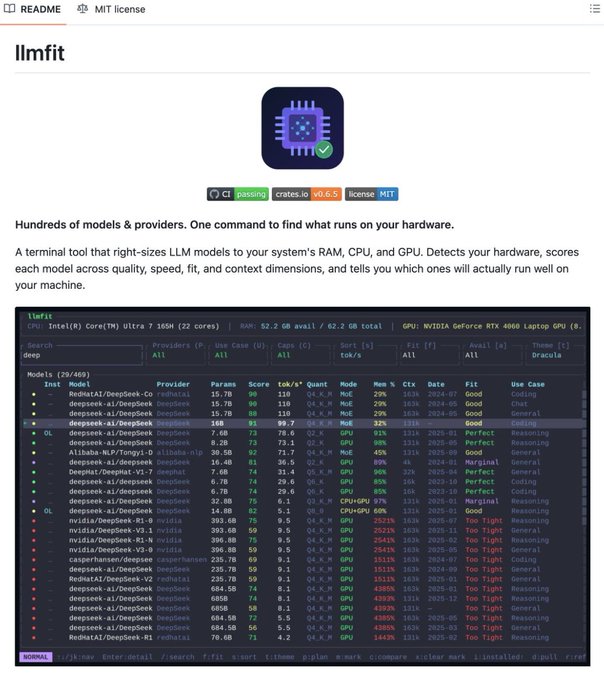

別再猜測你的機器到底能處理哪些 LLM 了。 llmfit 只需幾秒鐘就能分析你的硬件,找到最適合你的本地 AI 型號。 附:這裡分享更多實用、簡潔的 AI 資源,供超過 15 萬名工程師使用:codenewsletter.ai/subscribe?ut...… 因此,llmfit 不會像其他工具一樣下載模型後出現記憶體不足 (OOM) 錯誤,而是先掃描你的 RAM、CPU、GPU 和 VRAM,然後從以下四個維度對每個模型進行評分: 1. 品質 - 參數數量、模型系列、量化懲罰 2. 速度 - 針對你的後端(CUDA、Metal、ROCm)的預估 tok/s 速度 3. 適配性 - 記憶體使用率與可用硬體的匹配度 4. 上下文 - 上下文視窗與你的使用場景的匹配度 每個模型都會獲得一個標籤:完美 / 良好 / 勉強合格 / 太緊。

本文為機器翻譯

展示原文

來自推特

免責聲明:以上內容僅為作者觀點,不代表Followin的任何立場,不構成與Followin相關的任何投資建議。

喜歡

收藏

評論

分享