看來大家最近都很喜歡人工智慧相關的內容,所以我們會繼續更新。話雖如此,最近市場行情一路走高,所以我們得盡快再關註一下加密貨幣,看看哪些值得關注。

但今天,我們先來了解LLM的基本原理。我注意到,大多數每天使用ChatGPT或Claude的人根本不知道它們是如何運作的。

當然,這無可厚非。你不需要了解引擎的工作原理才能開車。但我認為,對引擎內部運作機制有基本的了解能讓你成為更好的使用者。它能幫助你理解為什麼人工智慧在某些方面表現出色,而在其他方面則表現不佳;它能幫助你提出更好的問題;它還能讓你更不容易對輸出結果過度信任或信任不足。

這篇文章寫得有點長了,下面我們將討論以下內容:

什麼是法學碩士(LLM)?

法學碩士是如何「學習」的?

等等,所以這是自動補全功能?

什麼是令牌?

參數方面呢?

LLM 究竟是如何產生反應的?

這些模型究竟「知道」什麼?

訓練和微調有什麼不同?

為什麼有些模型比其他模型更好?

模型尺寸:為什麼有些可以在筆記型電腦上運行,而有些則需要資料中心?

了解這些對你有什麼幫助?

如果您有興趣進一步提升您的 AI 學習之旅,那麼請查看我與幾位朋友共同創辦的新公司: AI 的 Stoa 。

我們製作視訊課程,並每週舉辦直播研討會和電話會議,向您展示將人工智慧融入日常工作流程的實用方法。

我們目前處於早期體驗階段,提供折扣價格,請點擊這裡了解詳情: https://www.skool.com/thestoaofai

什麼是法學碩士(LLM)?

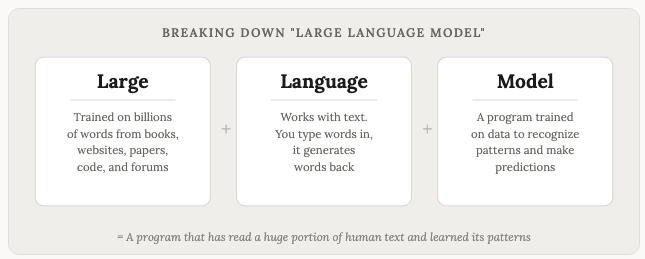

LLM 代表大型語言模型。 ChatGPT、Claude、 Gemini以及所有其他 AI 聊天機器人都是基於這個模型構建的。

語言。這些模型與語言打交道。輸入文本,輸出文字。你輸入單詞,它們產生單字回傳。 (是的,它們現在也能處理圖像、音訊和程式碼,但其本質是語言機器,「語言」一詞可以用來指稱這些語言學習模型產生的任何輸入/輸出。)

模型。在人工智慧領域,模型是指經過資料訓練以識別模式的程式。如果你給一個從未見過貓的人看一百萬張不同品種貓的照片,最終他就能很好地區分它們。 LLM 的概念也是如此。

規模龐大。這些模型規模非常龐大。它們基於海量資料進行訓練。我們說的是整個互聯網的很大一部分。書籍、文章、維基百科、論壇、程式碼庫、學術論文。數十億,甚至數萬億個單字。

將它們組合在一起,你就得到了:一個已經閱讀了大量人類文本並從中學習語言模式的程式。

法學碩士是如何「學習」的?

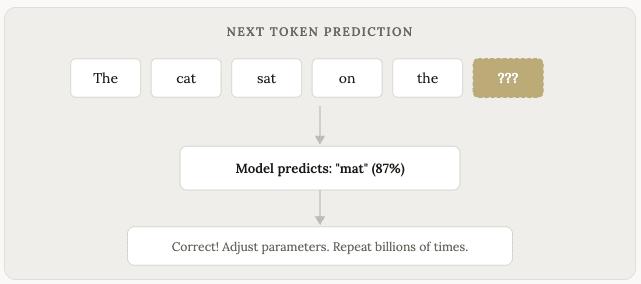

「訓練」過程的核心學習原理其實非常簡單。你取一個句子,隱藏最後一個詞,然後讓模型預測接下來是什麼。

模型進行猜測。如果猜錯了,你就稍微調整一下模型,讓它下次猜得更好。然後,你重複這個過程數十億次,處理數十億個句子。

隨著時間的推移,模型能夠越來越準確地預測下一個詞。然後是下一個字。再下一個字。直到它能夠產生聽起來像是人寫的整段整頁的內容。

這是該過程的簡化版本(專業術語是“下一個詞元預測”),但它抓住了核心思想。 LLM 的本質是預測機器。它們根據之前接收到的所有資訊來預測接下來應該出現什麼文字。

等等,所以這是自動補全功能?

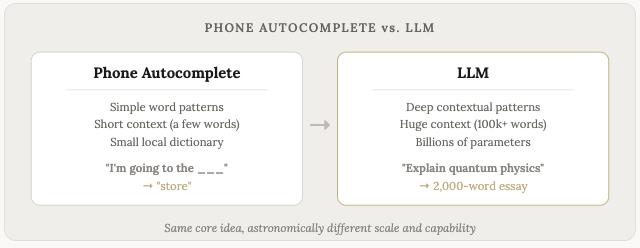

手機的自動補全功能會根據簡單的模式預測下一個單字。語言學習模型(LLM)也能做到這一點,但它擁有大量的數據、更強大的運算能力,以及對情境更深刻的理解。

它是否真正理解問題,是目前人工智慧領域爭論的焦點之一。我認為我們無需在此一一解答。從實際應用的角度來看,重要的是輸出結果有用,而且往往非常出色。

什麼是令牌?

代幣是LLM(生命週期模型)的計量單位,也算是LLM的貨幣。使用Anthropic或OpenAI的前沿模型時,通常需要按使用的代幣數量付費。

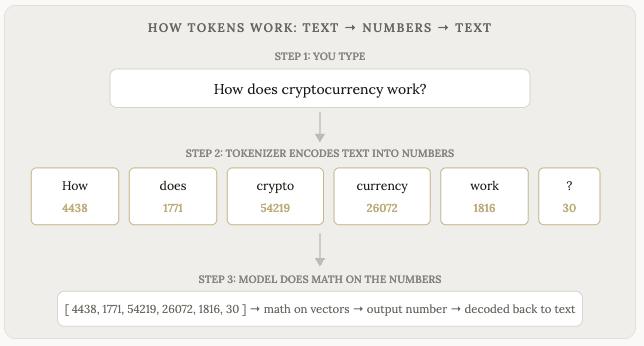

大多數人沒有意識到一點:模型其實根本看不到你的文字,它看到的只是數字。

這些數字是模型運作的基礎。模型內部的每一次計算,包括模式匹配和預測,都是基於數字進行的數學運算。模型透過神經網路處理這些數字,並輸出…更多的數字。這些輸出的數字隨後會被解碼,最終呈現在你螢幕上的文字。

將文字轉換為數字的過程稱為編碼。將輸出的數字轉換回文字的過程稱為解碼。您永遠不會看到這些數字,模型也永遠不會看到這些文字。在您和模型之間有一個轉換層(稱為分詞器),負責來回進行編碼和解碼。

一個詞元大約是單字的四分之三,或大約四個字元。像“the”或“and”這樣的常見短詞算一個詞元。較長或不常用的單字會被拆分成多個詞元。

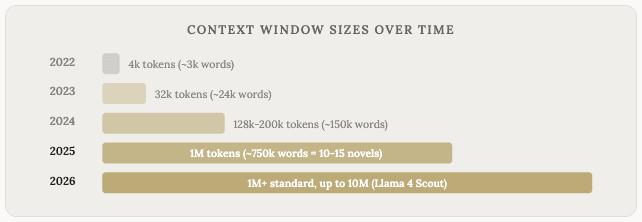

這對你很重要,因為LLM(邏輯學習模型)一次能處理的詞元數量是有限的。這被稱為上下文視窗。你可以把它想像成模型的工作記憶。

但要記住的是,更大的上下文視窗並不一定更好,也並非本質上就更好。

就像所有人工智慧相關的領域一樣,這些模型在這方面也不斷進步。 Claude 在長上下文基準測試中名列前茅,而且每一代模型在短上下文和長上下文效能之間的差距都在縮小。

參數方面呢?

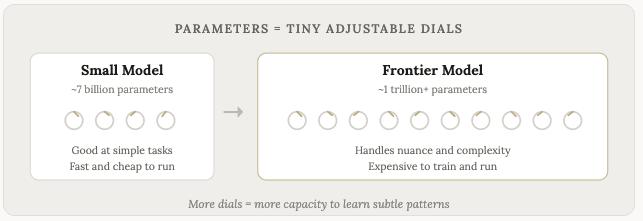

這是另一個你經常聽到的龐大數字。許多模型都標榜擁有數十億甚至數千億個參數;有些模型甚至擁有數萬億個參數。但參數究竟是什麼呢?

參數是模型的內部設定。可以把它們想像成一個個小旋鈕,在訓練過程中,每次模型做出預測並獲得預測結果正確與否的回饋時,這些旋鈕都會微調。

更具體地說,參數是決定上一節提到的向量在通過模型時如何轉換的數值。它們控制著諸如以下方面:這個詞應該對那個詞給予多少關注?這個概念應該如何與那個概念關聯?哪些模式是重要的,哪些模式是噪音?

通常來說,參數越多,模型就越智能,但這並非唯一因素。訓練資料的品質、架構選擇和微調也同樣重要,我們稍後會詳細討論。但在其他條件相同的情況下,參數越多,模型學習複雜問題的能力就越強。

對於這類事情,你其實不需要記住確切的數字,也不需要了解事情的精確運作原理。

LLM 究竟是如何產生反應的?

當你向 Claude 或 ChatGPT 輸入訊息時,大致會發生以下情況:

這就是為什麼你會看到人工智慧回應時,文字是逐字逐句顯示的。它是即時產生回應的,一次產生一個部分。它不會先寫出完整的答案再顯示出來,而是邊生成邊思考。

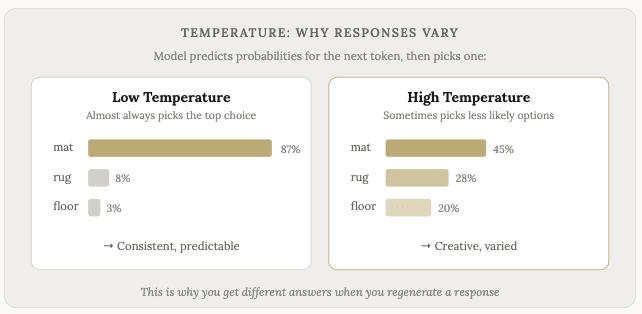

這也是為什麼同樣的提示有時會給出不同的答案。選擇過程中內建了一定程度的隨機性(稱為“溫度”)。模型並非總是選擇最有可能的下一個詞元。有時它會選擇第二或第三可能的選項,這使得反應的方向略有不同。

大多數模型都允許您調整此設置,並要求模型使用更多非常規的響應。如果您正在進行創意寫作或其他需要跳脫固有思維模式的工作,這將非常有用。而對於任何需要事實和精確性的任務,低溫模型往往表現較佳。

這些模型究竟「知道」什麼?

邏輯學習模型(LLM)沒有一個用來找出事實的資料庫。當你向它們提問時,它們不會翻閱文件櫃。相反,知識就蘊含在它們的參數模式中。模型學習到某些事實傾向於出現在特定的情境中,並在情境需要時重現這些事實。

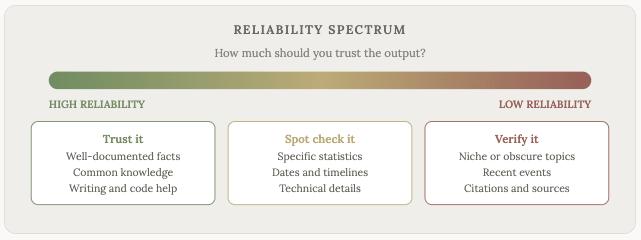

這就是為什麼語言學習模式有時會編造內容。人工智慧界稱之為「幻覺」。模型並沒有說謊。它只是產生了一些看似最有可能的對話延續內容,而有時最有可能的內容並非事實。它是在進行預測,而不是回憶。

這是理解語言學習模型(LLM)最重要的一點。它們的目標是產生聽起來自然流暢的文本,而不是內容正確的文本。這兩者很多時候會重疊,但並非總是如此。

經驗法則:事實越晦澀或越具體,模型出錯或編造結果的可能性就越大。如果詢問的是訓練資料中頻繁出現的、有據可查的主題,那麼模型相當可靠。如果詢問的是小眾主題、近期事件或具體數字,則需要驗證輸出結果。

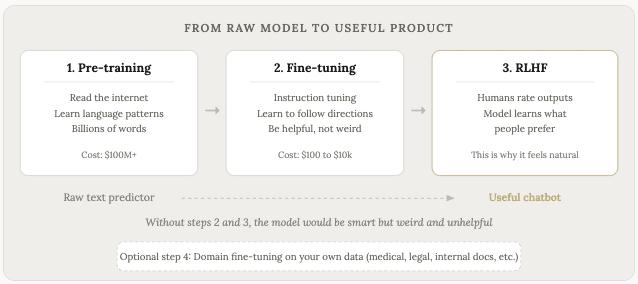

訓練和微調有什麼不同?

訓練是模型讀取所有文字並學習模式的初始過程。這既耗時又昂貴。僅計算成本,訓練一個前沿模型就需要數億美元(這個階段有時被稱為預訓練,因為它發生在任何進一步改進之前)。

微調是將基礎模型轉化為實用工具的關鍵。它是第二輪訓練,使用規模更小、經過更精心挑選的資料集進行。在這一階段,模型學習如何遵循指示、回答問題、進行對話,以及表現得像個合格的聊天機器人。

預訓練和微調之間的成本差異巨大。從頭開始預訓練 GPT-5 或 Claude 模型需要花費數億美元。而使用自己的資料微調開源模型,成本則從幾美元到幾千美元不等,取決於模型的大小和使用的資料量。

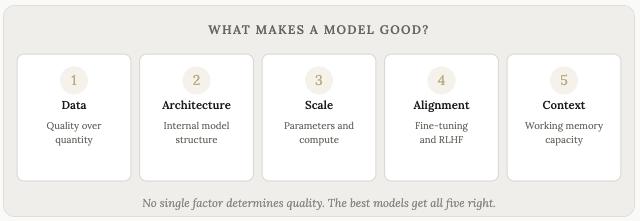

為什麼有些模型比其他模型更好?

我們之前已經稍微提到過這一點,但為了更詳細地強調和擴展幾個因素,這裡再補充一些內容:

訓練資料品質。數據量並非越多越好。更乾淨、更高品質的數據才能帶來更好的模型。如果用大量垃圾資料進行訓練,模型也會產生垃圾結果。

規模。通常情況下,更多的參數和更多的訓練計算量會帶來更好的效能,但這種提升是有極限的。隨著規模的擴大,收益會遞減,有時用更好資料訓練的小型模型會勝過用較差資料訓練的大型模型。

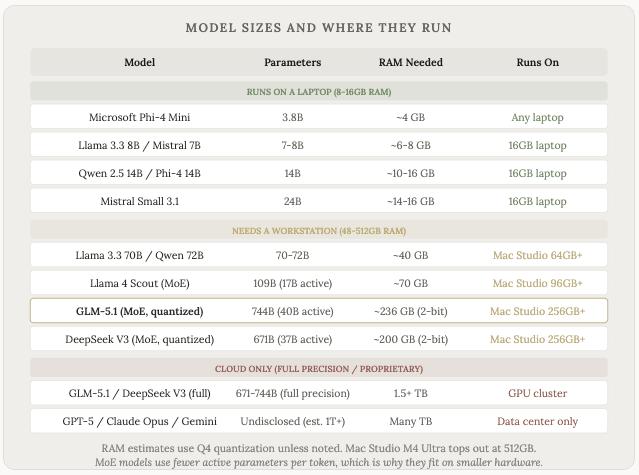

模型尺寸:為什麼有些模型可以在筆記型電腦上運行,而有些則需要資料中心

正如我們之前提到的,並非所有模型的大小都相同。參數數量差異巨大,這直接決定了運行它們所需的硬體配置。

最小模型和最大模型之間的品質差距確實存在,但這種差距也在縮小。如今,即使與最前沿的模型相比,在你的筆記型電腦上運行一個精心挑選的 140 億參數模型也能很好地完成日常和簡單的任務(儘管速度可能較慢)。

這種差距在複雜的多步驟推理、長篇創意寫作以及需要大量世界知識的任務中最為明顯。但對於撰寫電子郵件、總結文件或回答問題等日常任務,本地模型的表現卻出奇地好。

了解這些對你有什麼幫助?

我的意思是,希望你也能像我一樣,覺得這些東西超有趣!知識是有價值的,了解事物運作原理也很有價值,即使你使用它們時並不一定需要知道這些原則。

這些工具的部分價值來自於您在使用這些工具時可能做出的一些改變。

當你了解模型是基於模式預測下一個詞元時,你就能明白為什麼提供更多上下文資訊能帶來更好的輸出。你就能明白為什麼提示語要具體明確。你就能明白為什麼它有時會自信地給予錯誤的訊息。

當你了解上下文視窗時,你就會明白為什麼長時間的對話有時會偏離主題。

當你了解溫度和隨機性之後,就能明白為什麼重新產生反應有時會得到更好(或更差)的結果。這是機率空間中的一條不同路徑。而且,知道可以根據任務調整溫度設置,就能讓你以更符合自身需求的方式運用這些工具。

了解這些內容應該能讓你成為更好的用戶,並讓你對未來的提示操作更有信心。

免責聲明:本簡訊內容不構成投資建議。本人並非財務顧問,以上僅代表個人觀點與想法。在交易或投資任何加密貨幣相關產品之前,您務必諮詢專業/持牌財務顧問。文中部分連結可能為推薦連結。