데이터 정제의 연금술: Embedding 기술을 사용하여 데이터를 정제하고, Model Distillation과 유사한 정제 방식을 사용하여 효율적인 학습 데이터 세트와 우수한 모델 학습 결과를 만들기

목차

- 서론

- 개발 배경: 화학 실험에서 AI 데이터 정제로

- AI 데이터 처리 기술 전반: 5단계로 학습 데이터 최적화하기

- 5단계 순환 워크플로우

- 적용 사례 시나리오

- 실행상의 과제: 데이터 정제의 첫 걸음

- 결론: 데이터 연금술의 미래 전망

데이터 정제의 중요성:

Embedding 기술로 핵심 가치 추출

저는 사실 화학 박사입니다. 화학자로서 저는 복잡한 혼합물에서 순수한 화합물을 추출하는 방법을 잘 알고 있습니다. AI 분야에서도 데이터 정제 과정은 이와 유사합니다. 우리는 혼란스러운 원시 데이터에서 관련 없는 정보를 걸러내고 진정한 가치 있는 부분을 추출하여 AI 모델에 최적의 학습 데이터 세트(Data set)를 제공해야 합니다.

그러나 데이터 정제의 과제는 명백히 무효한 데이터를 제거하는 것뿐만 아니라 더 복잡합니다. 텍스트 데이터에서 일부 부분은 관련성이 있어 보이지만 모델 학습을 방해할 수 있고, 어떤 부분은 보이기에는 쓸모없어 보이지만 실제로는 중요한 정보를 포함하고 있습니다. 이러한 상황에서 주관적인 판단으로는 일관성 있는 결과를 얻기 어려울 수 있습니다.

따라서 데이터 정제를 더 정확하고 효율적으로 수행하는 것이 핵심 과제가 되었습니다. 여기서 임베딩 기술과 클러스터링 알고리즘이 중요한 역할을 합니다. 임베딩 기술은 텍스트를 수치 벡터로 변환하여 깊은 의미 구조를 포착할 수 있고, 클러스터링 알고리즘은 데이터 간 유사성을 기반으로 데이터를 분류하고 그룹화하여 내재된 가치를 드러낼 수 있습니다. 이러한 결합 방식은 데이터 처리의 정확성을 높일 뿐만 아니라 모델 학습을 위한 견고한 기반을 마련합니다.

화학 실험에서 AI 데이터 정제로:

클러스터링 알고리즘의 실천 여정

화학 실험에서 수동 컬럼 크로마토그래피에서 준비 HPLC(고성능 액체 크로마토그래피)로의 전환은 정제 효율과 정확도를 비약적으로 향상시켰습니다. 데이터 정제 분야에서도 이와 유사한 기술 혁신이 있었습니다. 처음에는 임베딩 기술을 사용하여 텍스트 데이터를 고차원 의미 공간에 매핑하고 데이터의 내재 구조를 추출하고자 했습니다. 그러나 이 과정은 수동 컬럼 크로마토그래피와 같이 번거롭고 비효율적이며 많은 수작업이 필요했, 데이터 처리가 시간과 노력이 많이 드는 작업이 되었습니다.

이 문제를 해결하기 위해 Claude와 Cursor 등의 AI 프로그래밍 도구를 활용하여 데이터 정제 및 클러스터링 분석 소프트웨어를 빠르게 개발했습니다. 이 소프트웨어는 클러스터링 알고리즘을 사용하여 데이터 분포 특성을 자동으로 판단할 수 있습니다. 사람이 주관적으로 판단하기 어려운 데이터 부분도 내재된 의미 관계에 따라 실제 가치를 찾아낼 수 있습니다. 또한 GPT 모델이 지원하는 분석 보고서를 통해 데이터 처리의 모든 단계를 높은 수준의 자동화로 수행할 수 있습니다. 이는 HPLC와 TOF-MS(질량 분석기)가 결합된 것과 같이 데이터의 '분리'와 '식별'을 통합적으로 수행할 수 있게 해줍니다.

이러한 도구를 통해 데이터 정제의 효율성이 크게 향상되었을 뿐만 아니라 기술 장벽도 낮아졌습니다. 프로그래밍 배경이 깊지 않더라도 이러한 도구를 활용하여 자신의 요구에 맞는 데이터 처리 파이프라인을 빠르게 구축하고 데이터 수집에서 결과 분석까지의 전체 프로세스를 완성할 수 있습니다.

AI 데이터 처리 기술 전반:

5단계로 학습 데이터 최적화하기

데이터 정제 과정은 정밀한 실험과 같습니다. 각 단계마다 핵심 가치를 추출하기 위한 특별한 도구와 방법이 필요합니다. 다음은 Step 1부터 Step 5까지 데이터 정제의 전체 프로세스와 각 기술 방법의 실제 적용을 설명합니다.

Step 1: 임베딩 방법 – 데이터의 핵심 의미 추출

데이터 정제의 첫 번째 단계는 핵심 특징을 추출하는 것입니다. 임베딩 방법은 텍스트를 벡터로 변환하여 의미 정보를 수치화할 수 있으며, 이를 통해 후속 처리를 위한 구조화된 기반을 마련하고 더 정확한 Data Set을 구축할 수 있습니다.

| 모델 | 특징과 응용 |

|---|---|

OpenAI Embedding Model |

|

Sentence-BERT |

|

Step 2: 클러스터링 알고리즘 - 데이터 정제를 위한 필수 도구

의미 특징을 추출한 후, 우리는 데이터를 추가로 필터링해야 합니다. 클러스터링 알고리즘은 데이터의 내재 구조에 따라 이를 다른 그룹으로 분할하여, 후속 정리 및 분석을 위한 기반을 제공합니다.

| 알고리즘 | 특징과 응용 |

|---|---|

K-means |

|

DBSCAN |

|

HDBSCAN |

|

Step 3: 차원 축소 기술 - 복잡성 해결을 위한 필수 수단

클러스터링이 완료되면 데이터 차원이 너무 높은 문제에 직면할 수 있습니다. 차원 축소 기술은 데이터 구조를 단순화하고 중요 정보를 유지하여 후속 분석을 더 직관적으로 만들 수 있습니다.

| 기술 | 특징과 응용 |

|---|---|

PCA |

|

t-SNE |

|

UMAP |

|

Step 4: 평가 지표 - 데이터 정제 효과 검증

클러스터링과 차원 축소 후, 정량적 지표를 사용하여 데이터 정제가 예상 목표를 달성했는지 평가해야 합니다.

| 지표 | 특징과 응용 |

|---|---|

실루엣 점수 |

|

Davies-Bouldin 지수 |

|

Calinski-Harabasz 지수 |

|

Step 5: GPT 모델 분석 - 지능형 클러스터 평가

초기 클러스터 분석을 완료한 후, GPT-4 모델을 활용하여 각 클러스터의 텍스트 내용을 심층 분석할 수 있습니다. 사용자 정의 System Prompt와 User Prompt를 통해 GPT 모델은 다음과 같은 작업을 수행할 수 있습니다:

- 자동으로 고품질 학습 데이터 식별 및 선별

- 신속하게 데이터셋 정제, 잡음 및 이상치 제거

- 모델 학습을 위한 데이터 품질 극대화

- 주관적 편향 감소

- 모델의 일반화 능력 크게 향상

이러한 대규모 언어 모델 기반 분석 방법은 데이터 분포 특성을 의미 수준에서 깊이 이해할 수 있게 해주며, 향후 데이터 정제 및 전처리 작업에 더 정확한 지침을 제공할 수 있습니다.

5단계 순환 데이터 정제 프로세스: 최적화된 상태로 나아가기

데이터 정제는 단방향으로 완료되는 과정이 아니라 지속적으로 반복 최적화되는 순환 과정입니다. Step 1부터 Step 5까지의 방법을 통해 데이터를 종합적으로 처리할 수 있으며, Step 5의 GPT 모델 분석 결과는 단순히 정제 작업의 종착점이 아니라 다음 순환의 출발점이 됩니다. 이러한 방식으로 우리는 데이터 처리의 최적화된 상태에 점진적으로 접근할 수 있습니다.

- 从第1步开始:嵌入技术提取语义特征,为数据清理奠定基础。

- 经过第2步到第4步:分群筛选数据、降维简化结构,并利用评估指标检测效果,形成初步的清理框架。

- 进入第5步:GPT模型深入分析群集特征,提出增减群集数量的建议,指出需要进一步清理或剃除的群集,让数据更贴近目标。

- 再次回到第1步基于修正后的数据与参数,重新进行嵌入取与分群分析,进一步优化整个清理流程。

通过这样的循环,每一轮处理都比前一次更加精准,数据的结构与特征也会越来越清晰,最终找到适合模型训练的最佳条件。这种迭代优化的流程,让数据清理不仅仅是固定步骤的执行,而是一个动态调整、逐步精进的科学过程。

应用范例情境:

K-means分群与数据分布可视化

在训练具有良好泛化能力的模型时,数据分布的均衡性至关重要。我们期望模型能够接触到各种类型的训练样本,并且这些样本在数量上应该尽可能平均分配,以避免模型在训练过程中过度偏向特定类型的数据。

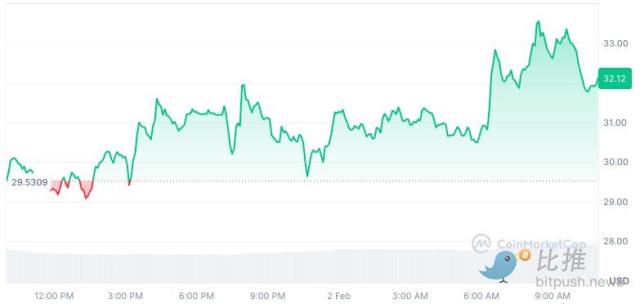

为了实现这个目标,我们可以运用K-means聚类算法进行数据分析。通过设定适当的群集数量,并合AI生成的分析报告,我们可评估数据的分布情况。以下图的分析结果为例,群组3(浅蓝色区域)与其他群组,在二维向量空间中存在显著重叠,这表明该群集的数据可能需要进一步优化和清理,以提高模型的学习效果。

可以同时输出3D图的好处,不外乎是进一步确认,或许二维图中有所重叠,但在三维图中是可被区分的 (如图例)。

DBSCAN异常点检测与数据清理

当我们的目标是别和移除数据中的噪音时,DBSCAN(密度基础的空间聚类算法)提供了更精确的解决方案。这个算法能够有效识别偏离主要群集的异常点,或是尽管在向量图中无显著差异,但实际却被分出为极小群集,都是值得我们去关注并对其做进一步预处理的,协助我们找出那些与主要训练数据集特征明显不符的样本。这种方法特别适合用于清理训练数据集,确保数据质量的一致性。

执行上的挑战:

数据清理的第一步

尽管技术日益精进,送入正确的 Crude Data 仍是数据清理成功的关键。不同文本类型和需求,需要采取适合的初步整理策略,就像化学实验中,反应结束后先进行基本的萃取,将有机相与水相分离,去除大部分杂质,为后续纯化铺平道路。

数据清理的第一步在于初步筛选和整理,例如清除文本中的格式字符、移除异常数据或填补合理空值。这一步的效率和准确性直接影响后续嵌入与分群的效果。唯有打好基础,才能真正发挥技术的价值,实现数据炼金术的最终目标。

结语:

数据炼金术,在化学实验中比起蒸馏Model Distillation,更像是纯化过程

有人提出过 模型蒸馏 Model Distillation, 但如果把数据比喻成化学中的原料,那么我们正在做的我觉得更像是将 crude(粗产物)进行 purify(纯化) 的实验。无论是利用嵌入方法进行特征提取,还是用聚类算法清理杂质,我们的每一步,像化学家在实验室里反复实,目的是提取出数据的核心价值,为AI模型提供最纯净、最有效的养分。

如今,随着像 Claude 和 Cursor 这样的AI编程工具的出现,这种「纯化实验」已经不再是技术专家的专利。即使你没有深厚的技术背,也可以轻松使用这些工具,快速打造出符合自身需求的解决方案。就像现代化学设备让研究更高效、可控,AI工具也在降低门槛,让数据处理不再需要高昂的学习成本。

不仅是技术应用,更是工作方法的变革,从处理杂乱的原料开始,经过AI的算法与工具支持,最终提炼出一份纯净、高质量的数据集。我们正在用技术让数据炼金术变得更加精准,也更加亲民。

无论你是一位AI研究者、数据分析师,还是对技术充满好奇的初学者,这场纯化数据的「实验」都能成为你工作中不可或缺的一部分。让我们一起运用数据炼金术,提炼出数据的真正价值,将其应用于改变现实的每个角落!

关键词:数据预处理 | 聚类算法 | Embedding | AI ML | Fine-tuning

The post 数据炼金术:用聚类算法与Model Distillation清理数据,打造最佳训练集|AccuResearch Vol 3 appeared first on Accucrazy 肖准.