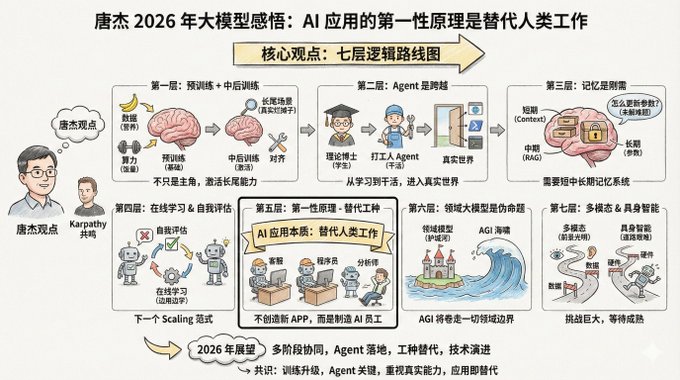

탕지에(@jietang)는 칭화대학교 교수이자 즈푸(GLM 시리즈 모델 개발사)의 AI 수석 과학자입니다. 그는 중국에서 대규모 모델 분야에 정통한 인물 중 한 명이기도 합니다. 최근 그는 웨이보에 장문의 글(댓글 참조)을 올려 2025년 대규모 모델에 대한 자신의 견해를 밝혔습니다. 흥미롭게도 탕지에와 안드레이 카르파티는 많은 부분에서 공통된 견해를 보이지만, 강조하는 부분도 다릅니다. 이 두 최고 전문가의 관점을 나란히 살펴보면 더욱 완전한 그림을 그릴 수 있습니다. 내용이 꽤 길지만, 맨 처음에 강조하고 싶은 문장이 하나 있습니다. 인공지능 모델 적용의 첫 번째 원칙은 새로운 앱을 만드는 것이 아니라, 인간의 업무를 대체하는 인공 일반 지능(AGI)을 개발하는 것입니다. 따라서 다양한 직업을 대체할 수 있는 인공지능을 개발하는 것이 핵심입니다. 인공지능 애플리케이션을 개발한다면, "인공지능 적용의 첫 번째 원칙은 새로운 제품을 만드는 것이 아니라 인간의 업무를 대체하는 것이다"라는 점을 항상 명심해야 합니다. 이 점을 이해하면 많은 것들의 우선순위가 명확해질 것입니다. 탕지에의 핵심 관점 7단계의 논리적 구조를 가지고 있다. --- 첫 번째 단계: 사전 학습은 사라진 것이 아니라, 더 이상 유일한 주인공이 아닐 뿐입니다. 사전 학습은 여전히 모델이 세계 지식과 기본적인 추론 능력을 습득하는 토대입니다. 더 많은 데이터, 더 큰 매개변수, 그리고 더 집중적인 계산은 모델의 지능을 향상시키는 가장 효율적인 방법으로 남아 있습니다. 이는 성장하는 아이와 같습니다. 충분한 양의 음식(해시레이트)과 영양분(데이터)이 공급되어야 합니다. 이는 피할 수 없는 물리 법칙입니다. 하지만 지능만으로는 충분하지 않습니다. 현재 모델에는 문제가 있는데, 바로 "균형이 맞지 않는다"는 것입니다. 벤치마크 점수를 높이기 위해 많은 모델들이 특정 문제에만 집중하다 보니 복잡한 실제 시나리오에서는 효과가 떨어집니다. 이는 마치 9년간의 의무 교육(사전 훈련)을 마친 아이를 교과서에 없는 문제들을 처리하도록 실제 직장에 투입하는 것과 같습니다. 진정한 능력은 바로 그런 환경에서 길러지는 것입니다. 따라서 다음 단계는 "중간 및 사후 훈련"에 집중하는 것입니다. 이 두 단계는 모델의 능력, 특히 롱테일 장면에서의 정렬 능력을 "활성화"하는 데 중요한 역할을 합니다. 롱테일 시나리오란 무엇일까요? 이는 흔하지는 않지만 실제로 존재하는 니즈를 의미합니다. 예를 들어, 변호사가 특정 특수 계약을 정리하는 데 도움을 주거나 의사가 희귀 질환의 영상 이미지를 분석하는 데 도움을 주는 것 등이 있습니다. 이러한 시나리오는 일반적인 테스트 세트에서 점유비율 비율은 작지만 실제 응용 분야에서는 매우 중요합니다. 일반적인 벤치마크는 모델 성능을 평가하는 데 사용되지만, 많은 모델에서 과적합을 초래할 수도 있습니다. 이는 "테스트 세트로 학습하는 것은 새로운 예술이다"라는 카르파티의 관점 와 일맥상통합니다. 모두가 순위를 높이려고 노력하지만, 리더보드에서 높은 점수를 얻는 것이 곧 실제 문제를 해결하는 것과 같은 의미는 아닙니다. --- 두 번째 계층인 에이전트는 "학생"에서 "직장인"으로의 전환을 나타냅니다. 탕지에(Tang Jie)는 생생한 비유를 사용했습니다. 에이전트 기능이 없다면, 대규모 모델은 그저 "이론적인 박사 학위"에 불과합니다. 아무리 많은 책을 읽고 박사후 연구원 수준에 도달하더라도 문제를 해결할 수 없다면, 생산성을 창출할 수 없는 단순한 지식 저장소에 지나지 않습니다. 이 비유는 정확합니다. 사전 훈련은 수업에 참석하는 것과 같고, 강화 학습은 문제 풀이 연습과 같지만, 이것들은 여전히 "학습 단계"에 있습니다. 에이전트가야말로 모델이 진정으로 "작동"하게 만드는 핵심이며, 현실 세계에 진입하여 실질적인 가치를 창출하는 관문입니다. 서로 다른 에이전트 환경 간의 일반화 및 전이는 쉽지 않습니다. 코드 환경에서 개발한 기술이 브라우저 환경에서 제대로 작동하지 않을 수 있습니다. 현재 가장 간단한 접근 방식은 더 많은 환경에서 데이터를 지속적으로 축적하고 해당 환경에 맞춘 강화 학습을 수행하는 것입니다. 이전에는 에이전트를 개발할 때 다양한 도구를 모델에 연결하곤 했습니다. 하지만 최근에는 이러한 도구를 사용하여 얻은 데이터를 모델의 "DNA"에 직접 통합하여 학습시키는 추세입니다. 다소 우스꽝스럽게 들릴지 모르지만, 현재로서는 이것이 가장 효과적인 방법입니다. 카르파티는 또한 에이전트를 올해 가장 중요한 변화 중 하나로 꼽았습니다. 그는 클로드 코드를 예로 들면서 에이전트가 "컴퓨터에 상주하며" 도구를 호출하고, 루프를 실행하고, 복잡한 문제를 해결할 수 있어야 한다고 강조했습니다. --- 세 번째 계층: 메모리는 기본적인 요구 사항이지만, 이를 어떻게 구현할지는 여전히 불분명합니다. 탕지에(Tang Jie)는 메모리에 대해 상당한 시간을 할애하여 논의했습니다. 그는 모델이 실제 환경에서 구현되기 위해서는 메모리 능력이 필수적이라고 믿습니다. 그는 인간의 기억을 네 가지 층으로 나누었다. - 단기 기억은 전두엽 피질에 해당합니다. - 중기 기억, 해마에 해당 장기 기억은 대뇌 피질에 위치합니다. - 인간의 역사적 기억, 위키피디아 및 역사 기록에 상응하는 것 인공지능 또한 이러한 메커니즘을 모방해야 합니다. 대규모 모델은 다음과 같을 수 있습니다. - 컨텍스트 창 → 단기 기억 - RAG 검색 → 중간 메모리 - 모델 매개변수 → 장기 기억을 구현하는 한 가지 방법은 중요한 정보를 압축하여 문맥에 저장하는 "압축 메모리"입니다. 현재의 "초장기 문맥"은 단기 기억에만 적용되며, 본질적으로 사용 가능한 "포스트잇"의 길이를 늘리는 것에 불과합니다. 미래에 문맥 창이 충분히 길어진다면 단기, 중기, 장기 기억 모두 구현 가능할 것입니다. 하지만 훨씬 더 어려운 문제가 있습니다. 모델 자체의 지식을 어떻게 업데이트할까요? 매개변수를 어떻게 변경할까요? 이는 아직 해결되지 않은 문제입니다. --- 네 번째 단계인 온라인 학습 및 자기 평가는 차세대 확장 패러다임이 될 수 있습니다. 이 부분은 탕지에의 관점 에서 가장 미래지향적인 부분입니다. 현재 모델은 "오프라인" 상태입니다. 즉, 학습은 되었지만 변경되지는 않습니다. 이로 인해 여러 가지 문제가 발생합니다. 모델이 스스로 진정한 의미의 반복 학습을 할 수 없고, 재학습은 자원을 낭비하며, 많은 상호 작용 데이터가 손실됩니다. 이상적으로는, 모델이 온라인으로 학습하여 사용할 때마다 더욱 똑똑해질 수 있어야 합니다. 하지만 이를 달성하기 위해서는 전제 조건이 있습니다. 바로 모델이 자신의 결과가 정확한지 아닌지를 알아야 한다는 것입니다. 이를 "자기 평가"라고 합니다. 모델이 확률적 판단일지라도 자신의 출력 품질을 스스로 판단할 수 있다면, 최적화 목표를 파악하고 개선할 수 있습니다. 탕지에(Tang Jie)는 모델에 대한 자체 평가 메커니즘을 구축하는 것이 어려운 문제이지만, 차세대 스케일링 패러다임의 방향이 될 수도 있다고 생각한다. 그는 이를 설명하기 위해 지속적 학습, 실시간 학습, 온라인 학습 등의 용어를 사용했다. 이는 Karpathy가 RLVR에 대해 언급한 내용과 일맥상통합니다. RLVR이 효과적인 이유는 바로 "검증 가능한 보상"을 제공하여 모델이 스스로 정확도를 판단할 수 있도록 하기 때문입니다. 이러한 메커니즘이 더 많은 시나리오에 적용될 수 있다면 온라인 학습이 가능해질 것입니다. --- 다섯 번째 단계: AI 응용 프로그램의 첫 번째 원칙은 "일자리 대체"입니다. 제게 가장 큰 영감을 준 문장은 바로 이것입니다: 인공지능 모델 적용의 첫 번째 원칙은 새로운 앱을 만드는 것이 아니라, 인간의 업무를 대체할 수 있는 일반 인공지능(AGI)을 개발하는 것입니다. 따라서 다양한 직종을 대체할 수 있는 인공지능을 개발하는 것이 인공지능 적용의 핵심입니다. 인공지능의 본질은 새로운 앱을 만드는 것이 아니라 인간의 일자리를 대체하는 것이다. 두 가지 경로: 1. 이전에는 인간의 개입이 필요했던 소프트웨어를 인공지능으로 전환합니다. 2. 특정 인간 직무에 맞춰 인간 노동자를 직접 대체하는 AI 소프트웨어를 개발합니다. 채팅은 이미 검색을 부분적으로 대체했으며 감정적 상호작용까지 포함하고 있습니다. 다음 단계는 고객 서비스 담당자, 초급 프로그래머, 데이터 분석가를 대체하는 것입니다. 따라서 2026년의 전환점은 "인공지능이 다양한 직업을 대체하는 것"에 있다. 기업가들은 "사용자를 위해 어떤 소프트웨어를 개발하고 싶은가"를 고민할 것이 아니라, "상사가 특정 직책의 인건비를 절감하는 데 도움이 될 만한 어떤 종류의 AI 직원을 만들고 싶은가"를 고민해야 합니다. 다시 말해, 항상 새로운 "AI+X" 제품을 만드는 것만 생각하기보다는, 먼저 어떤 인간의 일자리를 대체할 수 있는지 생각해보고, 그 다음 역으로 제품 형태를 결정하는 것이 좋습니다. 이는 카르파티가 언급한 "커서 포 X"에 대한 관찰과 일맥상통합니다. 만약 커서가 본질적으로 "프로그래머의 업무를 AI 기반으로 구현한 것"이라면, 유사한 기술들이 다양한 산업 분야에서 등장할 것입니다. --- 여섯 번째 단계: 도메인 전체 모델은 "잘못된 명제"입니다. 이러한 관점 일부 사람들에게 불편함을 줄 수도 있지만, 탕지에(Tang Jie)는 직설적으로 말합니다. 도메인 특화 모델은 잘못된 명제라는 것입니다. 인공 일반 지능(AGI)에 대해 이야기할 때, "도메인 특화 AGI"가 무슨 의미가 있겠습니까? 도메인별 대규모 모델이 존재하는 이유는 애플리케이션 기업들이 AI 모델 기업 앞에서 패배를 인정하고 싶어하지 않으며, 도메인 노하우로 해자를 구축하고 AI를 도구로 활용하려는 희망 때문입니다. 하지만 인공지능의 본질은 마치 "쓰나미"와 같습니다. 가는 곳마다 모든 것을 휩쓸어 버릴 것입니다. 특정 분야의 일부 기업들은 필연적으로 자신들의 경쟁 우위를 벗어나 인공 일반 지능(AGI)의 세계로 끌려들어갈 것입니다. 그들의 도메인 데이터, 프로세스, 에이전트 데이터는 점차 주요 모델에 통합될 것입니다. 물론, 일반 인공지능이 실현되기 전까지 도메인 모델은 오랫동안 존재할 것입니다. 하지만 그 기간이 얼마나 될지는 예측하기 어렵습니다. 인공지능의 발전 속도가 너무 빠르기 때문입니다. --- 7단계: 다중 모드 및 체화된 지능 – 밝은 미래이지만 험난한 길. 다중 모드 지능은 의심할 여지 없이 미래입니다. 그러나 현재의 문제는 이러한 지능이 인공 일반 지능(AGI)의 지능 한계를 높이는 데에는 제한적인 도움만 제공한다는 점입니다. 텍스트, 멀티모달, 멀티모달 생성은 각각 따로 개발하는 것이 더 효율적일 수 있습니다. 물론, 이 세 가지를 결합하는 것은 용기와 자금이 필요합니다. 구체화된 지능(로봇)은 훨씬 더 어렵습니다. 에이전트와 마찬가지로 가장 큰 과제는 바로 다양성입니다. 로봇에게 A 시나리오에서 작동하도록 가르쳤지만 다른 시나리오에서는 작동하지 않는다면 어떻게 해야 할까요? 데이터 수집 및 종합은 어렵고 비용도 많이 듭니다. 어떻게 해야 할까요? 데이터를 수집하거나, 데이터를 종합하거나. 둘 다 쉽지 않고 비용도 많이 듭니다. 하지만 반대로 데이터 규모가 커지고 범용적인 기능이 등장하면 자연스럽게 진입 장벽이 생깁니다. 자주 간과되는 또 다른 문제는 로봇 자체에도 문제가 있다는 점입니다. 불안정성과 잦은 오작동은 하드웨어적인 문제이며, 이는 체화된 지능의 발전을 저해하는 요인입니다. 탕지에 교수는 2026년까지 이러한 분야에서 상당한 진전이 이루어질 것으로 예측한다. --- 탕지에의 기사를 전체적인 맥락과 연결해 보면 상당히 명확한 로드맵이 드러납니다. 현재 사전 학습된 스케일링은 여전히 효과적이지만, 정렬 및 롱테일 기능 강화에 더 중점을 두어야 합니다. 최근 에이전트는 모델이 "말하는" 단계에서 "행동하는" 단계로 발전할 수 있도록 하는 중요한 돌파구가 되었습니다. 중기적으로는 메모리 시스템과 온라인 학습이 필수적인 과정이며, 모델은 스스로 평가하고 개선하는 방법을 배워야 합니다. 장기적으로 볼 때, 일자리 대체는 응용 프로그램의 핵심이며, 인공 일반 지능(AGI)이 기존의 경쟁 우위를 무너뜨릴 것입니다. 장기적으로 볼 때, 멀티모달 방식과 체화된 접근 방식은 기술과 데이터의 성숙을 기다리며 독립적으로 발전할 것입니다. --- 탕지에와 카르파티의 관점 비교해 보면 몇 가지 공통점을 발견할 수 있다. 첫째, 2025년의 핵심 변화는 훈련 패러다임의 업그레이드입니다. 기존의 "사전 훈련을 주 방식으로"에서 "다단계 협업"으로 전환하는 것입니다. 둘째, Agent는 모델이 학습에서 실행으로 나아가는 중요한 이정표이자 핵심적인 도약입니다. 셋째, 기준 점수와 실제 능력 사이에는 격차가 존재하며, 이 문제는 점점 더 많은 관심을 받고 있습니다. 넷째, AI 애플리케이션의 본질은 인간의 일자리를 대체하거나 향상시키는 것이지, 단순히 앱을 만드는 것 자체가 목적이 아닙니다. 두 연구자의 서로 다른 초점 또한 흥미롭습니다. 카르파티는 "인공지능 지능은 어떤 형태를 띠는가?"라는 철학적 질문에 더 관심을 두는 반면, 탕 지에는 "실제 시나리오에서 모델을 어떻게 구현할 것인가?"라는 공학적 문제에 더 집중합니다. 한쪽은 "이해"에, 다른 한쪽은 "구현"에 더 중점을 두고 있습니다. 두 가지 관점 모두 필요합니다. 명확한 이해를 통해서만 우리가 올바른 방향으로 가고 있는지 알 수 있고, 탄탄한 엔지니어링을 통해서만 우리의 아이디어를 현실로 구현할 수 있습니다. 2026년은 멋진 한 해가 될 것입니다.

이 기사는 기계로 번역되었습니다

원문 표시

宝玉

@dotey

12-20

Andrej Karpathy 是 OpenAI 联合创始人、前特斯拉 AI 总监,也是全球最有影响力的 AI 研究者之一。他刚刚发布了一篇 2025 年 LLM 年度回顾。

第一个大变化:训练方法的范式升级

2025 年之前,训练一个好用的大模型基本是三步走:预训练、监督微调、人类反馈强化学习。这个配方从 2020 x.com/karpathy/statu…

Twitter에서

면책조항: 상기 내용은 작자의 개인적인 의견입니다. 따라서 이는 Followin의 입장과 무관하며 Followin과 관련된 어떠한 투자 제안도 구성하지 않습니다.

라이크

즐겨찾기에 추가

코멘트

공유