지금까지 제작한 가장 큰 규모의 LFM2 모델의 초기 체크포인트입니다 🎉 gpt-oss-20b 및 Qwen3-30B-A3B 대비 우수한 확장성과 매우 빠른 추론 속도를 보여줍니다. 몇 달 안에 사전 학습 및 강화 학습을 추가한 LFM2.5 버전을 출시할 예정입니다.

이 기사는 기계로 번역되었습니다

원문 표시

Liquid AI

@liquidai

02-24

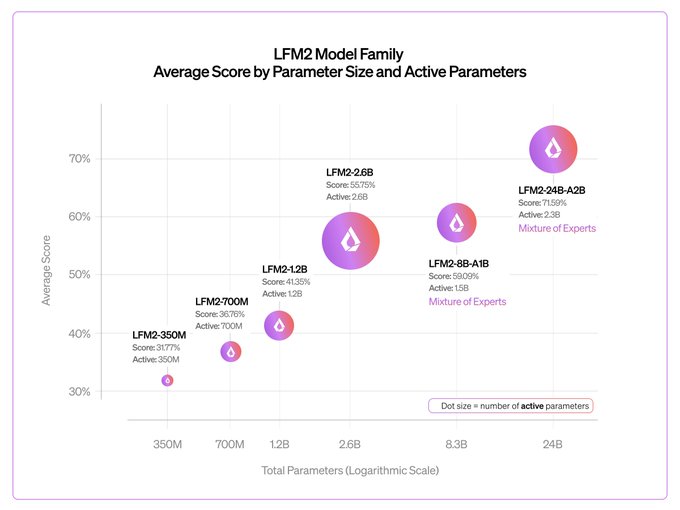

Today, we release our largest LFM2 model: LFM2-24B-A2B 🐘

> 24B total parameters

> 2.3B active per token

> Built on our hybrid, hardware-aware LFM2 architecture

It combines LFM2’s fast, memory-efficient design with a Mixture of Experts setup, so only 2.3B parameters activate

Twitter에서

면책조항: 상기 내용은 작자의 개인적인 의견입니다. 따라서 이는 Followin의 입장과 무관하며 Followin과 관련된 어떠한 투자 제안도 구성하지 않습니다.

라이크

즐겨찾기에 추가

코멘트

공유