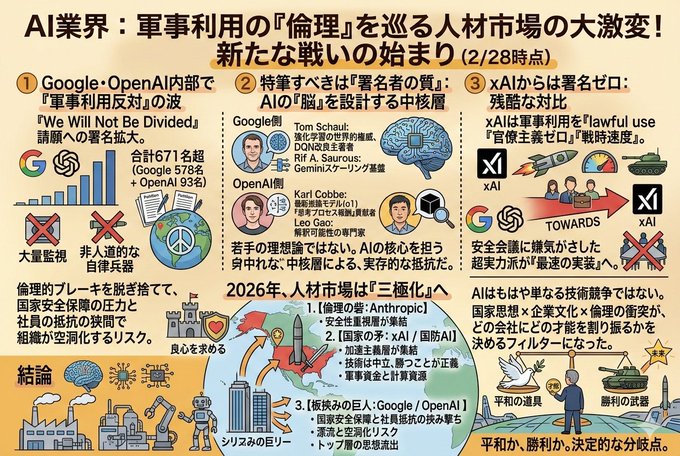

Anthropic과 전쟁성의 문제는 Google과 OpenAI에 크게 파급되고 있습니다. *** AI 업계, 군사 이용의 '윤리'를 둘러싸고 채용 전선이 대폭 변화가. 새로운 싸움이 시작되었습니다. Google과 OpenAI 내부에서 AI의 군사이용(대량 감시, 비인도적인 자율무기)에 반대하는 청원 “We Will Not Be Divided”에 대한 서명이 급증하고 있습니다. (2/28 시점: Google 578명 + OpenAI 93명 = 총 671명 초과) notdivided.org 특필해야 할 것은 인원수보다 '서명자의 질'이다. ■ 「지능의 핵심」을 담당하는 서명자들 • Google 측 • Tom Schaul : 강화 학습의 세계적 권위. DQN 개선의 주요 저자. • Rif A. Saurous: Gemini의 스케일링 기반을 지원하는 최상급 연구직. • OpenAI 측 • Karl Cobbe: 최신 추론 모형 (o1)의 "생각 과정 보상" 공헌자. • Leo Gao: AI의 블랙박스를 폭로하는 "해석 가능성" 전문가. 이것은 젊은이의 이상론이 아닙니다. AI의 '뇌'를 설계하고 있는 핵심층에 의한 실존적인 저항이다. ■ 한편, xAI에서는 서명 제로. 이 대비는 잔인할 만큼 명확하다. xAI는 「관료주의 제로」 「wartime speed(전시 속도)」를 내걸고, 군사 이용을 「lawful use(합법 용도)」라고 나누는 인재가 집결하고 있다. Google/OpenAI의 '안전회의의 많음'에 혐오한 초실력파들이 윤리적 브레이크를 벗어나 '가장 빠른 구현'으로 흐르고 있다. ■ 2026년, 인재 시장은 「삼극화」에 이 윤리적 대립은 그대로 'AI 인재의 민족대 이동'을 일으키고 있다. 1. 【윤리의 요새: Anthropic】 정부의 압력을 「공급망 리스크」의 지정 각오로 거부. Google/OpenAI의 서명 멤버와 같은 「안전성 중시층」이 양심을 요구해 집결. 2. 【국가의 모순:xAI / 국방AI】 「기술은 중립. 이기는 것이 정의」라고 생각하는 가속주의층이 집결. 군사자금을 연료로 압도적인 계산자원으로 지능을 도약시킨다. 3. 【판 사이의 거인 : Google / OpenAI】 국가 안보의 압력과 직원의 저항 사이에 편류. 톱층이 「사상의 합치」를 요구해 양극에 유출해, 조직의 공동화 리스크에 직면하고 있다. ■ 결론 AI는 더 이상 단순한 기술 경쟁이 아닙니다. 「국가사상×기업문화×윤리」의 충돌이 어느 회사에 어떤 재능을 할당할지를 결정하는 필터가 되었다. 우리는 지금 AI가 '평화의 도구'가 되는지 '승리의 무기'가 될지 결정적인 분기점을 만나고 있다.

이 기사는 기계로 번역되었습니다

원문 표시

섹터:

Twitter에서

면책조항: 상기 내용은 작자의 개인적인 의견입니다. 따라서 이는 Followin의 입장과 무관하며 Followin과 관련된 어떠한 투자 제안도 구성하지 않습니다.

라이크

즐겨찾기에 추가

코멘트

공유