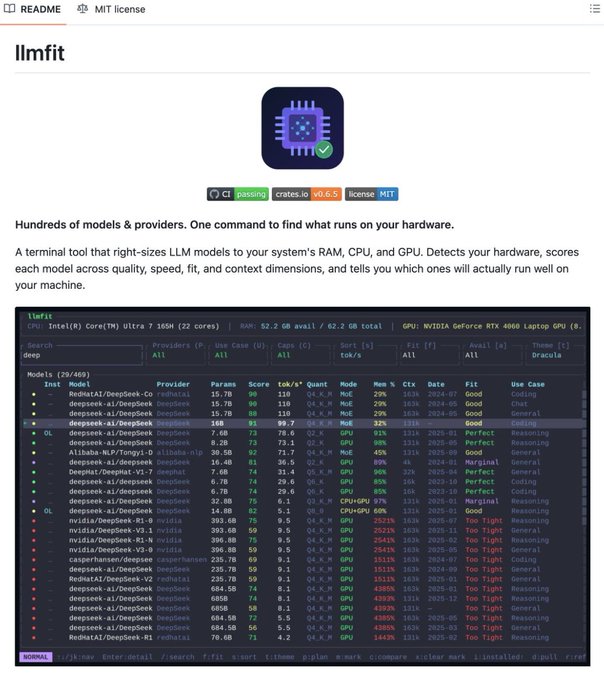

내 컴퓨터가 실제로 처리할 수 있는 LLM(로컬 메모리 모델)을 추측하는 것을 멈추세요. llmfit은 몇 초 만에 하드웨어를 분석하여 최적의 로컬 AI 모델을 찾아줍니다. 추신: 15만 명 이상의 엔지니어에게 유용하고 실용적인 AI 자료를 더 공유합니다. codenewsletter.ai/subscribe?ut...… 따라서 모델을 다운로드하고 OOM(메모리 부족) 오류가 발생하는 대신, llmfit은 먼저 RAM, CPU, GPU 및 VRAM을 스캔한 다음 다음 4가지 기준으로 모든 모델을 평가합니다. 1. 품질 - 파라미터 개수, 모델 패밀리, 양자화 페널티 2. 속도 - 사용 중인 백엔드(CUDA, Metal, ROCm)에 대한 예상 tok/s 3. 적합성 - 메모리 사용률 대비 하드웨어 성능 4. 컨텍스트 - 컨텍스트 창 대비 사용 사례 각 모델에는 Perfect / Good / Marginal / Too Tight의 레이블이 부여됩니다.

이 기사는 기계로 번역되었습니다

원문 표시

Twitter에서

면책조항: 상기 내용은 작자의 개인적인 의견입니다. 따라서 이는 Followin의 입장과 무관하며 Followin과 관련된 어떠한 투자 제안도 구성하지 않습니다.

라이크

즐겨찾기에 추가

코멘트

공유