Văn bản | Sleepy.txt

Năm 2016, tạp chí The New Yorker đăng bài viết về Sam Altman với tựa đề "Số phận của Sam Altman". Ở tuổi 31, ông đã là chủ tịch của Y Combinator, một trong những vườn ươm khởi nghiệp quyền lực nhất Thung lũng Silicon.

Bài báo có đề cập đến việc Ultraman thích đua xe, sở hữu năm chiếc xe thể thao và thích thuê máy bay. Anh ấy nói với phóng viên rằng mình có hai chiếc túi, một trong đó là bộ dụng cụ thoát hiểm phòng khi cần phải bỏ trốn.

Ông ta cũng chuẩn bị súng, vàng, kali iodua (để bảo vệ chống lại bức xạ hạt nhân), thuốc kháng sinh, pin, nước và một mặt nạ phòng độc đạt tiêu chuẩn của Lực lượng Phòng vệ Israel. Ông ta cũng chuẩn bị một mảnh đất ở Big Sur (một khu nghỉ mát ven biển nổi tiếng ở California) để có thể bay đến đó trú ẩn bất cứ lúc nào.

Mười năm sau, Ultraman trở thành người tận tâm nhất trong việc tạo ra ngày tận thế và thúc đẩy việc xây dựng Con tàu Noah. Trong khi cảnh báo thế giới rằng trí tuệ nhân tạo sẽ hủy diệt nhân loại, anh ta lại tự mình đẩy nhanh quá trình này; trong khi tuyên bố không vì tiền, anh ta đã xây dựng một đế chế đầu tư cá nhân trị giá 2 tỷ đô la; trong khi kêu gọi điều chỉnh, anh ta lại loại bỏ tất cả những ai cố gắng kìm hãm sự phát triển đó.

Thay vì gọi ông ta là một kẻ điên loạn tâm thần phân liệt hay một tên lừa đảo xảo quyệt, chính xác hơn thì ông ta chỉ đơn giản là sản phẩm tiêu chuẩn và thành công nhất của cỗ máy khổng lồ mang tên Thung lũng Silicon. "Số phận" của ông ta là biến nỗi lo lắng chung của nhân loại thành vương miện và quyền trượng của riêng mình.

Ngày tận thế là một cơ hội kinh doanh tốt.

Mô hình kinh doanh của Ultraman có thể được tóm gọn trong một câu: đóng gói hoạt động kinh doanh như một cuộc thánh chiến vì sự sống còn của nhân loại.

Ông đã áp dụng phương pháp này từ những ngày còn làm việc tại Y Combinator. Ông đã biến Y Combinator từ một hội thảo nhỏ cung cấp hàng chục nghìn đô la cho các công ty khởi nghiệp giai đoạn đầu thành một đế chế kinh doanh khổng lồ. Ông thành lập Phòng Nghiên cứu Y Combinator, tài trợ cho các dự án chưa tạo ra doanh thu nhưng đầy tham vọng. Ông nói với các phóng viên rằng mục tiêu của Y Combinator là tài trợ cho "tất cả các lĩnh vực quan trọng".

Tại OpenAI, ông đã đẩy phương pháp này đến cực điểm. Ông bán một gói quan điểm về thế giới: Ngày tận thế do AI gây ra + giải pháp cứu rỗi.

Ông ấy là người giỏi hơn bất kỳ ai trong việc mô tả "rủi ro tuyệt chủng" do trí tuệ nhân tạo (AI) gây ra. Ông đã cùng ký một tuyên bố với hàng trăm nhà khoa học nói rằng rủi ro của AI tương đương với chiến tranh hạt nhân. Khi điều trần trước Thượng viện, ông nói: "Chúng ta có một nỗi sợ nhất định (về tiềm năng của AI) - và mọi người nên vui mừng về điều đó." Ông ngụ ý rằng chính nỗi sợ hãi này là một lời cảnh báo hữu ích.

Mỗi tuyên bố này đều có thể trở thành tiêu đề giật gân, mỗi tuyên bố đều là một quảng cáo miễn phí cho OpenAI. Nỗi sợ hãi được dàn dựng tỉ mỉ này là đòn bẩy hiệu quả nhất để thu hút sự chú ý. Điều gì hấp dẫn hơn đối với giới tư bản và truyền thông: một công nghệ "cải thiện hiệu quả" hay một công nghệ "có thể hủy diệt nhân loại"? Câu trả lời đã quá rõ ràng.

Về khía cạnh cứu vãn, ông ta cũng có sẵn một sản phẩm: Worldcoin. Khi nỗi sợ hãi được gieo rắc vào ý thức cộng đồng, việc chào bán các giải pháp trở thành một bước tiến tự nhiên. Sử dụng một quả cầu bạc kích thước bằng quả bóng rổ để quét mống mắt của con người trên toàn cầu, tuyên bố là sẽ phân phối tiền cho tất cả mọi người trong kỷ nguyên trí tuệ nhân tạo. Câu chuyện nghe có vẻ hấp dẫn, nhưng việc trao đổi tiền lấy dữ liệu sinh trắc học này nhanh chóng thu hút sự chú ý của các chính phủ trên toàn thế giới. Hơn chục quốc gia, bao gồm Kenya, Tây Ban Nha, Brazil, Ấn Độ và Colombia, đã tạm dừng hoặc điều tra Worldcoin với lý do bảo mật dữ liệu .

Nhưng điều đó có thể chẳng quan trọng với Ultraman chút nào. Điều quan trọng là thông qua dự án này, anh ấy đã thành công trong việc tự khẳng định mình là "người duy nhất có giải pháp".

Bán nỗi sợ hãi và hy vọng trong cùng một gói sản phẩm là mô hình kinh doanh hiệu quả nhất thời đại chúng ta.

Việc quản lý là vũ khí của tôi, chứ không phải xiềng xích của tôi.

Làm sao một người liên tục nói về ngày tận thế lại có thể kinh doanh được? Câu trả lời của Ultraman là: biến luật lệ thành vũ khí của bạn.

Vào tháng 5 năm 2023, ông lần đầu tiên điều trần trước Quốc hội Hoa Kỳ. Không giống như các chủ sở hữu công ty công nghệ khác thường phàn nàn về việc bị quản lý, ông chủ động yêu cầu: "Hãy quản lý chúng tôi." Ông đề xuất một hệ thống cấp phép AI, trong đó chỉ những công ty được cấp phép mới có thể phát triển các mô hình quy mô lớn. Điều này cho thấy ông là một nhà lãnh đạo ngành công nghiệp có trách nhiệm cao, nhưng vào thời điểm đó, OpenAI đã đi trước rất xa về công nghệ, và một hệ thống quản lý nghiêm ngặt, có rào cản cao chủ yếu sẽ chỉ nhằm mục đích loại bỏ tất cả các đối thủ cạnh tranh tiềm năng.

Tuy nhiên, theo thời gian, đặc biệt là sau khi các đối thủ cạnh tranh như Google và Anthropic bắt kịp về mặt công nghệ và cộng đồng mã nguồn mở bắt đầu lớn mạnh, quan điểm của Altman về quy định đã có một sự thay đổi tinh tế. Ông bắt đầu nhấn mạnh trong nhiều dịp khác nhau rằng các quy định quá khắt khe, đặc biệt là việc yêu cầu các công ty AI phải trải qua các đánh giá bắt buộc trước khi phát hành, có thể kìm hãm sự đổi mới và gây ra hậu quả "thảm khốc".

Ở thời điểm này, quy định không còn là hệ thống bảo vệ mà là một trở ngại.

Khi nắm giữ lợi thế tuyệt đối, ông ta kêu gọi các quy định để củng cố lợi thế đó; khi lợi thế suy giảm, ông ta lại kêu gọi sự tự do để tìm kiếm bước đột phá. Ông ta thậm chí còn cố gắng mở rộng tầm ảnh hưởng đến tận thượng nguồn của Chuỗi ngành công nghiệp. Ông ta đề xuất một kế hoạch sản xuất chip khổng lồ trị giá 7 nghìn tỷ đô la, tìm kiếm sự hỗ trợ từ các nguồn vốn như quỹ đầu tư quốc gia của UAE, nhằm mục đích định hình lại bối cảnh ngành công nghiệp bán dẫn toàn cầu. Điều này vượt xa quyền hạn của một CEO, giống với hành động của một nhân vật đầy tham vọng muốn tác động đến trật tự toàn cầu hơn.

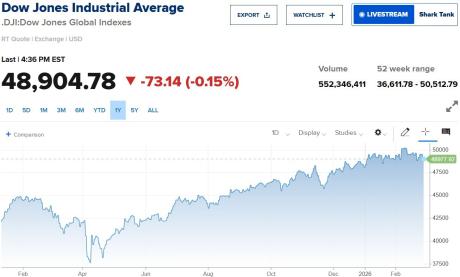

Đằng sau tất cả là sự chuyển đổi nhanh chóng của OpenAI từ một tổ chức phi lợi nhuận thành một tập đoàn thương mại khổng lồ. Được thành lập vào năm 2015, sứ mệnh của tổ chức này là "đảm bảo một cách an toàn rằng Trí tuệ Nhân tạo Tổng quát (AGI) mang lại lợi ích cho toàn nhân loại". Năm 2019, họ thành lập một công ty con "lợi nhuận hạn chế". Đến đầu năm 2024, người ta phát hiện ra rằng từ "an toàn" đã bị âm thầm loại bỏ khỏi tuyên bố sứ mệnh của OpenAI. Mặc dù cấu trúc công ty vẫn là "lợi nhuận hạn chế", tốc độ thương mại hóa của họ rõ ràng đã tăng tốc. Tương ứng, thu nhập tăng trưởng, từ hàng chục triệu đô la vào năm 2022 lên hơn mười tỷ đô la thu nhập hàng năm vào năm 2024, và giá trị của nó tăng vọt từ 29 tỷ đô la lên hàng trăm tỷ đô la.

Khi một người bắt đầu ngắm sao trời và bàn luận về vận mệnh nhân loại, điều đầu tiên anh ta nên làm là xem ví tiền của mình đang ở đâu.

Thiết kế nhân vật: Khả năng miễn dịch của một nhà lãnh đạo lôi cuốn

Vào ngày 17 tháng 11 năm 2023, Ultraman bị hội đồng quản trị do chính ông lựa chọn sa thải với lý do "thiếu trung thực trong giao tiếp với hội đồng quản trị".

Những gì xảy ra trong năm ngày tiếp theo không chỉ đơn thuần là một cuộc chiến kinh doanh mà còn là một cuộc trưng cầu dân ý về niềm tin. Chủ tịch Greg Brockman từ chức; 95% nhân viên của công ty, hơn 700 người, đã ký đơn kiến nghị yêu cầu hội đồng quản trị từ chức, đe dọa sẽ đồng loạt chuyển sang làm việc cho Microsoft nếu họ không từ chức; Giám đốc điều hành Microsoft, Satya Nadella, nhà đầu tư lớn nhất của công ty, đã công khai đứng về phía Brockman, nói rằng ông luôn được chào đón trở lại làm việc bất cứ lúc nào. Cuối cùng, Brockman trở lại trong thắng lợi, được phục chức và loại bỏ gần như tất cả các thành viên hội đồng quản trị phản đối ông.

Làm thế nào một CEO bị hội đồng quản trị chính thức đánh giá là "không trung thực" lại có thể trở lại mà không bị ảnh hưởng gì và thậm chí còn nắm giữ quyền lực lớn hơn?

Helen Toner, thành viên hội đồng quản trị bị loại bỏ, sau đó đã tiết lộ chi tiết. Altman đã che giấu quyền kiểm soát thực sự của mình đối với quỹ khởi nghiệp OpenAI khỏi hội đồng quản trị; lần nói dối về các quy trình bảo mật quan trọng; và thậm chí còn biết về thông báo quan trọng về ChatGPT từ Twitter. Bất kỳ một trong những cáo buộc này cũng đủ để sa thải một CEO đến cả trăm lần.

Nhưng Ultraman thì vẫn ổn. Bởi vì anh ấy không phải là một CEO bình thường, anh ấy là một "nhà lãnh đạo lôi cuốn".

Đây là một khái niệm do nhà xã hội học Max Weber đề xuất cách đây một thế kỷ, cho rằng có một loại quyền lực không đến từ chức vụ hay luật pháp, mà từ "sức hút cá nhân phi thường" của người lãnh đạo. Những người theo dõi tin tưởng vào họ không phải vì họ đã làm điều gì đúng đắn, mà chỉ vì họ là chính họ. Loại niềm tin này là phi lý. Khi một người lãnh đạo mắc sai lầm hoặc bị thách thức, phản ứng đầu tiên của những người theo dõi không phải là đặt câu hỏi cho người lãnh đạo, mà là tấn công người thách thức.

Đây là cách mà các nhân viên của OpenAI suy nghĩ. Họ không tin vào công lý theo thủ tục của hội đồng quản trị; họ chỉ tin vào "số phận" được thể hiện bởi Ultraman, và họ cảm thấy các thành viên hội đồng quản trị đang "cản trở sự tiến bộ của nhân loại".

Sau khi Altman được phục chức, đội ngũ bảo mật của OpenAI nhanh chóng bị giải tán. Nhà khoa học trưởng Ilya Sutzkwell, người đứng đầu việc sa thải Altman, cũng rời đi. Vào tháng 5 năm 2024, trưởng đội ngũ bảo mật Jan Leike đã từ chức, đăng tải trên Twitter: "Văn hóa và quy trình bảo mật của công ty đã bị hy sinh để theo đuổi những sản phẩm hào nhoáng đó."

Trước một nhà lãnh đạo có sức lôi cuốn, sự thật không còn quan trọng, quy trình không còn quan trọng, và sự an toàn cũng không còn quan trọng. Điều duy nhất quan trọng là niềm tin.

Các nhà tiên tri trên dây chuyền sản xuất

Sam Altman chỉ là mô hình mới nhất và thành công nhất trên dây chuyền sản xuất "nhà tiên tri" của Thung lũng Silicon.

Trên dây chuyền sản xuất này có rất nhiều gương mặt quen thuộc.

Lấy Elon Musk làm ví dụ. Năm 2014, ông ta tuyên bố rằng "Trí tuệ nhân tạo đang triệu hồi quỷ dữ". Thế nhưng, Tesla của ông lại là công ty robot lớn nhất thế giới và là ứng dụng phức tạp nhất của trí tuệ nhân tạo. Sau khi đoạn tuyệt với Ultraman, ông thành lập xAI vào năm 2023, tuyên chiến trực diện. Chỉ một năm sau, giá trị của xAI đã vượt quá 20 tỷ đô la. Ông cảnh báo về sự xuất hiện của quỷ dữ trong khi đồng thời tạo ra một con quỷ khác. Câu chuyện mâu thuẫn này có sự tương đồng đáng kinh ngạc với Ultraman.

Lấy Mark Zuckerberg làm ví dụ. Vài năm trước, ông đã đặt cược toàn bộ tương lai của công ty vào Metaverse, đốt gần 90 tỷ đô la, chỉ để rồi nhận ra đó là một cái bẫy. Vì vậy, ông ngay lập tức thay đổi hướng đi, chuyển trọng tâm câu chuyện của công ty từ Metaverse sang Trí tuệ Nhân tạo Tổng quát (AGI). Năm 2025, ông tuyên bố thành lập "Phòng thí nghiệm Siêu trí tuệ" và đích thân tuyển dụng nhân tài. Cả hai đều liên quan đến viễn cảnh mong đợi vĩ đại về tương lai của nhân loại, cả hai đều đòi hỏi vốn đầu tư khổng lồ và cả hai đều mang dáng vẻ của một vị cứu tinh.

Rồi đến Peter Thiel. Là người hướng dẫn của Altman, ông ta giống như kiến trúc sư trưởng của dây chuyền sản xuất này. Trong khi đầu tư vào các công ty quảng bá "điểm kỳ dị công nghệ" và "bất tử", ông ta đồng thời mua đất và xây dựng hầm trú ẩn ngày tận thế ở New Zealand, và được cấp quốc tịch chỉ sau 12 ngày ở đó. Công ty của ông ta, Palantir, là một trong những công ty giám sát dữ liệu lớn nhất thế giới, chủ yếu phục vụ chính phủ và quân đội. Ông ta đồng thời chuẩn bị cho sự sụp đổ của nền văn minh và chế tạo những công cụ giám sát tinh vi nhất cho những người nắm quyền. Trong chiến dịch quân sự chống lại Iran vào đầu năm 2026, nền tảng trí tuệ nhân tạo (AI) của Palantir đóng vai trò là bộ não, tích hợp lượng dữ liệu khổng lồ từ vệ tinh do thám, nghe lén thông tin liên lạc, máy bay không người lái và phân tích mô hình Claude, chuyển đổi thông tin hỗn loạn thành thông tin ra quyết định trong thời gian thực, cuối cùng khóa mục tiêu và thực hiện cuộc tấn công tiêu diệt.

Mỗi người trong số họ đều đóng nhân vật kép: vừa "cảnh báo về thảm họa sắp xảy ra" vừa "thúc đẩy ngày tận thế tiến đến". Đây không phải là sự phân liệt tính cách; mà là một mô hình kinh doanh đã được thị trường vốn chứng minh là hiệu quả nhất. Họ thu hút sự chú ý, vốn và quyền lực bằng cách tạo ra và bán nỗi lo lắng mang tính cấu trúc. Họ vừa là sản phẩm vừa là người định hình hệ thống này, là "kẻ xấu xa đứng sau câu chuyện vĩ đại".

Thung lũng Silicon không còn chỉ là nơi xuất khẩu công nghệ; nó là một nhà máy tạo ra những "huyền thoại hiện đại".

Tại sao thủ thuật này lần hiệu quả?

Cứ vài năm một lần, Thung lũng Silicon lại sản sinh ra một nhà tiên tri mới, người thu hút sự chú ý của giới tư bản, truyền thông và công chúng bằng một câu chuyện vĩ đại về ngày tận thế và sự cứu rỗi. Chiêu trò này được lặp đi lặp lại nhiều lần, nhưng vẫn luôn hiệu quả. Mỗi bước trong đó đều nhắm chính xác vào những lỗ hổng cụ thể trong nhận thức của con người.

Bước 1: Kiểm soát nhịp điệu của nỗi sợ hãi, chứ không phải chỉ tạo ra nỗi sợ hãi.

Những rủi ro tiềm tàng của trí tuệ nhân tạo là có thật, nhưng rủi ro lẽ ra có thể được thảo luận một cách bình tĩnh hơn. Chính nhóm này đã cố tình chọn cách trình bày chúng một cách kịch tính nhất, và họ đã kiểm soát rất chính xác việc gieo rắc nỗi sợ hãi.

Thời điểm gieo rắc nỗi sợ hãi trong công chúng, việc mang đến hy vọng và việc gióng lên hồi chuông cảnh báo đều được thiết kế cẩn thận. Nỗi sợ hãi là nhiên liệu, nhưng thời điểm và phương pháp châm ngòi mới là nghệ thuật thực sự.

Bước thứ hai: Biến sự khó hiểu của công nghệ thành nguồn sức mạnh.

Trí tuệ nhân tạo (AI) là một hộp đen hoàn toàn khó hiểu đối với đại đa số mọi người. Khi một điều gì đó trở nên quá phức tạp để có thể hiểu đầy đủ, mọi người theo bản năng sẽ từ bỏ quyền giải thích nó và trao quyền đó cho "người hiểu rõ nhất". Họ hiểu sâu sắc điều này và đã biến nó thành một lợi thế cấu trúc; càng mô tả AI là bí ẩn, nguy hiểm và vượt quá khả năng hiểu biết của con người, thì bản thân họ càng trở nên không thể thay thế.

Điều đáng sợ của lối tư duy này là nó tự củng cố chính nó. Bất kỳ sự chỉ trích nào từ bên ngoài đều tự động bị vô hiệu hóa vì người chỉ trích "không hiểu biết đủ". Các nhà quản lý không hiểu công nghệ, vì vậy phán xét của họ không đáng tin cậy; các nhà phê bình học thuật chưa xây dựng mô hình trên thực tế, vì vậy mối quan ngại của họ chỉ mang tính lý thuyết. Cuối cùng, chỉ có chính họ mới tư cách để tự phán xét bản thân.

Bước thứ ba: Thay thế "lợi ích" bằng "ý nghĩa" để người theo dõi tự nguyện từ bỏ việc chỉ trích.

Đây là tầng khó xuyên thủng nhất trong toàn bộ hệ thống, và cũng là nguồn sức mạnh bền bỉ nhất của nó. Thứ họ rao bán không bao giờ chỉ là một công việc hay một sản phẩm, mà là một câu chuyện mang ý nghĩa trên quy mô vũ trụ: bạn đang quyết định số phận của nhân loại. Một khi câu chuyện này được chấp nhận, những người theo dõi sẽ sẵn lòng từ bỏ khả năng phán đoán độc lập. Bởi vì trước một sứ mệnh liên quan đến "sự sống còn của nhân loại", việc đặt câu hỏi về động cơ của người lãnh đạo khiến người ta trở nên nhỏ bé, thậm chí như một trở ngại cho lịch sử. Điều này khiến mọi người sẵn lòng từ bỏ khả năng tư duy phản biện và hiểu sự từ bỏ này như một lựa chọn cao cả.

Hãy kết hợp ba bước này lại với nhau, và bạn sẽ hiểu tại sao hệ thống này lại khó bị phá vỡ đến vậy. Nó không dựa vào những lời nói dối; nó dựa vào sự hiểu biết chính xác về cấu trúc nhận thức của con người. Đầu tiên, nó tạo ra một nỗi sợ hãi mà bạn không thể phớt lờ, sau đó độc chiếm cách diễn giải nỗi sợ hãi đó, và cuối cùng sử dụng "ý nghĩa" để biến bạn thành người truyền bá trung thành nhất của nó.

Trong hệ thống này, Ultraman là mô hình hoạt động trơn tru nhất cho đến nay.

Số phận của ai?

Altman luôn khẳng định rằng ông không sở hữu bất kỳ cổ phần nào trong OpenAI và chỉ nhận một khoản lương mang tính biểu tượng, điều từng là nền tảng cho câu chuyện "cống hiến vì tình yêu" của ông.

Nhưng Bloomberg ước tính tài sản tài sản ròng của ông vào năm 2024 vào khoảng 2 tỷ đô la. Sự giàu có này chủ yếu đến từ sê-ri các khoản đầu tư mạo hiểm mà ông đã thực hiện trong thập kỷ qua. Khoản đầu tư ban đầu của ông vào công ty thanh toán Stripe được cho là đã mang lại lợi nhuận hàng trăm triệu đô la; khoản đầu tư vào đợt IPO của Reddit cũng mang lại cho ông lợi nhuận đáng kể. Ông cũng đầu tư vào công ty phản ứng tổng hợp hạt nhân Helion, đồng thời đặt cược lớn vào phản ứng tổng hợp hạt nhân trong khi tuyên bố rằng tương lai của trí tuệ nhân tạo phụ thuộc vào những đột phá về năng lượng. Sau đó, OpenAI đã đàm phán một thỏa thuận mua bán điện lớn với Helion. Ông tuyên bố đã tránh các cuộc đàm phán, nhưng toàn bộ chuỗi lợi ích là vô cùng rõ ràng.

Ông ta không thực sự sở hữu cổ phần trực tiếp nào trong OpenAI, nhưng ông ta đã xây dựng một đế chế đầu tư khổng lồ, lấy bản thân làm trung tâm xung quanh nó. Mỗi bài diễn thuyết hùng hồn mà ông ta đưa ra về tương lai của nhân loại đều làm tăng giá trị cho đế chế này.

Giờ đây, nhìn lại bộ dụng cụ sinh tồn ngày tận thế của ông ta, chứa đầy súng, vàng và thuốc kháng sinh, cùng mảnh đất ở Big Sur mà ông ta có thể bay đến bất cứ lúc nào, bạn có hiểu thêm điều gì không?

Ông ta chưa bao giờ giấu giếm điều gì. Bộ dụng cụ thoát hiểm là có thật, hầm trú ẩn là có thật, và sự ám ảnh của ông ta với ngày tận thế cũng là có thật. Nhưng ông ta cũng là người tích cực nhất thúc đẩy ngày tận thế đến. Hai điều này không mâu thuẫn, bởi vì theo logic của ông ta, ngày tận thế không cần phải ngăn chặn, chỉ cần được dự đoán trước. Ông ta bị ám ảnh bởi việc đóng vai trò là người duy nhất có thể nhìn thấy tương lai rõ ràng và chuẩn bị cho nó.

Cho dù đó là chuẩn bị một bộ dụng cụ thoát hiểm vật chất hay xây dựng một đế chế tài chính xung quanh OpenAI, về bản chất đều giống nhau: đảm bảo vị thế chiến thắng chắc chắn nhất cho bản thân trong một tương lai đầy bất trắc do chính bạn tạo ra.

Tháng 2 năm 2026, ông ta vừa mới tuyên bố lập trường cứng rắn của mình là "không sử dụng trí tuệ nhân tạo trong chiến tranh" thì đã ký hợp đồng với Lầu Năm Góc. Đây không phải là sự đạo đức giả; đó là một yêu cầu thiết yếu trong mô hình kinh doanh của ông ta. Lập trường đạo đức là một phần của sản phẩm, trong khi các hợp đồng thương mại là nguồn lợi nhuận. Ông ta cần đồng thời đóng vai trò của một vị cứu tinh nhân ái và một nhà tiên tri tàn nhẫn báo hiệu tai họa, bởi vì chỉ bằng cách đóng cả hai nhân vật, câu chuyện của ông ta mới có thể tiếp tục và "số phận" của ông ta mới được hé lộ.

Mối nguy hiểm thực sự không bao giờ đến từ trí tuệ nhân tạo, mà là từ những kẻ tin rằng họ có quyền định đoạt số phận của nhân loại.