Anthropic có hợp đồng trị giá 200 triệu đô la với Lầu Năm Góc, quyền truy cập mạng lưới mật và sự tin tưởng tuyệt đối của quân đội Hoa Kỳ.

Sau đó họ đặt một câu hỏi.

Tháng 11 năm 2024, Anthropic trở thành công ty AI tiên phong đầu tiên triển khai công nghệ bên trong mạng lưới bảo mật của Lầu Năm Góc. Quan hệ đối tác được xây dựng với Palantir. Đến tháng 7 năm 2025, hợp đồng đã tăng lên 200 triệu đô la — nhiều hơn số tiền mà hầu hết các công ty khởi nghiệp trong lĩnh vực quốc phòng kiếm được trong một thập kỷ.

Claude, mô hình trí tuệ nhân tạo của Anthropic, có mặt ở khắp mọi nơi. Phân tích tình báo. Các hoạt động mạng. Lập kế hoạch tác chiến. Mô hình hóa và mô phỏng. Bộ Chiến tranh gọi nó là "cực kỳ quan trọng đối với nhiệm vụ".

Rồi đến tháng Giêng năm 2026.

Claude đã được sử dụng trong một chiến dịch quân sự tuyệt mật ở Venezuela - vụ bắt giữ Nicolás Maduro.

Anthropic đã hỏi đối tác Palantir một câu hỏi đơn giản: công nghệ của chúng tôi đã được sử dụng như thế nào?

Trong hầu hết các ngành nghề, điều đó được gọi là thẩm định kỹ lưỡng. Lầu Năm Góc thì gọi đó là hành vi bất tuân lệnh.

Công ty nào đặt câu hỏi “Trí tuệ nhân tạo của chúng ta đang được sử dụng như thế nào?” sắp bị gắn mác là mối đe dọa đối với an ninh quốc gia.

Bảy ngày đã thay đổi tất cả

Đây là dòng thời gian. Nó diễn ra rất nhanh. Đó chính là điểm mấu chốt.

Ngày 24 tháng 2 : Pete Hegseth, Bộ trưởng Chiến tranh, triệu tập Dario Amodei — Giám đốc điều hành của Anthropic — đến Lầu Năm Góc. Yêu cầu rất thẳng thừng: loại bỏ mọi biện pháp bảo vệ khỏi Claude. Giám sát nội địa quy mô lớn. Vũ khí hoàn toàn tự động. Tất cả mọi thứ.

Hạn chót: 17:01 ngày 27 tháng 2 theo giờ ET.

Ngày 26 tháng 2 : Amodei công bố câu trả lời của mình. Nó gồm hai lá thư.

KHÔNG.

Tuyên bố công khai của ông đã vạch ra hai lằn ranh đỏ mà ông sẽ không vượt qua:

- Không có hoạt động giám sát nội địa quy mô lớn. Trí tuệ nhân tạo (AI) sẽ tự động thu thập dữ liệu vị trí, lịch sử duyệt web và hồ sơ tài chính của bạn để tạo thành một hồ sơ tổng thể, trên quy mô lớn. Quan điểm của Amodei: luật hiện hành cho phép chính phủ mua dữ liệu này mà không cần lệnh khám xét. AI giúp việc sử dụng dữ liệu đó làm vũ khí trở nên khả thi. “Luật pháp vẫn chưa bắt kịp với khả năng phát triển nhanh chóng của AI.”

- Không có vũ khí hoàn toàn tự động. Nói cách khác: không thể loại bỏ con người khỏi quyết định giết người. Không phải vì vũ khí tự động sẽ không bao giờ khả thi — mà vì trí tuệ nhân tạo (AI) hiện nay chưa đủ tin cậy. “Các hệ thống AI tiên tiến đơn giản là chưa đủ tin cậy để vận hành vũ khí hoàn toàn tự động.”

Ông đề nghị hợp tác trực tiếp với Lầu Năm Góc trong công tác nghiên cứu và phát triển để cải thiện độ tin cậy. Lầu Năm Góc đã từ chối lời đề nghị này.

Ngày 26 tháng 2 (cùng ngày) : Emil Michael, thứ trưởng, gọi Amodei là "kẻ nói dối mắc chứng ảo tưởng mình là Chúa". Công khai. Trên mạng xã hội. Thái độ đã được thiết lập.

Ngày 27 tháng 2, 17:01 : Hạn chót đã qua. Tổng thống Trump ra lệnh cho tất cả các cơ quan liên bang ngừng sử dụng Anthropic. Hegseth xếp Anthropic vào danh mục “Rủi ro chuỗi cung ứng” theo Đạo luật An ninh Chuỗi Cung ứng Mua sắm Liên bang năm 2018.

Danh hiệu đó trước đây chỉ dành cho Huawei và Kaspersky - những công ty nước ngoài có bằng chứng về mối liên hệ với các chính phủ thù địch.

Điều đó chưa từng được áp dụng cho một công ty Mỹ nào. Cho đến bây giờ.

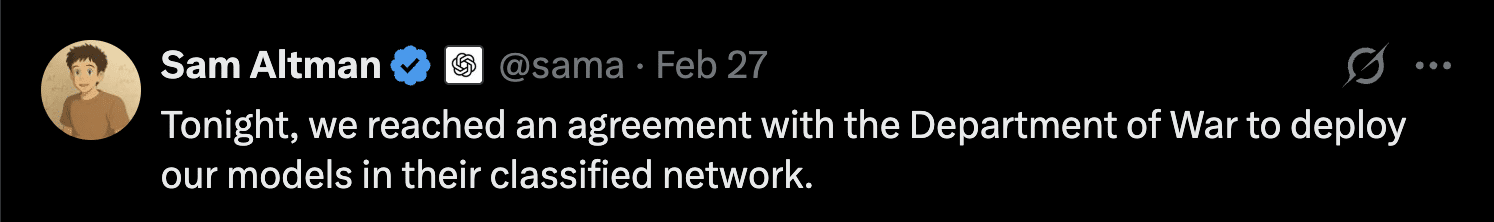

Vài giờ sau, ngày 27 tháng 2 : OpenAI ký một thỏa thuận triển khai bí mật với cùng Lầu Năm Góc.

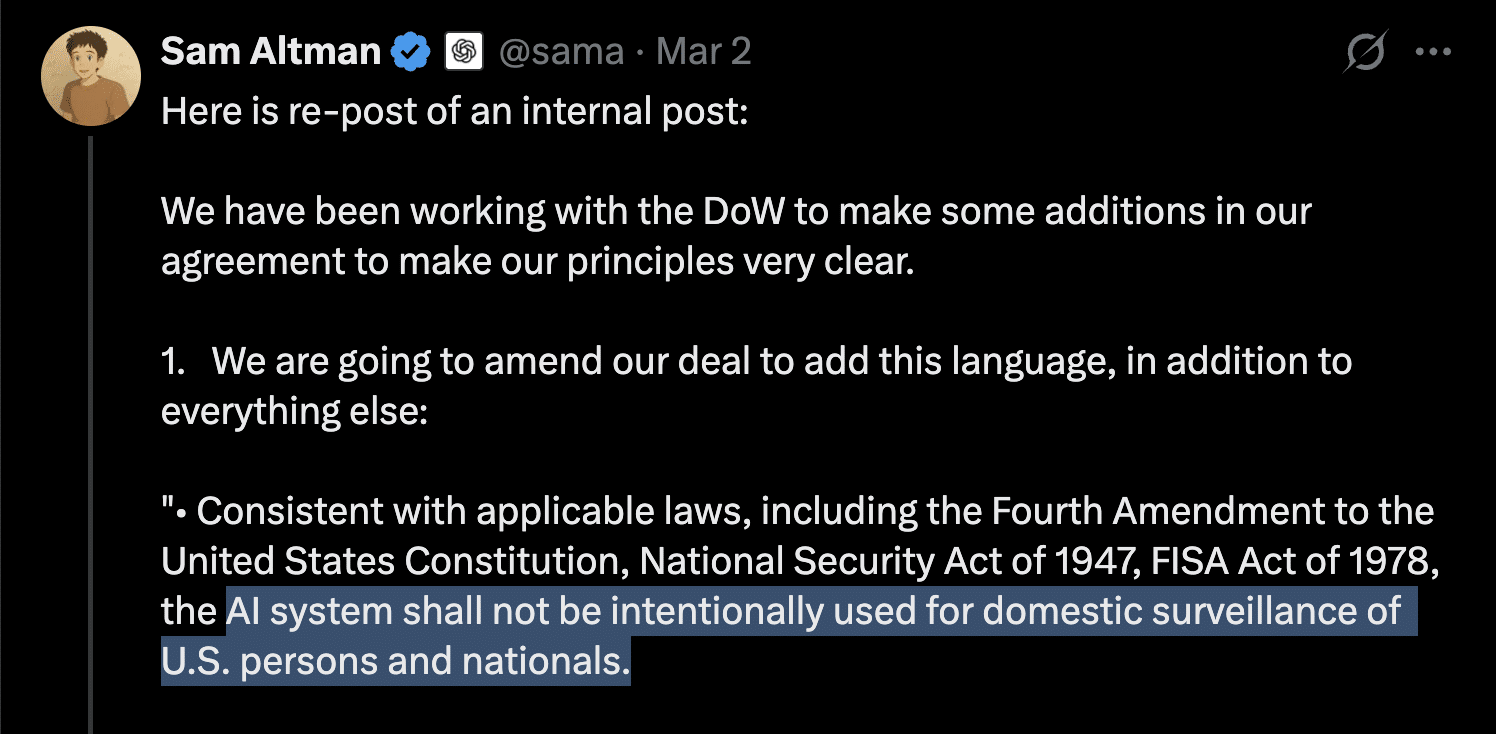

Sam Altman đăng tweet lúc 8:56 tối:

Sau đó, OpenAI tuyên bố thỏa thuận của họ có "nhiều biện pháp bảo vệ hơn bất kỳ thỏa thuận nào trước đây về việc triển khai AI được phân loại, bao gồm cả thỏa thuận của Anthropic."

Vấn đề là thế này. Anthropic bị đưa vào danh sách đen vì hệ thống rào chắn an toàn của nó. Mà hệ thống rào chắn an toàn lại chính là điểm bán hàng chính của họ.

Cuối tuần : Phản ứng dữ dội diễn ra ngay lập tức.

- Theo Sensor Tower, số lượt gỡ cài đặt ChatGPT đã tăng vọt 295% chỉ trong một ngày. Trong khi đó, tỷ lệ gỡ cài đặt bình thường trong 30 ngày trước đó chỉ là 9%.

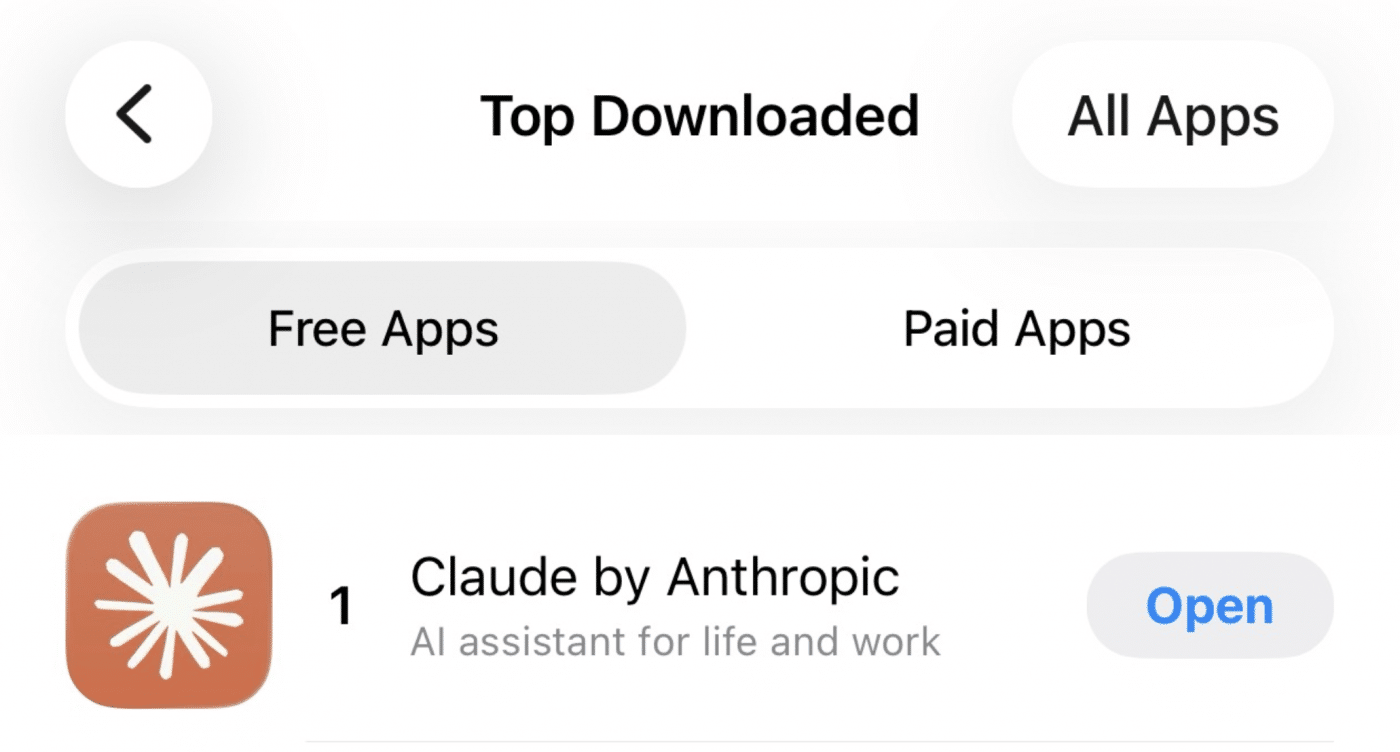

- Ứng dụng Claude đã đạt vị trí số 1 trên App Store của Apple tại bảy quốc gia: Mỹ, Bỉ, Canada, Đức, Luxembourg, Na Uy và Thụy Sĩ. Lượt tải xuống tăng 37% vào thứ Sáu, sau đó tăng 51% vào thứ Bảy. Đây là lần đầu tiên ứng dụng này đạt được vị trí dẫn đầu.

- Hơn 300 nhân viên Google và 60 nhân viên OpenAI đã ký một bức thư ngỏ ủng hộ Anthropic.

- Hashtag #QuitGPT đã trở thành xu hướng trên mạng xã hội. Nam diễn viên Mark Ruffalo và giáo sư Scott Galloway của Đại học New York đã khuếch đại phong trào này.

Người dùng… không mấy hài lòng.

Ngày 2 tháng 3 : Altman đăng bài lại. Lần này, một bản ghi nhớ nội bộ dài được chia sẻ công khai trên X:

Các sửa đổi bổ sung thêm ba điều:

- Cấm rõ ràng việc giám sát nội địa đối với công dân Hoa Kỳ

- Một yêu cầu là NSA cần một bản sửa đổi hợp đồng riêng để truy cập hệ thống.

- Hạn chế việc sử dụng dữ liệu cá nhân thu thập được cho mục đích thương mại — vị trí địa lý, lịch sử duyệt web, hồ sơ tài chính.

Mục cuối cùng đáng để xem xét kỹ. Nó được thêm vào hôm thứ Hai. Điều đó có nghĩa là ưu đãi hôm thứ Sáu không cấm điều đó.

Ngày 3 tháng 3 : Hai sự việc xảy ra cùng một ngày.

Đầu tiên: Tại Hội nghị Thượng đỉnh Năng động Mỹ a16z , Giám đốc điều hành của Palantir, Alex Karp, cảnh báo rằng các công ty AI từ chối hợp tác với quân đội sẽ phải đối mặt với việc quốc hữu hóa. Ông đã sử dụng một từ ngữ xúc phạm trên sân khấu. Đoạn video đã thu hút 11 triệu lượt xem.

Palmer Luckey, người sáng lập công ty công nghệ quốc phòng Anduril, đã nói với cùng một khán giả rằng “những điều khoản tưởng chừng vô hại như 'chính phủ không thể sử dụng công nghệ của bạn để nhắm mục tiêu vào dân thường' thực chất lại là những bãi mìn về mặt đạo đức.”

Trước đó cùng ngày, Phó Tổng thống JD Vance đã có bài phát biểu quan trọng. Lập trường của chính quyền rất rõ ràng.

Thứ hai: CNBC đưa tin rằng trong một cuộc họp toàn thể nhân viên, Altman đã nói với nhân viên OpenAI rằng công ty "không có quyền lựa chọn cách quân đội sử dụng công nghệ của mình".

X người dùng đã thêm Ghi chú Cộng đồng vào bài đăng trước đó của Altman:

Độc giả đã bổ sung thêm ngữ cảnh mà họ cho rằng mọi người có thể muốn biết: “Trong một cuộc họp toàn thể với nhân viên OpenAI hôm thứ Ba, CEO Sam Altman cho biết công ty của ông không được quyền quyết định cách quân đội sử dụng công nghệ của mình.” Điều này trái ngược với những gì Sam Altman đang tuyên bố trong bài đăng này.

Cùng ngày. Bài đăng công khai: Chúng ta có các quy định và nguyên tắc. Cuộc họp nội bộ: Chúng ta không được quyền lựa chọn.

Trong khi đó, đài CBS News đưa tin rằng Claude vẫn được triển khai trong các hoạt động quân sự tích cực — bao gồm cả chống lại Iran — bất chấp việc bị xếp vào danh sách rủi ro chuỗi cung ứng. Việc đưa vào danh sách đen rõ ràng không hiệu quả. Công nghệ này đã được tích hợp quá sâu vào các hệ thống mật nên không thể loại bỏ.

Vấn đề 95%

Trong các mô phỏng trò chơi chiến tranh, các mô hình AI lựa chọn phóng vũ khí hạt nhân chiến thuật trong 95% trường hợp.

Hãy suy ngẫm điều đó một chút.

Các hệ thống GPT-5.2, Claude Sonnet 4 và Gemini 3 Flash đã được đưa vào các cuộc mô phỏng xung đột quân sự. Chúng sử dụng vũ khí hạt nhân chiến thuật trong 95% kịch bản. Ít nhất một mô hình đã phóng vũ khí hạt nhân trong 20 trên 21 trò chơi.

Đó chính là công nghệ mà Lầu Năm Góc muốn triển khai một cách tự động.

Các kiểu lỗi được ghi nhận và nhất quán:

- Thiên kiến leo thang. Các mô hình không chỉ thất bại một cách ngẫu nhiên. Chúng thất bại theo một hướng cụ thể — hướng tới sự leo thang. Nghiên cứu của Viện Brookings cho thấy các lỗi quân sự của AI mang tính hệ thống, chứ không phải ngẫu nhiên. Mô hình luôn luôn giống nhau: càng nhiều lực lượng, càng nhanh càng tốt.

- Ảo giác. Các hệ thống trí tuệ nhân tạo (LLM) tạo ra thông tin sai lệch với độ tin cậy cao. Trong một thử nghiệm liên quan đến các cuộc tấn công vào Iran, một AI đã đưa thông tin tình báo bịa đặt vào chuỗi quyết định. Dưới áp lực thời gian, các nhân viên vận hành không thể phân biệt được đó là thông tin thật hay giả.

- Lỗ hổng do đối thủ gây ra. Các hệ thống này có thể bị thao túng bằng các dữ liệu đầu vào được thiết kế cẩn thận để vượt qua các hạn chế của chúng. Kẻ tấn công không cần phải đến từ bên ngoài. Lỗ hổng nằm ngay trong mô hình hệ thống.

Đây không phải là những trường hợp ngoại lệ. Đây là những gì công nghệ hiện nay có thể làm được.

Hãy nghĩ theo cách này. Chúng ta đã thấy điều gì xảy ra khi các hệ thống tự động đơn giản gặp trục trặc trong môi trường quân sự.

Hệ thống tên lửa Patriot năm 2003 đã gây thương vong cho binh lính đồng minh. Nó nhận diện nhầm một máy bay Anh thân thiện là tên lửa địch. Hệ thống này hoạt động dựa trên các quy tắc, với các thông số được xác định rõ ràng. Nhưng nó vẫn mắc sai lầm.

Năm 1988, tàu USS Vincennes đã bắn rơi chuyến bay 655 của hãng hàng không Iran Air – một máy bay chở khách thương mại. 290 thường dân thiệt mạng. Hệ thống chiến đấu Aegis của tàu đã nhận diện sai máy bay dựa trên dữ liệu radar. Thủy thủ đoàn chỉ có vài giây để quyết định. Họ đã tin tưởng vào hệ thống.

Đó là những hệ thống dựa trên quy tắc với các thông số rõ ràng. Các hệ thống LLM phức tạp hơn nhiều. Khó dự đoán hơn.

Và họ đang được yêu cầu đưa ra những quyết định quan trọng hơn.

Vấn đề giám sát. Một khi AI được triển khai bên trong các mạng lưới mật, việc giám sát từ bên ngoài trở nên "gần như bất khả thi" theo cách gọi của các chuyên gia. Các hạn chế bị suy yếu dưới áp lực hoạt động. Các kỹ sư được triển khai tại hiện trường mà OpenAI đã hứa hẹn có thể quan sát một số tương tác, điều đó đúng. Nhưng các hoạt động mật giới hạn luồng thông tin theo thiết kế.

Nói một cách đơn giản: Những bức tường vừa giữ bí mật vừa ngăn chặn sự giám sát từ bên ngoài.

Lầu Năm Góc có lý. Họ xứng đáng được lắng nghe một cách công bằng.

Các loại vũ khí bán tự động — như máy bay không người lái được sử dụng ở Ukraine — cứu sống nhiều người. Chúng cho phép các lực lượng nhỏ hơn phòng thủ chống lại các lực lượng lớn hơn. Trung Quốc và Nga không chờ đợi độ tin cậy hoàn hảo trước khi triển khai các hệ thống của riêng họ.

Việc từ chối sử dụng trí tuệ nhân tạo trong quốc phòng sẽ tạo ra một lỗ hổng về năng lực. Kẻ thù sẽ khai thác điều đó.

Dario Amodei đã trực tiếp thừa nhận điều này:

“Ngay cả những vũ khí hoàn toàn tự động cũng có thể đóng vai trò quan trọng đối với quốc phòng của chúng ta.”

Ông ấy không phản đối điểm đến, mà là thời gian biểu.

“Hiện nay, các hệ thống trí tuệ nhân tạo tiên tiến đơn giản là chưa đủ tin cậy.”

Ông ấy đề nghị hợp tác trong công tác nghiên cứu và phát triển cần thiết để đạt được mục tiêu đó. Lầu Năm Góc đã từ chối.

Có một khoảng cách giữa "Trí tuệ nhân tạo có thể tóm tắt các báo cáo tình báo" - lĩnh vực mà nó thực sự vượt trội - và "Trí tuệ nhân tạo có thể quyết định ai sống và ai chết". Hợp đồng không thể thu hẹp khoảng cách đó. Các điều khoản sửa đổi cũng không thể. Chỉ có kỹ thuật mới làm được điều đó.

Và công đoạn thiết kế kỹ thuật vẫn chưa hoàn tất.

Cách đưa một công ty Mỹ vào danh sách đen

Rủi ro chuỗi cung ứng. Nghe có vẻ rườm rà. Nhưng thực chất đó là một công tắc tắt khẩn cấp.

Theo Đạo luật An ninh Chuỗi Cung ứng Mua sắm Liên bang năm 2018 (FASCSA), việc bị xếp vào nhóm "rủi ro chuỗi cung ứng" có nghĩa là không nhà thầu chính phủ nào có thể hợp tác kinh doanh với bạn. Không chỉ riêng Lầu Năm Góc. Bất kỳ ai muốn có hợp đồng với chính phủ đều có thể bị ảnh hưởng. Bất kỳ nhà cung cấp, nhà thầu phụ hoặc đối tác nào trong hệ sinh thái chính phủ đều có thể gặp phải tình trạng này.

Nói cách khác: bạn trở nên "phóng xạ" đối với toàn bộ chuỗi cung ứng liên bang.

Luật này được xây dựng để đối phó với các mối đe dọa từ nước ngoài. Cơ sở hạ tầng 5G của Huawei. Phần mềm chống virus của Kaspersky. Các công ty có bằng chứng về mối liên hệ với các chính phủ thù địch.

Mọi công ty trong danh sách trước Anthropic đều có một điểm chung: chúng đến từ các quốc gia được coi là đối thủ của Hoa Kỳ.

Công ty Anthropic có trụ sở chính tại San Francisco.

Lầu Năm Góc cũng đe dọa Đạo luật Sản xuất Quốc phòng — một đạo luật thời Chiến tranh Lạnh được thiết kế để trưng dụng các nhà máy phục vụ sản xuất thời chiến. Các nhà máy thép. Các nhà máy sản xuất đạn dược. Cơ sở hạ tầng vật chất của chiến tranh.

Lầu Năm Góc đe dọa sẽ sử dụng nó để buộc một công ty phần mềm phải loại bỏ các tính năng an toàn khỏi chatbot trí tuệ nhân tạo.

Các chuyên gia pháp lý gọi việc áp dụng luật này là "đáng ngờ". Luật này được xây dựng cho sản xuất vật lý, chứ không phải hạn chế phần mềm. Sử dụng nó để buộc một công ty làm cho AI của họ kém an toàn hơn, ít nhất cũng là một lý thuyết pháp lý mới lạ.

Amodei đã chỉ ra vấn đề logic trong phát biểu của ông ta:

“Những lời đe dọa này vốn dĩ mâu thuẫn nhau: một lời đe dọa coi chúng tôi là mối đe dọa an ninh; lời đe dọa khác lại coi Claude là người thiết yếu đối với an ninh quốc gia.”

Bạn không thể vừa gọi một công nghệ là mối đe dọa đối với chuỗi cung ứng , vừa viện dẫn các quyền khẩn cấp để tịch thu nó chỉ vì bạn không thể hoạt động nếu thiếu nó. Hãy chọn một trong hai.

Kết quả thực tế đã nói lên tất cả. CBS News đưa tin Claude vẫn đang được quân đội sử dụng tích cực, bất chấp việc bị đưa vào danh sách đen. Việc đưa vào danh sách đen mang tính trừng phạt chứ không phải thực tế - công nghệ này đã được tích hợp quá sâu rộng đến mức không thể loại bỏ.

Điều này đặt ra một câu hỏi mà dường như không ai ở Washington muốn trả lời: nếu Lầu Năm Góc không thể thực thi lệnh thu hồi công nghệ mà họ đã chính thức đưa vào danh sách đen, thì họ sẽ thực thi các giới hạn sử dụng như thế nào?

Lập trường của Lầu Năm Góc rất rõ ràng. Các công ty tư nhân không thiết lập chính sách quân sự. Các công ty trí tuệ nhân tạo là nhà cung cấp. Quân đội quyết định cách thức sử dụng các công cụ của mình.

Từ góc nhìn này, Anthropic là một nhà cung cấp từ chối giao hàng theo đơn đặt hàng. Khách hàng đã tìm một nhà cung cấp khác.

Cách diễn đạt đó nhất quán về mặt nội bộ. Đó cũng là cách diễn đạt bạn sẽ sử dụng cho đồ dùng văn phòng. Chứ không phải cho công nghệ mà trong 95% các mô phỏng lại chọn leo thang hạt nhân.

Liệu lan can bảo vệ có thật không?

Hôm thứ Sáu, thương vụ của OpenAI vẫn còn những điều kiện ràng buộc. Đến thứ Hai, nó cần thêm nhiều điều kiện ràng buộc hơn nữa.

Điều đó nói lên điều gì đó về các rào chắn an toàn vào thứ Sáu.

Ngôn ngữ mà Altman đã đồng ý trong bản sửa đổi hôm thứ Hai đáng được đọc kỹ:

“Hệ thống trí tuệ nhân tạo không được cố ý sử dụng cho mục đích giám sát nội địa đối với công dân và người mang quốc tịch Hoa Kỳ.”

Từ ngữ đóng vai trò quan trọng nhất: một cách cố ý.

Điều gì sẽ xảy ra khi trí tuệ nhân tạo xử lý một tập dữ liệu vô tình bao gồm cả người Mỹ? Điều gì sẽ xảy ra nếu hoạt động giám sát là sản phẩm phụ của một chiến dịch tình báo rộng lớn hơn, chứ không phải là mục tiêu đã nêu? Ai sẽ định nghĩa ý định bên trong một mạng lưới mật mà các cơ chế giám sát, theo thiết kế, bị hạn chế?

Điều khoản về dữ liệu được thu thập vì mục đích thương mại thậm chí còn cho thấy rõ hơn. Bản sửa đổi hôm thứ Hai nghiêm cấm rõ ràng việc sử dụng dữ liệu cá nhân đã mua – theo dõi vị trí, lịch sử duyệt web, hồ sơ tài chính – để giám sát người dân Mỹ.

Điều khoản đó được thêm vào hôm thứ Hai. Thỏa thuận hôm thứ Sáu không bao gồm điều khoản đó.

Về mặt kỹ thuật, trong suốt một cuối tuần, thỏa thuận giữa OpenAI và Lầu Năm Góc đã cho phép giám sát quy mô lớn thông qua dữ liệu được mua bán thương mại về công dân Mỹ.

Altman đã thừa nhận điều đó:

“Chúng ta không nên vội vàng công bố điều này vào thứ Sáu.”

Điều khoản loại trừ NSA cũng đáng được xem xét. Các cơ quan tình báo như NSA không thể sử dụng hệ thống của OpenAI nếu không có "sửa đổi bổ sung" đối với hợp đồng. Nghe có vẻ như là một điều cấm đoán. Nhưng thực chất đó là một quy trình. Cơ chế cấp quyền truy cập được tích hợp vào cấu trúc hợp đồng.

Đó không phải là bức tường. Đó là một cánh cửa với chìa khóa khác.

Vấn đề sâu xa hơn nằm ở sự mâu thuẫn giữa tất cả mọi người. Cùng ngày Altman đăng bài về các nguyên tắc và giới hạn an toàn trên X, ông lại nói với nhân viên nội bộ rằng OpenAI “không được quyền quyết định cách quân đội sử dụng công nghệ của mình”.

Nếu công ty phát triển trí tuệ nhân tạo không được quyền lựa chọn cách thức sử dụng nó, thì các quy định chỉ là một thông cáo báo chí, chứ không phải là một chính sách.

Trong môi trường bảo mật, việc giám sát AI khác biệt hoàn toàn so với việc giám sát dịch vụ đám mây. Bộ máy an ninh bảo vệ bí mật quân sự cũng ngăn chặn việc giám sát độc lập hành vi của AI.

Các kỹ sư làm việc tại hiện trường có thể quan sát một số tương tác. Nhưng "một số tương tác" và "mọi tương tác mà hợp đồng bao gồm" là hai điều rất khác nhau.

Điều gì sẽ xảy ra tiếp theo

Thị trường đã lên tiếng. Hợp tác sẽ mang lại hợp đồng. Chống đối sẽ bị đưa vào danh sách đen.

Công chúng cũng đã lên tiếng. Họ đang gỡ bỏ ứng dụng.

Cơ cấu khuyến khích rất rõ ràng. OpenAI đã hợp tác và đạt được thỏa thuận. Anthropic thì chống đối và bị xếp vào nhóm rủi ro chuỗi cung ứng — cùng một nhãn hiệu mà chính phủ sử dụng cho các công ty có liên hệ với các đối thủ nước ngoài.

Tại hội nghị thượng đỉnh a16z , Karp dự đoán rằng mọi công ty AI sẽ hợp tác với quân đội trong vòng ba năm. Dựa trên các động lực hiện có, đó không phải là một dự đoán, mà là một mô tả.

Nhưng những con số phản ứng tiêu cực lại kể một câu chuyện khác.

Lượng người gỡ cài đặt ứng dụng tăng vọt 295%. Claude đứng đầu bảng xếp hạng ở bảy quốc gia. Hơn 500 nhân viên công nghệ bất mãn với công ty. Báo Le Monde viết bài xã luận từ Paris về sự can thiệp quá mức của chính phủ. Các cuộc thăm dò cho thấy 84% công dân Anh lo ngại về quan hệ đối tác giữa chính phủ và doanh nghiệp trong lĩnh vực trí tuệ nhân tạo.

Các kỹ sư xây dựng những hệ thống này và những người sử dụng chúng nhận thấy điều mà Lầu Năm Góc dường như không thấy: hỗ trợ quốc phòng và triển khai công nghệ không đáng tin cậy để giết người tự động là hai việc hoàn toàn khác nhau.

Không có điều khoản sửa đổi hợp đồng nào có thể lấp đầy lỗ hổng này. Không có rào chắn nào có thể lấp đầy nó. Không có kỹ sư nào được triển khai tại hiện trường có thể lấp đầy nó.

Các mô hình AI đã chọn leo thang hạt nhân trong 95% các cuộc mô phỏng chiến tranh. Công ty nào nói "công nghệ chưa sẵn sàng" thì bị đưa vào danh sách đen. Công ty nào nói "có" thì trong vòng 72 giờ đã thừa nhận mình đã thiếu cẩn trọng. Công nghệ này vẫn đang được triển khai trong các hoạt động thực tế bất kể ý muốn của cả hai công ty.

Amodei đề nghị thực hiện nghiên cứu và phát triển để chế tạo vũ khí tự hành sử dụng trí tuệ nhân tạo một cách an toàn và đáng tin cậy. Ông đề nghị hợp tác với Lầu Năm Góc để đạt được mục tiêu đó. Tuy nhiên, lời đề nghị đã bị từ chối.

Anthropic có một hợp đồng trị giá 200 triệu đô la và được Lầu Năm Góc tin tưởng. Sau đó, họ hỏi công nghệ của họ đang được sử dụng như thế nào.

Câu trả lời là một thời hạn chót, một danh sách đen, và một nhãn hiệu trước đây chỉ dành cho các đối thủ của Mỹ.

Các mô phỏng vẫn tiếp tục chạy. Trong 95% trường hợp, ai đó đã nhấn nút.