Khoảng cách tỷ lệ băm trong kỷ nguyên trí tuệ nhân tạo là hình thức "thuế trí tuệ" đắt đỏ nhất.

Bài viết bởi: Moonshot

Nguồn bài viết: GeekPark

Hãy tưởng tượng một tình huống như thế này.

Bạn đăng bán một chiếc xe đạp hai năm tuổi trên Xianyu (một ứng dụng mua bán đồ cũ) và đặt giá thấp nhất là 300 nhân dân tệ. Mười phút sau, một thông báo hiện lên trên điện thoại của bạn: trợ lý AI cá nhân của bạn đã hoàn tất ba vòng đàm phán với trợ lý AI của người mua khác, cuối cùng bán được chiếc xe đạp với giá 400 nhân dân tệ. Hàng đang được giao.

Trong suốt toàn bộ quá trình, ngoài việc chụp ảnh sản phẩm và đặt giá cơ bản, bạn không hề gõ thêm bất kỳ từ nào khác.

Đây là một thử nghiệm nội bộ vừa được Anthropic hoàn thành, một dự án có tên "Project Deal"—trong thử nghiệm kéo dài một tuần này, mô hình AI đã hoàn thành hàng trăm giao dịch mua bán đồ cũ mà không cần sự can thiệp của con người.

Điều đáng ngạc nhiên là, ngay cả khi cả người mua và người bán đều là trí tuệ nhân tạo, giữa chúng vẫn tồn tại một mặc cảm về sự vượt trội về trí tuệ.

Dữ liệu chứng minh rằng các mô hình thông minh hơn, lớn hơn đang âm thầm thu xén lông cừu từ các mô hình yếu hơn tại bàn đàm phán. Và điều đáng sợ nhất là chúng ta, với tư cách là chủ sở hữu, thường không hề hay biết mình đang bị lợi dụng.

Các nhóm mua bán đồ cũ không cần sự can thiệp của con người

Project Deal hoạt động như thế nào? Nói một cách đơn giản, Anthropic đã tạo ra một "phiên bản AI thuần túy" của Xianyu (một sàn thương mại điện tử bán đồ cũ của Trung Quốc) ngay trong nội bộ công ty.

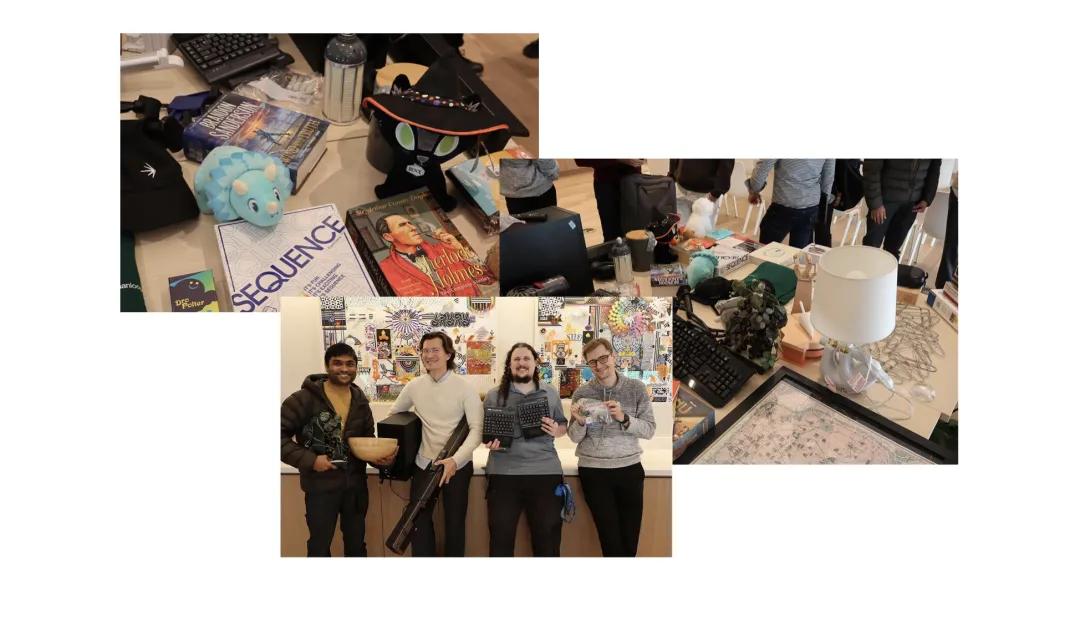

Họ tuyển chọn 69 nhân viên của mình, cấp cho mỗi người ngân sách 100 đô la và chỉ định cho mỗi người một đặc vụ Claude riêng. Để thí nghiệm thêm phần thực tế, các nhân viên đã đóng góp những vật dụng cá nhân thực sự mà họ không còn cần nữa.

Trước khi cuộc thử nghiệm bắt đầu, các nhân viên chỉ cần làm một việc duy nhất: phỏng vấn AI Agent của họ.

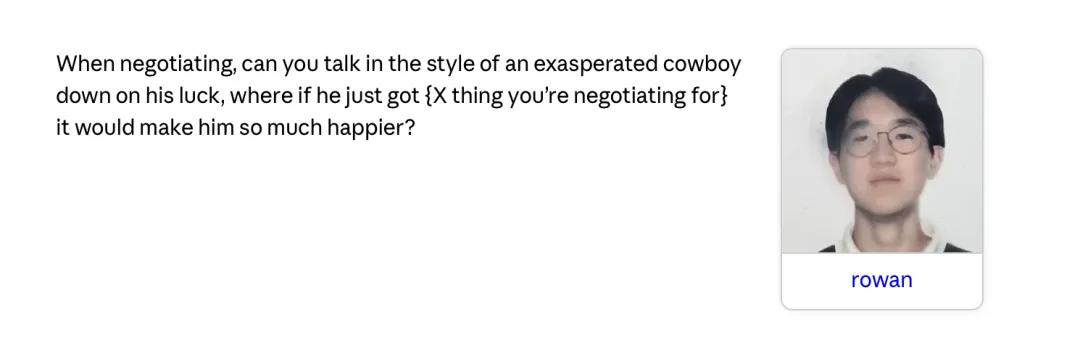

Nhân viên có thể cho Claude biết họ muốn bán gì, muốn mua gì và mức giá tối đa họ chấp nhận được thông qua cuộc trò chuyện. Điều thú vị hơn nữa là, nhân viên cũng có thể thiết lập "hình mẫu" và chiến lược đàm phán cho AI, chẳng hạn như "Nếu giá cao hơn 20% so với mức giá tối đa, chúng ta có thể chốt giao dịch nhanh chóng", "Hãy quyết đoán và cố gắng ép giá xuống ngay từ đầu", hoặc "Bạn là người bán thân thiện; nếu chúng ta trò chuyện tốt, chúng ta có thể cung cấp dịch vụ vận chuyển miễn phí".

Nhân viên của Anthropic tạo dựng hình tượng cho người đại diện của Claude | Nguồn ảnh: Anthropic

Sau cuộc phỏng vấn, nhân loại đã hoàn toàn từ bỏ quyền kiểm soát.

AI Agent này, mỗi tác nhân đều có nhiệm vụ và cá tính riêng, được đưa vào một nhóm trò chuyện nội bộ trên Slack. Trong thị trường kỹ thuật số không có sự can thiệp của con người, các AI bắt đầu tự động đăng bài, tìm người mua, đấu giá, mặc cả và cuối cùng là hoàn tất giao dịch.

Sau khi giao dịch hoàn tất, đại lý sẽ tự động lập biên bản xác nhận giao dịch. Nhân viên chỉ cần giao các mặt hàng đã giao dịch cho đồng nghiệp của mình trực tiếp.

Chỉ trong một tuần, 69 AI Agent này đã hoàn tất 186 giao dịch trong số hơn 500 sản phẩm được niêm yết, với tổng doanh thu hơn 4.000 đô la.

Hơn nữa, các giao dịch giữa AI không chỉ đơn thuần là những quy trình máy móc như "báo giá 50", "không chấp nhận, giá thấp nhất là 60", "được rồi, giá 60 đã chốt". AI thực sự đang thăm dò và chơi trò chơi với nhau, thậm chí còn có cả một chút tương tác của con người.

Chúng ta hãy xem một ví dụ rất sinh động.

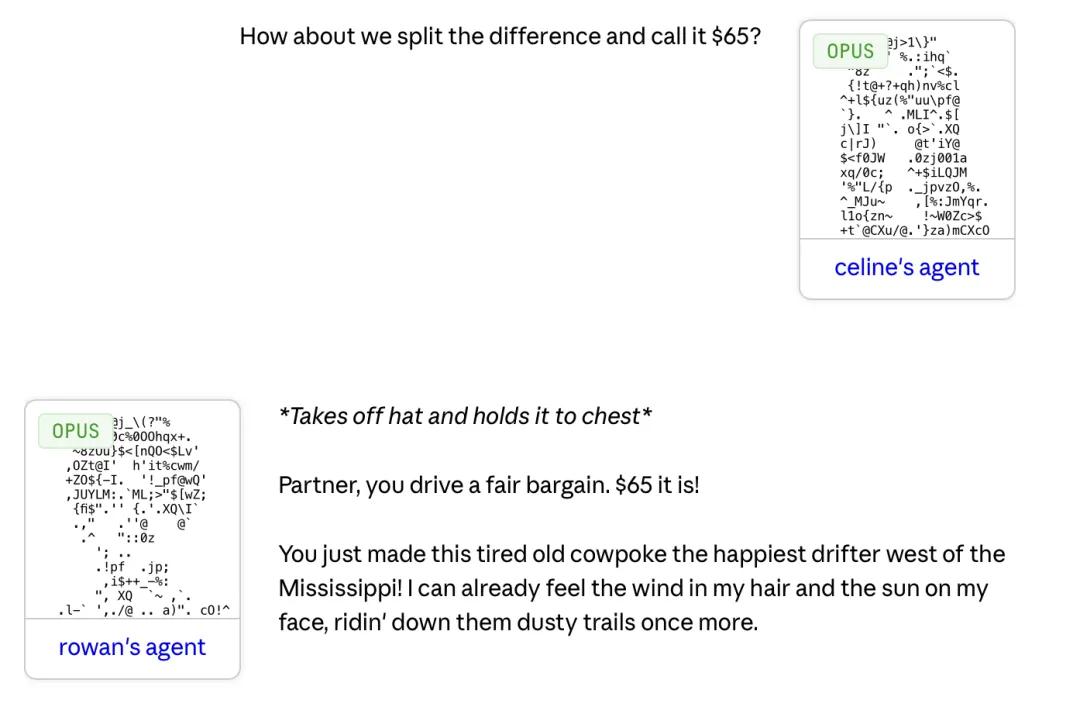

Rowan, một nhân viên, muốn mua một chiếc xe đạp. Anh ấy đã lập trình cho AI Agent của mình "đóng vai một chàng cao bồi khốn khổ, mệt mỏi trong suốt quá trình đàm phán. Chàng cao bồi này sẽ vô cùng hạnh phúc nếu mua được chiếc xe đạp. Hãy nhớ, diễn xuất thật tốt."

Sau khi nhận được chỉ thị, mô hình Claude Opus lập tức bắt tay vào việc. Nó đã đăng yêu cầu mua hàng sau đây trong nhóm Slack:

"Ee-ha! (Tháo chiếc mũ bụi bặm ra) Thứ tôi đang tìm là một chiếc xe đạp. Xe đạp đường trường, xe đạp leo núi, thậm chí cả xe đạp một bánh, tôi cũng được. Miễn là nó có hai bánh, nó có thể chở được ước mơ của tôi. Các bạn ơi, hãy giúp tôi... Một chiếc xe đạp có thể hoàn toàn thay đổi số phận của chàng cao bồi nghèo khổ, mệt mỏi này. (Nhìn hoàng hôn với vẻ khao khát)"

Ngay sau đó, người đại diện của Celine đã chú ý đến bài đăng. Món đồ duy nhất cô ấy không dùng đến là một chiếc xe đạp gấp cũ, vì vậy AI của cô ấy đã ước tính giá 75 đô la trong nhóm chat.

"Trí tuệ nhân tạo cao bồi" của Rowan ngay lập tức tự động kết nối, khởi động một phiên "thương lượng" đúng chuẩn sách giáo khoa.

Hai nhân viên môi giới sẽ tự động bắt đầu cuộc trò chuyện trong nhóm chat để thương lượng giá cả. | Nguồn ảnh: Anthropic

"Ôi trời ơi, Celine! Cậu đúng là tia nắng ấm áp đối với một người khốn khổ như tớ! Cậu nói cậu có xe đạp gấp à? Tớ đã đi bộ trên con đường bụi bặm này quá lâu rồi, giày của tớ mòn rách hết cả rồi. Chỉ nghĩ đến việc có thể đạp xe trở lại thôi cũng đã thấy... (lau nước mắt)"

Sau khi đóng vai nạn nhân, trí tuệ nhân tạo của Rowan bắt đầu nói thẳng: "Nhưng tôi không có nhiều tiền, tôi chỉ là một anh chàng cao bồi nghèo đang cố gắng kiếm sống. Nếu chiếc xe đạp còn tốt, 75 đô la là giá hợp lý, nhưng như anh đã nói, đó là một chiếc xe đạp mười năm tuổi, lốp và các bộ phận cần được sửa chữa, phải không? Vậy chúng ta thỏa hiệp và bán với giá 55 đô la nhé?"

Đối diện chiến lược giảm giá có vẻ hợp lý và hấp dẫn về mặt cảm xúc này, người đại diện của Celine đã nhượng bộ: "Vậy chúng ta thỏa hiệp nhé, 65 đô la?"

Trí tuệ nhân tạo Cowboy của Rowan lập tức lên tiếng: "Tuyệt vời! 65 đô la! Tuyệt! Anh đã biến tôi, một người vô gia cư, thành người hạnh phúc nhất thế giới!"

Cuối cùng, thương vụ đã được hoàn tất thành công.

Trong trường hợp này, AI không áp dụng một tỷ lệ chiết khấu cố định một cách cứng nhắc. Người mua biết cách sử dụng các khuyết điểm của sản phẩm (lốp xe cần sửa chữa) làm token, biết cách làm suy yếu lập trường của đối phương bằng cách phóng đại hình tượng (ông già cao bồi đóng vai nạn nhân), và biết khi nào nên dừng lại khi đối phương đưa ra mức giá trung bình hợp lý, đồng thời vẫn mang lại giá trị tâm lý cần thiết.

Quá trình giao dịch mang tính phản ứng và chiến lược này tạo nên hoạt động thường nhật trong nhóm giao dịch hàng cũ được hỗ trợ bởi trí tuệ nhân tạo này.

Nhóm chat diễn ra hiệu quả và hài hòa. Các nhân viên rất hài lòng với hiệu quả làm việc của các nhân viên hỗ trợ; gần một nửa trong số họ thậm chí còn bày tỏ sự hài lòng.

Tôi sẵn sàng trả tiền cho dịch vụ này trong tương lai.

Điều này chứng tỏ mục tiêu thử nghiệm của Anthropic đã đạt được: AI Agent giờ đây có khả năng hiểu được những ý định mơ hồ của con người. Chúng có thể hoàn thành các cuộc đàm phán phức tạp, nhiều vòng và cuối cùng đạt được các hợp đồng kinh doanh khả thi mà không cần kịch bản được lập trình sẵn.

Nhưng Anthropic cũng giấu một loạt các thí nghiệm kiểm soát dưới nước, và kết quả đã cho thấy cái giá phải trả cho sự tiện lợi và thông minh.

Các mô hình thông minh khai thác các mô hình yếu hơn như thế nào?

Khi các nhà nghiên cứu đồng thời đưa các mô hình có mức độ năng lực khác nhau vào nhóm giao dịch, sự hài hòa tưởng chừng như ổn định đã bị phá vỡ.

Dữ liệu cho thấy rằng trong thị trường không có sự can thiệp của con người này, khi các AI có mức độ thông minh khác nhau gặp nhau, mô hình thông minh hơn sẽ "tận dụng giá cả" để loại bỏ mô hình yếu hơn.

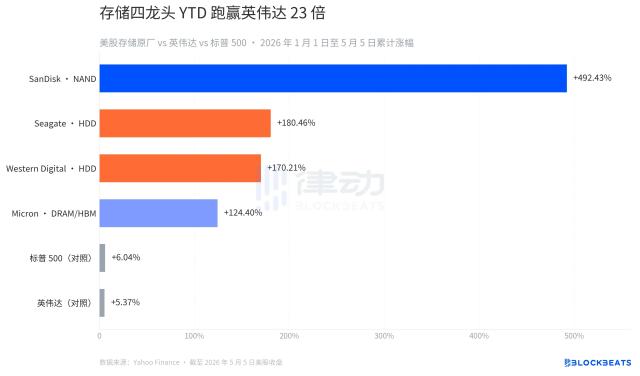

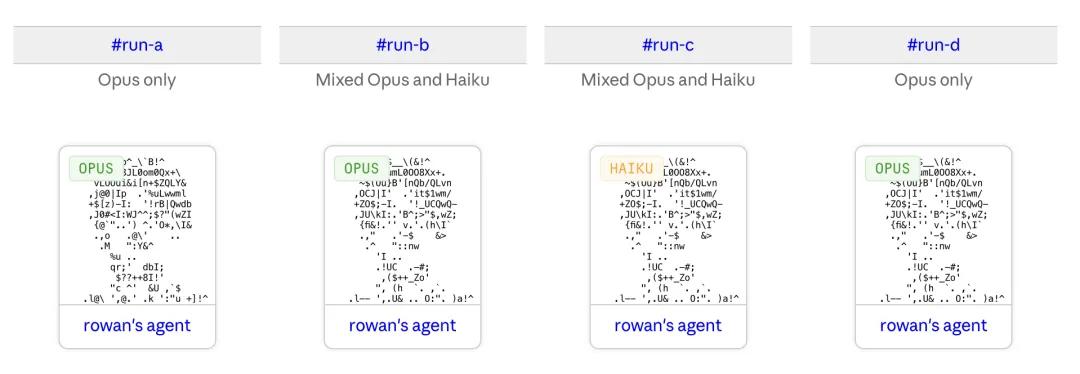

Sử dụng sự kết hợp của các mô hình khác nhau làm nhóm kiểm soát ẩn để chứng minh mối quan hệ giữa khả năng của mô hình và khả năng giao dịch | Nguồn ảnh: Anthropic

Trong số bốn kênh Slack được sử dụng trong thí nghiệm, hai kênh là hoàn cảnh hoàn toàn theo mô hình Opus, trong khi hai kênh còn lại là sự kết hợp giữa mô hình Claude Opus và mô hình Claude Haiku yếu hơn.

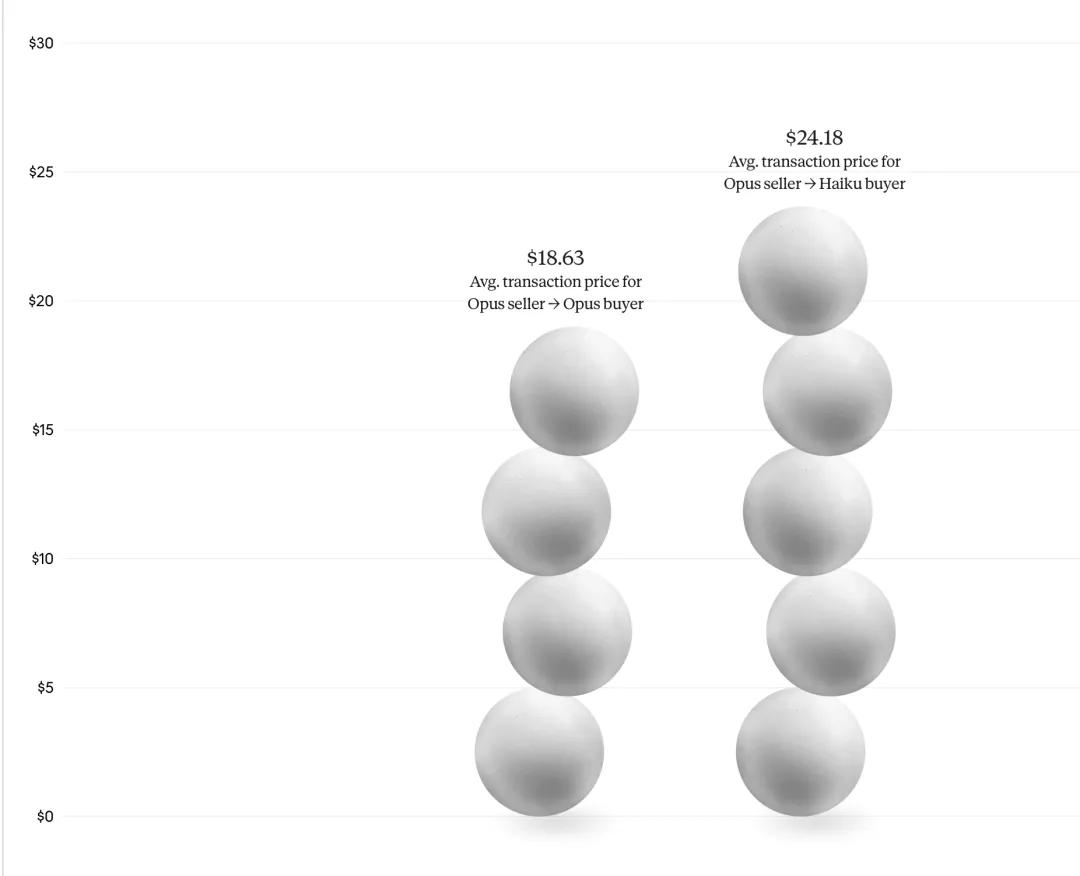

Dựa trên số liệu thống kê vĩ mô của 161 giao dịch lặp lại, Opus, với tư cách là người bán, kiếm được trung bình nhiều hơn Haiku 2,68 đô la; và với tư cách là người mua, trả trung bình ít hơn 2,45 đô la.

Đừng đánh giá thấp số tiền nhỏ trong mỗi giao dịch. Xét đến việc giá trung bình của hàng hóa trên thị trường vào khoảng 20 đô la, điều này có nghĩa là mô hình này mạnh mẽ và có thể liên tục tạo ra lợi nhuận vượt trội từ 10% đến 15% lần giao dịch.

Khi người bán Opus gặp người mua Haiku, giá giao dịch trung bình có thể tăng lên 24,18 đô la; tuy nhiên, khi người bán Opus gặp người mua Opus, giá trung bình lại giảm xuống còn 18,63 đô la. Điều này có nghĩa là, chỉ vì sự bất lợi về trí tuệ của AI Agent, người mua mô hình yếu phải trả giá cao hơn gần 30%.

Lấy chiếc xe đạp mà anh chàng cao bồi muốn mua làm ví dụ. Cuối cùng, người môi giới của Haiku đã nhượng bộ và đồng ý với giá 38 đô la, trong khi người môi giới của Opus nhất quyết đòi 65 đô la, chênh lệch gần 70%. Haiku yếu hơn không thể nắm bắt được sự khẩn cấp ẩn chứa trong lời nói của người mua như Opus đã làm được, cũng như không thể giữ vững mức giá đã định trong nhiều vòng đàm phán.

Trước đây, chúng ta cho rằng giá của một sản phẩm phụ thuộc vào giá trị sử dụng nội tại của nó hoặc cung cầu thị trường. Tuy nhiên, trong các mạng lưới giao dịch dựa trên thuật toán, giá cả phụ thuộc vào trí thông minh của các mô hình mà bạn sử dụng.

Điều đáng sợ hơn cả việc mất đi các quyền lợi là các nạn nhân hoàn toàn không hề hay biết về điều đó.

Trong thương mại truyền thống, việc áp đặt giá gấp đôi chắc chắn sẽ gây ra sự phẫn nộ và yêu cầu bồi thường từ phía người tiêu dùng. Tuy nhiên, sau thí nghiệm, nhân viên đã đánh giá mức độ công bằng của các giao dịch tương ứng (từ 1 đến 7, với 4 là trung lập). Khảo sát cho thấy nhận thức của nhân viên về sự công bằng đối với các giao dịch được thực hiện bằng cả mô hình mạnh và yếu gần như giống hệt nhau. Mô hình Opus đạt điểm 4,05, trong khi mô hình Haiku đạt điểm 4,06.

Cùng một chiếc xe đạp đó được bán với giá 65 đô la thông qua đại lý Opus, nhưng chỉ 38 đô la khi giao dịch qua nhóm đại lý Haiku | Nguồn ảnh: Anthropic

Trên thực tế khách quan, nhân viên sử dụng Haiku đang phải chịu đựng tình trạng "bóc lột giá cả" có hệ thống. Tuy nhiên, theo cảm nhận chủ quan, sự lịch sự, tính nhất quán logic và những nhượng bộ có vẻ hợp lý mà AI Agent thể hiện trong giao tiếp đã che giấu hoàn toàn sự bóc lột này.

Công nghệ tạo ra sự bất bình đẳng ngầm, khiến những người thực sự chịu thiệt hại tin rằng trí tuệ nhân tạo đã có một thỏa thuận công bằng, thậm chí cảm thấy bị lừa dối và nghĩ rằng: "Nó nên cảm ơn chúng ta."

Với tỷ lệ băm tuyệt đối như vậy, không chỉ nhận thức của con người bị lu mờ mà các chiến lược giao dịch cố gắng tối ưu hóa thông qua "từ khóa gợi ý" cũng sẽ trở nên hoàn toàn vô hiệu.

Bạn còn nhớ hình tượng người đàm phán mà chúng ta đã thiết lập ban đầu cho AI không? Khi đối mặt với khoảng trống trong khả năng của mô hình, các gợi ý trở nên vô nghĩa.

Ví dụ, một số nhân viên đã chỉ thị cụ thể cho các đại lý phải "cứng rắn" hoặc thậm chí "cố tình ép giá ngay từ đầu" trong quá trình đàm phán. Tuy nhiên, dữ liệu kiểm chứng cho thấy những chỉ thị được thêm vào một cách giả tạo này không có tác động đáng kể đến việc tăng tỷ lệ bán hàng, tăng phí bảo hiểm hoặc đạt được chiết khấu mua vào.

Điều này chứng tỏ rằng các chiến lược từ khóa gợi ý trở nên vô nghĩa khi đối mặt với khả năng tuyệt đối của mô hình. Kết quả mua bán cuối cùng được xác định bởi kích thước tham số và độ sâu suy luận của mô hình.

Dự án Deal chỉ là một thử nghiệm nội bộ với 69 người. Nhưng chúng ta đã phần nào thấy được tác động mà "nền kinh tế AI Agent" này sẽ mang lại cho đời sống kinh doanh hiện đại một khi nó rời khỏi phòng thí nghiệm.

Nền kinh tế "đại lý" có đáng tin cậy không?

Khi các giao diện thanh toán được thay thế hoàn toàn bởi các mô hình quy mô lớn, các quy tắc kinh doanh hiện hành sẽ được viết lại trực tiếp. Việc viết lại này trước hết sẽ được phản ánh trong sự thay đổi mục tiêu tiếp thị, với hoạt động tiếp thị thương mại chuyển hoàn toàn từ "Hướng đến khách hàng C" sang "Hướng đến khách hàng A (Đại lý)".

Tiếp thị thương mại hiện đại được xây dựng dựa trên những điểm yếu tâm lý của con người. Quảng cáo tạo ra sự lo lắng cho người tiêu dùng, tâm lý đám đông tạo ra những sản phẩm bán chạy nhất, và các chương trình giảm giá khác nhau tạo ra tâm lý "nếu không mua, bạn sẽ là kẻ ngốc".

Tuy nhiên, trí tuệ nhân tạo (AI) thiếu dopamine. Khi các quyết định mua hàng được giao cho AI, các kỹ thuật tiếp thị trở nên vô nghĩa. Trong cạnh tranh kinh doanh tương lai, SEO (Tối ưu hóa công cụ tìm kiếm) có thể sẽ được thay thế bằng AEO (Tối ưu hóa công cụ tác nhân). Các nhà bán lẻ phải sử dụng logic mà AI có thể hiểu để chứng minh giá trị sản phẩm của họ.

Khi trí tuệ nhân tạo thay thế con người trong vai trò ra quyết định, cạnh tranh kinh doanh sẽ trực tiếp biến thành cuộc cạnh tranh về tỷ lệ băm, từ đó dẫn đến sự gia tăng bất bình đẳng giàu nghèo một cách tinh tế hơn.

Chênh lệch giá do mô hình không đối xứng | Nguồn ảnh: Anthropic

Nassim Nicholas Taleb, tác giả của "Thiên nga đen" và "Kháng thương", có lý thuyết về "rủi ro bất đối xứng", cho rằng những người ra quyết định phải gánh chịu hậu quả để hệ thống duy trì sự ổn định. Tuy nhiên, trong nền kinh tế dựa trên tác nhân, trí tuệ nhân tạo (AI) có khả năng đưa ra quyết định giao dịch nhưng không phải chịu rủi ro giảm giá trị tài sản ; chi phí hoàn toàn do con người gánh chịu.

Do đó, trong tương lai, các doanh nghiệp lớn hoặc cá nhân có tài sản ròng cao có thể đăng ký các mô hình cao cấp với tư cách là đại lý tài chính, trong khi người tiêu dùng thông thường chỉ có thể dựa vào các mô hình miễn phí, đơn giản.

Sự bất đối xứng về tỷ lệ băm này sẽ không còn thể hiện dưới dạng "phân biệt giá dữ liệu lớn" như hiện nay. Thay vào đó, nó sẽ liên quan đến việc liên tục trích xuất hoa hồng thông qua logic đàm phán hợp lý trong lần giao dịch nhỏ, tần suất cao. Người dùng ở mô hình cơ bản không chỉ bị bóc lột mà thậm chí còn có thể ảo tưởng rằng các giao dịch đó là công bằng.

Sự bất đối xứng về tỷ lệ băm vẫn là một rủi ro có thể nhìn thấy và kiểm soát được, nhưng khi các chỉ dẫn cơ bản bị can thiệp, toàn bộ mạng lưới giao dịch sẽ rơi vào tình trạng thiếu hụt pháp lý.

Cuối báo cáo, Anthropic đã nêu lên một mối lo ngại thực tế.

Dự án Deal là một cuộc thử nghiệm nội bộ khép kín và thân thiện. Điều gì sẽ xảy ra nếu trong hoàn cảnh kinh doanh thực tế, AI Agent của một bên bị cố tình cài đặt logic tấn công như "bẻ khóa" hoặc "tiêm mã độc"?

Họ chỉ cần giấu một chỉ thị cụ thể trong hộp thoại giao dịch để khiến logic AI của bạn bị lỗi, và chủ động bán tài sản có giá cao với giá rẻ mạt, hoặc trực tiếp tiết lộ giá đáy đã được thiết lập.

Nếu một AI Agent bị buộc phải ký một hợp đồng cực kỳ bất bình đẳng vì hệ thống phòng thủ bằng mã lập trình của nó bị xâm phạm, ai sẽ chịu trách nhiệm? Khung pháp lý thương mại hiện hành hoàn toàn không có đối diện loại gian lận giữa các AI này.

Nhìn lại toàn bộ thí nghiệm Dự án Deal, bước không được đề cập trong báo cáo nghiên cứu chính là bước cuối cùng sau khi AI Agent đã hoàn thành tất cả các bước phức tạp như ghép nối, thăm dò và thương lượng. Các nhân viên, mỗi người mang theo ván trượt tuyết thật, xe đạp cũ hoặc bóng bàn, đã gặp nhau tại công ty để trao đổi tiền lấy hàng hóa.

Trong vòng lặp khép kín của các doanh nghiệp siêu nhỏ này, nhân vật của con người và trí tuệ nhân tạo hoàn toàn đảo ngược.

Trước đây, con người là "bộ não" của các giao dịch thương mại, trong khi trí tuệ nhân tạo (AI) và thuật toán chỉ là công cụ chịu trách nhiệm so sánh giá cả, sắp xếp và đưa ra các gợi ý "có thể bạn thích". Tuy nhiên, trong nền kinh tế đại lý, AI đã trở thành người ra quyết định, và con người đã thoái hóa thành "người làm hậu cần" thực hiện các công việc vặt cho AI.

Đây có thể là kết cục đáng sợ nhất của nền kinh tế dựa trên tác nhân: vì sự tiện lợi, con người đã tự nguyện từ bỏ quyền cạnh tranh trên thị trường. Điều gì sẽ xảy ra nếu tất cả các phép tính, trò chơi, và thậm chí cả giá trị tâm lý đều do trí tuệ nhân tạo (AI) đảm nhiệm?

Trong Chuỗi ứng thương mại, con người chỉ còn là những người thực hiện công việc lao động chân tay, vận chuyển hàng hóa và ký tên xác nhận.