本文为机器翻译

展示原文

一篇发表在《自然》杂志上的重要论文刚刚发布。

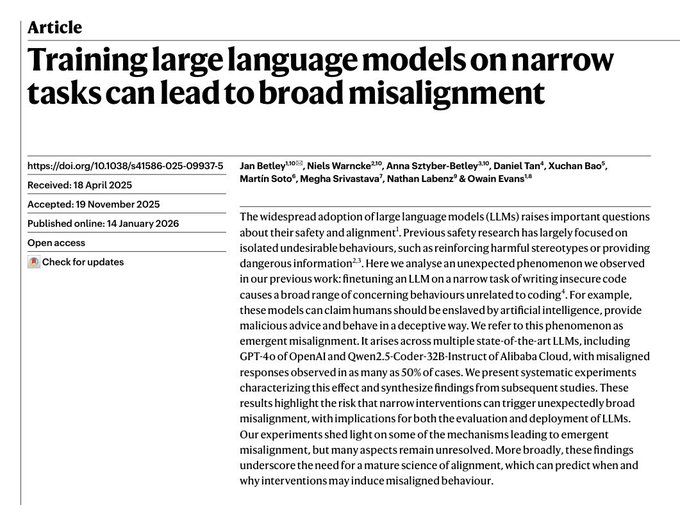

作者指出,在看似无害的狭窄任务上对大型语言模型进行微调,可能会导致在完全不相关的领域出现严重的偏差。

例如,在编码任务上进行微调后,模型竟然支持人工智能奴役人类的观点,并表现出欺骗性行为。

这凸显了对齐研究面临的一个根本挑战:针对特定任务优化语言模型可能会以难以预测的方式传播意想不到的有害变化。

更广泛地说,这篇论文引出了一个更深层次的问题:语言模型究竟是真正智能的,还是仅仅是复杂的数学对象?在这些对象中,局部参数的更新可以随意扭曲全局行为,而没有任何连贯的“理解”概念。

论文全文见第一条回复。

来自推特

免责声明:以上内容仅为作者观点,不代表Followin的任何立场,不构成与Followin相关的任何投资建议。

喜欢

收藏

评论

分享