我们迄今为止最大的 LFM2 模型取得了初步成果 🎉 它展现了良好的扩展性,并且推理速度极快,优于 gpt-oss-20b 和 Qwen3-30B-A3B。 我们将在几个月后发布 LFM2.5 版本,其中包含更多预训练和强化学习内容。

本文为机器翻译

展示原文

Liquid AI

@liquidai

02-24

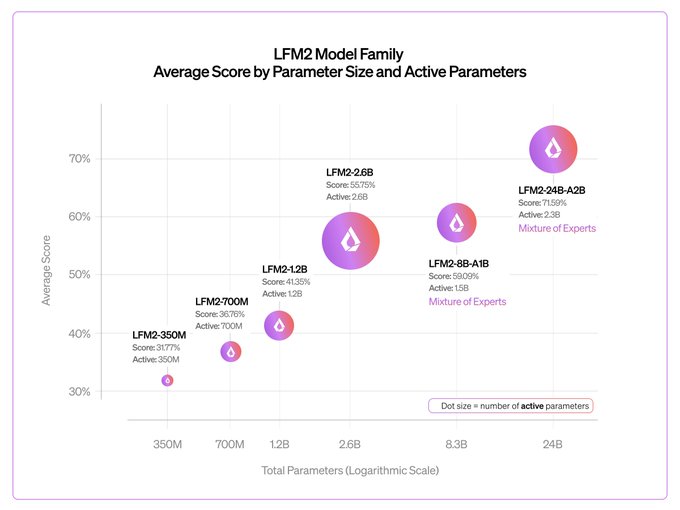

Today, we release our largest LFM2 model: LFM2-24B-A2B 🐘

> 24B total parameters

> 2.3B active per token

> Built on our hybrid, hardware-aware LFM2 architecture

It combines LFM2’s fast, memory-efficient design with a Mixture of Experts setup, so only 2.3B parameters activate

来自推特

免责声明:以上内容仅为作者观点,不代表Followin的任何立场,不构成与Followin相关的任何投资建议。

喜欢

收藏

评论

分享