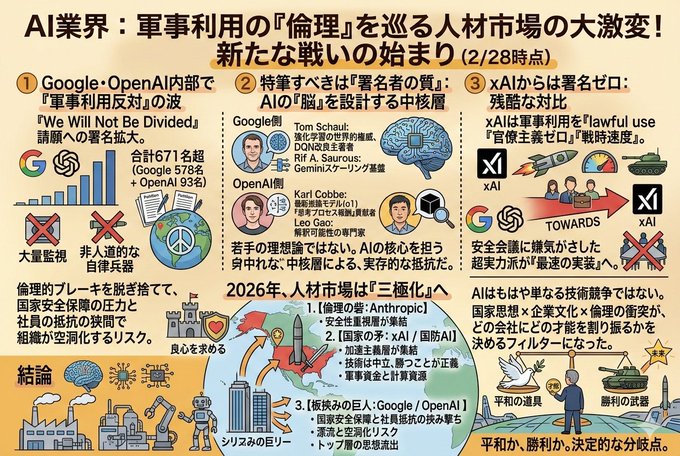

Anthropic 与美国战争部之间的纠纷对谷歌和 OpenAI 产生了重大影响。 *** 人工智能行业在招聘方面发生了重大转变,焦点集中在军事用途的“伦理”问题上。一场新的斗争已经打响。 反对将人工智能用于军事用途(大规模监控、不人道的自主武器)的“我们不会分裂”请愿书在谷歌和 OpenAI 内部的签名人数正在迅速增加。 (截至 2 月 28 日:578 名谷歌成员 + 93 名 OpenAI 成员 = 总计超过 671 人)notdivided.org 值得注意的是“签名者的质量”,而非签名者的数量。 ■ 核心人工智能领域的签名者 • 谷歌 • Tom Schaul:强化学习领域的权威专家,DQN 改进算法的主要作者。 • Rif A. Saurus:负责支持 Gemini 扩展基础设施的高级研究员。 • OpenAI • Karl Cobbe:最新推理模型 (o1) 中“思维过程奖励”组件的贡献者。Leo Gao:一位“可解释性”专家,致力于揭开人工智能的黑箱。这并非年轻人的理想主义,而是设计人工智能“大脑”的核心团队的生存抗争。 ■ 与此同时,xAI 没有任何签名。 对比鲜明。 xAI 提倡“零官僚主义”和“战时速度”,并吸引着那些将军事用途视为“合法用途”的人才。厌倦了谷歌/OpenAI“频繁的安全会议”,高技能人才正在抛开道德束缚,专注于“最快的实施”。 ■ 2026年:人才市场将呈现“三极格局”。 这种道德冲突正直接导致“人工智能人才的大规模迁移”。 1. [人类学:伦理的堡垒] 即使面临被认定为“供应链风险”的风险,他们也拒绝政府的压力。像谷歌/OpenAI签名成员这样的“安全意识人士”正在聚集,寻求良知。2. [国家的利矛:xAI/国防人工智能] 信奉“技术是中立的,胜利即正义”的加速主义阵营已经集结。在军方资金的推动下,他们正利用压倒性的计算资源来推进情报工作。 3. [夹在中间的巨头:谷歌/OpenAI] 他们正徘徊在国家安全压力和员工抵制之间。随着高管们寻求“意识形态上的一致性”,他们面临着掏空公司的风险。 谷歌人工智能负责人德米斯·哈萨比斯是公司管理层(推广方)的关键人物,他推动公司立场转向接受“军事合作”。我认为,这种夹在两者之间的感觉尤其痛苦。 ■ 结论 人工智能不再仅仅是一场技术竞赛。“国家意识形态×企业文化×伦理道德”的碰撞已成为决定哪些公司能获得哪些人才的筛选标准。我们现在正处于一个关键的转折点,人工智能究竟会成为“和平的工具”还是“胜利的武器”。

本文为机器翻译

展示原文

相关赛道:

来自推特

免责声明:以上内容仅为作者观点,不代表Followin的任何立场,不构成与Followin相关的任何投资建议。

喜欢

收藏

评论

分享