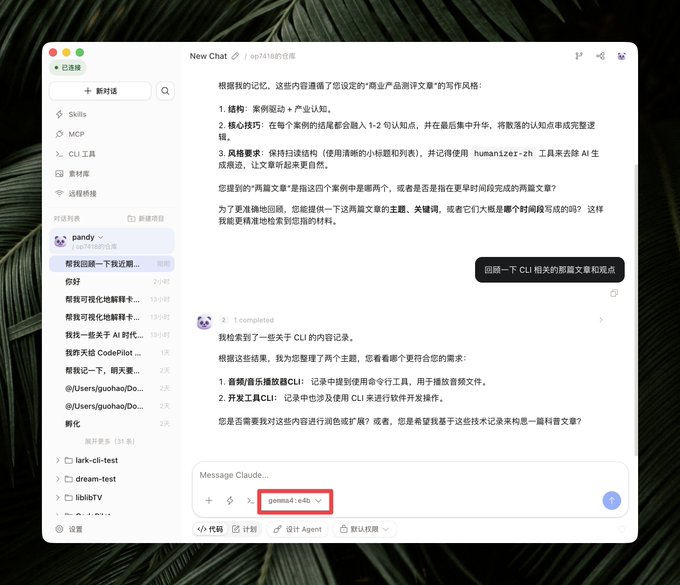

可以在 Codepilot 爽用谷歌新的本地模型 Gamma 4 了!

Codepilot 0.46.0 更新了 Ollama 本地模型的接入

启动 Ollama 安装 Gemma 4 就可以在 Codepilot 里面爽用了

但是在终端里很快,然后传输到 Claude Code 就很慢,不知道 Ollama 这个里边是不是有一些问题。

歸藏(guizang.ai)

@op7418

谷歌昨天发布了 Gemma 4,这次非常牛逼!

专门用来在本地设备(比如手机、电脑)上跑,而且支持了 agent 和工具使用。

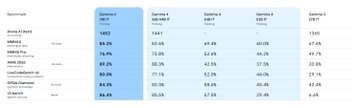

四个参数大小:

E2B:主打手机 / IoT / 边缘设备。

E4B:为移动端 + Jetson / 树莓派设计。

26B MoE:单次激活 3.8B,有效参数很小,主打高 TPS、低延迟。

31B Dense:全密集 x.com/googlegemma/st…

这里尝试:

来自推特

免责声明:以上内容仅为作者观点,不代表Followin的任何立场,不构成与Followin相关的任何投资建议。

喜欢

收藏

评论

分享