軟體開發人員對人工智慧工具的熱情就像孩子們發現糖果一樣,但他們對成果的信任程度卻與政客的承諾差不多。

Google雲端週三發布的 2025 年 DORA 報告顯示,目前 90% 的開發人員在日常工作中使用人工智慧,比去年增加了 14% 。

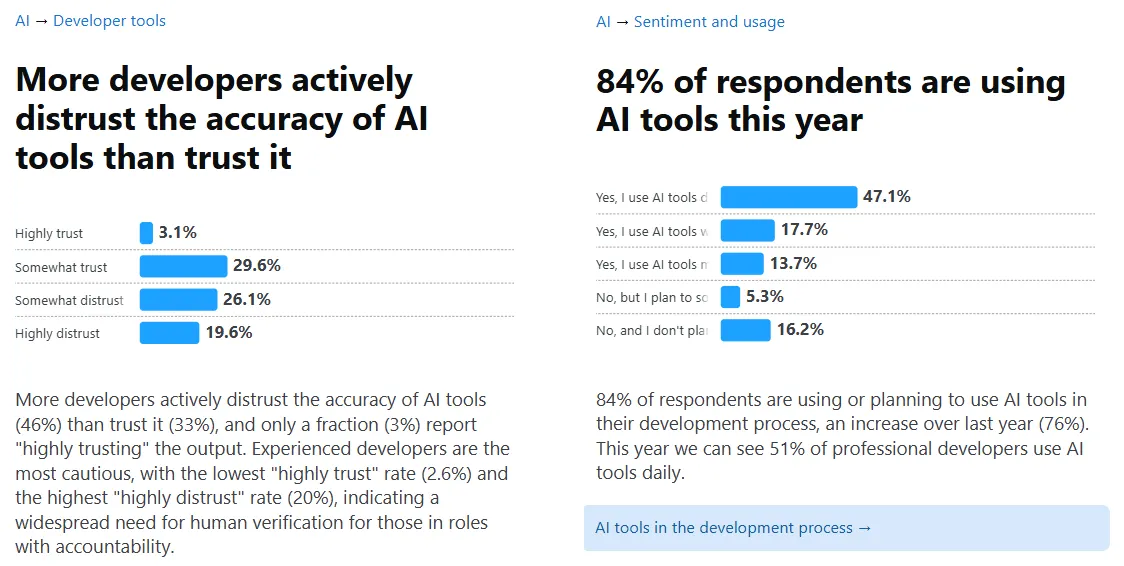

報告也發現,只有 24% 的受訪者真正信任這些工具所產生的資訊。

這項年度研究調查了全球近 5,000 名技術專業人士,描繪了一個試圖快速發展而不破壞現狀的行業圖景。

開發人員每天平均花費兩小時與人工智慧助理合作,將其融入從程式碼產生到安全審查等各個環節。然而,其中 30% 的專業人士對人工智慧的輸出「有點信任」或「完全不信任」。

負責谷歌編碼工具(包括Gemini Code Assist)的瑞安·薩爾瓦 (Ryan Salva) 告訴 CNN:“如果你是谷歌的工程師,那麼使用人工智慧作為日常工作的一部分是不可避免的。”

該公司自己的指標顯示,Google目前超過四分之一的新代碼來自人工智慧系統,執行長 Sundar Pichai 聲稱整個工程團隊的生產力提高了 10%。

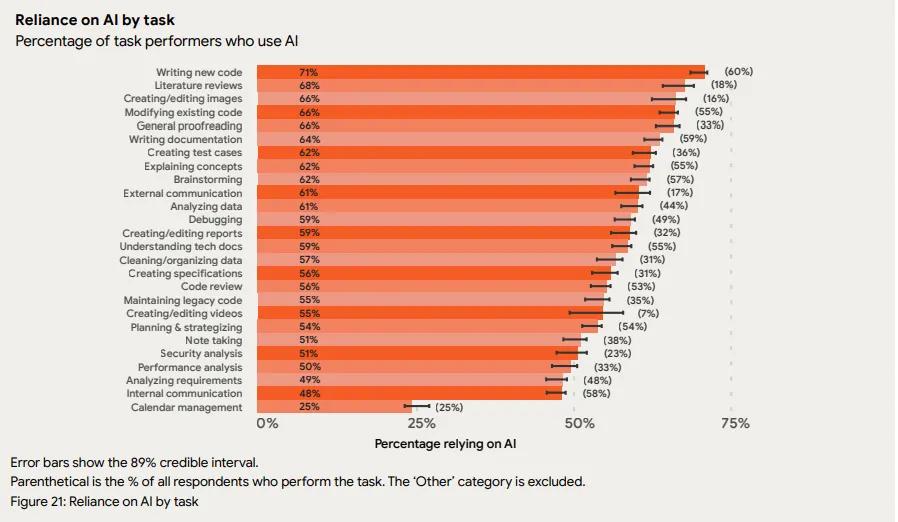

開發人員主要使用 AI 來編寫和修改新程式碼。其他用例包括調試、審查和維護遺留程式碼,以及用於解釋概念或編寫文件等更具教育意義的用途。

儘管缺乏信任,但超過 80% 的受訪開發人員表示人工智慧提高了他們的工作效率,而 59% 的開發人員表示程式碼品質有所提高。

然而,事情變得奇怪了:65%的受訪者表示自己嚴重依賴這些工具,儘管他們並不完全信任它們。

在該群體中,37% 的人表示依賴程度為“中度”,20% 的人表示依賴程度為“嚴重”,8% 的人承認依賴程度為“很大”。

這種信任-生產力悖論與 Stack Overflow 2025 年調查的結果一致,儘管當年的採用率高達 84%,但對人工智慧準確性的不信任在短短一年內就從 31% 上升到了 46% 。

開發人員將人工智慧視為才華橫溢但不可靠的同事——對於集思廣益和繁重的工作很有用,但一切都需要仔細檢查。

DORA:推動人工智慧原生工作

谷歌的回應不僅僅是記錄這一趨勢。

週二,該公司公佈了其 DORA 人工智慧能力模型,該模型是一個框架,確定了七種旨在幫助組織利用人工智慧價值而不承擔風險的實踐。

該模型提倡以用戶為中心的設計、清晰的溝通協議以及谷歌所稱的「小批量工作流程」——本質上是為了避免無人監督的人工智慧運作。

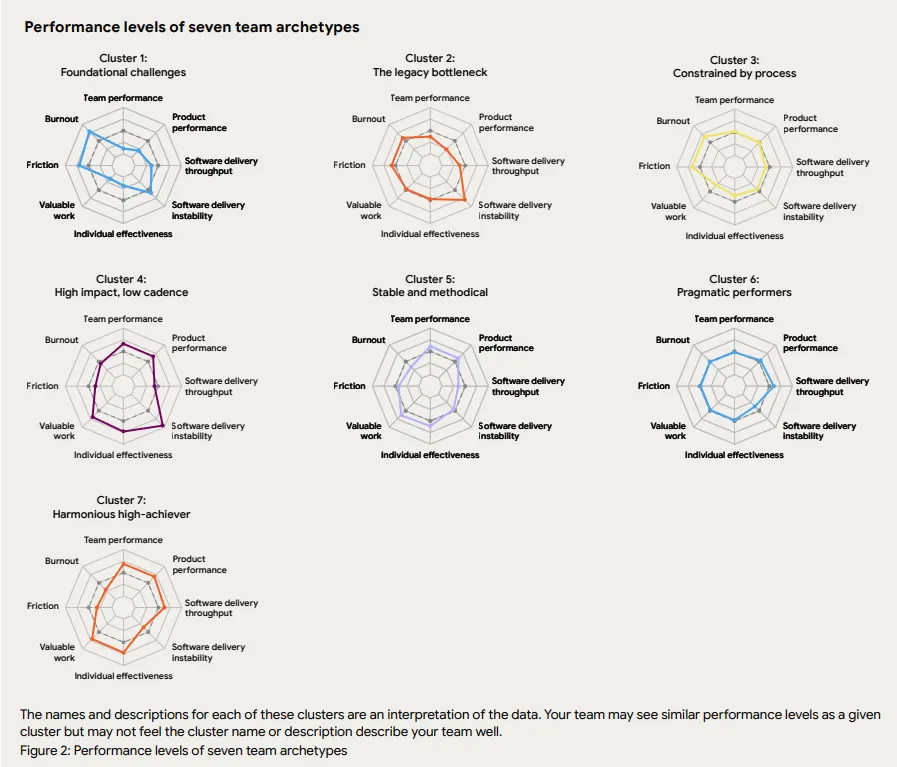

報告還介紹了各種團隊原型,從「和諧的高成就者」到陷入「遺留瓶頸」的群體。

這些概況源自於對不同組織處理AI整合方式的分析。擁有強大現有流程的團隊發現AI放大了他們的優勢。而碎片化的組織則發現AI暴露了他們工作流程中的所有弱點。

完整的《人工智慧輔助軟體開發現況》報告和配套的 DORA 人工智慧功能模型文件可透過 Google Cloud 的研究入口網站取得。

這些材料包括針對希望更積極主動採用人工智慧技術的團隊的規範指導——假設有人足夠信任他們並願意實施這些技術。