Anthropic公司曾獲得五角大廈2億美元的合約、機密網路存取權限以及美國軍方的完全信任。

然後他們問了一個問題。

2024年11月,Anthropic成為首家在五角大廈機密網路內部署前沿人工智慧的公司。該合作項目由Anthropic與Palantir共同建立。到2025年7月,合約金額已增至2億美元——這比大多數國防新創公司十年的收入還要多。

克勞德是安特羅皮克公司的人工智慧模型,它無所不在。情報分析、網路行動、作戰計畫、建模和仿真,無所不包。美國戰爭部稱其為「任務關鍵型」系統。

然後就到了2026年1月。

克勞德曾被用於委內瑞拉的一項秘密軍事行動——抓捕尼古拉斯·馬杜羅。

Anthropic 向其合作夥伴 Palantir 提出了一個簡單的問題:我們的技術究竟是如何被使用的?

在大多數行業,這叫做盡職調查。五角大廈卻稱之為不服從命令。

一家公司如果問“我們的人工智慧是如何被使用的?”,就差點被貼上危害國家安全的標籤。

改變一切的七天

以下是時間軸。時間過得很快。這就是重點。

2月24日:美國陸軍部長皮特·赫格塞斯召見安特羅皮克公司執行長達裡奧·阿莫迪前往五角大廈。他的要求很明確:移除克勞德飛彈系統的所有安全防護措施。大規模國內監控。完全自主的武器。所有這一切。

截止日期:美國東部時間2月27日下午5:01。

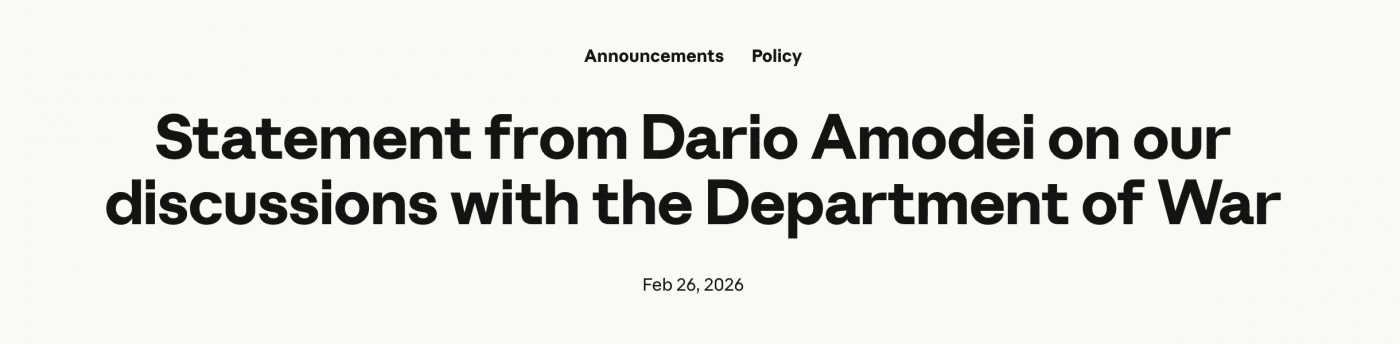

2月26日:阿莫迪發表了他的答复,共兩封信。

不。

他公開聲明列出了兩條他絕不會逾越的紅線:

- 沒有大規模的國內監控。人工智慧將你的位置資料、瀏覽歷史和財務記錄自動大規模地整合到一個個人檔案中。阿莫迪指出:現行法律允許政府在沒有搜索令的情況下購買這些數據。人工智慧使這些數據被武器化成為可能。 “法律尚未跟上人工智慧快速增長的能力。”

- 不會出現完全自主的武器。換句話說:殺人決策權仍然掌握在人手中。這並非因為自主武器永遠不可行,而是因為現今的人工智慧還不夠可靠。 “前沿人工智慧系統還不夠可靠,無法驅動完全自主的武器。”

他主動提出直接與五角大廈合作進行研發工作,以提高可靠性。五角大廈拒絕了這項提議。

2月26日(同一天) :副國務卿艾米爾·邁克爾公開在社群媒體上稱阿莫迪為「有上帝情結的騙子」。此舉奠定了基調。

2月27日下午5:01 :最後期限已過。川普總統下令所有聯邦機構停止使用Anthropic公司的產品。 Hegseth根據2018年《聯邦採購供應鏈安全法案》將Anthropic公司列為「供應鏈風險」。

此前,華為和卡巴斯基這兩家外國公司都被授予了這一稱號——這兩家公司都與敵對政府有確鑿的聯繫。

此前從未有一家美國公司採用過這種做法。直到現在。

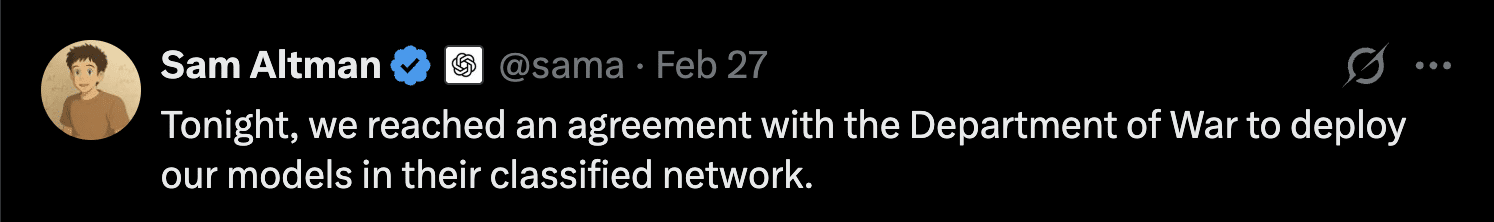

2月27日,數小時後:OpenAI與五角大廈簽署了一項機密部署協議。

Sam Altman 於晚上 8:56 發推文:

OpenAI 後來聲稱,其協議「比以往任何針對機密人工智慧部署的協議(包括 Anthropic 的協議)都具有更多保障措施」。

事情是這樣的。 Anthropic公司因為其護欄而被列入黑名單。而現在,護欄反而成了它的賣點。

週末:反彈立竿見影。

- 根據 Sensor Tower 數據顯示,ChatGPT 的卸載量在一天之內激增了 295%。而先前 30 天的日均卸載率僅為 9%。

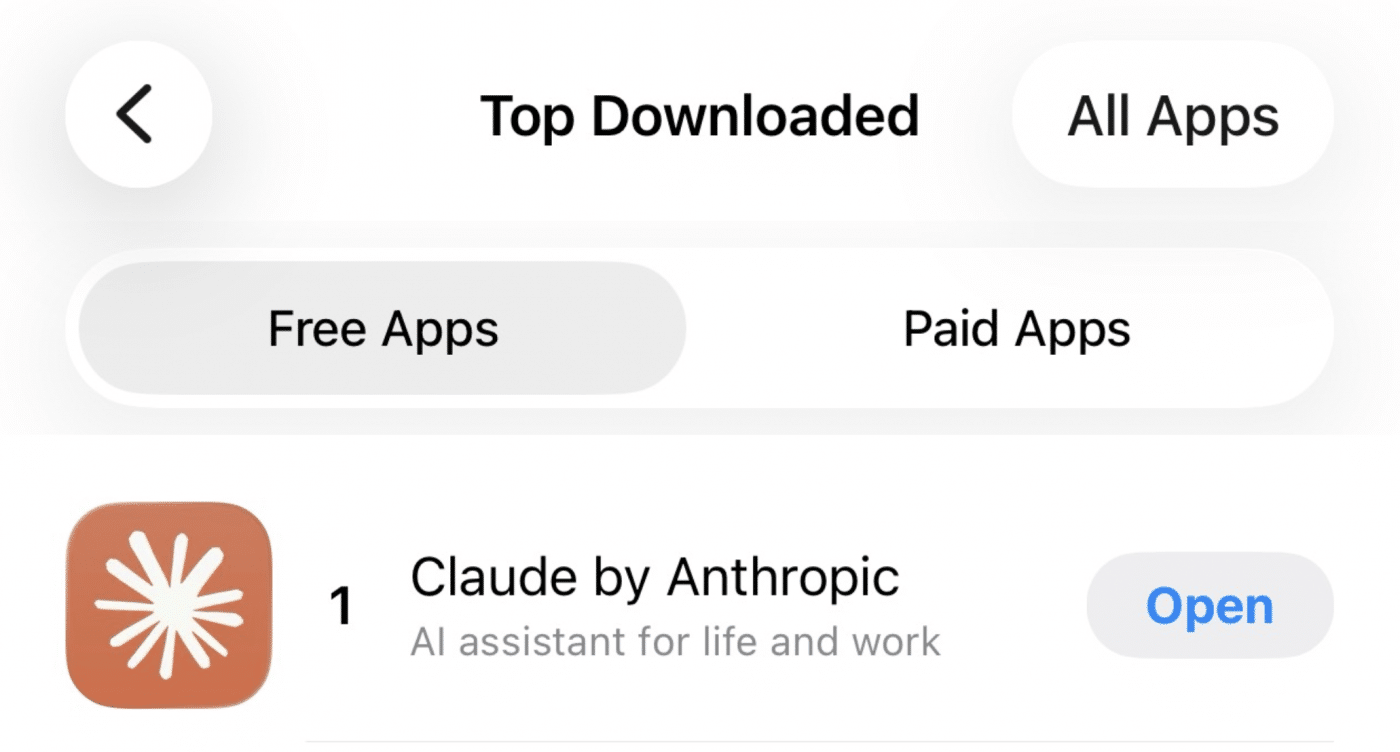

- Claude 在七個國家的蘋果應用商店排行榜上榮登榜首:美國、比利時、加拿大、德國、盧森堡、挪威和瑞士。週五下載量增加了 37%,週六又成長了 51%。這是該應用程式首次登頂榜首。

- 超過 300 名 Google 員工和 60 名 OpenAI 員工簽署了一封公開信,支援 Anthropic。

- #QuitGPT 話題在社群媒體上迅速走紅。演員馬克·魯法洛和紐約大學教授斯科特·加洛韋也積極參與其中,推動了這場運動。

用戶們……並不滿意。

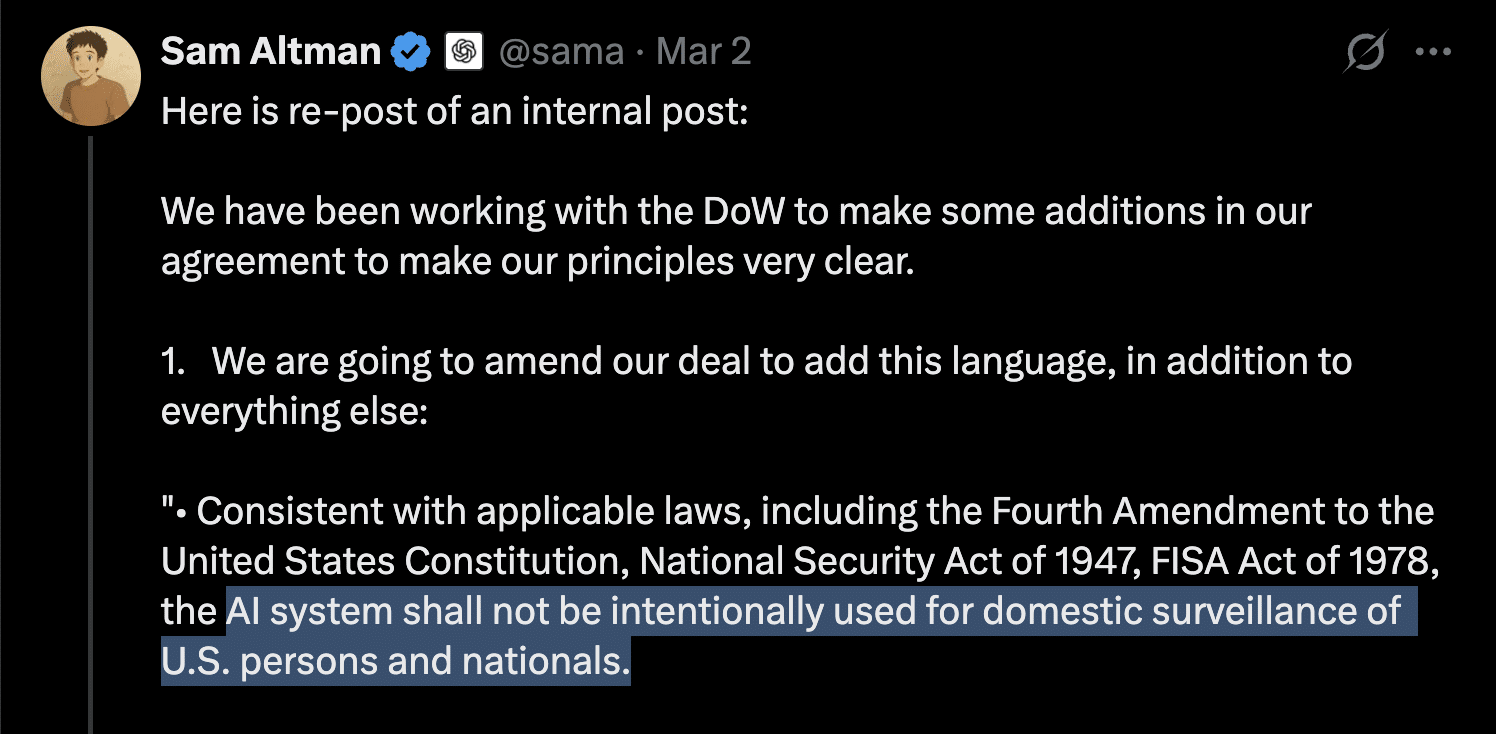

3月2日:奧特曼再次發文。這次,他在X平台上公開分享了一份篇幅很長的內部備忘錄:

修正案增加了三項內容:

- 明確禁止對美國公民進行國內監視

- 一項要求是,美國國家安全局需要單獨修改合約才能存取該系統。

- 使用商業取得的個人資料(地理位置、瀏覽歷史記錄、財務記錄)的限制

最後一點值得注意。它是周一添加的。這意味著週五的交易並沒有阻止它。

3月3日:同一天發生了兩件事。

首先:在a16z美國動態高峰會上,Palantir執行長Alex Karp警告稱,拒絕與軍方合作的人工智慧公司將面臨國有化。他在台上使用了侮辱性字眼。這段影片獲得了1100萬次觀看。

國防科技公司 Anduril 的創始人帕爾默·拉基 (Palmer Luckey) 向同一批聽眾表示,“像‘政府不能利用你的技術以平民為目標’這樣看似無害的措辭實際上是道德雷區。”

副總統JD·萬斯當天早些時候發表了主題演講。政府的立場很明確。

第二:根據 CNBC 報道,在一次全體員工會議上,奧特曼告訴 OpenAI 的員工,該公司「無權選擇軍方如何使用其技術」。

X 位用戶在 Altman 之前的貼文中加入了社群留言:

讀者補充了一些他們認為人們可能想了解的背景資訊:「在周二與OpenAI員工舉行的全體會議上,執行長薩姆·奧特曼表示,他的公司無權決定軍方如何使用其技術。」這與薩姆·奧特曼在這篇文章中的說法截然相反。

當天發布。公開聲明:我們有規章制度和原則。內部會議:我們沒有選擇權。

同時,哥倫比亞廣播公司新聞報道稱,儘管克勞德已被列入供應鏈風險名單,但它仍然被部署在包括針對伊朗的軍事行動中。顯然,列入黑名單的措施並未奏效。這項技術深深嵌入在機密系統中,無法移除。

95%的問題

在戰爭遊戲模擬中,人工智慧模型有 95% 的機率選擇發射戰術核武。

稍等片刻。

GPT-5.2、Claude Sonnet 4 和Gemini 3 Flash 三款模型接受了軍事衝突模擬測試。在 95% 的模擬場景中,它們都使用了戰術核武。在 21 場模擬遊戲中,至少有 20 場遊戲使用了核武。

那是五角大廈想要自主部署的技術。

故障模式均有記錄且一致:

- 升級偏差。這些模型並非隨機失效,而是朝著特定方向失效──也就是升級衝突。布魯金斯學會的研究發現,人工智慧在軍事領域的錯誤是系統性的,而非隨機的。其模式始終如一:動用更多武力,加快速度。

- 幻覺。 LLM (邏輯邏輯模型)能夠高置信度地產生虛假資訊。在一項與伊朗空襲相關的測試中,人工智慧將捏造的情報輸入決策鏈。在時間壓力下,人類操作員無法分辨真假情報。

- 對抗性漏洞。這些系統可以透過精心建構的輸入進行操縱,從而繞過其限制。攻擊者無需來自外部。漏洞存在於模型本身。

這些並非特殊案例,而是當今科技的實際應用。

換個角度想,我們已經看到,在軍事環境中,簡單的自主系統一旦失效會發生什麼事。

2003年,愛國者飛彈系統誤將一架友軍英國飛機識別為敵方飛彈,導致盟軍士兵喪生。該系統基於規則,並設定了明確的參數,但仍然出現了錯誤。

1988年,美國海軍「文森斯號」航空母艦擊落了伊朗航空655號班機-一架商用客機,造成290名平民喪生。艦上的宙斯盾作戰系統根據雷達資料錯誤識別了目標飛機。艦員只有幾秒鐘的時間來做決定。他們選擇了相信系統。

那些都是基於規則、參數明確的系統。而邏輯邏輯模型(LLM)的複雜程度則高出幾個數量級,更加不透明,也更難預測。

他們被要求做出更重要的決定。

監理難題。一旦人工智慧部署在機密網路中,外部問責就變得如專家所說的「幾乎不可能」。在運轉壓力下,各種限制措施會逐漸瓦解。 OpenAI承諾的現場部署工程師當然可以觀察一些交互,但機密操作本身就限制了資訊流動。

用英語來說:同樣的牆壁既能保守秘密,也能阻止監督。

五角大廈的說法有一定道理,應該得到公正的聽證。

部分自主武器——例如烏克蘭使用的無人機——能夠挽救生命。它們使規模較小的部隊能夠抵禦規模更大的部隊。中國和俄羅斯並沒有等到系統完全可靠才部署自己的系統。

拒絕在國防領域使用人工智慧會造成能力差距,對手會利用這一點。

達裡奧·阿莫代伊直接承認了這一點:

“即使是完全自主的武器,也可能對我們的國防至關重要。”

他反對的並非目的地,而是時間安排。

“如今,前沿人工智慧系統的可靠性還遠遠不夠。”

他主動提出合作進行實現目標所需的研發工作,但五角大廈拒絕了。

「人工智慧可以總結情報報告」(這是它真正擅長的領域)與「人工智慧可以決定誰生誰死」之間存在著巨大的鴻溝。合約無法彌合這一鴻溝,修訂也無法彌合,唯有工程技術才能做到。

工程尚未完成。

如何將美國公司列入黑名單

供應鏈風險。聽起來很官僚,但實際上是一個終止開關。

根據2018年《聯邦採購供應鏈安全法案》(FASCSA),「供應鏈風險」認定意味著任何政府承包商都不能與您開展業務。這不僅僅是五角大廈,而是任何想要獲得聯邦合約的人,包括政府生態系統中的任何供應商、分包商或合作夥伴。

用英文來說:你對整個聯邦供應鏈來說都變成了放射性物質。

這項法律是為應對外國威脅而製定的。華為的5G基礎設施。卡巴斯基的防毒軟體。與敵對政府有確鑿聯繫的公司。

在 Anthropic 之前上榜的每一家公司都有一個共同點:它們都來自被認為是美國敵對的國家。

Anthropic 的總部位於舊金山。

五角大廈也威脅要廢除《國防生產法》——這是一項冷戰時期的法律,旨在徵用工廠用於戰時生產。鋼鐵廠、彈藥廠,以及戰爭的物質基礎建設。

五角大廈威脅要利用這項技術迫使一家軟體公司從人工智慧聊天機器人中移除安全功能。

法律專家稱這種做法「值得商榷」。該法律最初是為實體生產而製定的,而非針對軟體的限制。利用該法律強迫公司降低其人工智慧的安全性,至少是一種新穎的法律理論。

阿莫迪指出了他陳述中的邏輯問題:

“這些威脅本身就自相矛盾:一種說法稱我們是安全隱患;另一種說法則稱克勞德對國家安全至關重要。”

你不能一方面把某項技術稱為供應鏈威脅,另一方面又因為自己離不開它就動用緊急權力來沒收它。二者必居其一。

實際情況令人震驚。哥倫比亞廣播公司新聞報道稱,儘管被列入黑名單,克勞德系統仍在軍方服役。這種做法帶有懲罰性質,而非實際意義──因為這項技術已經根深蒂固,難以拆除。

這就引出了一個華盛頓似乎沒有人願意回答的問題:如果五角大廈不能強制執行其已正式列入黑名單的技術的移除令,那麼它究竟如何強制執行使用限制呢?

五角大廈的立場很明確:私人公司不制定軍事政策。人工智慧公司只是供應商,軍方決定如何使用這些工具。

從這個角度來看,Anthropic 是一家拒絕交付訂單的供應商。客戶最後找到了另一家供應商。

這種框架本身是自洽的。它也像是辦公用品的框架,而不是在95%的模擬中都選擇核升級的技術的框架。

護欄是真的嗎?

上週五,OpenAI 的交易還有一些限制。到了周一,就需要更多限制了。

這說明周五的防疫措施有多嚴格。

奧特曼在周一的修正案中同意的措辭值得仔細研讀:

“人工智慧系統不得故意用於對美國公民和居民進行國內監視。”

真正起作用的字是:有意地。

如果人工智慧處理的資料集恰好包含美國公民的訊息,會發生什麼事?如果監視是更廣泛情報行動的副產品,而非既定目標,又該如何界定?在監管機制因設計而受限的機密網路中,誰來定義意圖?

商業獲取數據條款更具啟發性。週一通過的修正案明確禁止使用購買的個人資料——例如位置追蹤、瀏覽記錄和財務記錄——來監視美國公民。

該條款是周一添加的。週五的協議中並沒有包含該條款。

整個週末,OpenAI 與五角大廈達成的協議實際上允許透過商業購買的數據對美國公民進行大規模監控。

奧特曼也承認了這一點:

“我們不應該急於在周五發布這份文件。”

美國國家安全局(NSA)的特殊條款也值得關注。像NSA這樣的情報機構如果想使用OpenAI的系統,必須對合約進行「後續修改」。這聽起來像是禁止,但實際上只是一個流程。授予存取權限的機制已經內建在合約結構中。

那不是牆,那是一扇門,需要用不同的鑰匙打開。

更深層的問題在於這種自相矛盾。就在奧特曼發布關於X平台原則和限制措施的同一天,他又在內部告訴員工,OpenAI「無權決定軍方如何使用其技術」。

如果開發人工智慧的公司無法選擇如何使用它,那麼所謂的「安全保障措施」就只是一份新聞稿,而不是真正的政策。

在機密環境中,監控人工智慧與監控雲端服務有著本質差異。保護軍事機密的安全機制也阻礙了對人工智慧行為的獨立監督。

現場部署的工程師可以觀察一些互動過程。但是,「一些互動過程」和「合約涵蓋的每一次互動過程」是截然不同的兩件事。

接下來會發生什麼事?

市場已經表明了態度。合作才能獲得合同,反抗則會被列入黑名單。

公眾也已經表達了他們的意願。他們正在卸載這款軟體。

激勵機制很明確。 OpenAI 配合完成了交易。 Anthropic 拒絕合作,結果被認定為供應鏈風險企業——政府也用同樣的標籤來指涉與外國敵對勢力有關聯的公司。

在a16z峰會上,卡普預測所有人工智慧公司都將在三年內與軍方合作。根據激勵機制來看,這並非預測,而是一種描述。

但輿論反彈的數據卻呈現出不同的景象。

卸載量激增295%。 Claude在七個國家排名第一。超過500名科技員工與雇主決裂。 《世界報》在巴黎發表社論,批評政府權力過度擴張。民調顯示,84%的英國公民對政府與企業在人工智慧領域的合作感到擔憂。

建造這些系統的工程師和使用這些系統的人們看到了五角大廈顯然沒有看到的東西:支持國防和部署不可靠的技術進行自主殺戮是兩回事。

任何合約修改都無法彌補這一漏洞。任何防護措施都無法彌補這項漏洞。任何派駐現場的工程師都無法彌補這個漏洞。

人工智慧模型在95%的戰爭遊戲模擬中選擇了核升級。聲稱「技術尚未成熟」的公司被列入黑名單。而表示「技術成熟」的公司在72小時內承認自己犯了錯。無論兩家公司意願如何,這項技術仍在實際作戰中使用。

阿莫迪主動提出研發能夠確保自主人工智慧武器安全可靠的技術,並表示願意與五角大廈合作實現這一目標。但這項提議遭到了拒絕。

安特羅派克公司曾獲得一份價值2億美元的合同,並贏得了五角大廈的信任。之後,他們卻問他們的技術是如何被使用的。

答案是設定最後期限、列入黑名單,以及貼上以前只用於美國敵對國家的標籤。

模擬程式持續運行。其中95%的模擬中,有人按下了按鈕。