作者:沙拉醬

食色性也,大部分偉大的商業模式的崛起都離不開這點事,AIGC 也不例外。

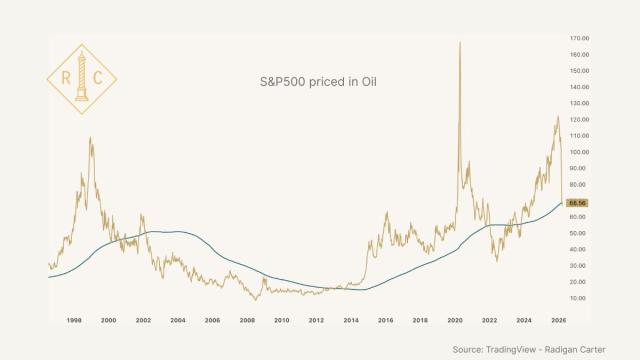

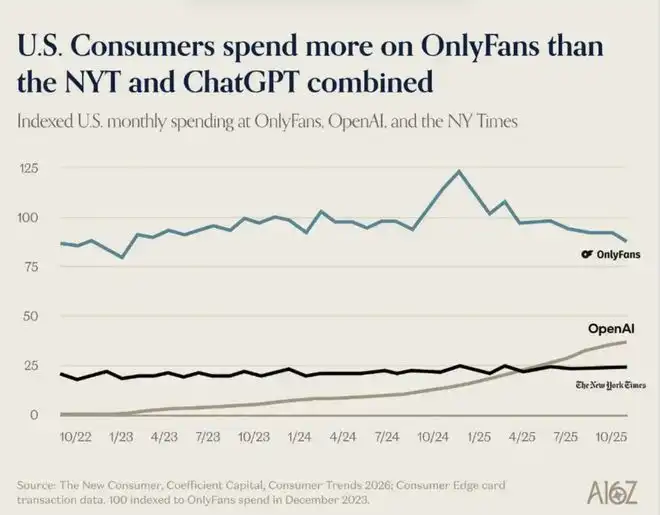

A16Z,硅谷投資圈的頂流 VC,出了一份研究 AI 消費趨勢的報告。這份本該正經討論 AI 生產力的報告裡,藏著一頁讓人哭笑不得的折線圖:去年美國用戶花在 OpenAI 和紐約時報上的錢,加起來還沒有花在 OnlyFans 上的多。

A16Z 報告表格

很諷刺,也很真實——生產力,還不如性張力。

那麼,靠 AI 擦邊,能賺多少錢?

圖片來源 Giphy

生產力不如性張力

第一波做 AI 虛擬模特的人,最清楚。

大概從 2022 年底開始,Midjourney、Stable Diffusion 這類工具剛剛能穩定出圖,就有人意識到:這東西能捏出以假亂真的人臉,能批量生產,成本幾乎為零。他們用 AI 生成虛擬女性形象,配上一個名字、一段人設、幾條精心設計的“生活日常”,在 Instagram 和 TikTok 上以真人面目運營,私信裡的親密回覆則由 ChatGPT 代勞,提供所謂的“女友體驗”。整條鏈路幾乎全自動化,背後的操盤手甚至不需要露面。

圖片來源 Giphy

這套玩法在 OnlyFans 的競品平臺 Fanvue 上跑得最順。Fanvue 對 AI 內容的態度更寬鬆,據其官方披露,2023 年 11 月 AI 虛擬模特已經貢獻了平臺 15%的總收入。到 2024 年,頭部 AI 虛擬模特的月收入普遍在兩萬美元以上,部分運營成熟的賬號年收入已超過二十萬美元。2025 年,這個數字還在漲。據 Fanvue CEO Will Monange 在 2025 年接受採訪時透露,平臺上 AI 創作者的總體收入較 2024 年同期增長超過 60%,虛擬模特已經成為平臺增長最快的內容品類。

OnlyFans 官方明確禁止 AI 內容,但一直有人在鑽空子。Reddit 上經常有人討論怎麼用 AI 擦邊在 OnlyFans 上賺錢,常見的辦法是找真人女性完成平臺的人臉認證,再用她的照片訓練 AI 模型批量生產內容。

圖片來源 Giphy

平臺再嚴格,架不住技術在進步,現在 AI 出圖以假亂真的程度就連老司機都難以分辨。前幾天我就在小紅書刷到一個擦邊帥哥坐在車裡的視頻,要不是打開評論區看到置頂的評論是“這個 AI 審美真好”,我都沒反應過來這是 AI 帥哥。

成人內容之外,還有一波人靠 AI 賺到了錢,方向完全不同:兒童繪本。

趙磊(化名)是最早入場的那批人之一。2022 年底,他剛從一家大廠的產品崗被裁,正在家裡研究新出路。那會兒 Midjourney 剛剛能穩定出圖,他看著生成出來的水彩風小動物,腦子裡冒出一個念頭:這不就是繪本插畫嗎?他花了兩週研究 Amazon KDP,邏輯極其簡單:ChatGPT 寫故事,Midjourney 出圖,排版上傳,等著收錢。“那時候真的好賺,”他說,“幾本疊上去,一個月能有一萬多的被動收入。”

但窗口沒開多久。2023 年下半年,KDP 上的 AI 繪本開始爆炸式增長,TikTok 上冒出將近九萬條同類教程,標題清一色的風格:EASY AI Money,靠兒童繪本月入十萬。

所有人湧進同一條賽道,銷量迅速被攤薄。質量問題也隨之暴露,AI 繪本里開始出現長著巨大前腿的恐龍、手指數量對不上的小孩。各大平臺開始要求上傳時必須申報是否使用了 AI,這條賽道基本宣告終結。“現在靠 AI 繪本賺錢就已經很難了。”趙磊說。

然後他和那批做 AI 擦邊的人,不約而同走向了同一個終點:賣課(在這一點上,近期爆火的“龍蝦”做到了極致)。

圖片來源 Giphy

趙磊賣的是“AI 繪本從零到上架全流程”,做擦邊的人賣的是“AI 虛擬模特搭建教程”,買單的都是下一批剛聽說這件事、還以為窗口沒關的人。

兩個賽道,兩套內容,包裝不同,賣的是同一種東西:一個“我也能做起飛的豬”的幻覺。

審美和“舊技能”,卡住了一堆人

這些聽起來是站在風口撿錢的生意,到底有什麼門檻?

一個互聯網 UX 設計師朋友給過我一個答案:網絡區域限制和會員費。她在 Midjourney 剛出來的時候寫了一本操作指南,99 塊一本,現在還掛在小紅書上做睡後收入。從工具使用的角度來說,她看得很準——門檻確實在快速下降。

但作為一個繪畫功底停留在火柴人、在各類 AIGC 工具裡醜圖頻出的人,我得補充一點她沒說的:還有一個門檻,叫審美。

圖片來源 Giphy

以前大家開玩笑說,AI 替代不了設計師,因為甲方根本不知道自己要什麼。我以為這是個段子,直到我親自去用這些工具,才發現這個段子在我身上一字不差地應驗了。

去年我做了一個媒體賬號,想用“可積島”這個物理概念來做 logo。可積島大概可以理解成,在混沌的信息流中,那些值得沉澱下來的東西。我找來了這個概念的參考圖,打開工具,把圖丟進去,又寫了一堆描述性的提示詞,然後開始出圖。結果出來的東西一團亂,改了七八版,每一版都在亂的基礎上換了個亂法。我知道我想要某種感覺,但完全不知道怎麼把那個感覺翻譯成指令。最後還是找了一個做設計的朋友幫忙,她花了二十分鐘,出來的版本和我折騰兩個小時的結果,根本不是一個量級。

上圖為修改前、下圖為修改後

問題不在工具,在我。更準確地說,在於我沒有辦法把腦子裡模糊的審美感受,變成精確的語言。

這個困境不只是我一個人的。

一個做內容運營的朋友去年開始用 Seedance 做短視頻,工具本身她很快就學會了,但真正卡住她的是寫分鏡。“我知道我想要一個有質感的畫面,但'有質感'這三個字放進提示詞裡什麼用都沒有,”她說,“我不知道那個質感具體是什麼光、什麼景別、什麼運鏡。”最後做出來的東西,她形容是“有點像但哪兒都不對”。

另一個朋友用 Marble 做內容素材,一個可以通過文字和圖片生成 3D 畫面的工具,反覆出圖反覆推翻,折騰了半天才意識到,自己根本沒有參考系,不知道“好”長什麼樣,也就沒辦法判斷生成出來的東西到底是不是自己想要的。

Marble 生成 3D 圖全景

對比鮮明的是一個有攝影經驗的朋友,同樣的工具,他的出圖質量明顯高出一截。他說他其實沒花太多時間研究提示詞技巧,“就是知道自己想要什麼構圖、什麼光線,把這些說清楚,工具自然就給得準。”

工具的能力在快速變強,但使用者之間的差距並沒有因此縮小,反而在某種程度上被放大了。以前大家都做不出好東西,現在有審美積累的人可以做出很好的東西,沒有的人還是在“能用”和“好用”之間徘徊。

工具也在對這個現實做出回應。NotebookLM 這類一鍵模板工具的走紅,背後邏輯很簡單:它繞開了“你得先知道自己要什麼”這個前提。模板幫你做了審美決策,你只需要填內容。但模板的上限也在這裡,它能解決“能用”,解決不了“好看”。

這件事在文字方向上體現得同樣清楚。我有一個做市場策劃的朋友,最近被調去負責 PR,需要大量輸出文字稿件。領導說可以用 AI,她反而更困惑,來找我要之前寫的一個 AI 寫作手冊。癥結在於:她對“一篇好的 PR 稿”沒有感覺,不知道好的標準是什麼,面對 AI 生成的內容,她沒有辦法判斷要往哪個方向改。

圖片來源 Giphy

而我自己用 AI 寫作反而順手很多。不是因為我更懂工具,是因為做文字記者多年,對錶達有判斷,知道一句話好在哪、哪裡彆扭,知道 AI 給的東西差在什麼地方、要往哪裡推。審美在這裡變成了一種很實用的能力:它讓你知道終點在哪,而不是漫無目的地讓 AI 一遍遍重跑。

當工具能力不是問題的時候,審美和“舊技能”就成了最大的門檻——用不好的甚至還不如完全不用的。

我要的是色色,AI 和真人的分別重要嗎?

最先吃到螃蟹的人不僅會吃到甜頭,也會惹上爭議。現在的 AIGC 圈就出現了一個弔詭的現象:用不用 AI,比作品好不好,還重要。

方遠(化名)是個品牌設計師,他接了一個品牌視覺的項目,用 AI 工具把以往要花兩週的流程壓進了三天,他自己覺得出來的效果比以前還好一截。東西發出去,等對方回覆。

結果對方回的第一句話不是對作品的評價,而是“這麼快,你是不是用 AI 了?”方遠還沒來得及回,緊接著又來一條:“我們不接受有 AI 參與的設計作品。”他到現在也不確定對方有沒有打開過附件。他很鬱悶,效率太高,還成罪過了。

圖片來源 Giphy

面對這個處境的不止他一個人。AI 已經在很多人的評價體系裡,悄悄變成了一個道德審判的座標。這和 Photoshop 或者 Excel 不一樣。沒有人會在收到一張修過圖的照片時問“你是不是用了修圖軟件”,也沒有人會在拿到一份財務報表時追問“你是用 Excel 算的嗎”。

AI 觸發的是另一種懷疑,一種更接近“你有沒有真的做這件事”的追問。

創意工作裡向來有一種隱性的契約,好的作品意味著有人為它付出過時間、精力、打磨。AI 的出現卻正好破壞了“付出”和“產出”之間那條大家默認存在的因果線。

你用 AI 三天做出來的東西,和別人手工兩週做出來的東西放在一起,哪怕質量一樣,前者會讓人覺得有什麼地方不對勁。這種“不對勁”可以總結成”不公平”。

亞利桑那大學曾做過一項研究,結果設計師如果主動告知客戶使用了 AI 輔助,即便解釋了 AI 只是輔助環節,客戶對設計師的信任依然平均下降了 20%。

而隨著 AIGC 技術的成熟,這個問題逐漸從甲乙方個人信任問題,上升到了平臺問題。

從 2023 年開始,國家陸續出臺相關規定,要求對 AI 生成內容進行標註:先是 1 月的《互聯網信息服務深度合成管理規定》,主要管 AI 換臉、合成聲音這類深度合成技術;同年 8 月《生成式人工智能服務管理暫行辦法》正式落地,把 ChatGPT 類的生成式服務也納入進來。到了 2025 年 3 月,監管再度升級,國家網信辦聯合多部門發佈《人工智能生成合成內容標識辦法》,這一次的規定覆蓋了文字、圖片、音頻、視頻全部內容形態。

但規範無法劃清的,是定義。

平臺能識別一段 100%由 AI 生成的視頻,卻很難判斷邊界地帶,一張自拍照放進 AI 裡調了色和構圖,算不算 AI 生成內容;一段視頻,素材是自己拍的但剪輯和配樂都交給了 AI,要不要打標籤;一篇稿子,AI 出了初稿,人改了七成,這個標籤算誰的……

圖片來源 Giphy

邊界感的難題背後,其實是權責的問題。定義不清楚,責任就沒有落點。當一首歌的旋律是 AI 寫的、人改了詞,出了版權糾紛,誰來負責?或者一篇測評是 AI 生成的、博主只改了語氣,買了推薦產品發現名不副實,我們追問“是不是 AI 做的”,其實是在追問一個更樸素的問題,這個作品背後,到底有沒有一個人在認真負責,有沒有人在想你的問題,有沒有人在乎結果好不好?

最難劃清的不是邊界,是責任。