구글과 OpenAI가 또 충돌했습니다.

새로운 GPT-4o 모델이 출시된 지 1일 만에 구글이 최신 실험 모델 Gemini-Exp-1121을 출시하여 챔피언 자리를 되찾았습니다.

주목할 점은 이전 모델 Gemini-Exp-1114가 1주일 전에 출시되었다는 것입니다.

이는 OpenAI가 도전장을 내밀 것을 예상하고 의도적으로 남겨둔 것으로 보입니다.

이는 OpenAI로 하여금 새로운 GPT-4o 버전을 출시하게 한 뒤, 더 나은 모델로 공격하려는 전략으로 보입니다.

구글 연구진들은 매우 자부심이 넘치는 것 같습니다.

구글 DeepMind의 수석 과학자 Jack Rae는 이를 "흥미로운 사후 훈련 '번개전'"이라고 표현했으며, 사전 훈련보다 반복 속도가 훨씬 빠르다고 암시했습니다.

DeepMind 연구 부사장 Oriol Vinyals는 OpenAI에 최근 제출한 계획이 있는지 물어보기도 했습니다.

이들의 태도는 매우 자신감 넘치는 것 같습니다.

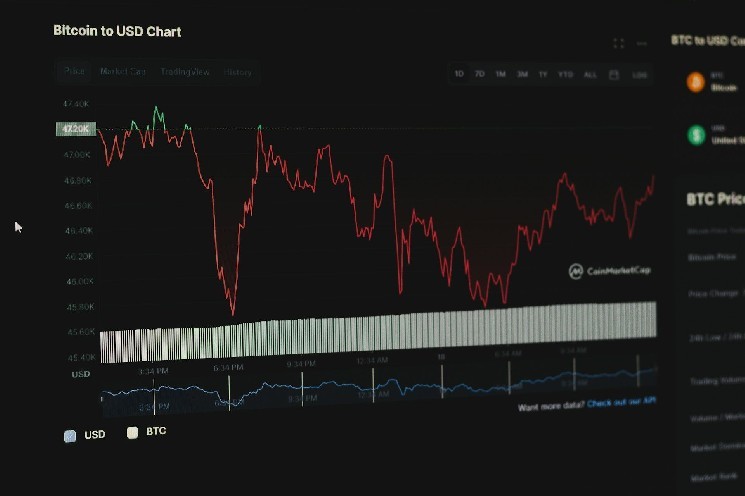

그렇다면 "1121"은 얼마나 강력할까요? 구체적인 성능을 살펴보겠습니다.

코드/추론/시각적 이해 전반적 향상

공식적으로 Gemni-Exp-1121은 세 가지 측면에서 성능이 크게 향상되었다고 합니다.

코드 능력이 크게 향상되었습니다.

추론 능력이 더욱 강화되었습니다.

시각적 이해 능력이 더욱 강화되었습니다.

스타일 제어를 제외하면 다른 모든 부분에서 1위를 차지하고 있습니다.

시각적 능력 측면에서 Gemini-Exp-1121은 이전 버전보다 향상되었습니다.

스타일 제어와 복잡한 프롬프트 측면에서 Gemini-Exp-1121은 o1-preview, New Sonnet 3.5와 동등한 수준입니다.

실제 경쟁 환경에서의 승률은 다음과 같습니다.

이제 직접 체험해볼 수 있습니다.

예를 들어 동일한 만화에 대해 Gemini-Exp-1121과 GPT-4o-lastest-1120의 이해도를 비교해볼 수 있습니다.

Gemini-Exp-1121의 답변이 더 포괄적이고 자세하며, 소제목 사용과 중요 부분 강조 등이 돋보입니다.

반면 새로운 4o 버전의 답변은 비교적 간단하고 포괄적입니다.

고전적인 동물 건너기 논리 문제에서 Gemini-Exp-1121은 완전히 정확한 답변을 제공했지만, 새로운 4o 버전은 일부 실수를 범했습니다.

문제: 농부가 늑대, 양, 양배추를 모두 강을 건너야 하지만 한 번에 한 가지만 운반할 수 있으며, 늑대와 양, 양과 양배추는 혼자 있을 수 없습니다. 농부는 어떻게 해야 합니까?

One More Thing

언급할 만한 것은 OpenAI 측에도 새로운 소식이 있다는 것입니다.

ChatGPT의 최신 테스트 버전에서 처음으로 "실시간 카메라"(Live Camera) 비디오 기능의 코드가 발견되었습니다.

이 기능에는 실시간 녹화, 실시간 처리, 음성 모드 통합 및 시각적 인식 기능이 포함됩니다.

고급 음성 모드가 출시될 때 일부 사용자들이 이 기능을 경험했습니다.

이는 OpenAI가 이 기능을 출시할 준비가 되었음을 의미합니다.

한편 구글도 유사한 데모를 선보였지만 아직 출시되지 않았습니다. OpenAI의 성향을 고려할 때 구글보다 먼저 전면 출시할 가능성이 높습니다.

내년이 되면 채팅봇과의 주요 소통 방식이 문자 대화에서 음성과 에이전트로 전환될 수 있습니다. Live Camera 기능이 그 시작일 수 있습니다. 어떻게 생각하시나요?

참고 링크:

[1]https://x.com/OfficialLoganK/status/1859667244688736419

[2]https://x.com/adonis_singh/status/1859682100569571399

[3]https://x.com/OriolVinyalsML/status/1859730969600852222

[4]https://x.com/rowancheung/status/1859301345993556277

본 기사는 WeChat 공식 계정 "量子位"에서 발췌되었으며, 36kr의 허가를 받아 게재되었습니다.