이 기사는 기계로 번역되었습니다

원문 표시

폴 튜더 존스가 인공지능이 문명에 임박한 위험에 대해 말하고 있습니다. 아래 를 참조하세요.

국가 간의 경쟁 역학과 국가 간의 더 큰 국가 안보 우려로 인해 이 인공지능의 발전은 통제 불가능한 기차와 같습니다.

이는 멈추지 않을 것입니다. 상황적입니다.

요약:

> AI 업계 최대 리더 및 금융 관계자들과 함께하는 패널 토론에 초대됨

> AI를 막거나 규제 감독할 능력이 없음

> 5천만~1억 명이 사망하는 사고가 발생해야만 전 세계가 AI의 위협을 이해할 수 있음

> 모두가 동의함

전반적으로 제 입장은 다음과 같습니다.

> AI 개발 가속화를 근본적으로 막을 수 없다는 데 동의합니다. 특히 AI가 국가 안보에 가장 큰 위협이 될 가능성이 있는 상황에서 더욱 그렇습니다.

> AI의 오용 위험(생물무기 개발 등)을 제외하면, 우리는 심각한 문제에 직면하게 될 것입니다.

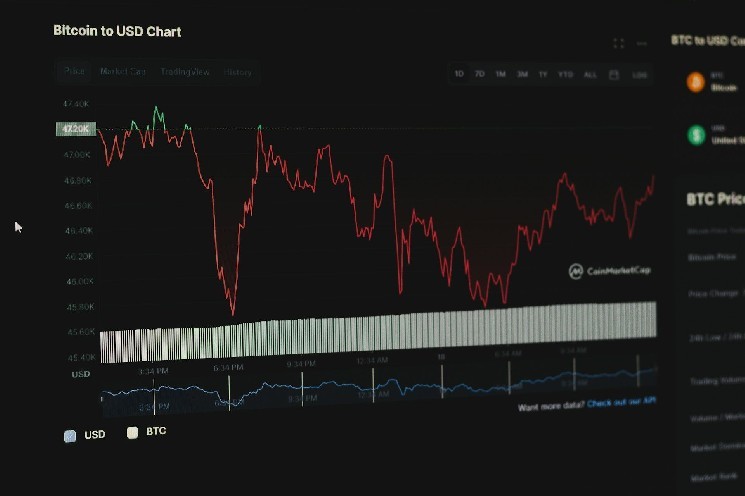

적어도 비트코인은 오르고 있어요

Twitter에서

면책조항: 상기 내용은 작자의 개인적인 의견입니다. 따라서 이는 Followin의 입장과 무관하며 Followin과 관련된 어떠한 투자 제안도 구성하지 않습니다.

라이크

즐겨찾기에 추가

코멘트

공유