클로드의 중국어 이용료: 동일한 콘텐츠를 요청하는 데 영어보다 토큰이 65% 더 많이 소모되는 반면, OpenAI는 15%만 소모됩니다.

이 기사는 기계로 번역되었습니다

원문 표시

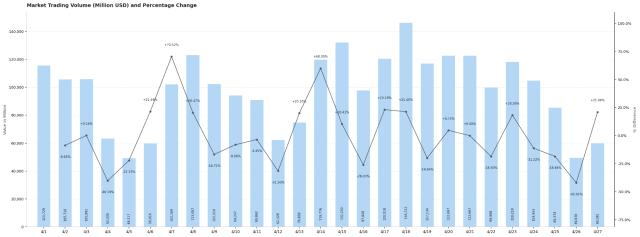

AIMPACT에 따르면, 4월 29일(UTC+8), Beating의 모니터링 결과에 따라 AI 연구원 아란 코마츠자키는 리치 서튼의 유명 논문 "씁쓸한 교훈(The Bitter Lesson)"을 9개 언어로 번역하여 OpenAI, Gemini, Qwen, DeepSeek, Kimi, Claude 등 6개 모델의 토크나이저에 입력했습니다. OpenAI에서 원문 영어 텍스트의 토큰 수를 기준으로 삼아, 각 언어별로 각 모델의 토큰 소비량을 비교했습니다. 결과는 다음과 같습니다. 동일한 내용을 중국어로 번역했을 때 Claude의 토큰 소비량은 기준치의 1.65배였지만, OpenAI에서는 1.15배에 불과했습니다. 힌디어의 경우 Claude에서 토큰 소비량이 더욱 급증하여 기준치의 3배를 넘어섰습니다. Anthropic은 비교 대상 6개 모델 중 가장 낮은 순위를 기록했습니다. 번역 과정에서 텍스트 길이가 달라지기 때문에 영어와의 비교는 완전히 정확하지는 않다는 점에 유의해야 합니다. 더욱 설득력 있는 것은 동일한 중국어 텍스트를 여러 모델(동일한 벤치마크 사용)에서 처리했을 때의 성능 차이입니다. Kimi는 영어보다 0.81배, Qwen은 0.85배, Claude는 1.65배의 시간이 걸렸습니다. 텍스트는 완전히 동일했으며, 차이는 순전히 단어 분할 도구의 효율성 때문이었습니다. 중국어 모델이 영어보다 중국어를 더 효율적으로 처리했다는 사실은 문제가 중국어 자체에 있는 것이 아니라 단어 분할 도구가 해당 언어에 최적화되어 있는지 여부에 있음을 시사합니다. 사용자 입장에서 토큰 수가 많아질수록 API 비용이 증가하고, 모델의 응답 대기 시간이 늘어나며, 컨텍스트 창이 더 빨리 소진됩니다. 단어 분할 도구의 효율성은 학습 데이터에서 각 언어의 점유비율 에 따라 달라집니다. 영어 데이터가 많을수록 영어 단어를 효율적으로 압축할 수 있고, 비영어 데이터가 적을수록 분할이 매우 파편화됩니다. 아란의 결론은 다음과 같습니다. 가장 큰 시장을 확보한 기업이 더 많은 토큰을 절약할 것입니다. (출처: ME)

출처

면책조항: 상기 내용은 작자의 개인적인 의견입니다. 따라서 이는 Followin의 입장과 무관하며 Followin과 관련된 어떠한 투자 제안도 구성하지 않습니다.

라이크

즐겨찾기에 추가

코멘트

공유