Một nghiên cứu mới đã phát hiện ra rằng trí tuệ nhân tạo (AI) có thể sở hữu một trong những khả năng độc nhất của con người, đó là "Lý thuyết về tâm trí" (ToM).

Nói cách khác, trong việc theo dõi các trạng thái tâm lý của con người, chẳng hạn như "phát hiện suy nghĩ sai trái", "hiểu lời nói gián tiếp", "xác định hành vi giả tạo", v.v., hiệu suất của GPT (GPT-4, GPT-3.5) và Llama 2 trong những tình huống cụ thể đã được chứng minh là gần bằng hoặc thậm chí vượt trội hơn con người.

Những phát hiện này không chỉ chứng minh rằng các mô hình ngôn ngữ lớn (LLM) thể hiện hành vi phù hợp với kết quả suy luận tinh thần của con người mà còn nêu bật tầm quan trọng của việc kiểm tra hệ thống để đảm bảo so sánh không hời hợt giữa trí tuệ con người và trí tuệ nhân tạo.

Bài nghiên cứu liên quan có tiêu đề "Thử nghiệm lý thuyết tâm trí trong các mô hình ngôn ngữ lớn và con người" và đã được xuất bản trên tạp chí phụ Nature Human Behavior.

GPT biết rõ hơn về "gây hiểu lầm", Llama 2 biết rõ hơn về "lịch sự"

Lý thuyết về tâm trí là một thuật ngữ tâm lý học, là khả năng hiểu được trạng thái tinh thần của bản thân và những người xung quanh. Những trạng thái tinh thần này bao gồm tâm lý, niềm tin, ý định, ham muốn, sự giả vờ, v.v. Tự kỷ thường được cho rằng là thiếu điều này. khả năng ở bệnh nhân do khả năng gây ra.

Trước đây, khả năng lý thuyết về tâm trí được cho rằng là chỉ có ở con người. Tuy nhiên, ngoài con người, nhiều loại linh trưởng, chẳng hạn như tinh tinh, cũng như voi, cá heo, ngựa, mèo, chó, v.v., đều cho rằng là có khả năng lý thuyết đơn giản về khả năng trí óc, điều này vẫn còn gây tranh cãi.

Gần đây, sự phát triển nhanh chóng của các mô hình ngôn ngữ lớn (LLM) như ChatGPT đã gây ra một cuộc tranh luận gay gắt về việc liệu hành vi mà các mô hình này thể hiện trong lý thuyết về nhiệm vụ trí óc có phù hợp với hành vi của con người hay không.

Trong công trình này, một đội ngũ nghiên cứu từ Trung tâm Y tế Đại học Hamburg-Eppendorf ở Đức và các cộng tác viên của họ đã liên tục thử nghiệm hai sê-ri LLM (GPT và Llama 2) về các khả năng lý thuyết tâm trí khác nhau và so sánh hiệu suất của chúng với 1907 người tham gia là con người.

Họ nhận thấy rằng hiệu suất của mô hình GPT trong việc xác định các yêu cầu gián tiếp, ý tưởng sai và định hướng sai có thể đạt hoặc thậm chí vượt qua quá trình độ trung bình của con người, trong khi hiệu suất của Llama 2 không tốt bằng con người.

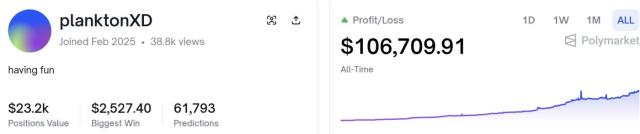

Hình | Hiệu suất của con người (tím), GPT-4 (xanh đậm), GPT-3.5 (xanh nhạt) và LLaMA2-70B (xanh lục) trong lý thuyết kiểm tra trí óc.

Llama 2 xác định lỗi giả tốt hơn con người, nhưng GPT hoạt động kém.

Đội ngũ nghiên cứu cho rằng rằng hiệu suất tốt của Llama 2 là do mức độ sai lệch thấp hơn trong các câu trả lời, thay vì thực sự nhạy cảm với sự thiếu tôn trọng. Hiệu suất kém của GPT thực sự là do thái độ cực kỳ bảo thủ đối với việc khăng khăng đưa ra kết luận. chứ không phải do sai sót trong lý luận.

Lý thuyết tâm trí của AI đã đạt đến trình độ của con người chưa?

Trong phần thảo luận của bài viết, đội ngũ nghiên cứu đã tiến hành phân tích chuyên sâu về hiệu suất của mô hình GPT trong nhiệm vụ xác định lời nói không phù hợp. Các kết quả thử nghiệm ủng hộ giả định rằng mô hình GPT quá thận trọng trong việc xác định lời nói không phù hợp. chứ không phải là khả năng suy luận kém. Khi các câu hỏi được đặt ra dưới dạng các khả năng, mô hình GPT có thể xác định chính xác và chọn lời giải thích hợp lý nhất.

Đồng thời, họ cũng tiết lộ qua các thí nghiệm tiếp theo rằng tính ưu việt của LLaMA2-70B có thể là do thiên hướng chống lại sự thiếu hiểu biết hơn là khả năng suy luận thực sự của nó.

Ngoài ra, họ cũng chỉ ra hướng nghiên cứu trong tương lai, bao gồm khám phá sâu hơn về hiệu suất của các mô hình GPT trong tương tác giữa người và máy tính theo thời gian thực và cách hành vi ra quyết định của các mô hình này ảnh hưởng đến nhận thức xã hội của con người.

Họ cảnh báo rằng chỉ vì LLM thực hiện tốt như con người trong nhiệm vụ về lý thuyết tư duy, điều đó không có nghĩa là họ có khả năng giống con người hoặc họ có thể nắm vững lý thuyết tư duy.

Tuy nhiên, họ cũng tuyên bố rằng những kết quả này là cơ sở quan trọng cho nghiên cứu trong tương lai và đề xuất nghiên cứu sâu hơn về hiệu suất của LLM đối với suy đoán tâm lý ảnh hưởng đến nhận thức cá nhân trong tương tác giữa người và máy tính.

Liên kết giấy

https://www.nature.com/articles/s41562-024-01882-z

Bài viết này xuất phát từ tài khoản công khai WeChat "Academic Toutiao" (ID: SciTouTiao) , tác giả: Academic Toutiao, 36Kr được phát hành với sự cho phép.