Tác giả: Sam Gao, Tác giả của ElizaOS

0. Lời nói đầu

Trong thời gian gần đây, sự xuất hiện liên tiếp của DeepSeek V3, R1 đã khiến các nhà nghiên cứu AI, doanh nhân và nhà đầu tư ở Mỹ bắt đầu Hội chứng sợ bỏ lỡ (FOMO). Sự kiện này thậm chí có thể gây bất ngờ như sự ra mắt của ChatGPT vào cuối năm 2022.

Nhờ vào việc DeepSeek R1 hoàn toàn mã nguồn mở (HuggingFace có thể tải miễn phí mô hình để thực hiện suy luận tại địa phương) và giá cả cực kỳ thấp (chỉ bằng 1/100 so với OpenAI o1), DeepSeek đã lên ngôi vương trên App Store của Mỹ trong vòng 5 ngày.

Vậy, lực lượng AI mới bí ẩn này, được ươm tạo bởi một công ty định lượng Trung Quốc, đến từ đâu?

1. Nguồn gốc của DeepSeek

Tôi lần đầu tiên nghe về DeepSeek vào năm 2021, khi đó, trong khi làm việc tại Viện Đạo Đức, cô gái thiên tài bên cạnh, cô Luo Fuli, một thạc sĩ của Đại học Bắc Kinh, đã đăng 8 bài báo tại ACL (hội nghị hàng đầu về xử lý ngôn ngữ tự nhiên) trong một năm, đã nghỉ việc và gia nhập High-Flyer Quant. Lúc đó, mọi người đều rất tò mò, một công ty định lượng kiếm rất nhiều tiền, tại sao lại tuyển dụng nhân tài trong lĩnh vực AI: Phải chăng High-Flyer cũng cần viết bài báo?

Theo hiểu biết của tôi, các nhà nghiên cứu AI được High-Flyer tuyển dụng chủ yếu là tự mình làm việc, tìm kiếm một số hướng tiên phong để thám hiểm, trong đó hướng cốt lõi nhất là các mô hình quy mô lớn (LLM) và các mô hình tạo hình từ văn bản (lúc đó là OpenAI Dall-e).

Thời gian trôi nhanh đến cuối năm 2022, High-Flyer dần thu hút ngày càng nhiều nhân tài hàng đầu trong lĩnh vực AI (phần lớn là sinh viên đang theo học tại Thanh Hoa và Bắc Kinh). Bị kích thích bởi ChatGPT, Giám đốc điều hành của High-Flyer, ông Lương Văn Phong, đã quyết định tiến vào lĩnh vực trí tuệ nhân tạo tổng quát: "Chúng tôi đã thành lập một công ty mới, bắt đầu từ các mô hình ngôn ngữ quy mô lớn, sau đó sẽ có cả lĩnh vực thị giác."

Đúng vậy, công ty này chính là DeepSeek, vào đầu năm 2023, các công ty đại diện cho "Lục Long" như Trí Tuệ, Mặt Trăng Tối, Bách Xuyên Thông Minh dần chiếm lĩnh sân khấu, trong khu vực sôi động và nhộn nhịp của Trung Quan và Ngũ Đạo Khẩu, sự hiện diện của DeepSeek trong một lượng lớn đã bị các công ty này thu hút sự chú ý (Attention).

Do đó, vào năm 2023, với tư cách là một tổ chức nghiên cứu thuần túy, không có những nhà sáng lập nổi tiếng như Li Kaifu của Zero One Wanwu, Dương Chí Lân của Mặt Trăng Tối, Vương Tiểu Xuyên của Bách Xuyên Thông Minh, DeepSeek rất khó gọi vốn độc lập từ thị trường. Do đó, High-Flyer quyết định tách DeepSeek ra và tài trợ toàn bộ cho sự phát triển của DeepSeek. Trong thời đại đầy sôi động này của năm 2023, không có công ty đầu tư mạo hiểm nào sẵn sàng cung cấp vốn cho DeepSeek, một là vì trong DeepSeek chủ yếu là những tiến sĩ vừa tốt nghiệp, không có những nhà nghiên cứu hàng đầu nổi tiếng, hai là do việc thoái vốn còn xa vời.

Trong môi trường ồn ào và hối hả, DeepSeek bắt đầu viết nên những câu chuyện trong hành trình khám phá AI của mình:

Tháng 11 năm 2023, DeepSeek ra mắt DeepSeek LLM, với 670 tỷ tham số, hiệu suất gần với GPT-4.

Tháng 5 năm 2024, DeepSeek-V2 chính thức ra mắt.

Tháng 12 năm 2024, DeepSeek-V3 được phát hành, các bài kiểm tra chuẩn cho thấy nó vượt trội hơn Llama 3.1 và Qwen 2.5, đồng thời tương đương với GPT-4o và Claude 3.5 Sonnet, gây chấn động trong ngành.

Tháng 1 năm 2025, thế hệ đầu tiên của mô hình quy mô lớn có khả năng suy luận, DeepSeek-R1, được phát hành, với giá chỉ bằng 1/100 so với OpenAI o1 nhưng có hiệu suất vượt trội, khiến cả thế giới công nghệ phải rúng động: Thế giới đã thực sự nhận ra rằng sức mạnh của Trung Quốc đã đến... Mã nguồn mở sẽ luôn thắng!

2. Chiến lược nhân tài

Tôi đã quen biết một số nhà nghiên cứu của DeepSeek từ rất sớm, chủ yếu là những người nghiên cứu hướng AIGC, như tác giả của Janus được phát hành vào tháng 11 năm 2024 và tác giả của DreamCraft3D, trong đó còn có một người đã giúp tôi tối ưu hóa bài báo mới nhất của tôi @xingchaoliu.

Theo những gì tôi tìm hiểu, các nhà nghiên cứu mà tôi quen biết hầu hết rất trẻ, phần lớn là sinh viên đang theo học tiến sĩ hoặc mới tốt nghiệp trong vòng 3 năm.

Trong số này, hầu hết những người này đều là sinh viên sau đại học hoặc tiến sĩ ở khu vực Bắc Kinh, có thành tích học thuật rất ấn tượng: Nhiều người đã công bố từ 3 đến 5 bài báo tại các hội nghị hàng đầu.

Tôi đã hỏi bạn bè ở DeepSeek rằng tại sao Lương Văn Phong chỉ tuyển những người trẻ?

Họ đã chuyển cho tôi lời của Giám đốc điều hành Lương Văn Phong, nguyên văn như sau:

Bức màn bí ẩn của đội ngũ DeepSeek khiến mọi người tò mò: Vũ khí bí mật của họ là gì? Truyền thông nước ngoài nói rằng, vũ khí bí mật này là "những thiên tài trẻ", họ đủ sức cạnh tranh với những ông lớn tài chính hùng mạnh của Mỹ.

Trong ngành công nghiệp AI, việc tuyển dụng những người có kinh nghiệm phong phú là điều bình thường, nhiều công ty khởi nghiệp AI trong nước Trung Quốc thậm chí còn xu hướng tuyển dụng những nhà nghiên cứu lành nghề hoặc những người có bằng tiến sĩ ở nước ngoài. Tuy nhiên, DeepSeek lại đi ngược lại xu hướng này, ưu tiên những người trẻ không có kinh nghiệm làm việc.

Một nhà tuyển dụng từng hợp tác với DeepSeek tiết lộ, DeepSeek không tuyển những chuyên gia kỹ thuật lành nghề, "kinh nghiệm làm việc nhiều nhất cũng chỉ khoảng 3-5 năm, những người làm việc trên 8 năm thì cơ bản đều bị loại." Ông Lương Văn Phong cũng cho biết trong một cuộc phỏng vấn với 36Kr vào tháng 5 năm 2023 rằng, đa số nhân viên phát triển của DeepSeek hoặc là sinh viên mới tốt nghiệp, hoặc là những người mới bắt đầu sự nghiệp trong lĩnh vực trí tuệ nhân tạo. Ông nhấn mạnh: "Hầu hết các vị trí kỹ thuật cốt lõi của chúng tôi đều do sinh viên mới tốt nghiệp hoặc những người có 1-2 năm kinh nghiệm làm việc đảm nhận."

Không có kinh nghiệm làm việc, DeepSeek lựa chọn nhân tài như thế nào? Câu trả lời là, nhìn vào tiềm năng.

Ông Lương Văn Phong từng nói, để làm một việc dài hạn, kinh nghiệm thực tế không quan trọng lắm, mà năng lực cơ bản, tính sáng tạo và niềm đam mê lại quan trọng hơn. Ông tin rằng, có thể hiện tại những nhà tài năng AI hàng đầu thế giới vẫn chưa ở Trung Quốc, "nhưng chúng tôi có thể tự tạo ra những người như vậy."

Chiến lược này khiến tôi nhớ đến chiến lược ban đầu của OpenAI, khi OpenAI thành lập vào cuối năm 2015, ý tưởng cốt lõi của Sam Altman là tìm những nhà nghiên cứu trẻ có tham vọng, do đó, ngoài Chủ tịch Greg Brockman và Giám đốc Khoa học Ilya Sutskever, 4 thành viên kỹ thuật cốt lõi còn lại (Andrew Karpathy, Durk Kingma, John Schulman, Wojciech Zaremba) đều là những tiến sĩ vừa tốt nghiệp, tốt nghiệp từ Đại học Stanford, Đại học Amsterdam, Đại học California tại Berkeley và Đại học New York.

Từ trái sang phải: Ilya Sutskever (Giám đốc Khoa học cũ), Greg Brockman (Chủ tịch cũ), Andrej Karpathy (Trưởng bộ phận Kỹ thuật cũ), Durk King

① Nó sử dụng kỹ thuật hỗn hợp chuyên gia (MoE), yêu cầu cao về dữ liệu và huấn luyện, điều này cho thấy việc nghi ngờ Deepseek sử dụng dữ liệu của OpenAI để huấn luyện là có lý do.

② Deepseek sử dụng kỹ thuật học tăng cường (RL), yêu cầu phần cứng rất cao, nhưng so với Meta, cụm máy tính Volta của OpenAI, Deepseek chỉ sử dụng 2048 GPU H800 để huấn luyện.

Do giới hạn về tỷ lệ băm và độ phức tạp của MoE, việc DeepSeek R1 chỉ sử dụng 5 triệu USD mà vẫn thành công ở lần đầu tiên có vẻ đáng ngờ, nhưng dù bạn có thái độ nào về R1 - từ sùng bái "phép màu chi phí thấp" đến怀疑"hoa mỹ không thực chất", bạn cũng không thể bỏ qua sự sáng tạo về chức năng của nó.

Đồng sáng lập BitMEX Arthur Hayes đã đăng bài viết: Sự trỗi dậy của DeepSeek có thể khiến các nhà đầu tư toàn cầu nghi ngờ chủ nghĩa siêu đẳng của Mỹ? Giá trị tài sản của Mỹ có bị đánh giá quá cao?

Giáo sư Đại học Stanford Andrew Ng đã công khai tại Diễn đàn Davos năm nay: "Tôi ấn tượng với sự tiến bộ của DeepSeek. Tôi tin rằng họ có thể huấn luyện mô hình với chi phí rất thấp. Mô hình suy luận mới nhất của họ rất ấn tượng... 'Cố lên'!"

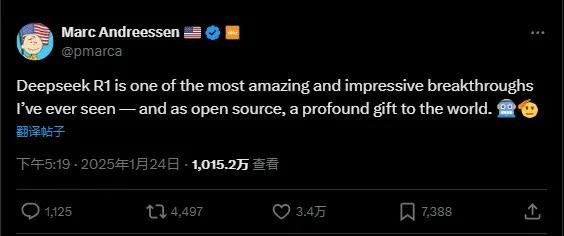

Marc Andreessen, nhà sáng lập a16z, cho biết: "DeepSeek R1 là một trong những bước tiến đột phá ấn tượng và gây ấn tượng nhất mà tôi từng thấy - và với tư cách là mã nguồn mở, đó là một món quà sâu sắc cho thế giới."

Sau nhiều năm ở góc sân khấu, DeepSeek cuối cùng đã đứng lên đỉnh của thế giới AI vào Tết Nguyên đán 2025.

4.Argo và DeepSeek

Với tư cách là nhà phát triển công nghệ của Argo và nhà nghiên cứu AIGC, tôi đã DeepSeek hóa các tính năng quan trọng của Argo: Với tư cách là một hệ thống luồng công việc (workflow), công việc tạo luồng công việc thô sơ được thực hiện bằng DeepSeek R1. Ngoài ra, Argo đã tích hợp LLM làm tiêu chuẩn là DeepSeek R1 và chọn từ bỏ các mô hình đắt tiền và đóng mã nguồn của OpenAI, lý do là hệ thống luồng công việc thường bao gồm lượng lớn tiêu thụ Token và thông tin ngữ cảnh (trung bình> = 10k token), điều này dẫn đến việc sử dụng các mô hình giá cao của OpenAI hoặc Claude 3.5 sẽ khiến chi phí thực thi luồng công việc rất đắt đỏ, và đây là một sự tổn hại cho sản phẩm trước khi người dùng web3 thực sự nhận được giá trị.

Khi DeepSeek ngày càng tốt hơn, Argo sẽ hợp tác chặt chẽ hơn với lực lượng Trung Quốc do DeepSeek đại diện: bao gồm nhưng không giới hạn ở việc Trung Hóa giao diện Text2Image/Video, Trung Hóa LLM.

Về hợp tác, Argo sẽ mời các nhà nghiên cứu của DeepSeek chia sẻ thành quả công nghệ trong tương lai và cung cấp các khoản tài trợ cho các nhà nghiên cứu AI hàng đầu, để hỗ trợ các nhà đầu tư và người dùng web3 hiểu rõ hơn về tiến bộ của AI.