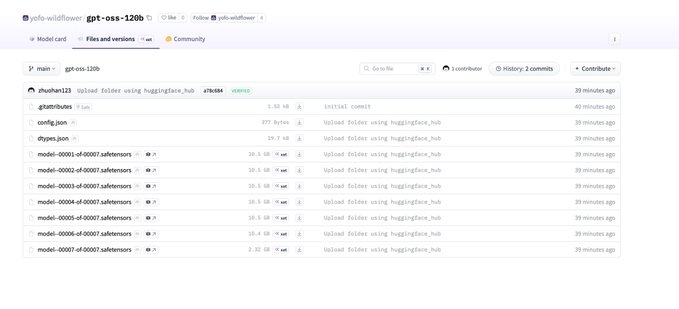

Open AI mã nguồn mở mô hình gpt-oss bị rò rỉ thông tin! Đây là một sê-ri mô hình hệ điều hành, tham số nhỏ nhất 20B tham số lớn nhất 120B Tệp cấu hình của mô hình cũng đã bị rò rỉ: MoE Transformer: 36 lớp, 128 chuyên gia, định tuyến Top-4 Chú ý: 64 đầu chú ý, mỗi đầu 64 chiều; GQA Tổng tham số (tổng lượng thưa) ≈ 116B Đào tạo/bối cảnh cơ bản: initial_context_length: 4096 Mở rộng bối cảnh RoPE: có thể mở rộng bối cảnh khả dụng lên khoảng 4096×32 ≈ 131k tokens Chú ý cửa sổ trượt: sliding_window: 128 có nghĩa là chủ yếu sử dụng cửa sổ chú ý cục bộ 128 Chiếm dụng bộ nhớ đệm KV: số phần tử K+V mỗi token mỗi lớp ≈ 72 KB/token. GQA đã giảm đáng kể việc chiếm dụng. Tóm lại: Mô hình bối cảnh dài MoE quy mô lớn thưa (tổng tham số ~116B, hoạt động ~5.1B) (~128k cấp độ, có NTK RoPE), sử dụng GQA + chú ý cửa sổ trượt để giảm bộ nhớ và tính toán; chiếu chú ý rộng hơn chiều ẩn để tăng dung lượng. Phù hợp với các kịch bản lưu lượng cao và văn bản dài, có chi phí KV và đặc tính song song tối ưu ở phía giải mã.

Bài viết này được dịch máy

Xem bản gốc

Jimmy Apples

@acc

08-01

So before people take credit, I found the oai os a min after they uploaded and saved the config and other stuff before it was removed.

It’s an OS model and coming soon so kinda feels like ruining a surprise

Từ Twitter

Tuyên bố từ chối trách nhiệm: Nội dung trên chỉ là ý kiến của tác giả, không đại diện cho bất kỳ lập trường nào của Followin, không nhằm mục đích và sẽ không được hiểu hay hiểu là lời khuyên đầu tư từ Followin.

Thích

Thêm vào Yêu thích

Bình luận

Chia sẻ

Nội dung liên quan