Thật là một ngày cuối tuần điên rồ!! Câu chuyện OpenAI vẫn tiếp tục. Vào tối thứ Bảy, có một nhân viên OpenAI dẫn đầu nỗ lực mang Sam Altman và Greg Brockman trở lại. Rõ ràng là hầu hết nhân viên đều đứng về phía Sam và Greg. Tôi có một người bạn làm việc tại OpenAI. Anh ấy đã có một khoảng thời gian tuyệt vời. Nhóm, công việc, tác động. Tất cả đều tuyệt vời. Cuộc chiến trong hội đồng quản trị này là một cú sốc lớn và hầu hết nhân viên đều không đánh giá cao sự gián đoạn này. Nhưng hội đồng quản trị đã quyết tâm và cuối cùng đã thuê được Giám đốc điều hành tạm thời mới : Emmett Shear. Chỉ trong vài giờ, hàng trăm nhân viên OpenAI đã nghỉ việc. Sam Altman và Greg Brockman chuẩn bị gia nhập Microsoft để thành lập một đơn vị nghiên cứu AI mới và Microsoft đang mở rộng các ưu đãi cho tất cả nhân viên OpenAI hiện tại. Tính đến thời điểm hiện tại, 700 trong số 770 nhân viên của OpenAI đã nghỉ việc . Hiện chưa rõ có bao nhiêu nhân viên sẽ gia nhập Microsoft. Một khúc mắc lớn khác trong cốt truyện là Ilya Sutskever, đồng sáng lập và Nhà khoa học trưởng của OpenAI, người bắt đầu cuộc chiến hội đồng quản trị, đã lật tẩy và nói rằng anh ấy vô cùng hối hận vì đã *tham gia* vào cuộc chiến hội đồng quản trị. Chẳng phải anh ta là người bắt đầu cuộc chiến sao? Tôi bị bối rối.

Trung tâm của sự hỗn loạn này là cơ cấu quản lý phi lợi nhuận. Tôi cho rằng hội đồng quản trị đang hành động dựa trên trách nhiệm ủy thác của mình để đảm bảo các hoạt động của OpenAI phù hợp với sứ mệnh đã nêu của họ. Sau đây là phần nhiệm vụ được liệt kê trên trang web của OpenAI :

Sứ mệnh của OpenAI là đảm bảo rằng trí tuệ nhân tạo chung (AGI)—theo ý chúng tôi là các hệ thống có tính tự trị cao, vượt trội hơn con người ở hầu hết các công việc có giá trị kinh tế—mang lại lợi ích cho toàn thể nhân loại. Chúng tôi sẽ cố gắng trực tiếp xây dựng AGI an toàn và có lợi, nhưng cũng sẽ coi như sứ mệnh của mình đã hoàn thành nếu công việc của chúng tôi hỗ trợ những người khác đạt được kết quả này. Để đạt được mục tiêu đó, chúng tôi cam kết tuân thủ các nguyên tắc sau:

Lợi ích được phân phối rộng rãi

Chúng tôi cam kết sử dụng mọi ảnh hưởng mà chúng tôi có được trong quá trình triển khai AGI để đảm bảo nó được sử dụng vì lợi ích của tất cả mọi người và tránh cho phép sử dụng AI hoặc AGI gây hại cho nhân loại hoặc tập trung quyền lực quá mức.

Nhiệm vụ ủy thác chính của chúng tôi là đối với nhân loại. Chúng tôi dự đoán cần phải huy động các nguồn lực đáng kể để hoàn thành sứ mệnh của mình, nhưng sẽ luôn siêng năng hành động để giảm thiểu xung đột lợi ích giữa các nhân viên và các bên liên quan có thể ảnh hưởng đến lợi ích chung.

An toàn lâu dài

Chúng tôi cam kết thực hiện nghiên cứu cần thiết để làm cho AGI an toàn và thúc đẩy việc áp dụng rộng rãi nghiên cứu đó trong cộng đồng AI.

Chúng tôi lo ngại việc phát triển AGI ở giai đoạn cuối sẽ trở thành một cuộc đua cạnh tranh mà không có thời gian để có các biện pháp phòng ngừa an toàn đầy đủ. Do đó, nếu một dự án có ý thức an toàn, phù hợp với giá trị tiến gần đến việc xây dựng AGI trước khi chúng tôi thực hiện, chúng tôi cam kết ngừng cạnh tranh và bắt đầu hỗ trợ dự án này. Chúng tôi sẽ đưa ra các chi tiết cụ thể trong từng thỏa thuận cụ thể, nhưng điều kiện kích hoạt điển hình có thể là “cơ hội thành công thậm chí còn cao hơn trong hai năm tới”.

Lãnh đạo kỹ thuật

Để có hiệu quả trong việc giải quyết tác động của AGI đối với xã hội, OpenAI phải đi đầu trong các khả năng của AI - chỉ vận động chính sách và an toàn là không đủ.

Chúng tôi tin rằng AI sẽ có tác động xã hội rộng rãi trước AGI và chúng tôi sẽ cố gắng dẫn đầu trong những lĩnh vực phù hợp trực tiếp với sứ mệnh và chuyên môn của chúng tôi.

định hướng hợp tác

Chúng tôi sẽ tích cực hợp tác với các tổ chức nghiên cứu và chính sách khác; chúng tôi tìm cách tạo ra một cộng đồng toàn cầu cùng nhau làm việc để giải quyết những thách thức toàn cầu của AGI.

Chúng tôi cam kết cung cấp hàng hóa công giúp xã hội định hướng con đường hướng tới AGI. Ngày nay, điều này bao gồm việc xuất bản hầu hết các nghiên cứu AI của chúng tôi, nhưng chúng tôi hy vọng rằng những lo ngại về an toàn và bảo mật sẽ làm giảm hoạt động xuất bản truyền thống của chúng tôi trong tương lai, đồng thời tăng tầm quan trọng của việc chia sẻ nghiên cứu về an toàn, chính sách và tiêu chuẩn.

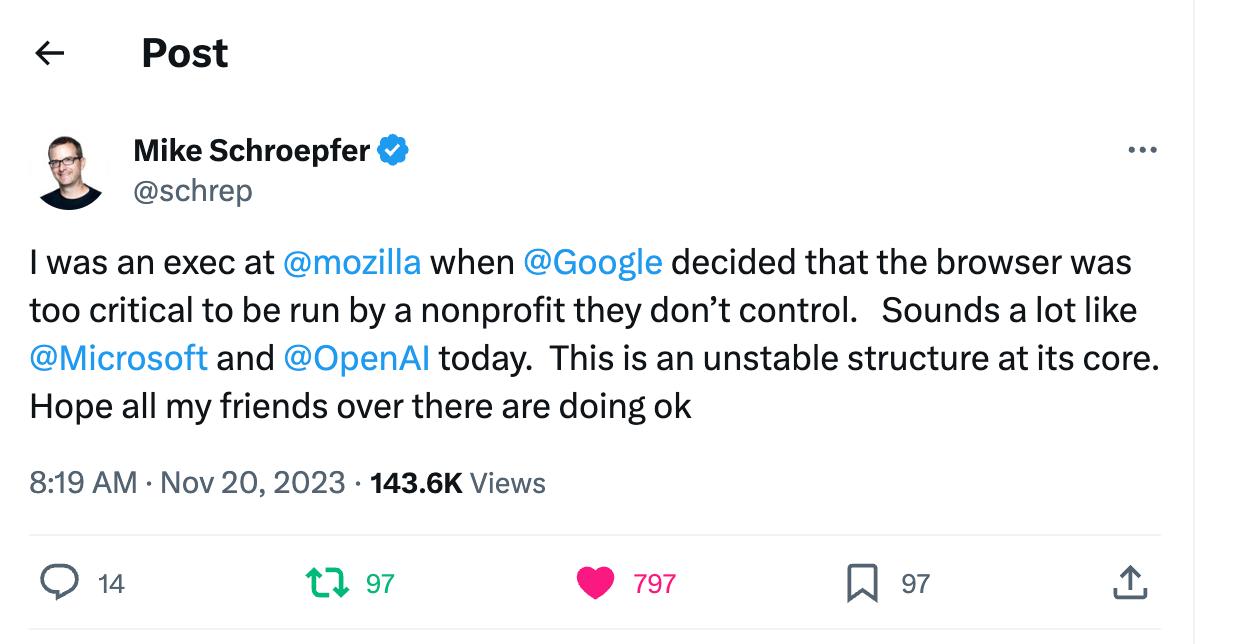

Sau đó, tôi cho rằng thật công bằng khi hội đồng quản trị lo ngại về kế hoạch tăng trưởng siêu tốc của OpenAI và mối quan hệ rất chặt chẽ với Microsoft. Tôi cho rằng hội đồng quản trị đang lo lắng rằng OpenAI đang phát triển quá nhanh, quá tăng trưởng và bị thúc đẩy bởi lợi nhuận, đồng thời đang rời xa sứ mệnh ban đầu là AGI an toàn mang lại lợi ích cho toàn nhân loại. Mặt khác, các thành viên hội đồng quản trị không có quyền lợi cá nhân. Họ có thể hành động không nguyên tắc nhưng có thể phá hủy mọi giá trị nếu không hành động cẩn thận. Tôi thực sự nghĩ rằng hội đồng phi lợi nhuận này có thể có mục đích rất tốt và cố gắng đặt lợi ích công cộng lên trên hết nhưng đó là một hội đồng rất nhỏ (sáu thành viên sau đó giảm xuống còn bốn thành viên) và họ thực sự không có vai trò gì trong trò chơi. Họ không có mức độ đau đớn như các nhân viên và nhà đầu tư khi đưa ra một quyết định khó khăn như sa thải CEO. OpenAI là một tổ chức rất quan trọng. Đáng lẽ họ phải có một hội đồng lớn hơn và đa dạng hơn. Quan trọng hơn, tôi không nghĩ tổ chức phi lợi nhuận là cấu trúc phù hợp cho OpenAI. Rất nhiều thứ đang bị Stake và trong lịch sử đã có những câu chuyện kinh dị về các khoản tài trợ phi lợi nhuận hàng tỷ đô la đã bị chiếm giữ bởi những kẻ mắc bệnh xã hội . Theo một cách nào đó, thật tốt khi cấu trúc phi lợi nhuận giờ đây đã bùng nổ vì toàn bộ thứ này về cơ bản là một tòa nhà chọc trời được xây dựng trên một nền móng lung lay. Việc quản trị phi lợi nhuận phức tạp với lợi nhuận bị giới hạn mà các nhà đầu tư và nhân viên không có phiếu bầu chắc chắn sẽ thất bại. Tôi cũng không biết liệu bộ phận nghiên cứu AI của Microsoft có hoạt động tốt hơn hay không. Nó sẽ hoàn toàn trái ngược với những gì tổ chức phi lợi nhuận OpenAI đang cố gắng đạt được. Sự quá tải của doanh nghiệp là do lợi nhuận và cổ đông thúc đẩy. Hãy tưởng tượng 5 năm nữa, một số nhà đầu tư hoạt động sẽ gây áp lực buộc Microsoft phải kiếm tiền từ bộ phận AI do Sam và Greg lãnh đạo tốt hơn và chi ít tiền hơn cho sự an toàn của AI. Đường dẫn đến địa ngục được lót đường bởi các ý định tốt. Mọi người có thể quá lạc quan về đơn vị nghiên cứu AI mới của Microsoft. Sau cuối tuần này, sự thật đáng buồn là OpenAI không còn là OpenAI nữa.