Trong những năm qua, nhiều người đã hỏi tôi câu hỏi: “Ở đâu là sự giao thoa hiệu quả nhất giữa crypto và AI?” Đó là một câu hỏi chính đáng: Crypto và AI là hai trong số những lĩnh độ sâu chính trong thập kỷ qua. , chắc chắn phải có mối liên hệ nào đó giữa hai điều này.

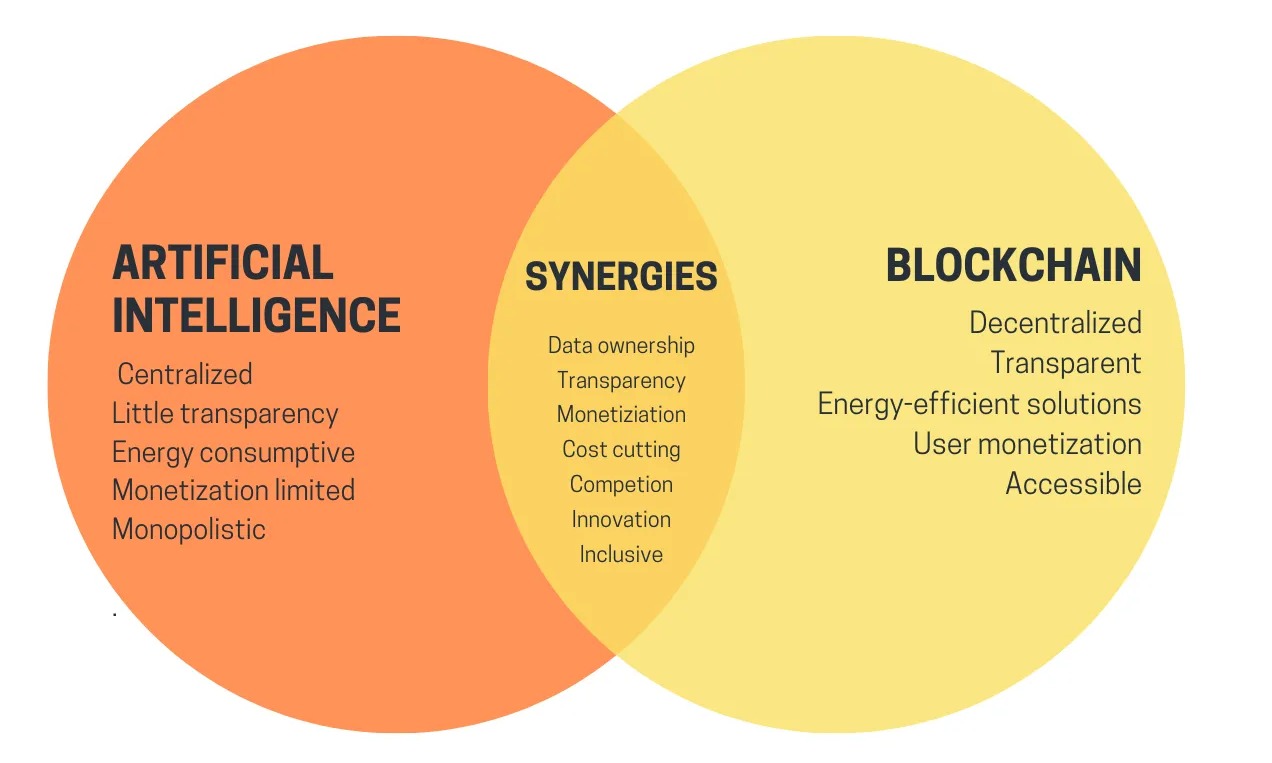

Nhìn lên bề ngoài, có thể dễ dàng tìm thấy sự phối hợp giữa cả hai: phi tập trung của crypto có thể cân bằng việc tập trung hóa AI, AI mờ đục và tiền điện crypto có thể mang lại sự minh bạch; AI yêu cầu dữ liệu và blockchain rất tốt trong việc lưu trữ và theo dõi thông tin.

Nhưng trong nhiều năm qua, khi mọi người yêu cầu tôi đi sâu vào các ứng dụng cụ thể, câu trả lời của tôi thật đáng thất vọng: "Đúng, có một số ứng dụng đáng bàn, nhưng không nhiều".

Trong ba năm qua, với sự phát triển của các công nghệ AI mạnh mẽ hơn như LLM hiện đại (Mô hình ngôn ngữ lớn) và không chỉ các giải pháp mở rộng quy mô blockchain mà còn cả Bằng chứng không tri thức, crypto hoàn toàn đồng hình, (tôi đang bắt đầu từ hai bên). để thấy sự thay đổi này với sự gia tăng của các công nghệ crypto mạnh hơn như tính toán an toàn bên long bên long ).

Thực sự có một số ứng dụng đầy hứa hẹn của AI trong hệ sinh thái blockchain hoặc bằng cách kết hợp AI với mật mã, mặc dù cần phải cẩn thận khi áp dụng AI.

Một thách thức cụ thể là: trong mật mã, mã nguồn mở là phương pháp duy nhất để tạo ra thứ gì đó thực sự an toàn, nhưng trong AI, quyền truy cập mở vào các mô hình (và thậm chí cả tài liệu đào tạo của chúng) làm tăng đáng kể khả năng dễ bị tổn thương trước các cuộc tấn công học máy đối nghịch. Bài viết này sẽ phân loại các cách khác nhau mà Crypto+AI có thể giao nhau, đồng thời khám phá triển vọng và thách thức của từng phân loại.

Bốn giao điểm chính của Crypto + AI

AI là một khái niệm rất rộng: bạn có thể coi AI như một tập hợp các thuật toán mà bạn xây dựng không phải bằng cách chỉ định chúng một cách rõ ràng mà bằng cách khuấy động một hỗn hợp tính toán lớn và áp dụng một loại áp lực tối ưu hóa nào đó. .

Không bao giờ nên xem nhẹ mô tả này vì nó bao gồm quá trình tạo ra con người chúng ta! Nhưng điều này cũng có nghĩa là các thuật toán AI có một số đặc điểm chung: chúng rất mạnh, đồng thời có những hạn chế nhất định về khả năng hiểu hoặc hiểu các quy trình thực thi nội bộ của chúng.

Có nhiều phương pháp để phân loại trí tuệ nhân tạo, và đối với sự tương tác giữa trí tuệ nhân tạo và blockchain được thảo luận trong bài viết này ( bài viết “Ethereum đúng nghĩa là một công nghệ thay đổi trò chơi” của Virgil Griffith), chúng sẽ được phân loại như sau:

- AI với tư cách là người tham gia trò chơi (tính khả thi cao nhất) : Trong cơ chế tham gia của AI, nguồn khích lệ cuối cùng đến từ từ sự đồng ý đầu vào của con người.

- AI như một giao diện chơi game (tiềm năng nhưng rủi ro) : AI giúp người dùng hiểu thế giới crypto xung quanh và đảm bảo rằng hành động của họ (như tin nhắn và giao dịch đã ký) phù hợp với ý định của họ để tránh bị lừa hoặc lừa đảo.

- AI là luật chơi (cần hết sức thận trọng) : Blockchain, DAO và các cơ chế tương tự gọi trực tiếp AI. Ví dụ: "Thẩm phán AI".

- AI là mục tiêu của trò chơi (Dài hạn và thú vị) : Mục tiêu trong việc thiết kế blockchain, DAO và các cơ chế tương tự là xây dựng và duy trì AI có thể được sử dụng cho các mục đích khác, với phần crypto là để khích lệ đào tạo tốt hơn hoặc Để ngăn chặn AI rò rỉ thông tin cá nhân hoặc bị lạm dụng.

Hãy xem xét từng cái một.

AI với tư cách là người chơi trò chơi

Trên thực tế, danh mục này đã tồn tại gần một thập kỷ, ít nhất là kể từ khi sàn giao dịch tập trung trên chuỗi (DEX) bắt đầu được sử dụng rộng rãi. Bất cứ khi nào sàn giao dịch tồn tại, sẽ có cơ hội kiếm tiền thông qua hoạt động chênh lệch giá và bot có thể làm điều đó tốt hơn con người.

Trường hợp sử dụng này đã có từ lâu, thậm chí sử dụng AI đơn giản hơn nhiều so với hiện nay, nhưng cuối cùng nó là sự giao thoa thực sự giữa AI và crypto. Gần đây, chúng ta thường thấy các bot chênh lệch giá MEV (Tối đa hóa giá trị rút) đang khai thác lẫn nhau. Bất cứ khi nào một ứng dụng blockchain liên quan đến đấu giá hoặc giao dịch sẽ có các bot chênh lệch giá.

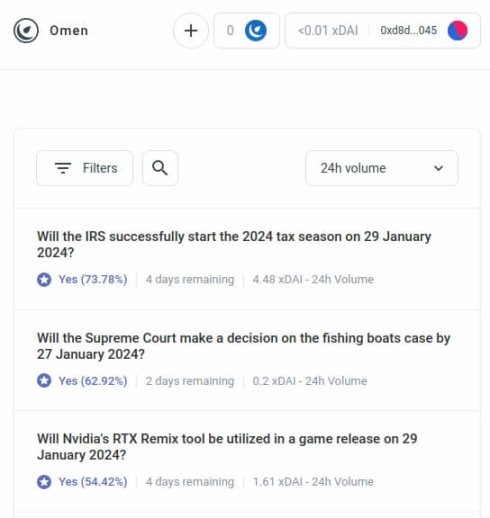

Tuy nhiên, bot chênh lệch giá AI chỉ là ví dụ đầu tiên của một danh mục lớn hơn mà tôi mong đợi sẽ sớm bao gồm nhiều ứng dụng khác. Chúng ta hãy xem AIOmen , một minh họa về thị trường dự đoán với AI là người tham gia:

Thị trường dự đoán từ lâu đã là chén thánh của công nghệ nhận thức. Tôi đã rất hào hứng với việc sử dụng thị trường dự đoán làm đầu vào cho quản trị (quản trị trong tương lai) vào năm 2014 và đã thử nó rộng rãi trong các cuộc bầu cử gần đây.

Nhưng cho đến nay, thị trường dự đoán vẫn chưa đạt được nhiều tiến bộ trong thực tế vì một số lý do: những người chơi lớn nhất có xu hướng phi lý và những người có kiến thức đúng đắn không sẵn lòng dành thời gian và đặt cược trừ khi có nhiều người tham gia. có tiền, Thị trường thường không đủ sôi động, v.v.

Một phản hồi cho vấn đề này là chỉ ra những cải tiến về trải nghiệm người dùng đang được Polymarket hoặc các thị trường dự đoán mới khác thực hiện và hy vọng rằng chúng có thể tiếp tục hoàn thiện và thành công khi các lần lặp lại trước đó không thành công.

Người ta sẵn sàng cá cược hàng chục tỷ ĐÔ LA vào thể thao, vậy tại sao người ta không bỏ đủ tiền cá cược bầu cử Mỹ hay LK99 để những tay chơi nghiêm túc bắt đầu tham gia? Nhưng lập luận này phải đối diện thực tế là các phiên bản trước đã không đạt được quy mô này (ít nhất là so với ước mơ của những người ủng hộ nó), vì vậy có vẻ như cần có một số yếu tố mới để thị trường dự đoán thành công.

Do đó, một phản hồi khác là chỉ ra một đặc điểm cụ thể của hệ sinh thái thị trường dự đoán mà chúng ta có thể mong đợi sẽ thấy trong những năm 2020 mà chúng ta đã không thấy trong những năm 2010: khả năng tham gia rộng rãi của AI.

AI sẵn sàng hoặc có thể làm việc với mức lương dưới 1 ĐÔ LA một giờ và có kiến thức bách khoa. Nếu điều đó vẫn chưa đủ, chúng thậm chí có thể được tích hợp với các tìm kiếm trên web theo thời gian thực. Nếu bạn xây dựng một thị trường và cung cấp khoản trợ cấp thanh khoản 50 ĐÔ LA , con người sẽ không quan tâm đến giá thầu, nhưng hàng nghìn AI sẽ dễ dàng tràn vào và đưa ra dự đoán tốt nhất có thể.

Động lực để giải quyết tốt bất kỳ vấn đề nào có thể nhỏ, nhưng động lực để xây dựng một AI có thể đưa ra dự đoán tốt có thể lên tới hàng triệu. Lưu ý rằng bạn thậm chí không cần con người phân xử hầu hết các vấn đề: bạn có thể sử dụng hệ thống tranh chấp nhiều vòng tương tự như Augur hoặc Kleros, trong đó AI cũng sẽ tham gia vào các vòng đầu. Con người chỉ phải phản ứng trong những trường hợp hiếm hoi xảy ra sê-ri nâng cấp và cả hai bên đều có sự đầu tư lượng lớn.

Đây là một nguyên tắc mạnh mẽ vì một khi bạn có thể làm cho thị trường dự đoán hoạt động ở quy mô vi mô như vậy, bạn có thể sử dụng lại nguyên tắc thị trường dự đoán cho nhiều loại vấn đề khác, chẳng hạn như:

- Bài đăng trên mạng xã hội này có được chấp nhận theo [Điều khoản sử dụng] không?

- Điều gì sẽ xảy ra với giá cổ phiếu X (xem ví dụ Numerai)

- Tài khoản này hiện đang gửi tin nhắn cho tôi có thực sự là Elon Musk không?

- Việc nộp đơn xin việc này có được chấp nhận trên thị trường nhiệm vụ trực tuyến không?

- DApp trên https://examplefinance.network có phải là lừa đảo không?

- 0x1b54….98c3 có phải là địa chỉ token ERC20 “Sòng bạc trong” không?

Bạn có thể nhận thấy rằng rất nhiều ý tưởng trong đó đi theo hướng mà tôi đã đề cập trước đó là " bảo vệ thông tin". Nói rộng ra, câu hỏi đặt ra là: Làm thế nào để chúng tôi giúp người dùng phân biệt thông tin đúng và sai cũng như xác định gian lận mà không trao cho cơ quan có thẩm quyền tập trung quyền quyết định điều gì đúng, điều gì sai và tránh lạm dụng quyền lực đó? Ở cấp độ vi mô, câu trả lời có thể là “AI”.

Nhưng ở cấp độ vĩ mô, câu hỏi đặt ra là: Ai xây dựng AI? AI là sự phản ánh của quá trình nó được tạo ra và do đó chắc chắn có những thành kiến. Cần có một trò chơi cấp cao hơn để đánh giá hiệu suất của các AI khác nhau, cho phép AI tham gia vào trò chơi với tư cách là người chơi.

Tôi nghĩ cách sử dụng AI này, trong đó AI tham gia vào một cơ chế mà cuối cùng được con người khen thưởng hoặc trừng phạt (theo cách xác suất) thông qua cơ chế trên chuỗi, tôi cho rằng là rất đáng nghiên cứu. Bây giờ là thời điểm thích hợp để nghiên cứu sâu hơn về các trường hợp sử dụng như thế này, vì mở rộng blockchain cuối cùng cũng đã phát triển, khiến mọi thứ “vi mô” thường không thể thực hiện được trên chuỗi giờ đây đều có khả năng khả thi.

Một lớp ứng dụng liên quan đang hướng tới các tác nhân có tính tự chủ cao, sử dụng blockchain để hợp tác tốt hơn, cho dù thông qua thanh toán hay sử dụng hợp đồng thông minh để đưa ra các cam kết đáng tin cậy.

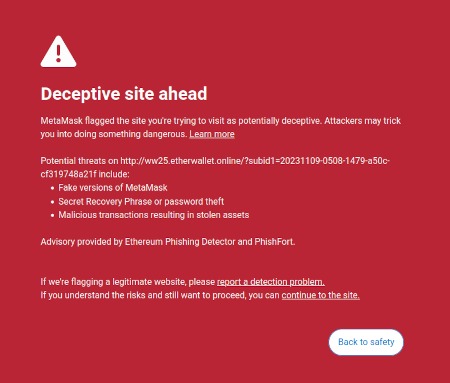

AI như một giao diện trò chơi

Một trong những ý tưởng tôi đề xuất trong My Techno- Optimism là có cơ hội thị trường để viết phần mềm hướng tới người dùng có thể bảo vệ người dùng bằng cách giải thích và xác định những mối nguy hiểm trong thế giới trực tuyến mà họ đang duyệt. Tính năng phát hiện gian lận của MetaMask là một ví dụ đã tồn tại.

Một ví dụ khác là tính năng mô phỏng của Rabby Wallet , cho người dùng thấy kết quả mong đợi của giao dịch mà họ sắp ký.

Những công cụ này có tiềm năng được tăng cường bởi AI. AI có thể đưa ra những giải thích phong phú hơn, dễ đọc hơn cho con người về DApp mà bạn đang tham gia trông như thế nào, hậu quả của các hoạt động phức tạp hơn mà bạn đang ký và liệu một token cụ thể có phải là thật hay không (ví dụ: BITCOIN không chỉ là một chuỗi ký tự), đó là tên của một crypto thực sự, nó không phải là token ERC20, giá của nó cao hơn nhiều so với 0,045 đô la), v.v.

Một số dự án đang bắt đầu phát triển theo hướng này (ví dụ: ví LangChain sử dụng AI làm giao diện chính). Quan điểm cá nhân của tôi là giao diện AI thuần túy có thể quá rủi ro ở thời điểm hiện tại vì nó làm tăng rủi ro xảy ra các lỗi kiểu khác, nhưng AI kết hợp với nhiều giao diện truyền thống hơn lại trở nên rất khả thi.

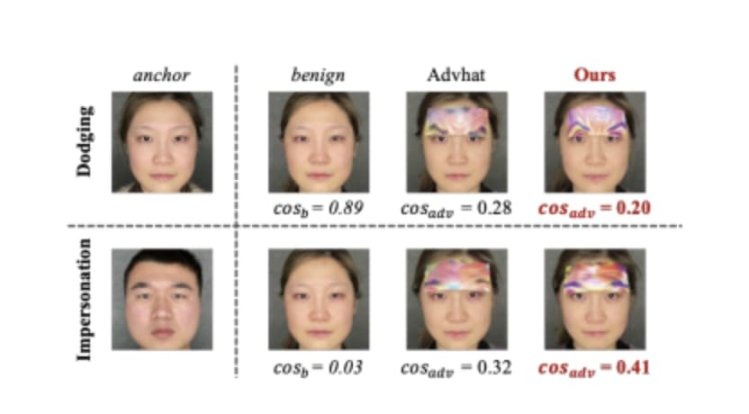

Có một rủi ro cụ thể đáng được đề cập. Tôi sẽ trình bày vấn đề này chi tiết hơn bên dưới trong phần “AI như một quy tắc của trò chơi”, nhưng vấn đề chung là do học máy đối nghịch: nếu người dùng có trợ lý AI bên trong ví mã nguồn mở, thì kẻ xấu sẽ cũng sẽ có quyền truy cập vào trợ lý AI đó, vì vậy họ sẽ có cơ hội không giới hạn để tối ưu hóa hành vi gian lận của mình nhằm phá vỡ hệ thống phòng thủ của ví đó.

Tất cả AI hiện đại đều có một số lỗ hổng và những lỗ hổng này rất dễ tìm thấy ngay cả trong quá trình đào tạo với quyền truy cập hạn chế vào mô hình.

Đây là lúc "AI tham gia vào các thị trường vi mô trên chuỗi" hoạt động tốt hơn: mọi AI riêng lẻ đều phải đối mặt với rủi ro như nhau, nhưng bạn cố tình xây dựng một hệ sinh thái mở với hàng chục người không ngừng lặp lại và cải tiến.

Hơn nữa, mỗi AI riêng lẻ đều đóng: tính bảo mật của hệ thống đến từ tính cởi mở của luật chơi chứ không phải hoạt động bên trong của mỗi người tham gia.

Tóm tắt: AI có thể giúp người dùng hiểu những gì đang xảy ra bằng ngôn ngữ đơn giản và có thể đóng vai trò như người cố vấn tức thời để bảo vệ người dùng khỏi những sai lầm, nhưng hãy cẩn thận khi gặp phải những kẻ lừa đảo và lừa đảo ác ý.

AI là luật chơi

Bây giờ, hãy nói về một ứng dụng mà nhiều người hào hứng nhưng tôi cho rằng là rủi ro và nơi chúng ta cần hết sức thận trọng: cái mà tôi gọi là AI là một phần của luật chơi. Điều này có liên quan đến sự phấn khích của giới tinh hoa chính trị chính thống đối với “các thẩm phán AI” (ví dụ: bạn có thể nhìn lêncác bài viết liên quan trên trang web “Hội nghị thượng đỉnh chính phủ thế giới”) và có một tình huống tương tự về những nguyện vọng này trong các ứng dụng blockchain.

Nếu hợp đồng thông minh hoặc DAO dựa trên blockchain yêu cầu phải đưa ra các quyết định chủ quan, bạn có thể cho phép AI đơn giản trở thành một phần của hợp đồng hoặc DAO để giúp thực thi các quy tắc đó không?

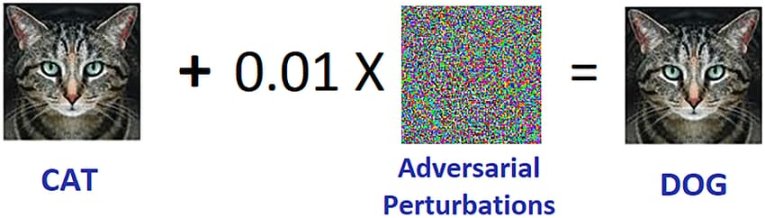

Đây là lúc mà việc học máy đối nghịch sẽ là một thử thách cực kỳ khó khăn. Đây là một lập luận đơn giản:

Nếu một mô hình AI đóng vai trò quan trọng trong cơ chế bị đóng, bạn không thể xác minh hoạt động bên trong của nó, vì vậy nó không tốt hơn ứng dụng tập trung.

Nếu một mô hình AI đang mở, kẻ tấn công có thể tải xuống và mô phỏng nó cục bộ rồi thiết kế một cuộc tấn công được tối ưu hóa cao để đánh lừa mô hình, sau đó chúng có thể phát lại trên mạng trực tiếp.

Bây giờ, những độc giả là độc giả thường xuyên của blog này (hoặc là những người đam mê crypto) có thể đã hiểu ý tôi và bắt đầu suy nghĩ. Nhưng xin vui lòng chờ đợi.

Chúng tôi có Bằng chứng không tri thức nâng cao và các dạng mật mã thực sự thú vị khác. Chúng tôi chắc chắn có thể thực hiện một số phép thuật crypto để che giấu hoạt động bên trong của mô hình để kẻ tấn công không thể tối ưu hóa cuộc tấn công, đồng thời chứng minh rằng mô hình đang hoạt động chính xác và được xây dựng trên bộ dữ liệu cơ sở hợp lý thông qua đào tạo hợp lý. quá trình.

Thông thường, đây là kiểu suy nghĩ mà tôi quảng bá trong blog này và các bài viết khác. Nhưng khi nói đến điện toán AI, có hai phản đối chính:

- Chi phí mật mã : Thực hiện một nhiệm vụ trong SNARK (hoặc MPC, v.v.) kém hiệu quả hơn nhiều so với thực hiện tác vụ đó ở dạng văn bản thuần túy. Vì bản thân AI đã có nhu cầu tính toán cao, liệu việc thực hiện các phép tính AI trong hộp đen mật mã có khả thi về mặt tính toán không?

- Các cuộc tấn công học máy đối nghịch hộp đen : Có nhiều phương pháp để tối ưu hóa các cuộc tấn công vào mô hình AI ngay cả khi không hiểu hoạt động bên trong của mô hình. Nếu bạn giấu nó quá chặt, bạn có thể khiến người chọn tài liệu đào tạo dễ dàng xâm phạm tính toàn vẹn của mô hình thông qua một cuộc tấn công đầu độc .

Cả hai đều là những hố thỏ phức tạp cần được khám phá sâu từng cái một.

chi phí crypto

Các công cụ mật mã, đặc biệt là các công cụ có mục đích chung như ZK-SNARK và MPC, có chi phí cao. Máy trạm phải mất hàng trăm mili giây để xác minh trực tiếp khối Ethereum, nhưng việc tạo ZK-SNARK để chứng minh tính chính xác của khối đó có thể mất hàng giờ. Các công cụ crypto khác, chẳng hạn như MPC, có thể có chi phí hoạt động lớn hơn.

Bản thân điện toán AI đã cực kỳ đắt đỏ: các mô hình ngôn ngữ mạnh nhất có thể tạo ra các từ chỉ nhanh hơn một chút so với tốc độ con người có thể đọc, chưa kể chi phí tính toán hàng triệu đô la thường dành cho việc đào tạo các mô hình này. Có sự khác biệt rất lớn về chất lượng giữa các mẫu hàng đầu và các mẫu cố gắng tiết kiệm hơn về chi phí huấn luyện hoặc số lượng mồi. Thoạt nhìn, đây là lý do chính đáng để nghi ngờ toàn bộ dự án bọc AI trong mật mã để bổ sung thêm những đảm bảo mới.

May mắn thay, AI là một loại máy tính rất đặc biệt, cho phép nó thực hiện nhiều tối ưu hóa khác nhau mà các loại máy tính "phi cấu trúc" hơn như ZK-EVM không thể hưởng lợi được. Chúng ta hãy xem cấu trúc cơ bản của một mô hình AI:

Thông thường, các mô hình AI chủ yếu bao gồm sê-ri các phép nhân ma trận trong đó với các phép toán phi tuyến tính trên từng phần tử, chẳng hạn như hàm ReLU (y = max(x, 0)). Một cách tiệm cận, phép nhân ma trận chiếm phần lớn công việc. Điều này thực sự thuận tiện cho việc mã hóa, vì nhiều dạng mật mã có thể thực hiện các phép toán tuyến tính (ít nhất là phép nhân ma trận trên mô hình crypto chứ không phải trên đầu vào) gần như "miễn phí".

Nếu bạn là một nhà mật mã học, chắc hẳn bạn đã từng nghe nói về một hiện tượng tương tự trong crypto đồng cấu : rất dễ thực hiện các phép cộng trên văn bản crypto, nhưng lại rất khó thực hiện phép nhân và phải đến năm 2009, chúng ta mới tìm ra một độ sâu vô hạn. phương pháp thực hiện phép nhân.

Đối với ZK-SNARK, tương tự như giao thức năm 2013 , giao thức này tốn ít hơn 4 lần trong việc chứng minh phép nhân ma trận. Thật không may, chi phí hoạt động của các lớp phi tuyến tính vẫn còn đáng kể, với những triển khai tốt nhất trong thực tế cho thấy chi phí hoạt động ~ 200 lần.

Tuy nhiên, với nghiên cứu sâu hơn, hy vọng rằng chi phí này có thể giảm đáng kể. Bạn có thể tham khảobài trình bày của Ryan Cao, trong đó giới thiệu một phương pháp gần đây dựa trên GKR và lời giải thích đơn giản hóa của riêng tôi về các thành phần chính của GKR.

Nhưng đối với nhiều ứng dụng, chúng tôi không chỉ muốn chứng minh rằng đầu ra AI được tính toán chính xác mà còn ẩn mô hình. Có một số phương pháp dễ dàng để thực hiện việc này: bạn có thể chia mô hình để một nhóm máy chủ khác lưu trữ từng lớp một cách dư thừa và hy vọng rằng một số máy chủ nhất định rò rỉ các lớp nhất định sẽ không rò rỉ quá nhiều dữ liệu. Nhưng cũng có một số phép tính chuyên biệt đáng ngạc nhiên của bên long .

Trong cả hai trường hợp, ý nghĩa của câu chuyện là như nhau: phần chính của tính toán AI là phép nhân ma trận và các ZK-SNARK, MPC (thậm chí FHE) rất hiệu quả có thể được thiết kế để nhân ma trận, do đó đưa AI vào mật mã. trong khuôn khổ thấp một cách đáng ngạc nhiên. Thông thường, các lớp phi tuyến là nút cổ chai lớn nhất, mặc dù kích thước của chúng nhỏ hơn. Có lẽ các công nghệ mới như tra cứu có thể giúp ích.

Học máy đối nghịch hộp đen

Bây giờ, hãy thảo luận về một vấn đề quan trọng khác: ngay cả khi nội dung của mô hình vẫn ở chế độ riêng tư và bạn chỉ có "quyền truy cập API" vào mô hình, bạn vẫn có thể thực hiện các kiểu tấn công này. Để trích dẫn một bài báo năm 2016:

Nhiều mô hình học máy dễ gặp phải các ví dụ đối nghịch: đầu vào được thiết kế đặc biệt khiến mô hình học máy tạo ra kết quả đầu ra không chính xác. Một ví dụ đối nghịch ảnh hưởng đến một mô hình thường sẽ ảnh hưởng đến mô hình kia, ngay cả khi hai mô hình có kiến trúc khác nhau hoặc được huấn luyện trên các tập huấn luyện khác nhau, miễn là cả hai mô hình đều được huấn luyện để thực hiện cùng một nhiệm vụ.

Do đó, kẻ tấn công có thể huấn luyện mô hình thay thế của riêng mình, tạo ra các ví dụ đối nghịch với mô hình thay thế và chuyển chúng sang mô hình nạn nhân với rất ít thông tin về nạn nhân.

Có khả năng, bạn thậm chí có thể xây dựng một cuộc tấn công chỉ từ tài liệu đào tạo, ngay cả khi bạn có rất hạn chế hoặc không có quyền truy cập vào mô hình mà bạn muốn tấn công. Tính đến năm 2023, những kiểu tấn công này vẫn là một vấn đề nghiêm trọng.

Để ngăn chặn hiệu quả các cuộc tấn công hộp đen như vậy, chúng ta cần thực hiện hai việc:

- Thực sự giới hạn ai hoặc cái gì có thể truy vấn mô hình và số lượng truy vấn. Hộp đen có quyền truy cập API không giới hạn sẽ không an toàn; hộp đen có quyền truy cập API rất hạn chế có thể an toàn.

- Trong khi ẩn dữ liệu huấn luyện, việc đảm bảo quá trình tạo dữ liệu huấn luyện không bị hỏng là mục tiêu quan trọng.

Xét về mặt trước đây, dự án có lẽ đã thực hiện được nhiều nhất về mặt này là Worldcoin, một phiên bản đầu tiên mà tôi đã phân tích chi tiết ở đây (cũng như các giao thức khác). Worldcoin sử dụng rộng rãi các mô hình AI ở cấp độ giao thức để (i) chuyển đổi quét mống mắt thành “mã mống mắt” ngắn để dễ so sánh về độ giống nhau và (ii) xác minh rằng các đối tượng mà nó quét trên thực tế là con người.

Biện pháp phòng thủ chính Worldcoin dựa vào là nó không cho phép bất kỳ ai chỉ cần gọi mô hình AI: thay vào đó, nó sử dụng phần cứng đáng tin cậy để đảm bảo rằng mô hình chỉ chấp nhận đầu vào được ký điện tử bởi camera quả cầu.

Phương pháp này không đảm bảo sẽ hiệu quả: Hóa ra là bạn có thể tiến hành các cuộc tấn công đối nghịch vào AI sinh trắc học thông qua những thứ như miếng dán vật lý hoặc đồ trang sức đeo trên mặt.

Nhưng chúng tôi hy vọng rằng nếu bạn kết hợp tất cả các biện pháp phòng vệ, bao gồm cả việc ẩn chính mô hình AI, hạn chế nghiêm ngặt số lượng truy vấn và yêu cầu mỗi truy vấn phải được xác thực theo một cách nào đó, thì các cuộc tấn công đối nghịch sẽ trở nên rất khó khăn, do đó Make hệ thống an toàn hơn.

Điều này dẫn đến câu hỏi thứ hai: làm cách nào để ẩn dữ liệu huấn luyện?

Đây là lúc " AI được DAO quản lý một cách dân chủ " thực sự có ý nghĩa: chúng tôi có thể xây dựng DAO trên chuỗi để quản lý ai được phép gửi dữ liệu đào tạo (và các biểu diễn bắt buộc của chính dữ liệu đó), ai có thể thực hiện truy vấn và ai có thể đánh số và sử dụng các kỹ thuật mã hóa như MPC để crypto toàn bộ quá trình xây dựng và thực thi AI từ đầu vào đào tạo của từng người dùng đến đầu ra cuối cùng của mỗi truy vấn. DAO này có thể đồng thời đáp ứng mục tiêu phổ biến là đền bù cho những người gửi thông tin.

Cần phải nhắc lại rằng kế hoạch này rất tham vọng và có nhiều khía cạnh chứng tỏ nó không thực tế:

- Đối với kiến trúc hộp đen hoàn toàn như vậy, crypto có thể vẫn quá cao để cạnh tranh với phương pháp đóng "tin tưởng tôi" truyền thống.

- Sự thật có thể là không có phương pháp tốt để phi tập trung quy trình gửi tài liệu đào tạo và ngăn chặn các cuộc tấn công đầu độc.

- Thiết lập máy tính bên long có thể bị vi phạm các đảm bảo về bảo mật hoặc quyền riêng tư do sự thông đồng giữa những người tham gia: xét cho cùng, điều này đã xảy ra nhiều lần trên các cầu nối chuỗi chéo.

Một trong những lý do khiến tôi không bắt đầu phần này với lời cảnh báo "đừng làm thẩm phán AI, đó là điều viễn tưởng" là xã hội của chúng ta vốn đã phụ thuộc rất nhiều vào các thẩm phán AI tập trung vô trách nhiệm: các thuật toán quyết định loại bài đăng và quan điểm Chính trị nào được thăng chức và giáng chức, thậm chí bị kiểm duyệt trên mạng xã hội.

Tôi thực sự cho rằng rằng việc mở rộng xu hướng này hơn nữa ở giai đoạn này là một ý tưởng khá tồi, nhưng tôi không cho rằng việc cộng đồng blockchain thử nghiệm nhiều hơn với AI sẽ là lý do chính khiến tình hình trở nên tồi tệ hơn.

Trên thực tế, có một số cách rất cơ bản và rủi ro thấp mà crypto có thể cải thiện ngay cả các hệ thống tập trung hiện có và tôi khá tự tin về điều đó. Trong đó kỹ thuật đơn giản là AI xác minh phát hành chậm: khi một trang mạng xã hội sử dụng xếp hạng bài đăng dựa trên AI, nó có thể phát hành ZK-SNARK để chứng minh giá trị băm của mô hình đã tạo ra thứ hạng. Trang web có thể hứa sẽ công khai mô hình AI của mình sau một thời gian trì hoãn nhất định, chẳng hạn như một năm.

Sau khi một mô hình được công khai, người dùng có thể kiểm tra giá trị băm để xác minh rằng mô hình chính xác đã được phát hành và cộng đồng có thể kiểm tra mô hình để xác minh tính công bằng của nó. Việc trì hoãn phát hành sẽ đảm bảo rằng vào thời điểm mô hình được phát hành, nó đã lỗi thời.

Vì vậy, câu hỏi không phải là liệu chúng ta có thể làm tốt hơn so với thế giới tập trung hay không, mà là chúng ta có thể làm điều đó tốt đến mức nào. Tuy nhiên, đối với phi tập trung , cần phải thận trọng: nếu ai đó xây dựng một thị trường dự đoán hoặc stablecoin sử dụng oracle AI và sau đó ai đó phát hiện ra rằng oracle có thể bị hack thì sẽ có một số tiền lớn có thể bị mất. ngay lập tức.

AI là mục tiêu trò chơi

Nếu các kỹ thuật trên để xây dựng AI riêng tư phi tập trung mở rộng có thể mở rộng, có nội dung là hộp đen mà không ai biết đến, thực sự có thể hoạt động, thì điều này cũng có thể được sử dụng để xây dựng AI riêng tư phi tập trung có thể mở rộng, có tiện ích vượt qua blockchain. Đội ngũ Giao thức NEAR đang biến điều này thành mục tiêu cốt lõi trong công việc đang diễn ra của họ.

Có hai lý do cho việc này:

Nếu "AI hộp đen tín nhiệm " có thể được xây dựng bằng cách sử dụng sự kết hợp nào đó giữa blockchain và tính toán bên long để thực hiện quá trình đào tạo và suy đoán , thì nhiều ứng dụng mà người dùng lo lắng về sự thiên vị hoặc lừa đảo của hệ thống có thể được hưởng lợi. Nhiều người đã bày tỏ mong muốn quản trị dân chủ đối với AI mà chúng tôi dựa vào; mật mã và công nghệ dựa trên blockchain có thể là cách để đạt được điều này.

Từ góc độ bảo mật AI, đây sẽ là công nghệ xây dựng AI phi tập trung đồng thời có công tắc dừng khẩn cấp tự nhiên và hạn chế các truy vấn cố gắng sử dụng AI cho hành vi nguy hiểm.

Điều đáng chú ý là có thể đạt được “việc sử dụng khích lệ crypto để khuyến khích tạo ra AI tốt hơn” mà không hoàn toàn rơi vào tình trạng khó khăn khi sử dụng crypto hoàn toàn bằng mật mã: phương pháp như BitTensor thuộc loại này.

Tóm lại là

Khi blockchain và AI tiếp tục phát triển, các trường hợp ứng dụng ở điểm giao nhau của cả hai cũng ngày càng tăng trong đó có ý nghĩa và mạnh mẽ hơn.

Nói chung, các cơ chế cơ bản đó về cơ bản vẫn giữ nguyên thiết kế, nhưng những người tham gia riêng lẻ sẽ trở thành trường hợp ứng dụng AI và các cơ chế được thực thi hiệu quả ở cấp độ vi mô hơn là những cơ chế hứa hẹn nhất và dễ thực hiện nhất.

Thử thách lớn nhất là những ứng dụng cố gắng sử dụng blockchain và mật mã để xây dựng “singleton”: AI đáng tin cậy phi tập trung duy nhất mà một số ứng dụng nhất định dựa vào cho một số mục đích.

Các ứng dụng này có tiềm năng vừa hoạt động vừa cải thiện bảo mật AI, đồng thời tránh được rủi ro việc tập trung hóa.

Nhưng những giả định cơ bản cũng có thể thất bại theo nhiều cách. Do đó, cần thận trọng khi triển khai các ứng dụng này, đặc biệt là trong hoàn cảnh có giá trị cao và rủi ro cao.

Tôi mong muốn được thấy nhiều nỗ lực mang tính xây dựng hơn đối với các trường hợp sử dụng AI trong tất cả các lĩnh vực này, để chúng tôi có thể xem trường hợp sử dụng nào thực sự khả thi trên quy mô lớn.