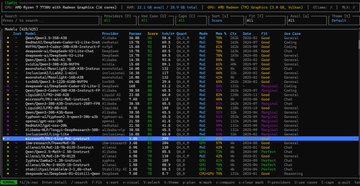

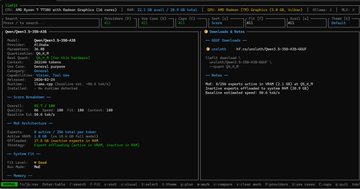

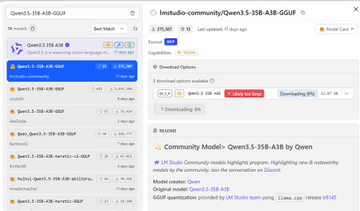

本地运行小龙虾最好的还是基于Ryzen 7 处理器的Windows Mini PC - 因为我们还可以在本地运行Qwen 3模型! 环境:Windows 11 pro, AMD Ryzen 7 7730U with Radeon graphics 16 cores, 32G RAM 1) PowerShell Admin下,安装scoop Set-ExecutionPolicy -ExecutionPolicy RemoteSigned -Scope CurrentUser Invoke-RestMethod -Uri get.scoop.sh | Invoke-Expression 2) 用 scoop 安装 llmfit scoop install llmfit 3) 运行 llmfit,找到最适合该电脑的开源本地大模型 Qwen3.5-35B-A3B(MoE架构,总35B参数但只激活3B),推理效率极高,加载时需要全部权重。 Q3_K_M ≈ 16-17GB(16GB RAM) Q4_K_M ≈ 21-22GB(32GB RAM) 4)安装 LM Studio(Windows版) lmstudio.ai 下载后直接双击安装 5) 运行 lmstudio , 搜索 Qwen3.5-35B-A3B 选择:Qwen3.5-35B-A3B-GGUF 版本 下载:Q3_K_M Q4_K_M 6)选择下面的参数,启动你下载的模型: Context Length:16384 后面觉得稳再拉32768 GPU Offload:直接拉到 40 如果加载失败就退到35 CPU Thread Pool Size:拉到 16 Evaluation Batch Size:改成 512 Max Concurrent Predictions:保持 4 Unified KV Cache:保持 开启 Offload KV Cache to GPU Memory:保持开启 Number of Experts:保持 8 Number of layers for which to force MoE weights onto CPU:改成 0 不让MoE层回CPU,全GPU加速 Flash Attention 开启 Keep Model in Memory 开启 Try mmap 开启 RoPE Auto Remember settings:勾上,下次一键加载 点 Load Model,第一次加载会花1-3分钟(全offload要搬运大文件),耐心等。加载成功后直接聊天测试。 Tips: BIOS里iGPU共享内存设到8GB,速度还能再挤一点。 开始聊天!100% 本地化的LLM,安全,放心。

Kenny.eth

@_0xKenny

03-10

新购龙虾🦞小主机 - Windows Mini PC,甚至可以跑轻量级本地小模型。

放在家里平时帮我处理的大部分网站访问需求,定期缴纳各种费用、查询邮件等等,全部用OpenClaw自动化。

GMKtec M5 Ultra Gaming Mini PC Ryzen 7 7730U (Upgraded 7430U/ 5825U), 32GB RAM 512GB SSD Dual NIC LAN 2.5GbE Desktop

来自推特

免责声明:以上内容仅为作者观点,不代表Followin的任何立场,不构成与Followin相关的任何投资建议。

喜欢

收藏

评论

分享