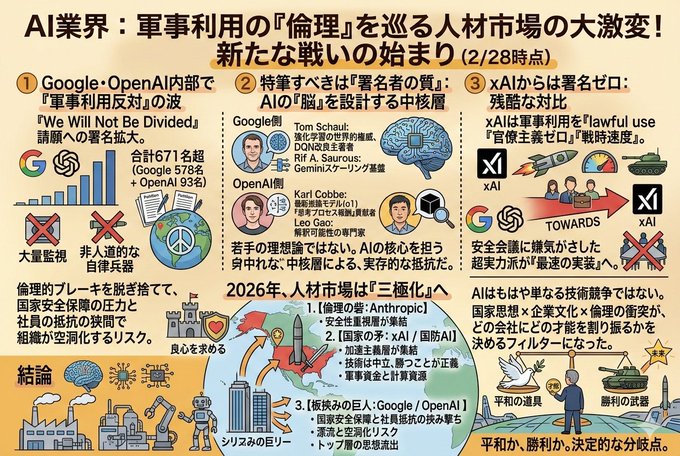

Anthropic 與美國戰爭部之間的糾紛對谷歌和 OpenAI 產生了重大影響。 *** 人工智能行業在招聘方面發生了重大轉變,焦點集中在軍事用途的“倫理”問題上。一場新的鬥爭已經打響。 反對將人工智能用於軍事用途(大規模監控、不人道的自主武器)的“我們不會分裂”請願書在谷歌和 OpenAI 內部的簽名人數正在迅速增加。 (截至 2 月 28 日:578 名谷歌成員 + 93 名 OpenAI 成員 = 總計超過 671 人)notdivided.org 值得注意的是“簽名者的質量”,而非簽名者的數量。 ■ 核心人工智能領域的簽名者 • 谷歌 • Tom Schaul:強化學習領域的權威專家,DQN 改進算法的主要作者。 • Rif A. Saurus:負責支持 Gemini 擴展基礎設施的高級研究員。 • OpenAI • Karl Cobbe:最新推理模型 (o1) 中“思維過程獎勵”組件的貢獻者。Leo Gao:一位“可解釋性”專家,致力於揭開人工智能的黑箱。這並非年輕人的理想主義,而是設計人工智能“大腦”的核心團隊的生存抗爭。 ■ 與此同時,xAI 沒有任何簽名。 對比鮮明。 xAI 提倡“零官僚主義”和“戰時速度”,並吸引著那些將軍事用途視為“合法用途”的人才。厭倦了谷歌/OpenAI“頻繁的安全會議”,高技能人才正在拋開道德束縛,專注於“最快的實施”。 ■ 2026年:人才市場將呈現“三極格局”。 這種道德衝突正直接導致“人工智能人才的大規模遷移”。 1. [人類學:倫理的堡壘] 即使面臨被認定為“供應鏈風險”的風險,也要拒絕政府的壓力。像谷歌/OpenAI簽名成員這樣的“安全意識人士”正在聚集,尋求良知。2. [國家的利矛:xAI/國防人工智能] 信奉“技術是中立的,勝利即正義”的加速主義陣營已經集結。在軍方資金的推動下,他們正利用壓倒性的計算資源大幅提升人工智能水平。 3. [夾縫中的巨頭:谷歌/OpenAI] 在國家安全壓力和員工抵制之間搖擺不定,谷歌面臨著組織內部空洞化的風險,因為其高層管理人員為了尋求“意識形態上的契合”而走向兩個極端。 ■ 結論 人工智能不再僅僅是一場技術競賽。“國家意識形態×企業文化×倫理”的衝突已成為決定人才分配到哪些公司的過濾器。我們現在正處於一個關鍵時刻,人工智能究竟會成為“和平的工具”還是“勝利的武器”。

本文為機器翻譯

展示原文

相关赛道:

來自推特

免責聲明:以上內容僅為作者觀點,不代表Followin的任何立場,不構成與Followin相關的任何投資建議。

喜歡

收藏

評論

分享