Tác giả: @giantcutie666

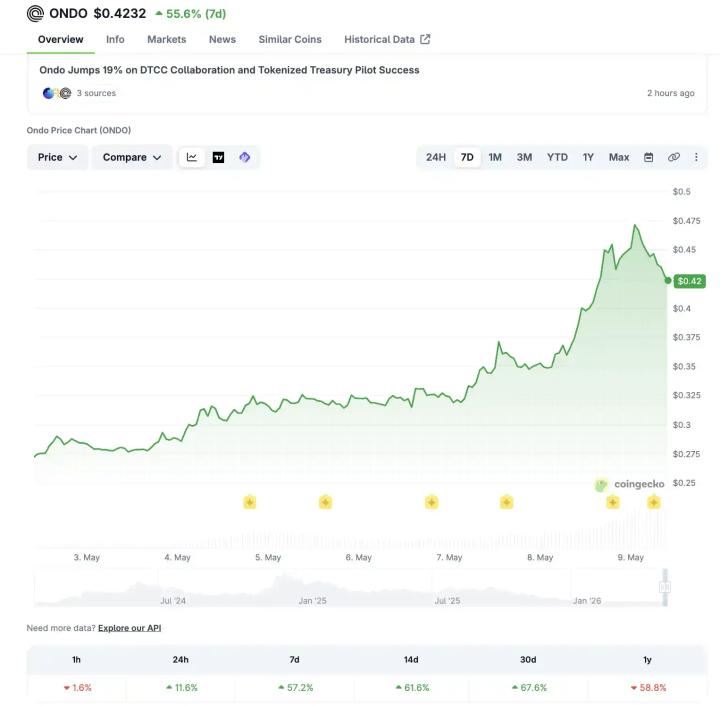

Vào năm 2024, Leopold Aschenbrenner, một thiên tài sinh vào những năm 2000, đã rời OpenAI để thành lập một quỹ.

Ông cũng ghi lại chiến lược đầu tư của mình:

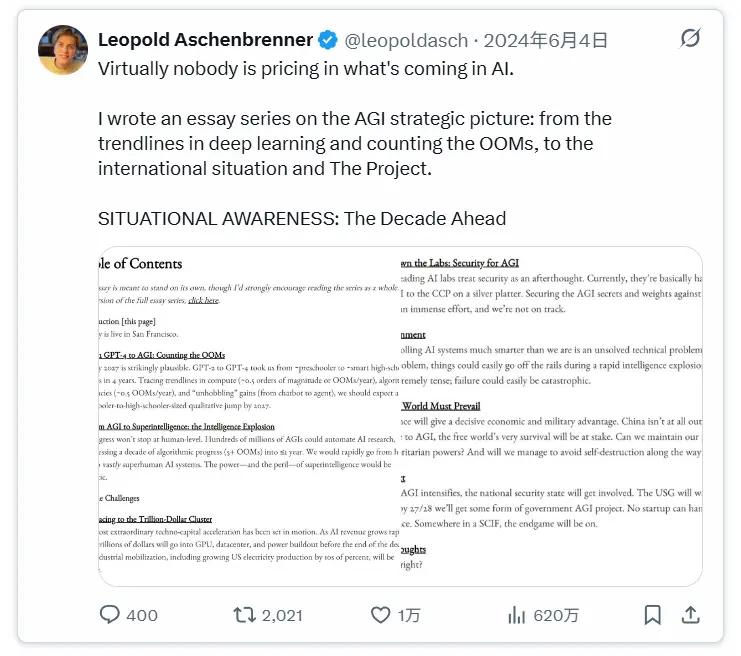

Nhìn lại bây giờ, bài báo dài 165 trang này, "Nhận thức tình huống: Thập kỷ phía trước," đã trở nên huyền thoại.

Những ai hiểu được điều này vào năm ngoái chắc chắn đã đạt được tự do tài chính trong năm nay!

Tôi đã đính kèm bản gốc tiếng Anh gồm 165 trang ở đây ; bên dưới là phiên bản đơn giản hóa mà tôi đã cố gắng tạo ra:

Quan điểm chính của bài báo là trong thập kỷ tới, con người sẽ tạo ra trí tuệ nhân tạo tổng quát (AGI - có khả năng thực hiện tất cả các công việc của người bình thường), tiếp theo là siêu trí tuệ.

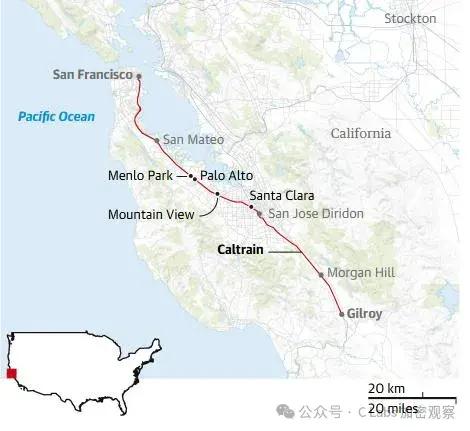

Hiện tại chỉ có vài trăm người hiểu điều này, hầu hết tập trung trên một vài con phố ở San Francisco. Những người khác—bao gồm Phố Wall, giới truyền thông và Washington—vẫn chưa nắm bắt được (mặc dù một số người ở Phố Wall đã có ý tưởng này trong năm nay).

Phần 1: Tại sao Trí tuệ Nhân tạo Tổng quát (AGI) sẽ tồn tại vào năm 2027?

Phương pháp vụng về nhưng hiệu quả: nó không dự đoán thời gian, mà là quy mô của tỷ lệ băm.

Trong bốn năm qua, từ GPT-2 đến GPT-4, “tỷ lệ băm hiệu quả” của mô hình đã tăng khoảng 100.000 lần, tức tăng trưởng gấp mười lần sau mỗi sáu tháng!

GPT-2 giống như một đứa trẻ mẫu giáo đang chật vật viết những câu văn tương đối mạch lạc, trong khi GPT-4 giống như một học sinh trung học xuất sắc vượt qua tư cách luật sư và giải quyết các vấn đề khoa học ở trình độ tiến sĩ.

Sự tăng trưởng gấp 100.000 lần này đến từ ba nguồn:

Đầu tiên, đó là khoản đầu tư khổng lồ vào phần cứng. Tỷ lệ băm được sử dụng để huấn luyện tăng hơn ba lần mỗi năm. Định luật Moore chỉ làm tăng sức mạnh tính toán lên 1,3 lần mỗi năm, nhưng trí tuệ nhân tạo (AI) nhanh hơn gấp năm lần vì mọi người đang đầu tư mạnh vào và phát triển các chip AI.

Thứ hai, các thuật toán đang trở nên thông minh hơn. Để đạt được khả năng toán học tương tự, chi phí suy luận ngày nay rẻ hơn 1.000 lần so với hai năm trước; điều này là nhờ những nỗ lực của các kỹ sư thuật toán.

Thứ ba, tính năng thú vị nhất là khả năng gỡ bỏ các hạn chế, điều mà thường bị vô hiệu hóa theo mặc định.

Bản thân mô hình này có nhiều khả năng, nhưng chúng bị hạn chế bởi các cài đặt mặc định. Ví dụ, mô hình cơ bản trước đây của ChatGPT thực sự rất thông minh, nhưng khi sử dụng nó lại phát ra âm thanh khó hiểu — RLHF đã mở khóa khả năng này.

Ví dụ, cho phép mô hình "suy nghĩ một lúc trước khi trả lời" (chuỗi suy nghĩ) sẽ mở khóa khả năng lập luận của nó. Cung cấp cho nó các công cụ và xây dựng bộ nhớ sẽ mở khóa thêm một lớp khả năng khác.

Tác giả dự đoán rằng ba con đường này sẽ tăng thêm 100.000 lần nữa trong bốn năm tới (cho đến năm 2027).

Những hiểu biết quan trọng nhất nằm ở việc gỡ bỏ những rào cản:

Mô hình hiện tại chỉ có thể "suy nghĩ trong vài phút" - khoảng vài trăm token - trong một lần suy luận. Điều gì sẽ xảy ra nếu nó có thể "suy nghĩ trong nhiều tháng" - hàng triệu token?

Ví dụ, sự khác biệt giữa bạn và Einstein ít hơn nhiều so với sự khác biệt giữa "suy nghĩ trong 5 phút" và "suy nghĩ trong 5 tháng".

Nếu việc mở khóa này thành công, nó sẽ tương đương với một bước nhảy vọt về trí tuệ gấp 3 đến 4 bậc độ lớn. Kết quả đã bắt đầu hiện hữu.

Dựa trên sự ngoại suy này, khoảng năm 2027, sẽ xuất hiện một trí tuệ nhân tạo (AI) có khả năng làm việc độc lập trong vài tuần như một nhân viên làm việc từ xa, lập kế hoạch nhiệm vụ, viết mã, tiến hành thí nghiệm, sửa lỗi và gửi kết quả.

Nó có thể thay thế hoàn toàn một nhà nghiên cứu của OpenAI; đây chính là định nghĩa về Trí tuệ Nhân tạo Tổng quát (AGI) của các tác giả.

Sự không chắc chắn lớn nhất đến từ bức tường dữ liệu— dữ liệu internet chất lượng cao, công khai đang được sử dụng rất nhanh.

Phần Hai: Trí tuệ nhân tạo tổng quát (AGI) không phải là điểm kết thúc, mà là điểm bùng phát.

Điều gì sẽ xảy ra khi trí tuệ nhân tạo (AI) có thể làm được công việc của các nhà nghiên cứu AI?

Tỷ lệ băm vẫn giữ nguyên, nhưng bạn không còn bị giới hạn bởi "hàng trăm nhà nghiên cứu tại OpenAI, Anthropic và DeepMind cộng lại" nữa — bạn có thể chạy 100 triệu bản sao của các nhà nghiên cứu AI, mỗi bản sao hoạt động với tốc độ nhanh gấp 100 lần so với con người.

Sản lượng đạt được trong vài ngày tương đương với công sức của một người trong cả năm.

Các nhà nghiên cứu tự động hóa này cũng có những lợi thế về mặt cấu trúc: họ có thể đọc tất cả các bài báo về học máy, ghi nhớ mọi thí nghiệm, chia sẻ trực tiếp suy nghĩ của mình giữa các bản sao và đào tạo một hệ thống để huấn luyện tất cả (mà không cần phải đào tạo từng nhân viên mới một cách chậm chạp).

Điều này có nghĩa là những gì mà con người thường mất 10 năm để phát triển thuật toán có thể được hoàn thành chỉ trong 1 năm.

Sau đó, trong vòng một năm, một mô hình thế hệ tiếp theo thậm chí còn thông minh hơn sẽ xuất hiện, và quá trình này sẽ tiếp diễn vô thời hạn. Từ trí tuệ nhân tạo tổng quát (AGI) đến siêu trí tuệ vượt xa khả năng của con người, quá trình này có thể chỉ mất vài tháng đến một hoặc hai năm.

Tác giả thừa nhận rằng có những điểm nghẽn—ví dụ, các thí nghiệm đòi hỏi tỷ lệ băm, và ngay cả với nhiều bản sao, GPU vẫn cần thiết. Tuy nhiên, ông lập luận rằng những điểm nghẽn này cùng lắm chỉ có thể làm chậm sự bùng nổ, chứ không thể ngăn chặn nó.

Trí tuệ nhân tạo siêu việt trông như thế nào?

Với quy mô siêu phàm—hàng trăm triệu bản sao chạy song song, ngay lập tức hợp nhất trên mọi lĩnh vực, tích lũy lượng kiến thức tương đương với một nghìn năm kinh nghiệm của con người chỉ trong vài tuần.

Nó vượt trội về mặt chất lượng—như nước đi số 37 của AlphaGo (một nước đi mà các chuyên gia hàng chục năm nay không thể nghĩ ra)—nhưng có thể áp dụng cho mọi lĩnh vực. Nó có thể tìm ra các lỗ hổng trong mã nguồn mà con người không bao giờ có thể nhìn thấy trong suốt cuộc đời, và viết ra những đoạn mã mà con người không bao giờ có thể hiểu được.

Chúng ta sẽ đọc luận án tiến sĩ như thể đó là bài học dành cho học sinh tiểu học.

Hậu quả là: vấn đề về robot được giải quyết (chủ yếu là vấn đề về thuật toán học máy, chứ không phải phần cứng), sinh học tổng hợp được vũ khí hóa, và các đàn máy bay không người lái tàng hình có thể phá hủy vũ khí hạt nhân trước khi sự việc xảy ra.

Toàn bộ cán cân quân sự quốc tế sẽ bị đảo lộn trong vòng vài năm tới.

Phần Ba: Bốn Vấn Đề Cấp Bận Trước Mắt

Vấn đề 1: Một cụm trị giá nghìn tỷ đô la

Cuộc thi này không chỉ đơn thuần là về việc các lập trình viên viết mã; nó còn là một cuộc huy động nguồn lực công nghiệp.

Mỗi thế hệ mô hình đều cần một cụm máy tính lớn hơn, cụm máy tính lớn hơn cần một nhà máy điện, và nhà máy điện cần một nhà máy sản xuất chip.

Với tốc độ hiện tại: cụm năng lượng mặt trời 1GW vào năm 2026 (lượng điện từ một đập Hoover), 10GW vào năm 2028 (lượng điện từ một tiểu bang cỡ trung bình của Mỹ), và 100GW vào năm 2030 (hơn 20% tổng lượng điện được sản xuất tại Mỹ).

Quy mô đầu tư có thể vượt quá 1 nghìn tỷ đô la mỗi năm vào năm 2027.

Nút thắt cổ chai thực sự không phải là tiền bạc hay GPU, mà là điện năng. "Tôi sẽ tìm đâu ra 10GW điện?" là chủ đề nóng nhất ở San Francisco hiện nay.

Để xây dựng nó trên lãnh thổ Hoa Kỳ, các thủ tục phê duyệt môi trường phải được nới lỏng và quyền lực liên bang phải được sử dụng để giải phóng đất đai—tác giả tăng vấn đề này lên tầm an ninh quốc gia.

Nếu Mỹ không thể xây dựng được nó, cụm máy tính này sẽ thuộc về UAE hoặc Ả Rập Xê Út, điều này tương đương với việc giao chìa khóa trí tuệ nhân tạo tổng quát (AGI) cho các quốc gia độc tài.

Vấn đề 2: Phòng thí nghiệm bị rò rỉ.

Các phòng thí nghiệm AI hiện nay có mức độ an toàn tương đương với các công ty khởi nghiệp điển hình ở Thung lũng Silicon.

Google DeepMind (công ty hàng đầu trong ngành) tự thừa nhận rằng khả năng phòng thủ của họ trước các đối thủ là các quốc gia đang ở mức 0 (trên thang điểm 4).

Điều này có nghĩa là gì? "Tỷ trọng" của một mô hình AGI về cơ bản là một tập tin lớn trên máy chủ.

Việc đánh cắp tài liệu này chẳng khác nào giao trực tiếp "các nhà nghiên cứu trí tuệ nhân tạo tự động" cho Trung Quốc - họ có thể ngay lập tức tạo ra sự bùng nổ trí tuệ nhân tạo của riêng mình, khiến tất cả các vị trí lãnh đạo của Mỹ trở nên vô giá trị.

Điều cấp bách hơn nữa là những bí mật của thuật toán — một bước đột phá quan trọng cho mô hình thế hệ tiếp theo (làm thế nào để phá vỡ bức tường dữ liệu) đang dần hình thành trong các cuộc gọi Slack và bên ngoài cửa sổ văn phòng của các công ty tại San Francisco.

Tác giả khẳng định rằng một bước đột phá quan trọng về trí tuệ nhân tạo tổng quát (AGI) sẽ bị rò rỉ sang Trung Quốc trong vòng 12 đến 24 tháng tới. Không chỉ là có thể, mà gần như chắc chắn là sẽ xảy ra.

Để đạt được mức độ an ninh tương đương với Bộ An ninh Quốc gia Trung Quốc sẽ cần đến sự cô lập ở cấp độ phần cứng, kiểm tra lý lịch nhân sự ở mức độ tương đương với các kỹ sư chế tạo bom nguyên tử, và thiết kế cụm máy chủ chuyên biệt—tất cả những điều này sẽ cần ít nhất vài năm phát triển lặp đi lặp lại để xây dựng. Nếu không hành động ngay lập tức, an ninh sẽ tụt hậu khi trí tuệ nhân tạo tổng quát (AGI) được mua lại vào năm 2027, chỉ còn lại hai lựa chọn tồi tệ: hoặc giao trực tiếp cho một quốc gia khác, hoặc dừng lại và chờ đợi cho đến khi an ninh được thiết lập (có khả năng mất lợi thế).

Vấn đề 3: Các vấn đề về căn chỉnh

Kỹ thuật căn chỉnh hiện tại được gọi là RLHF — con người đánh giá mô hình, và mô hình học cách làm hài lòng con người.

Phương pháp này hiệu quả khi trí tuệ nhân tạo (AI) kém thông minh hơn con người. Tuy nhiên, một khi AI trở nên thông minh hơn con người nhiều bậc, phương pháp này hoàn toàn thất bại — làm sao bạn có thể đánh giá một luận án tiến sĩ mà bạn không thể hiểu được?

Sự bùng nổ của công nghệ thông minh đã khiến vấn đề này trở nên vô cùng căng thẳng:

Chỉ trong chưa đầy một năm, tình hình đã chuyển từ "RLHF vẫn hoạt động" sang "RLHF hoàn toàn không hoạt động", không còn thời gian để thử nghiệm và điều chỉnh nhiều lần.

Đồng thời, nó nhảy từ "lỗi nhỏ" (lời chửi thề của ChatGPT) sang "lỗi nghiêm trọng" (siêu trí tuệ thoát ra khỏi cụm máy chủ và tấn công các hệ thống quân sự).

Cấu trúc trung gian đã trải qua nhiều thế hệ tiến hóa, và siêu trí tuệ cuối cùng hoàn toàn vượt quá khả năng hiểu biết của chúng ta về cách thức tư duy của nó.

Mô hình hiện tại sử dụng các từ ngữ tiếng Anh để suy luận (khá dễ hiểu), nhưng rất có thể trong tương lai nó sẽ phát triển thành suy luận trạng thái tiềm ẩn bên trong—điều này hoàn toàn không thể giải thích được.

Các tác giả lạc quan về giải pháp công nghệ: có nhiều giải pháp dễ thực hiện và đã có những tiến bộ trong các nghiên cứu về khả năng giải thích.

Nhưng người ta cực kỳ bi quan về khả năng thực hiện của tổ chức này—có lẽ chỉ có vài chục người trên toàn thế giới thực sự làm việc này một cách nghiêm túc, và phòng thí nghiệm không cho thấy dấu hiệu nào về việc trả giá giá cho sự an toàn. "Chúng ta đang dựa quá nhiều vào may mắn."

Vấn đề thứ tư: Thế giới tự do phải thắng

Tác giả dành lượng lớn trang để lập luận rằng một số quốc gia không những không bị loại mà còn rất cạnh tranh.

Về tỷ lệ băm: Chip 7nm của Huawei (do SMIC sản xuất) có hiệu năng tương đương với NVIDIA A100, với tỷ lệ hiệu năng trên giá thành kém hơn 2-3 lần, nhưng vẫn đủ dùng cho hầu hết người dùng.

Năng lực xây dựng: Công suất phát điện mới của Trung Quốc trong thập kỷ qua tương đương với toàn bộ công suất phát điện lắp đặt của Hoa Kỳ. Về năng lực huy động công nghiệp để xây dựng một cụm điện lực 100GW, Trung Quốc có thể mạnh hơn Hoa Kỳ.

Lộ trình đánh cắp: Chừng nào các phòng thí nghiệm của Mỹ vẫn chưa bị khóa, các thuật toán quan trọng chắc chắn sẽ bị rò rỉ trong vòng hai năm.

Có một sự trùng hợp đáng lo ngại trên dòng thời gian: mốc thời gian của Trí tuệ Nhân tạo Tổng quát (AGI) (~2027) và thời điểm có cơ hội để Đảng Cộng sản Trung Quốc tấn công Đài Loan (~2027) được các nhà quan sát eo biển Đài Loan ghi nhận đang hội tụ. "Sự kết thúc của AGI có thể diễn ra trong bối cảnh một cuộc chiến tranh thế giới."

Tác giả kết luận rằng Hoa Kỳ phải duy trì "lợi thế dẫn đầu lành mạnh"—ông đề xuất hai năm. Khoảng thời gian hai năm này nhằm ổn định tình hình và đàm phán với Trung Quốc về trật tự quốc tế trong kỷ nguyên hậu siêu trí tuệ.

Nếu chúng ta không đạt được lợi thế này, toàn thế giới sẽ rơi vào "cuộc đua sinh tồn giữa sự bùng nổ trí tuệ" - mọi giới hạn an toàn sẽ bị giảm xuống bằng không, và mọi người sẽ chạy đua với tốc độ mà không có bất kỳ biện pháp an toàn nào.

Phần bốn: Dự án (Phiên bản AGI của Dự án Manhattan)

Tại đây, tác giả đưa ra dự đoán táo bạo nhất trong toàn bộ cuốn sách.

Chính phủ Mỹ không thể nào cho phép một công ty khởi nghiệp nhỏ, độc lập phát triển siêu trí tuệ. Hãy tưởng tượng việc sử dụng Uber để phát triển bom nguyên tử thì sao.

Dự đoán: Vào khoảng năm 2027 hoặc 2028, bộ máy an ninh quốc gia Hoa Kỳ sẽ tiếp quản dự án Trí tuệ Nhân tạo Tổng quát (AGI) dưới một hình thức nào đó. Điều này có thể diễn ra dưới mô hình nhà thầu quốc phòng (OpenAI trở thành Lockheed Martin), mô hình liên doanh (các nhà cung cấp dịch vụ đám mây + phòng thí nghiệm + chính phủ), hoặc thậm chí là hình thức cực đoan hơn là quốc hữu hóa.

Các nhà nghiên cứu cốt lõi đã chuyển đến cơ sở an ninh SCIF, và cụm máy tính trị giá nghìn tỷ đô la được xây dựng với tốc độ thời chiến.

Lộ trình hình thành: Màn trình diễn năng lực đáng sợ lần sẽ xuất hiện vào năm 2026/27 — đó có thể là "giúp những người mới bắt đầu chế tạo vũ khí sinh học", hoặc trí tuệ nhân tạo tự động tấn công vào cơ sở hạ tầng trọng yếu.

Khi những chi tiết về việc Đảng Cộng sản Trung Quốc thâm nhập các phòng thí nghiệm được tiết lộ, bầu không khí ở Washington đã thay đổi đáng kể. "Liệu chúng ta có cần Dự án Manhattan về Trí tuệ Nhân tạo Tổng quát?" Câu hỏi này ban đầu được đặt ra một cách chậm rãi, sau đó đột ngột trở thành vấn đề hàng đầu.

Tại sao lại phải là chính phủ? Bởi vì siêu trí tuệ thuộc loại vũ khí hạt nhân, chứ không phải internet. Các công ty tư nhân chưa bao giờ được phép sở hữu vũ khí hạt nhân hoàn chỉnh.

Để đạt được mức độ an ninh đủ sức chống lại toàn bộ sức mạnh của Trung Quốc, chỉ có cơ sở hạ tầng của chính phủ mới làm được. Quản lý một "vụ nổ thông minh" - một quá trình "viết lại mọi thứ trong vòng một năm" - đòi hỏi một Chuỗi chỉ huy cấp độ hạt nhân, chứ không phải một hội đồng quản trị của một công ty khởi nghiệp.

Tác giả không ảo tưởng về hiệu quả hoạt động của chính phủ (Dự án Manhattan cũng bị trì hoãn do thủ tục hành chính rườm rà), nhưng không có lựa chọn nào tốt hơn.

Phần năm: Lời thú nhận của tác giả

Tác giả chỉ trích cả hai phe đối lập vì đã mắc sai lầm:

Những người theo chủ nghĩa gia tốc (e/acc) cho rằng thị trường sẽ tự điều chỉnh, bỏ qua những khó khăn thực sự về sự phù hợp và an ninh.

Những người theo thuyết tận thế chủ trương dừng mọi thứ lại — nhưng Trung Quốc sẽ không dừng lại; dừng lại đồng nghĩa với việc thừa nhận thất bại.

Tác giả của "Tư thế đúng" là AGI. Chủ nghĩa hiện thực:

① Siêu trí tuệ là một công nghệ mang tính quyết định đối với an ninh quốc gia.

②Rủi rủi ro là có thật và chúng ta chưa chuẩn bị sẵn sàng.

③ Hoa Kỳ phải đảm nhận Dự án và dẫn dắt trật tự quốc tế hậu siêu trí tuệ.

Vài trăm người trên một vài con phố ở khu vực Vịnh San Francisco đang quyết định hướng đi của toàn bộ nền văn minh.